Windows下搭建hadoop 搭建本地hadoop开发环境

2018-03-27 19:01

621 查看

一、下载所需文件

1.JDK下载地址:点击打开链接

2.Hadoop下载地址:点击打开链接

3.Windows下安装Hadoop工具下载地址:点击打开链接 密码:yk9u

二、jdk安装

1.不会看这里点击打开链接

三、Hadoop环境配置

1.下载Hadoop,并解压到你的本地目录,我下载的是hadoop-2.5.2版本,解压在D:\hadoop\hadoop-2.5.2。

四、配置Hadoop的环境变量

1.计算机 –>属性 –>高级系统设置 –>高级选项卡 –>环境变量 –> 单击新建HADOOP_HOME

注意:路径到bin的上级目录即可。

2.Path环境变量下配置【%HADOOP_HOME%\bin;】变量

五、配置Hadoop文件

1.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”下的core-site.xml文件,将下列文本粘贴进去,并保存。<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>/D:/hadoop/workplace/tmp</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>/D:/hadoop/workplace/name</value>

</property>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration> 2.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”目录下的mapred-site.xml(如果不存在将mapred-site.xml.template重命名为mapred-site.xml)文件,粘贴一下内容并保存。

<!-- 这个参数设置为1,因为是单机版hadoop -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.data.dir</name>

<value>/D:/hadoop/workplace/data</value>

</property>

</configuration> 4.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”目录下的yarn-site.xml文件,粘贴以下内容并保存。

set JAVA_HOME=D:\java\jdk六、替换文件

将1.3下载到的hadooponwindows-master.zip,解压,将全部bin目录文件替换至hadoop目录下的bin目录。

七、运行环境 1.运行cmd窗口,执行hdfs namenode -format。

2.运行cmd窗口,切换到hadoop的sbin目录,执行start-all.cmd,它将会启动以下4个进程窗口。

八、上传测试根据你core-site.xml的配置,接下来你就可以通过:hdfs://localhost:9000来对hdfs进行操作了。1.创建输入目录

QA常见问题:

1:启动hadoop可能提示找不到JAVA_HOME路径,是因为hadoop读取JAVA_HOME环境变量存在空格导致。

2:启动hadoop提示找不到HADOOP,是因为Hadoop环境变量没有配置好,请检查Hadoop环境变量配置。

2.节点管理GUI:http://localhost:50070/

1.JDK下载地址:点击打开链接

2.Hadoop下载地址:点击打开链接

3.Windows下安装Hadoop工具下载地址:点击打开链接 密码:yk9u

二、jdk安装

1.不会看这里点击打开链接

三、Hadoop环境配置

1.下载Hadoop,并解压到你的本地目录,我下载的是hadoop-2.5.2版本,解压在D:\hadoop\hadoop-2.5.2。

四、配置Hadoop的环境变量

1.计算机 –>属性 –>高级系统设置 –>高级选项卡 –>环境变量 –> 单击新建HADOOP_HOME

注意:路径到bin的上级目录即可。

2.Path环境变量下配置【%HADOOP_HOME%\bin;】变量

五、配置Hadoop文件

1.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”下的core-site.xml文件,将下列文本粘贴进去,并保存。<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>/D:/hadoop/workplace/tmp</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>/D:/hadoop/workplace/name</value>

</property>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration> 2.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”目录下的mapred-site.xml(如果不存在将mapred-site.xml.template重命名为mapred-site.xml)文件,粘贴一下内容并保存。

<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> <property> <name>mapred.job.tracker</name> <value>hdfs://localhost:9001</value> </property> </configuration>3.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”目录下的hdfs-site.xml文件,粘贴以下内容并保存。<configuration>

<!-- 这个参数设置为1,因为是单机版hadoop -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.data.dir</name>

<value>/D:/hadoop/workplace/data</value>

</property>

</configuration> 4.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”目录下的yarn-site.xml文件,粘贴以下内容并保存。

<configuration> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <property> <name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name> <value>org.apache.hadoop.mapred.ShuffleHandler</value> </property> </configuration>5.编辑“D:\hadoop\hadoop-2.5.2\etc\hadoop”目录下的hadoop-env.cmd文件,将JAVA_HOME用 @rem注释掉,编辑为JAVA_HOME的路径,然后保存。@rem set JAVA_HOME=%JAVA_HOME%

set JAVA_HOME=D:\java\jdk六、替换文件

将1.3下载到的hadooponwindows-master.zip,解压,将全部bin目录文件替换至hadoop目录下的bin目录。

七、运行环境 1.运行cmd窗口,执行hdfs namenode -format。

2.运行cmd窗口,切换到hadoop的sbin目录,执行start-all.cmd,它将会启动以下4个进程窗口。

八、上传测试根据你core-site.xml的配置,接下来你就可以通过:hdfs://localhost:9000来对hdfs进行操作了。1.创建输入目录

C:\WINDOWS\system32>hadoop fs -mkdir hdfs://localhost:9000/user/ C:\WINDOWS\system32>hadoop fs -mkdir hdfs://localhost:9000/user/wcinput2.上传数据到目录

C:\WINDOWS\system32>hadoop fs -put D:\personal\debug.log hdfs://localhost:9000/user/wcinput C:\WINDOWS\system32>hadoop fs -put D:\personal\waz.txt hdfs://localhost:9000/user/wcinput3.查看文件

QA常见问题:

1:启动hadoop可能提示找不到JAVA_HOME路径,是因为hadoop读取JAVA_HOME环境变量存在空格导致。

2:启动hadoop提示找不到HADOOP,是因为Hadoop环境变量没有配置好,请检查Hadoop环境变量配置。

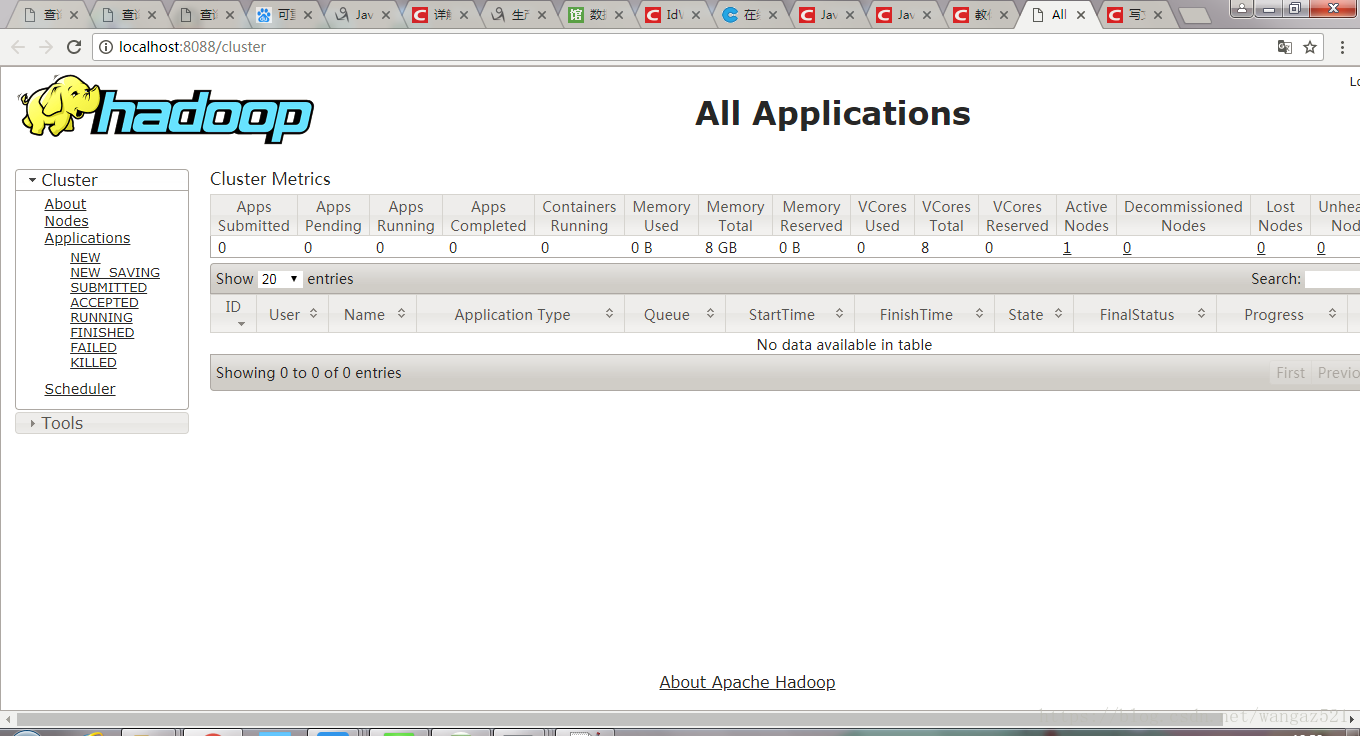

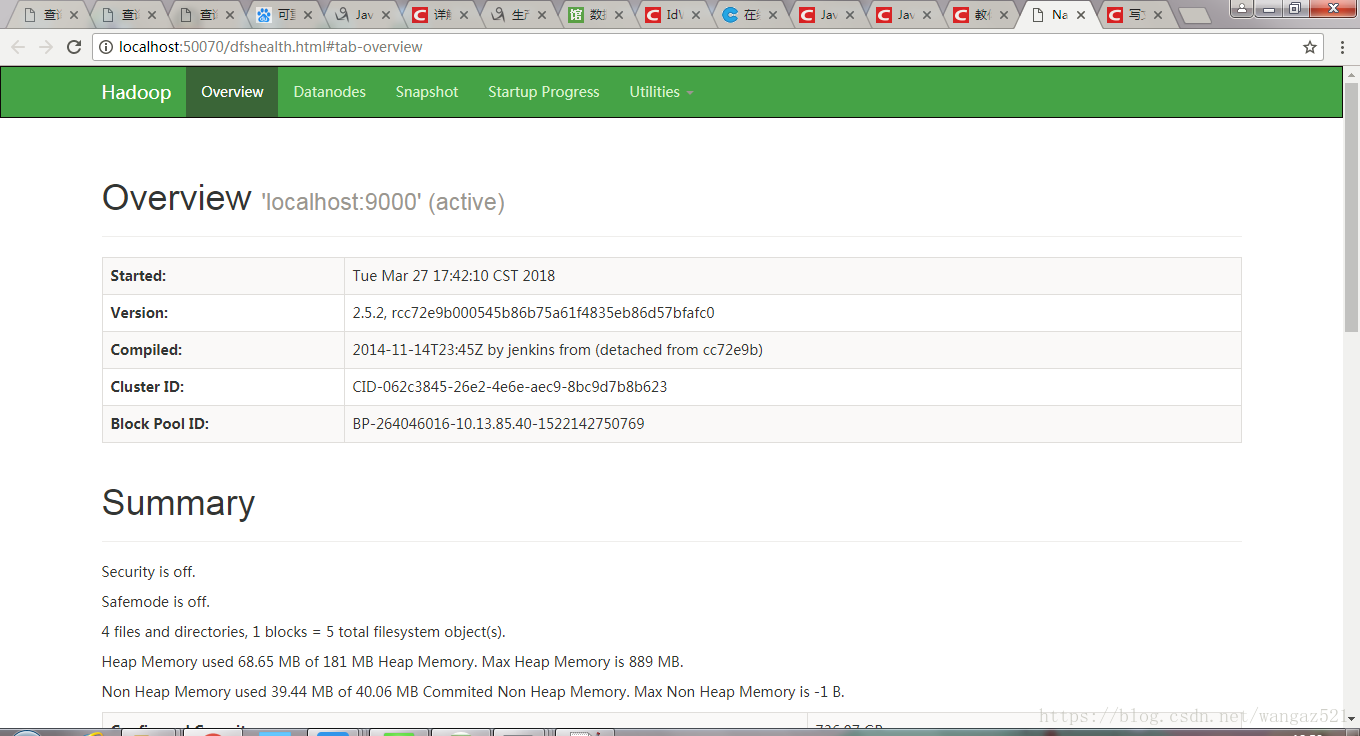

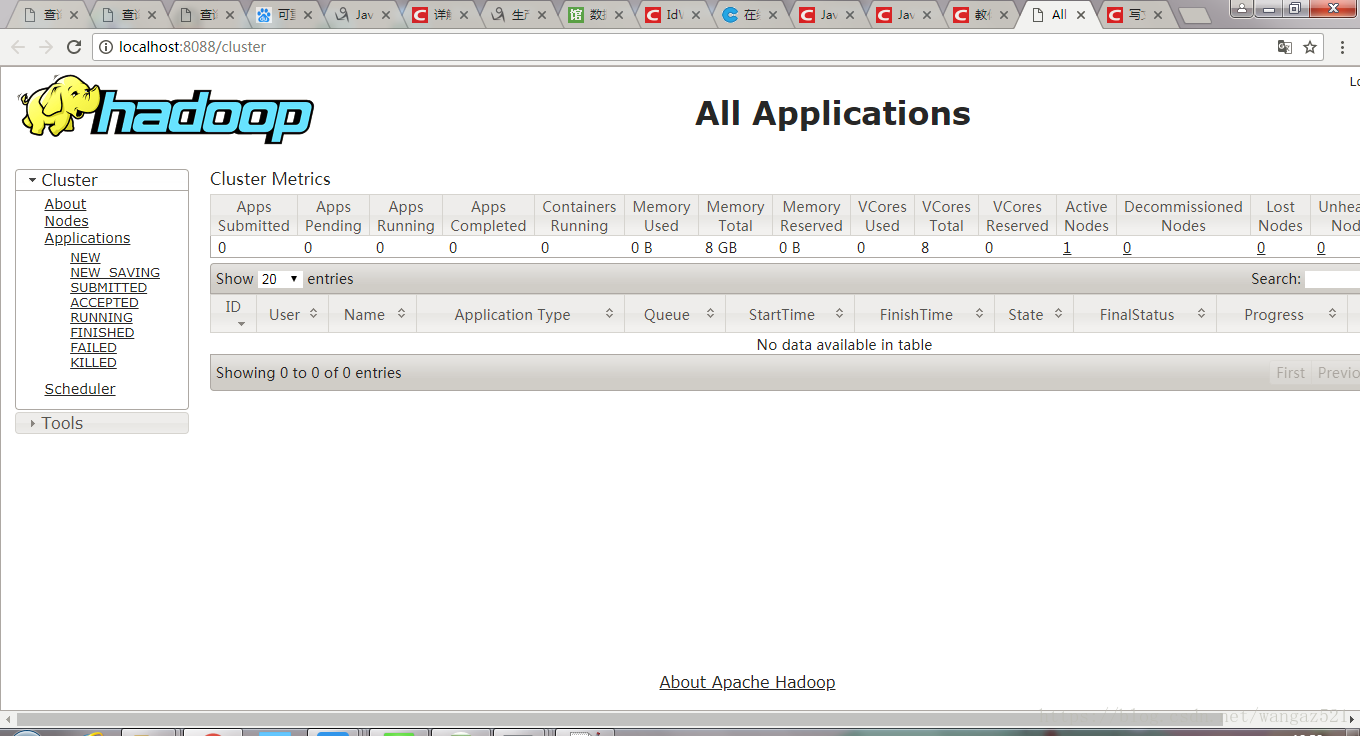

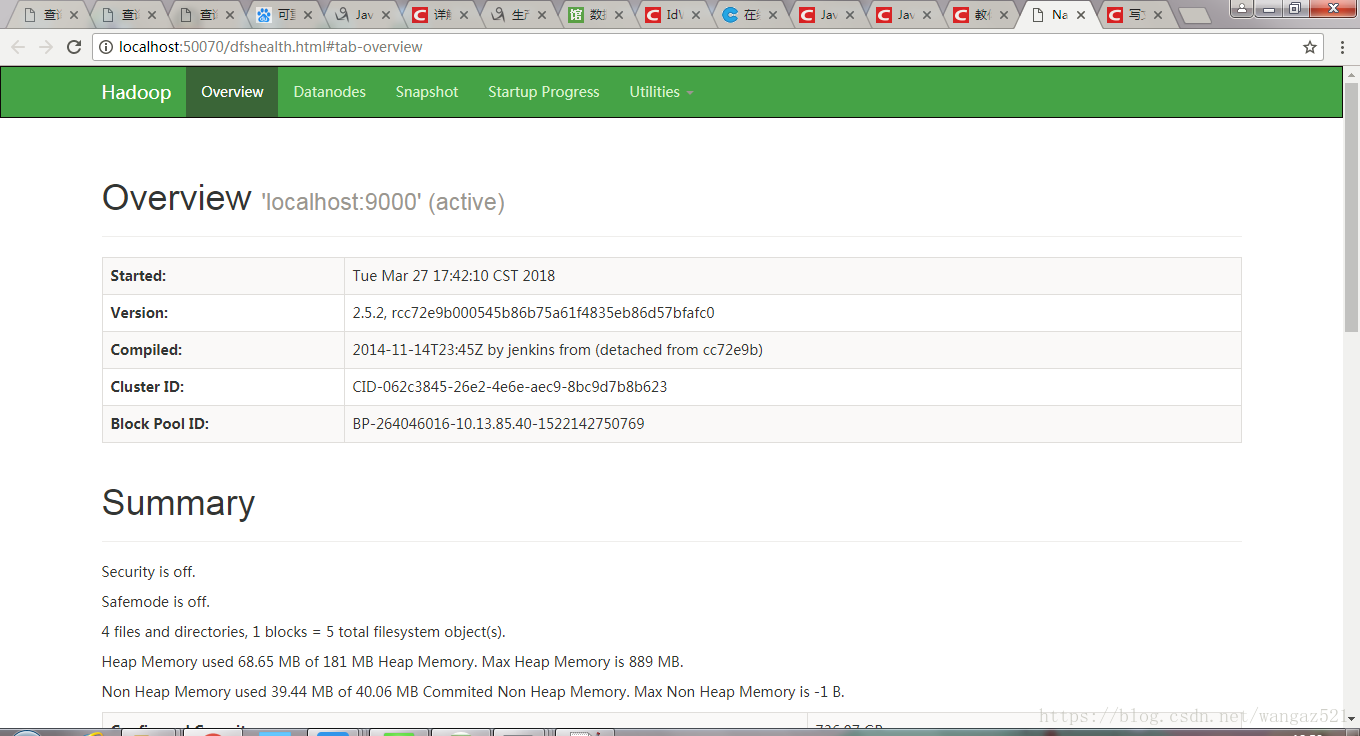

hadoop自带的web控制台GUI

1.资源管理GUI:http://localhost:8088/;

2.节点管理GUI:http://localhost:50070/

相关文章推荐

- hadoop的windows远程linux服务进行本地开发环境搭建

- windows下搭建hadoop-2.6.0本地idea开发环境

- windows下搭建hadoop-2.6.0本地idea开发环境

- windows下idea中搭建hadoop开发环境,向远程hadoop集群提交mapreduce任务

- eclipse+maven搭建hadoop本地开发环境

- Hadoop Intellij IDEA本地开发环境搭建

- windows 32位eclipse远程hadoop开发环境搭建

- windows上搭建hadoop开发环境

- Spark Streaming 实战(1)搭建kafka+zookeeper+spark streaming 的windows本地开发环境

- HADOOP WINDOWS 开发环境搭建

- Windows下搭建Spark+Hadoop开发环境

- 搭建Spark的maven本地windows开发环境以及测试

- windows下搭建hadoop开发环境(Eclipse)

- windows下搭建hadoop开发环境(Eclipse)

- windows下hadoop伪分布式模式开发环境的搭建(Cygwin)以及Eclipse集成开发环境下的搭建

- Windows下Cygwin+Eclipse搭建Hadoop开发环境

- Windows上搭建hadoop开发环境

- hadoop 1.x 伪分布式部署及windows开发环境搭建

- windows下搭建hadoop+eclipse开发环境

- Hadoop-Windows下的Eclipse开发环境搭建,远程虚拟机Hadoop服务器