机器学习基石 5.3 Effective Number of Hypotheses

2017-07-23 12:08

260 查看

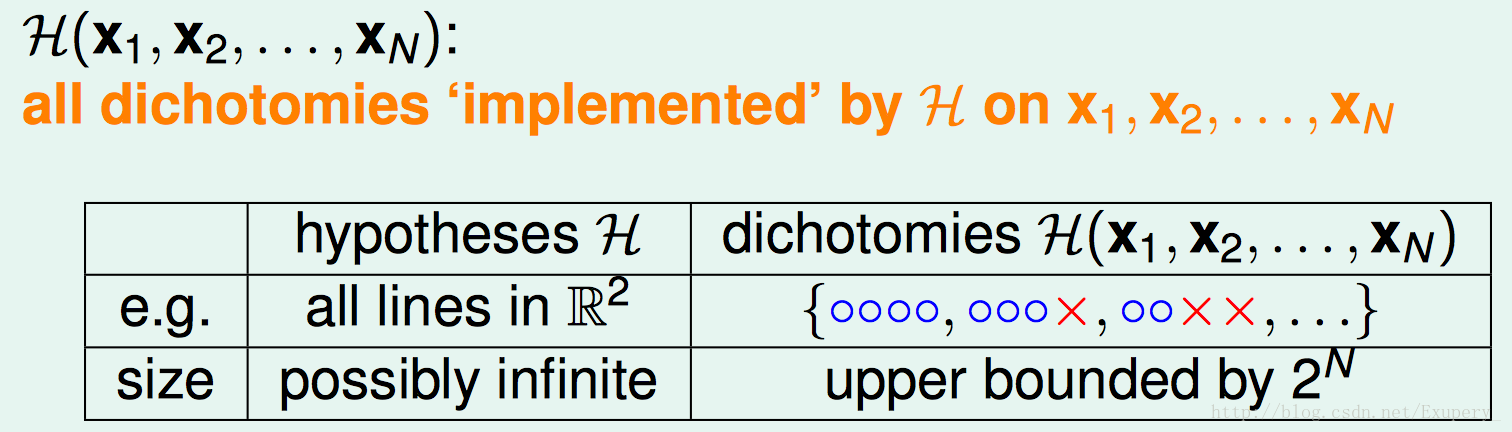

Dichotomies Mini-hypotheses

Growth Function

Growth Function for Positive Rays

Growth Function for Positive Intervals

Growth Function for Convex Sets

Fun Time

引入新概念:

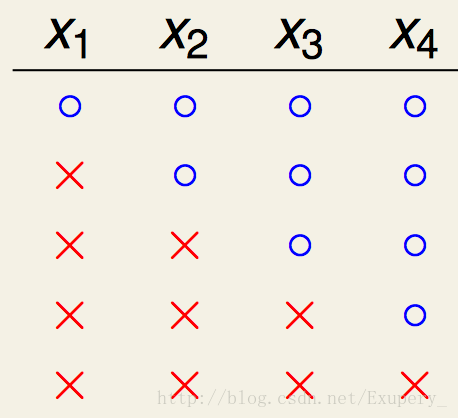

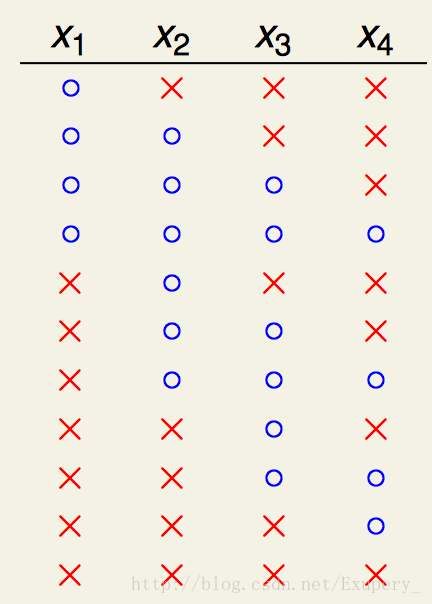

dichotomy:只关注hypothesis作用在x1,x2,⋯,xN上的结果,这样就可以把所有的hypothesis像上一节一样进行分类。

令

h(x1,x2,⋯,xN)=(h(x1),h(x2),⋯,h(xN))∈{×,◯}N

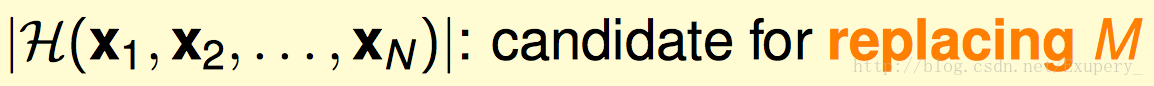

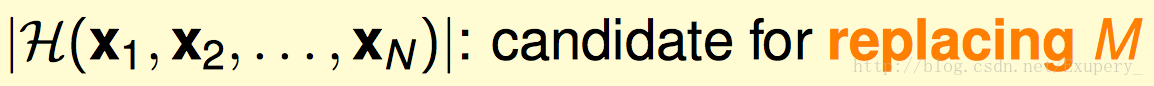

希望可以用|(x1,x2,⋯,xN)|来代替原来的M。

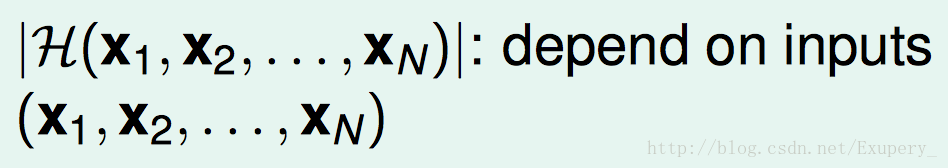

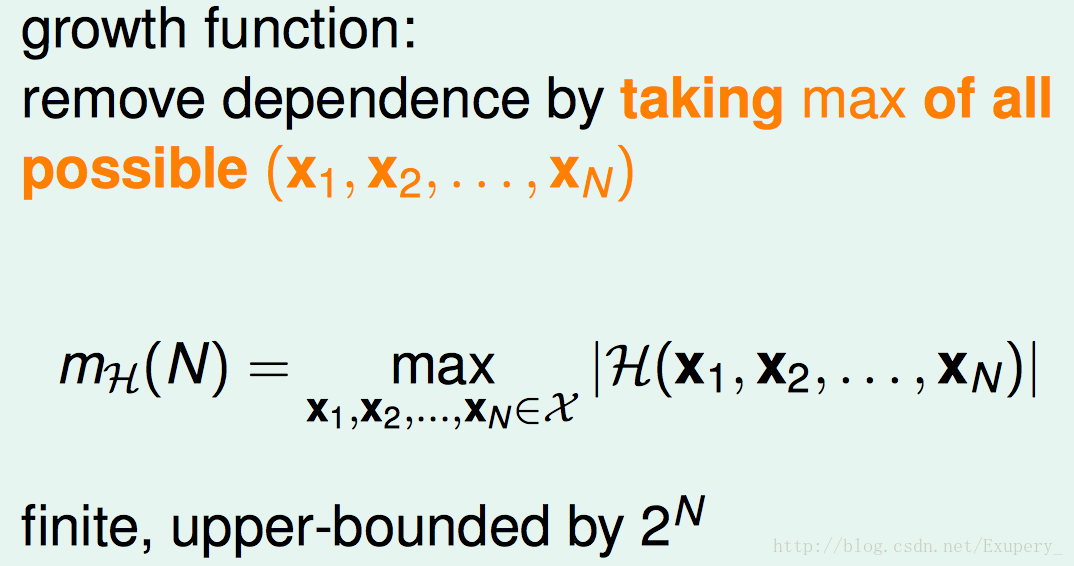

用其最大值来摆脱输入的依赖。

比如:

mH(1)=2

mH(2)=4

mH(3)=8

mH(4)=14

h(x)={1,−1,x>thresholdx⩽threshold

相当于一维的perceptrons的一半。

易得

(x1,x2,⋯,xN)中每一个h(x1,x2,⋯,xN)的样子

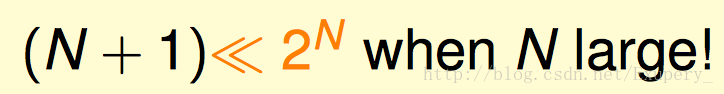

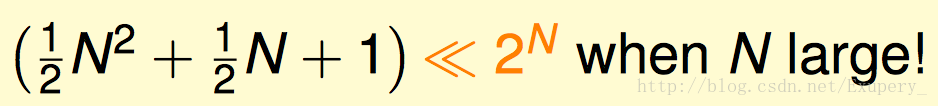

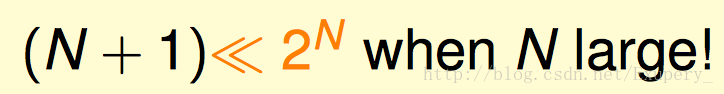

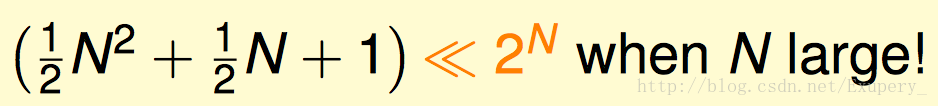

当N很大时,N+1远小于2N。

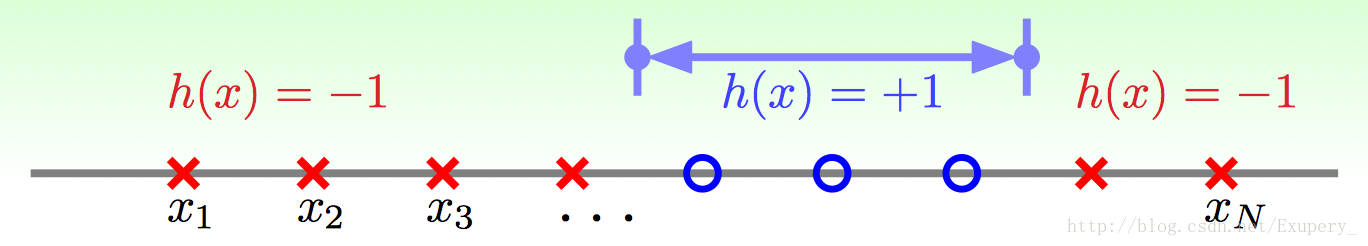

范围内为+1,范围外为-1。

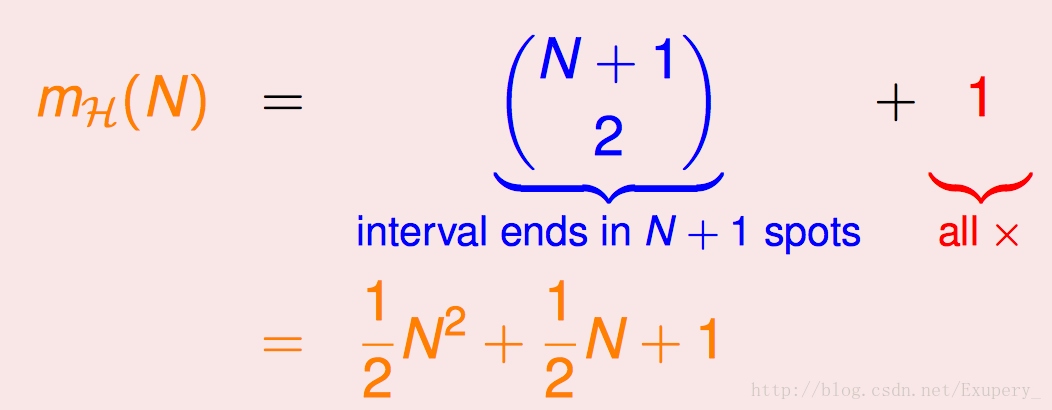

它的mH(N)

N个点把数轴分为N+1段,如果范围的两个端点放在不同的段内,那么一共有(N+12)种,如果放在同一段内,那么只有1种。

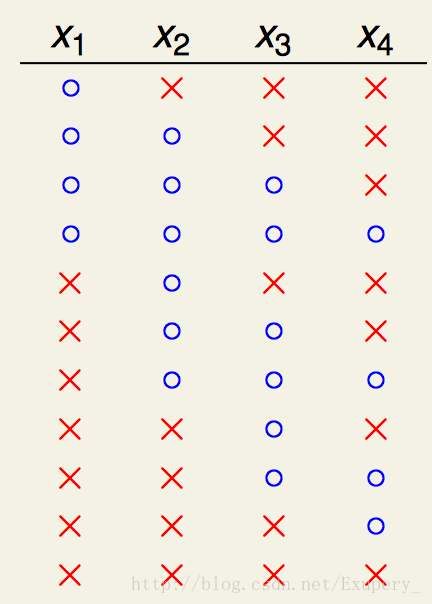

(x1,x2,⋯,xN)中每一个h(x1,x2,⋯,xN)的样子

这个结果在N很大时也是远小于2N的。

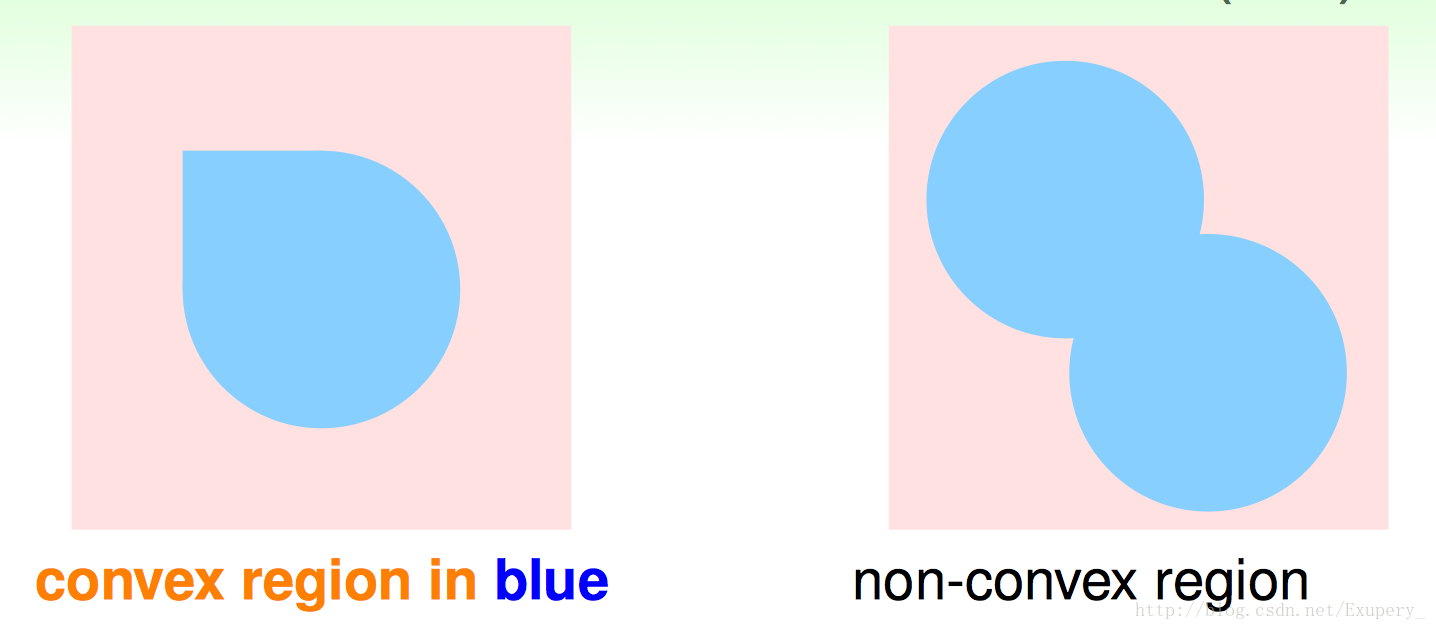

当x在凸包内部时,h(x)=1,否则h(x)=−1

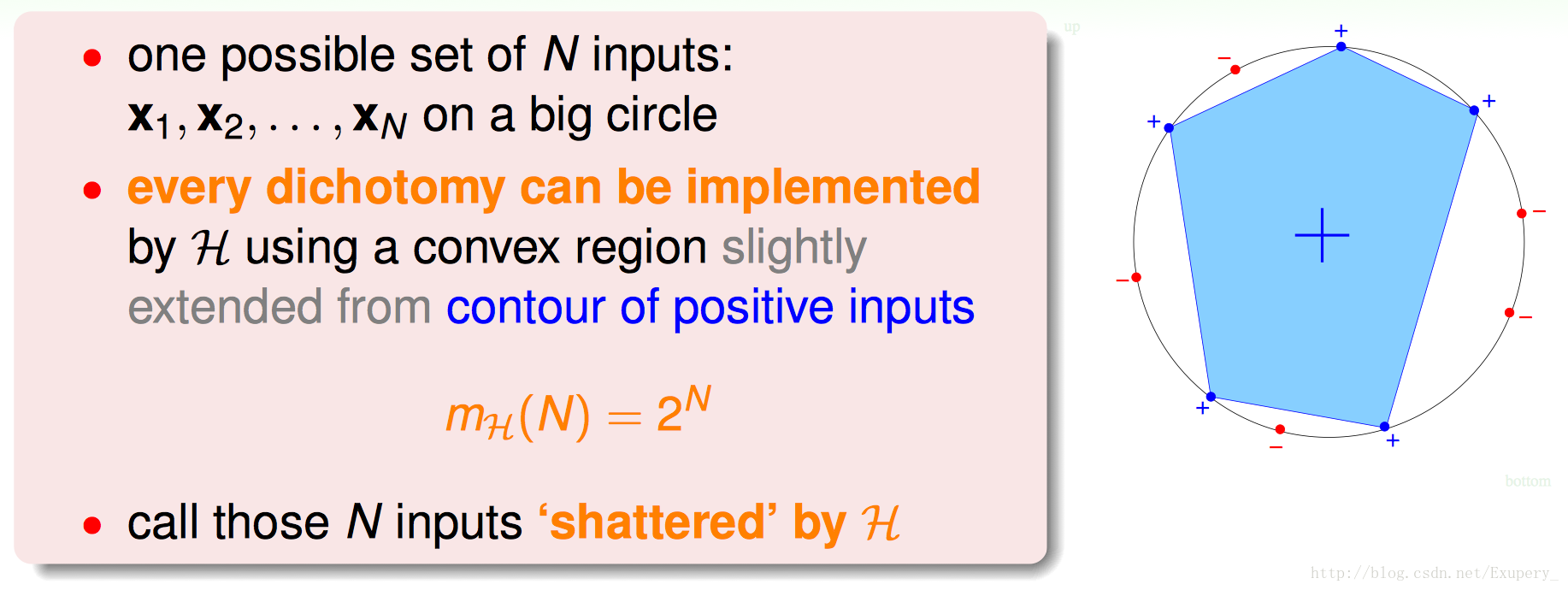

一种可能的输入:所有的点都在一个大圆上。

这时无论每个点对应的是圈还是叉,都能找到一种凸包对应一个dichotomy。

Growth Function

Growth Function for Positive Rays

Growth Function for Positive Intervals

Growth Function for Convex Sets

Fun Time

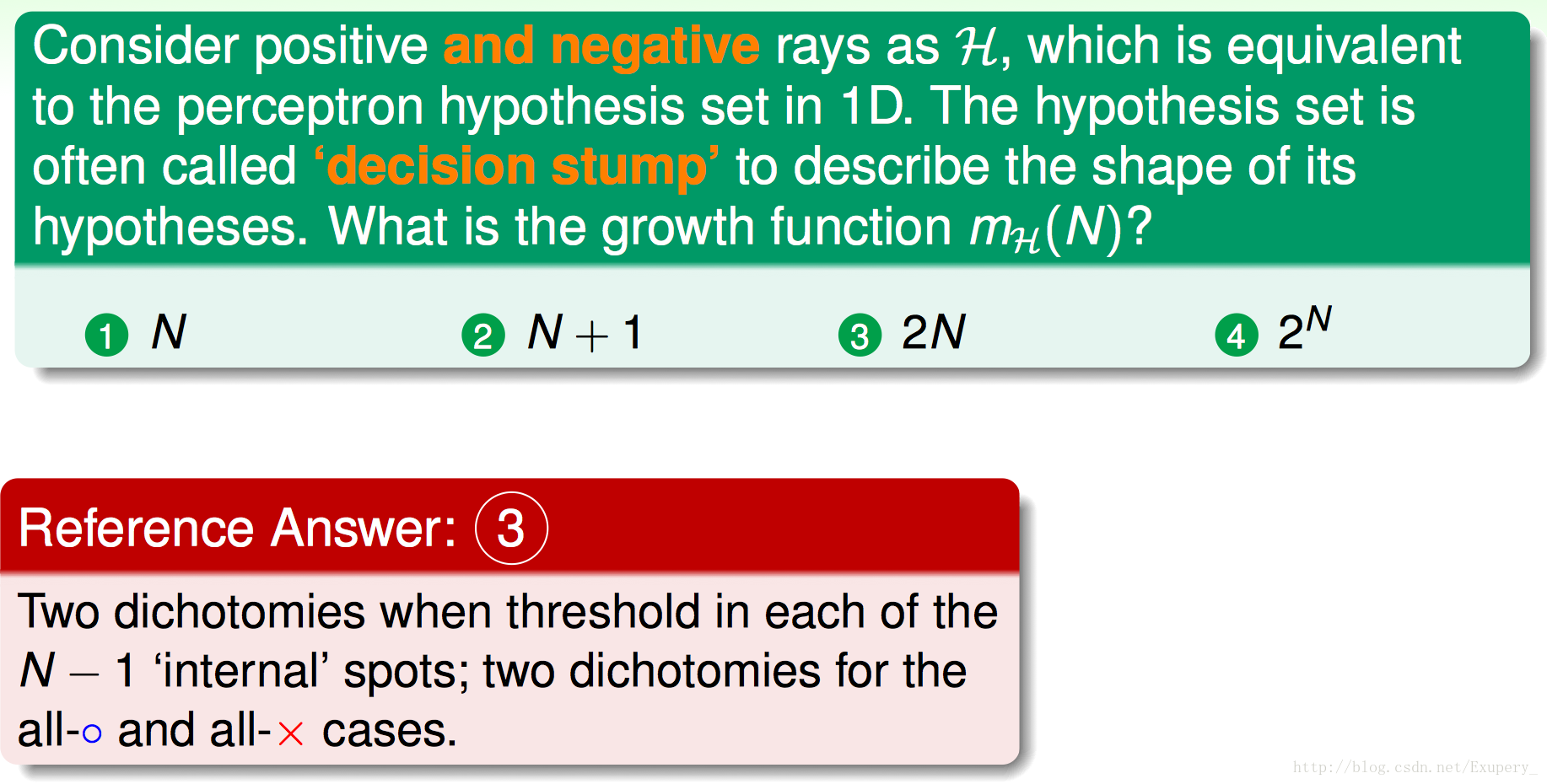

1. Dichotomies: Mini-hypotheses

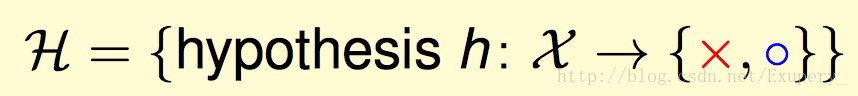

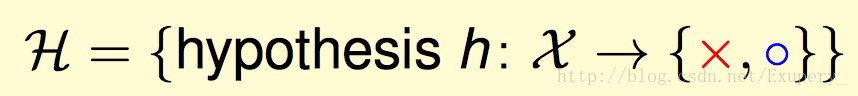

原来的hypothesis set:

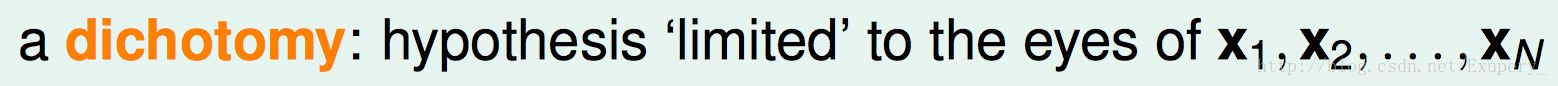

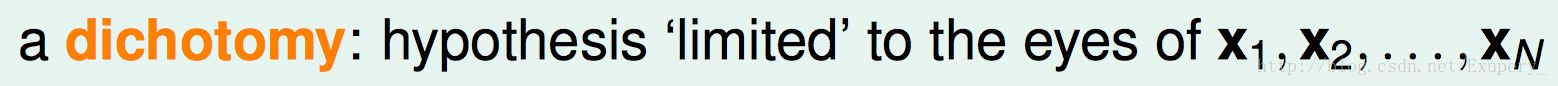

引入新概念:

dichotomy:只关注hypothesis作用在x1,x2,⋯,xN上的结果,这样就可以把所有的hypothesis像上一节一样进行分类。

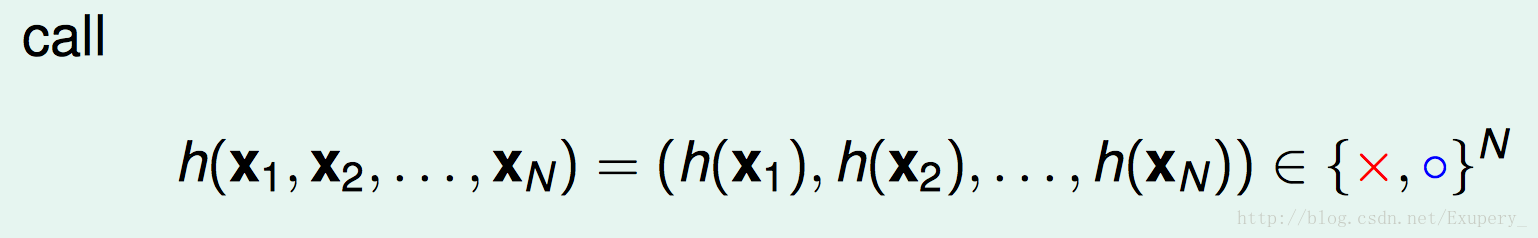

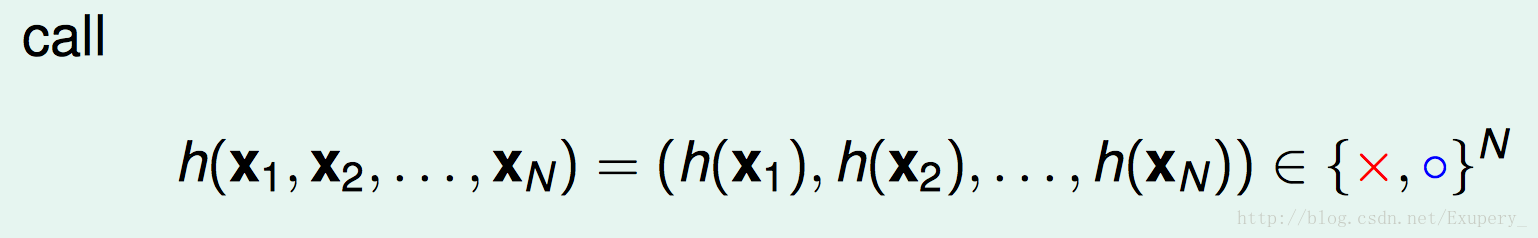

令

h(x1,x2,⋯,xN)=(h(x1),h(x2),⋯,h(xN))∈{×,◯}N

希望可以用|(x1,x2,⋯,xN)|来代替原来的M。

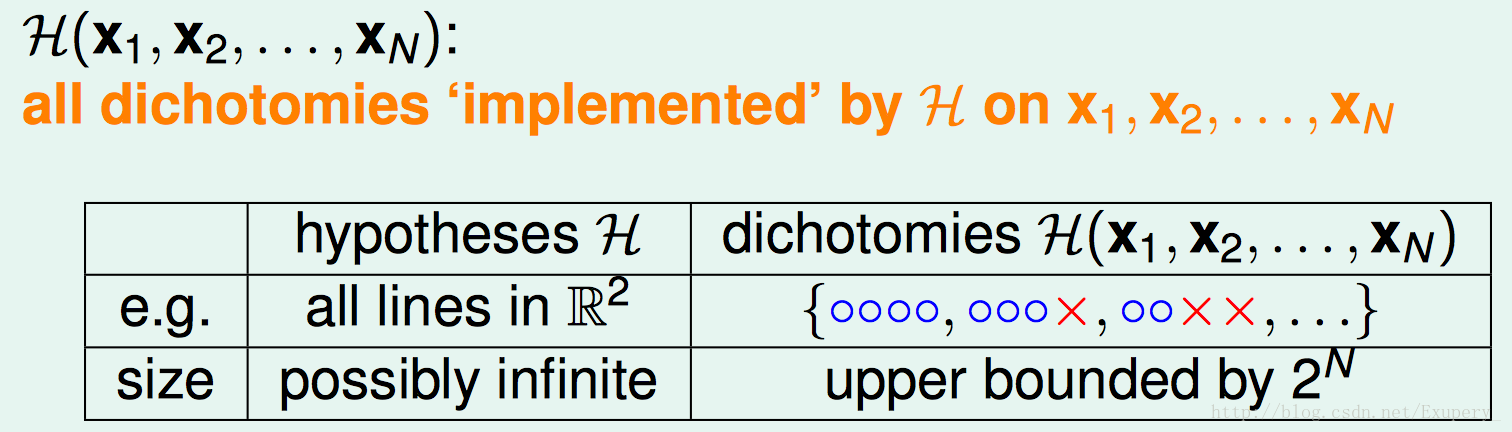

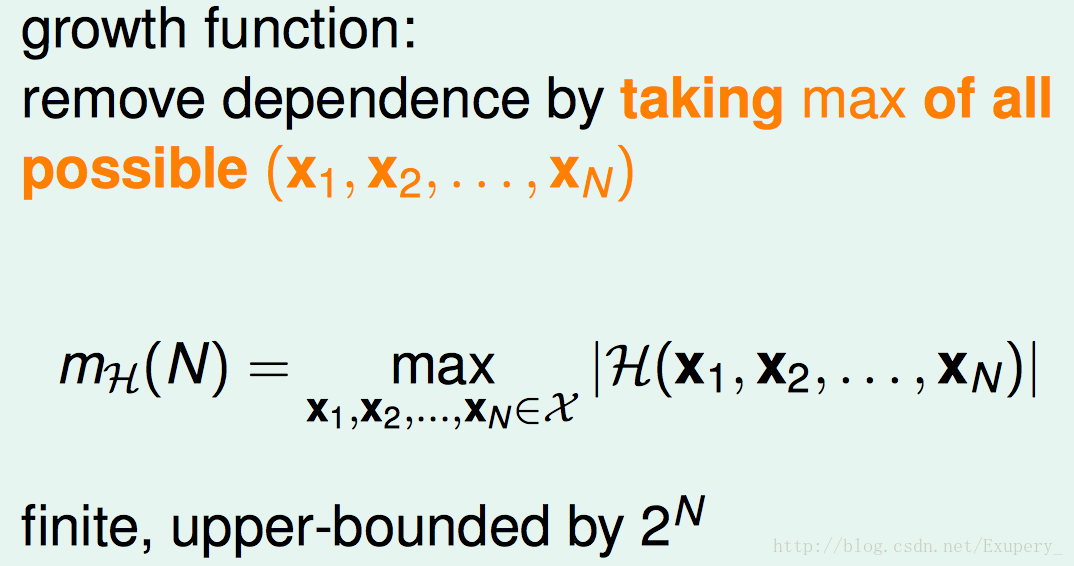

2. Growth Function

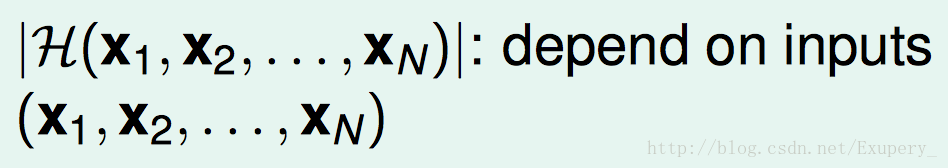

然而|(x1,x2,⋯,xN)|与输入的(x1,x2,⋯,xN)有关。

用其最大值来摆脱输入的依赖。

比如:

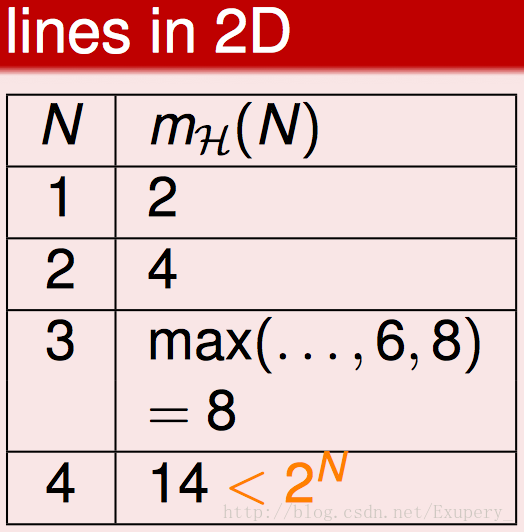

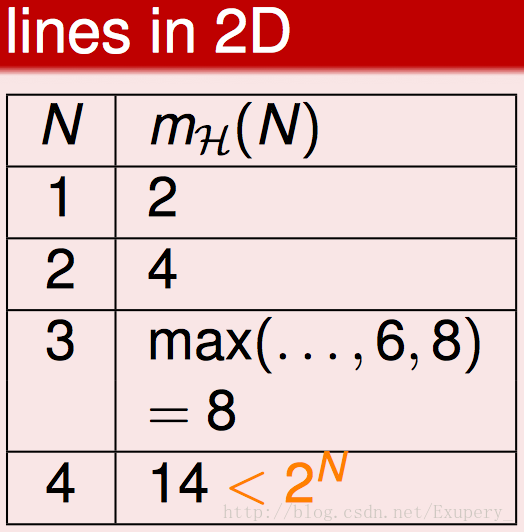

mH(1)=2

mH(2)=4

mH(3)=8

mH(4)=14

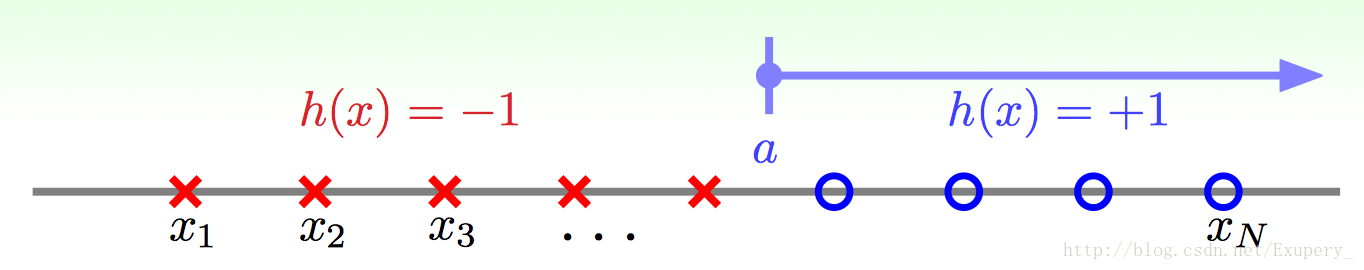

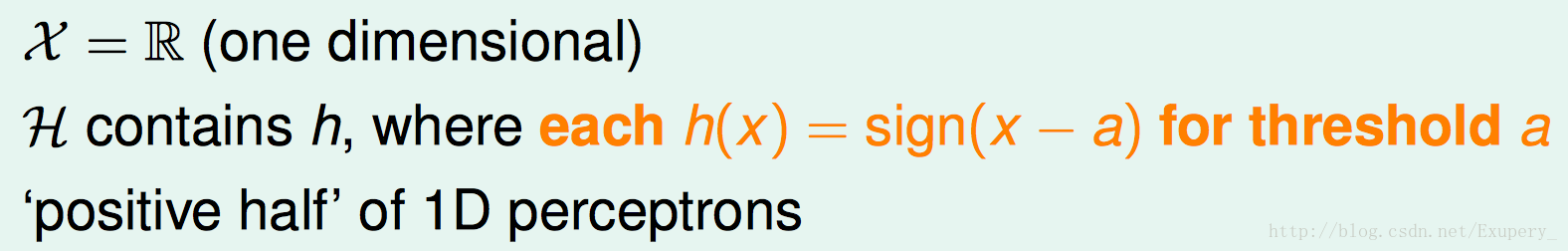

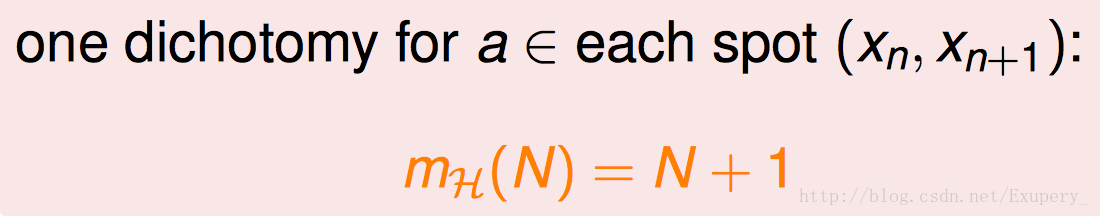

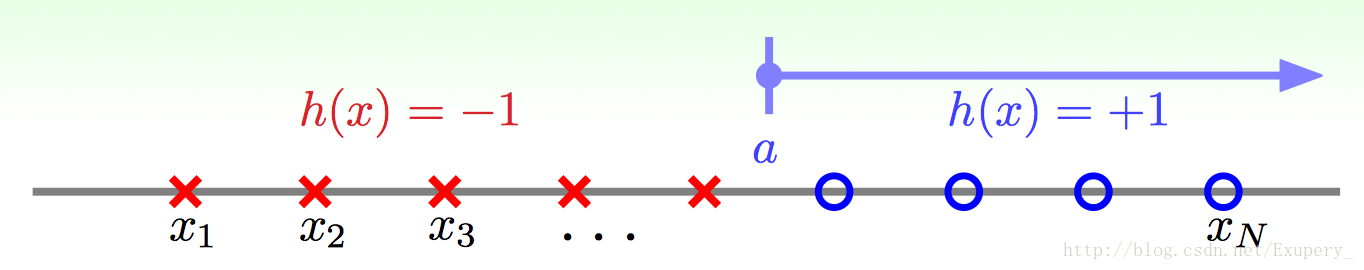

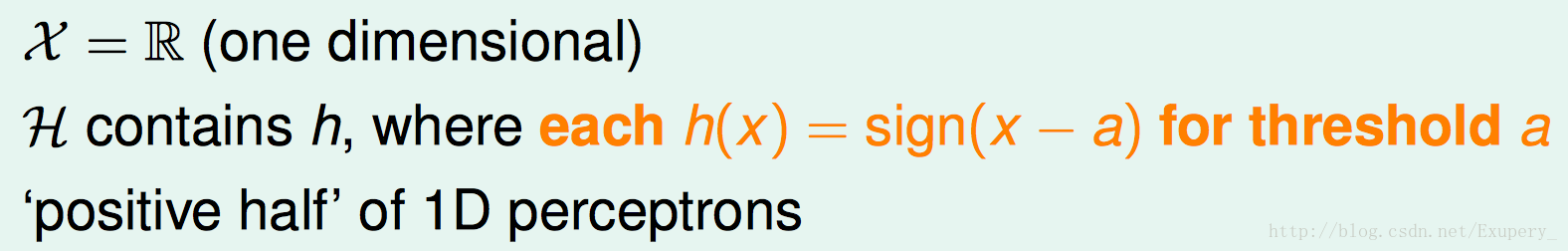

3. Growth Function for Positive Rays

考虑一个简单的情况:Positive Raysh(x)={1,−1,x>thresholdx⩽threshold

相当于一维的perceptrons的一半。

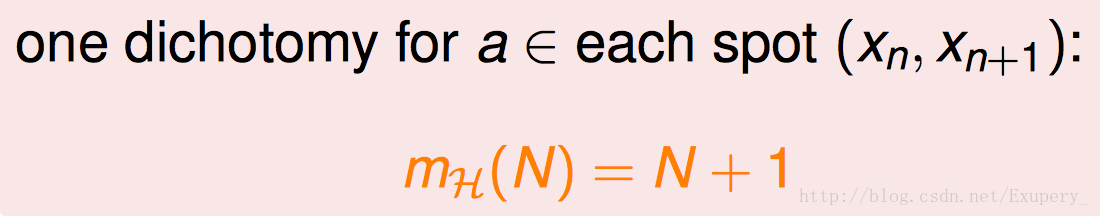

易得

(x1,x2,⋯,xN)中每一个h(x1,x2,⋯,xN)的样子

当N很大时,N+1远小于2N。

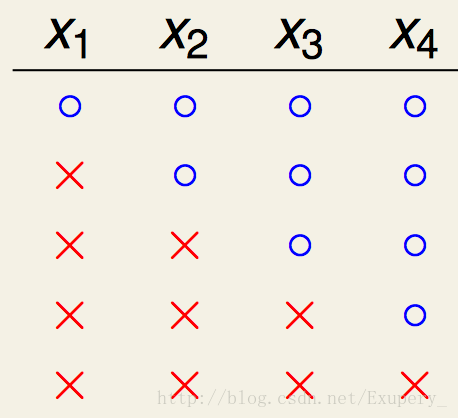

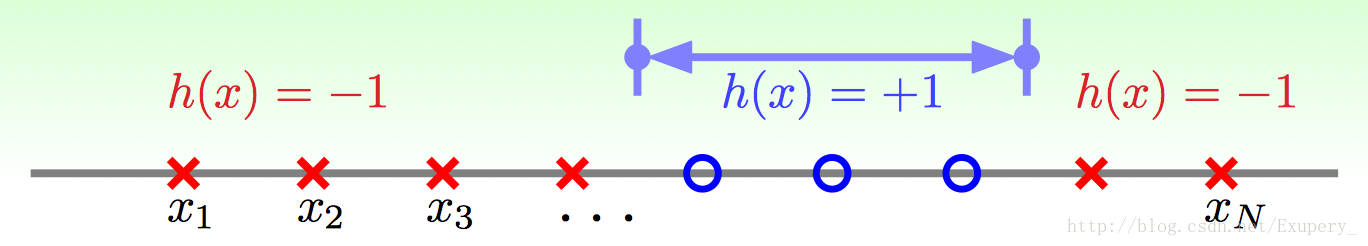

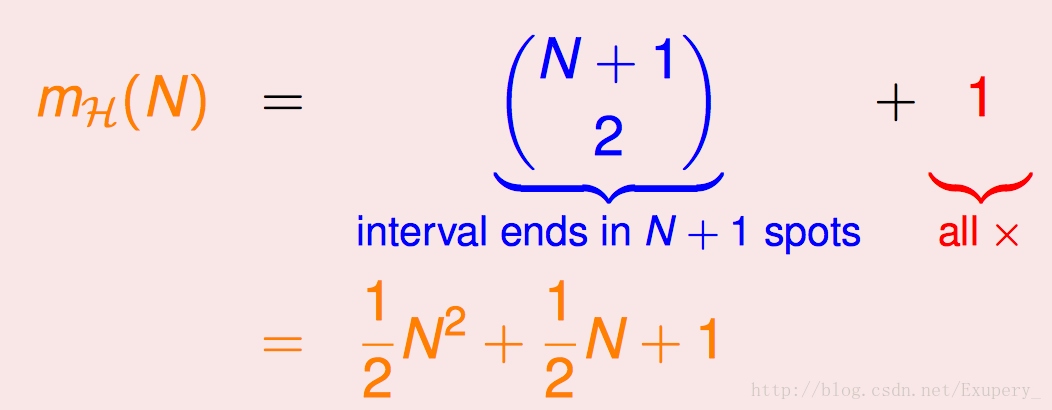

4. Growth Function for Positive Intervals

考虑另外一种情况:Positive Intervals范围内为+1,范围外为-1。

它的mH(N)

N个点把数轴分为N+1段,如果范围的两个端点放在不同的段内,那么一共有(N+12)种,如果放在同一段内,那么只有1种。

(x1,x2,⋯,xN)中每一个h(x1,x2,⋯,xN)的样子

这个结果在N很大时也是远小于2N的。

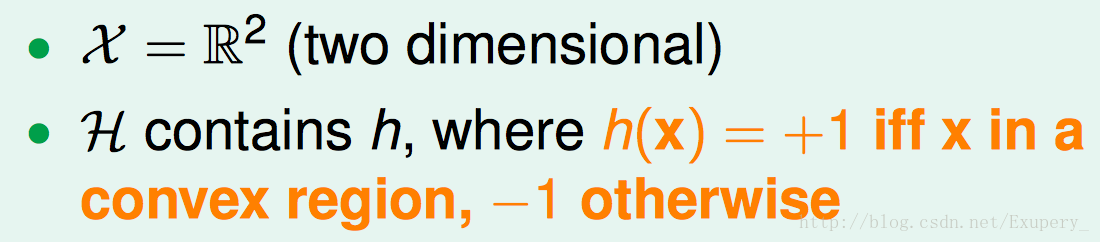

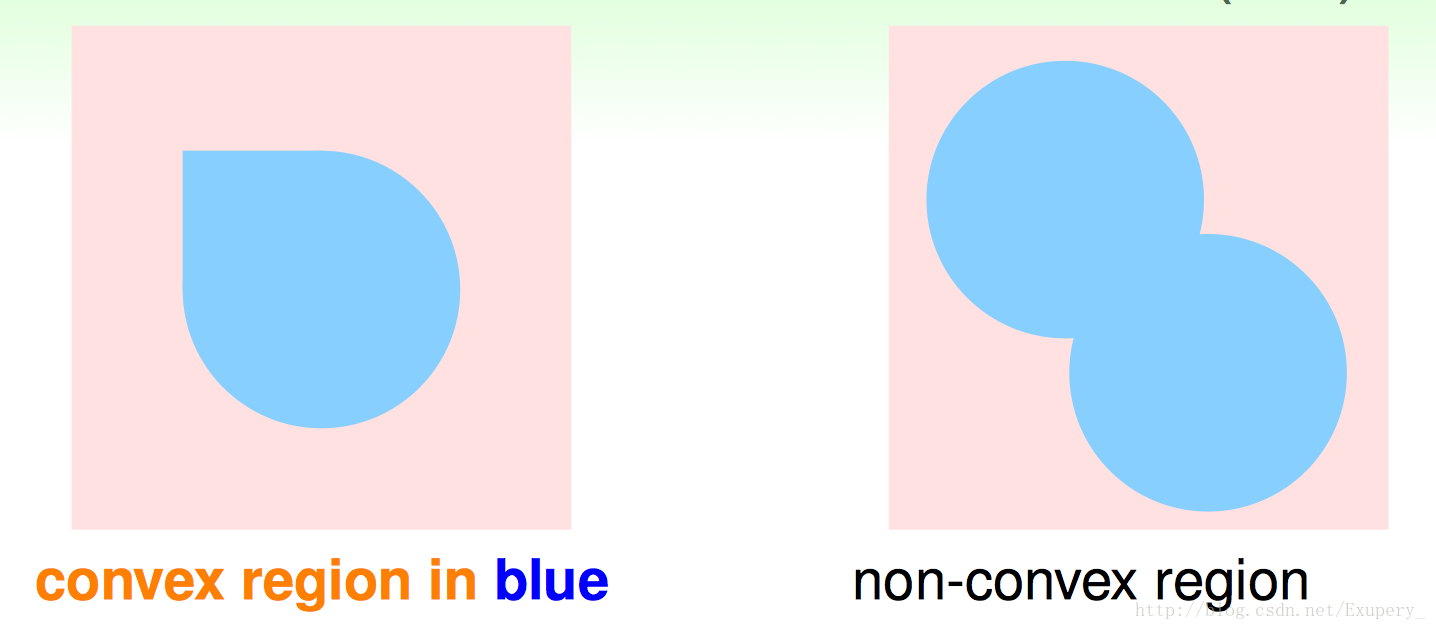

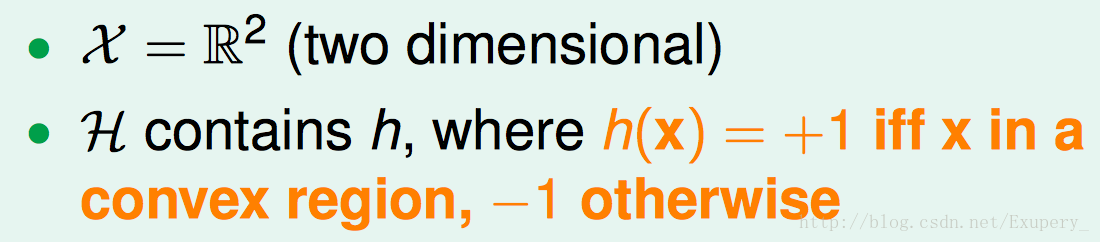

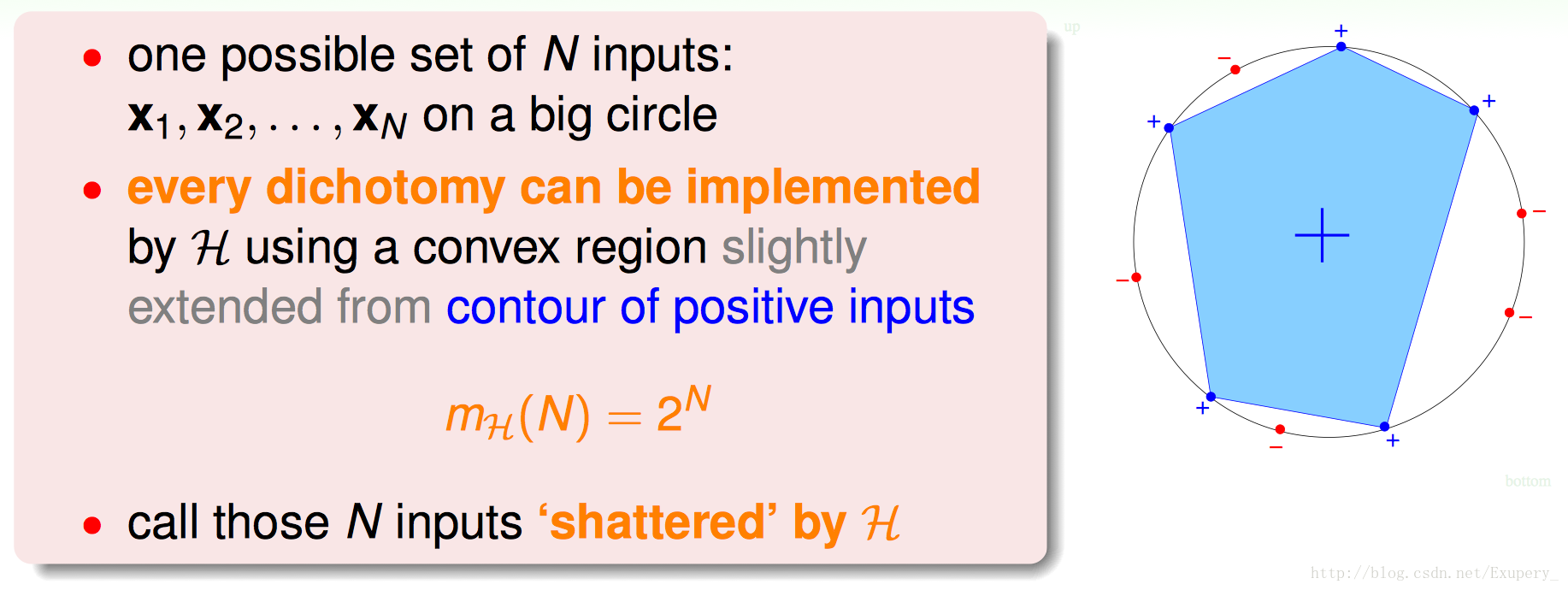

5. Growth Function for Convex Sets

考虑h为平面上的一个凸包的情况

当x在凸包内部时,h(x)=1,否则h(x)=−1

一种可能的输入:所有的点都在一个大圆上。

这时无论每个点对应的是圈还是叉,都能找到一种凸包对应一个dichotomy。

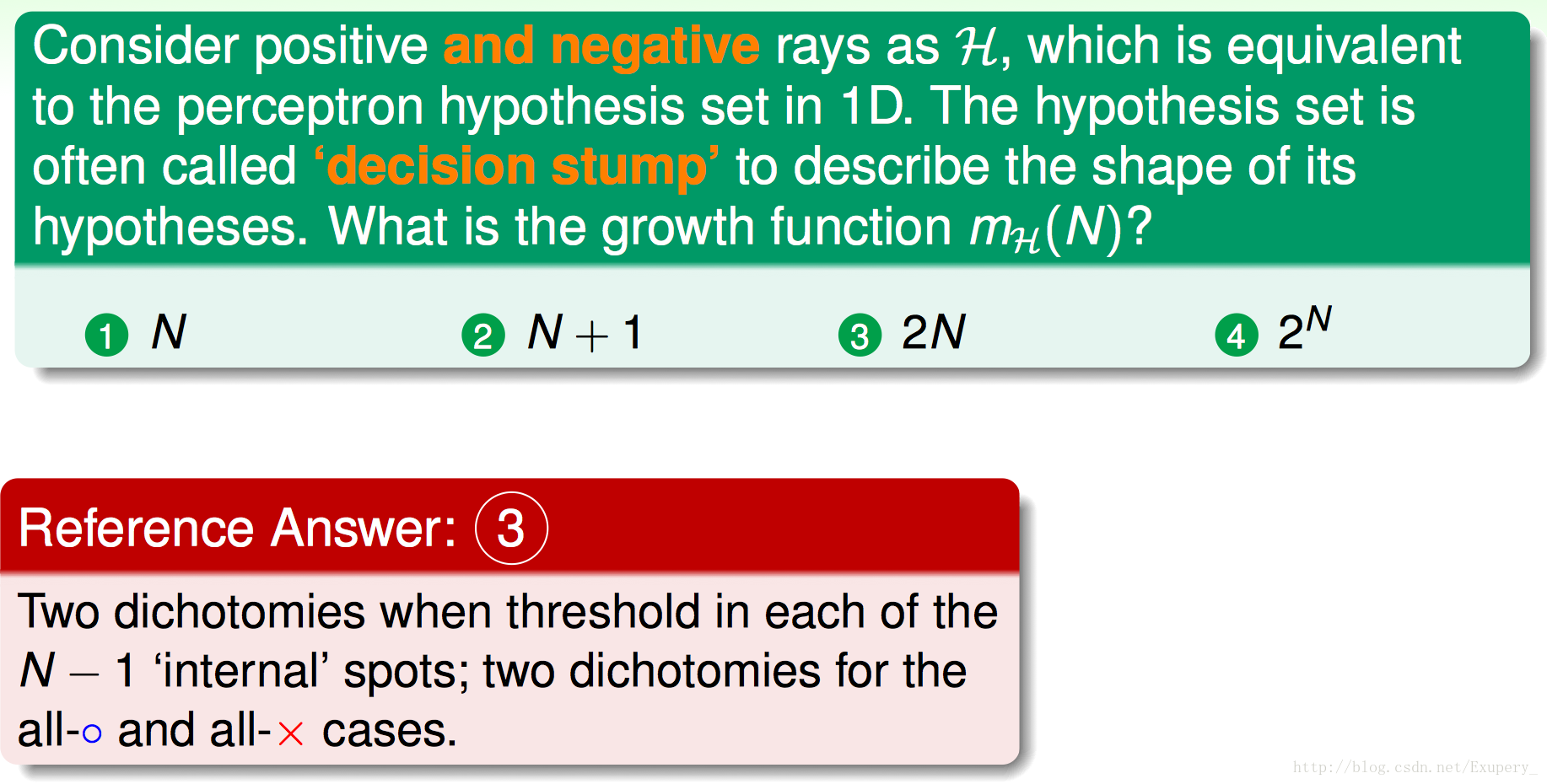

6. Fun Time

相关文章推荐

- 机器学习基石-05-3-Effective Number of Hypotheses

- 机器学习基石 5.2 Effective Number of Lines

- 机器学习基石-07-2-VC Dimension of Perceptrons

- 机器学习基石-Hazard of Overfitting

- 机器学习基石第六讲:theory of generalization

- 机器学习基石 7.2 VC Dimension of Perceptrons

- 机器学习基石笔记 Lecture 3 - Types of Learning

- 机器学习基石-07-1-Definition of VC Dimension

- 机器学习基石 2.3 Guarantee of PLA

- 机器学习基石 - Types of Learning

- 15. 机器学习基石 - Summary - Power of Three

- 机器学习基石第六讲 Theory of Generalization

- 机器学习基石-10-3-Gradient of Logistic Regression Error

- 3. 机器学习基石-When can Machine Learn? - Types of Learning

- 机器学习基石-Types of Learning

- 林轩田机器学习基石心得6:Theory of Generalization

- 林轩田-机器学习基石 课堂笔记(六)Theory of Generalzation

- 4. 机器学习基石-When can Machine Learn? - Feasible of Learning

- 【笔记】机器学习基石(三)type of learning

- 【Feasibility of Learning】林轩田机器学习基石