MySQL高可用性之MHA

2017-03-05 16:23

477 查看

防伪码:学海无涯苦作舟!

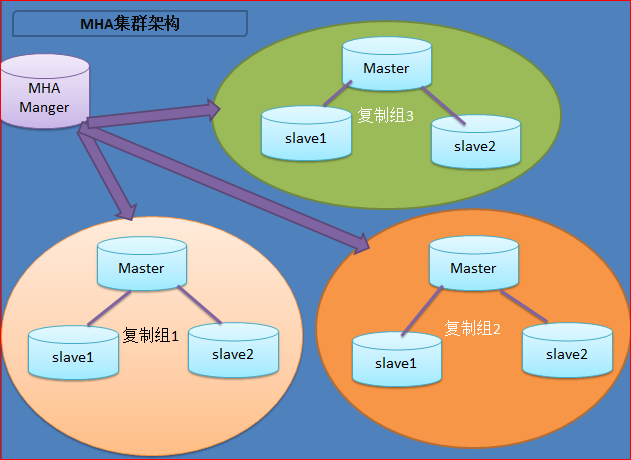

MHA(Master HighAvailability)目前在MySQL高可用方面是一个相对成熟的解决方案,它由日本DeNA公司youshimaton(现就职于Facebook公司)开发,是一套优秀的作为MySQL高可用性环境下故障切换和主从提升的高可用软件。在MySQL故障切换过程中,MHA能做到在0~30秒之内自动完成数据库的故障切换操作,并且在进行故障切换的过程中,MHA能在最大程度上保证数据的一致性,以达到真正意义上的高可用。

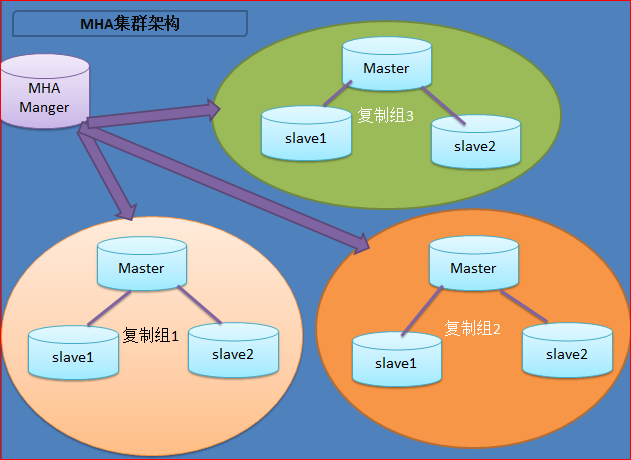

MHA里有两个角色一个是MHA Node(数据节点)另一个是MHA Manager(管理节点)。

MHA Manager可以单独部署在一台独立的机器上管理多个master-slave集群,也可以部署在一台slave节点上。MHA Node运行在每台MySQL服务器上,MHA Manager会定时探测集群中的master节点,当master出现故障时,它可以自动将最新数据的slave提升为新的master,然后将所有其他的slave重新指向新的master。整个故障转移过程对应用程序完全透明。

在MHA自动故障切换过程中,MHA试图从宕机的主服务器上保存二进制日志,最大程度的保证数据的不丢失,但这并不总是可行的。例如,如果主服务器硬件故障或无法通过ssh访问,MHA没法保存二进制日志,只进行故障转移而丢失了最新的数据。使用MySQL 5.5的半同步复制,可以大大降低数据丢失的风险。MHA可以与半同步复制结合起来。如果只有一个slave已经收到了最新的二进制日志,MHA可以将最新的二进制日志应用于其他所有的slave服务器上,因此可以保证所有节点的数据一致性。

注:从MySQL5.5开始,MySQL以插件的形式支持半同步复制。如何理解半同步呢?首先我们来看看异步,全同步的概念:

异步复制(Asynchronous replication)

MySQL默认的复制即是异步的,主库在执行完客户端提交的事务后会立即将结果返给给客户端,并不关心从库是否已经接收并处理,这样就会有一个问题,主如果crash掉了,此时主上已经提交的事务可能并没有传到从上,如果此时,强行将从提升为主,可能导致新主上的数据不完整。

全同步复制(Fully synchronous replication)

指当主库执行完一个事务,所有的从库都执行了该事务才返回给客户端。因为需要等待所有从库执行完该事务才能返回,所以全同步复制的性能必然会受到严重的影响。

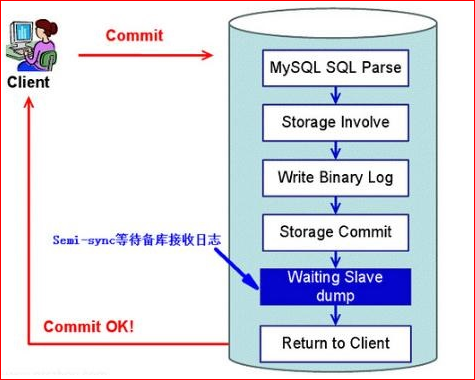

半同步复制(Semisynchronous replication)

介于异步复制和全同步复制之间,主库在执行完客户端提交的事务后不是立刻返回给客户端,而是等待至少一个从库接收到并写到relay log中才返回给客户端。相对于异步复制,半同步复制提高了数据的安全性,同时它也造成了一定程度的延迟,这个延迟最少是一个TCP/IP往返的时间。所以,半同步复制最好在低延时的网络中使用。

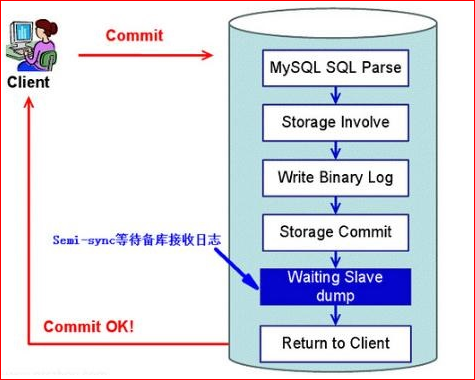

下面来看看半同步复制的原理图:

总结:异步与半同步异同

默认情况下MySQL的复制是异步的,Master上所有的更新操作写入Binlog之后并不确保所有的更新都被复制到Slave之上。异步操作虽然效率高,但是在Master/Slave出现问题的时候,存在很高数据不同步的风险,甚至可能丢失数据。

MySQL5.5引入半同步复制功能的目的是为了保证在master出问题的时候,至少有一台Slave的数据是完整的。在超时的情况下也可以临时转入异步复制,保障业务的正常使用,直到一台salve追赶上之后,继续切换到半同步模式。

工作原理:

相较于其它HA软件,MHA的目的在于维持MySQL Replication中Master库的高可用性,其最大特点是可以修复多个Slave之间的差异日志,最终使所有Slave保持数据一致,然后从中选择一个充当新的Master,并将其它Slave指向它。

-从宕机崩溃的master保存二进制日志事件(binlogevents)。

-识别含有最新更新的slave。

-应用差异的中继日志(relay log)到其它slave。

-应用从master保存的二进制日志事件(binlogevents)。

-提升一个slave为新master。

-使其它的slave连接新的master进行复制。

目前MHA主要支持一主多从的架构,要搭建MHA,要求一个复制集群中必须最少有三台数据库服务器,一主二从,即一台充当master,一台充当备用master,另外一台充当从库,因为至少需要三台服务器。

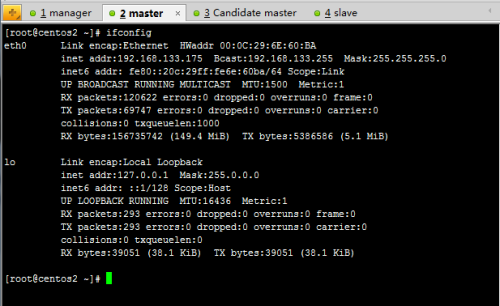

接下来部署MHA,具体的搭建环境如下

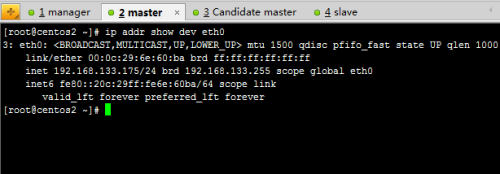

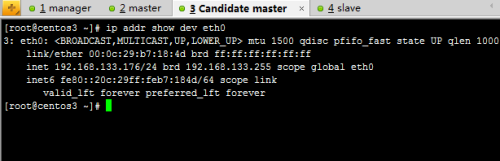

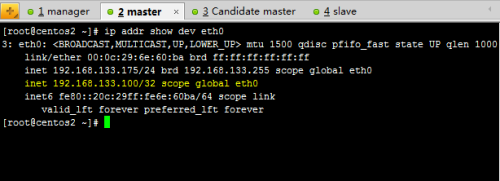

其中master对外提供写服务,备选master(实际的slave,主机名centos3)提供读服务,slave也提供相关的读服务,一旦master宕机,将会把备选master提升为新的master,slave指向新的master,manager作为管理服务器。

一、基础环境准备

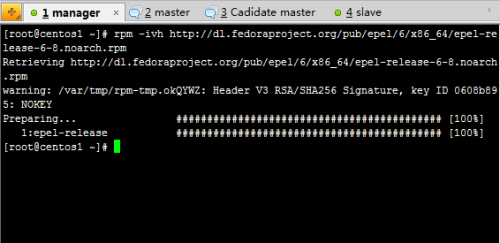

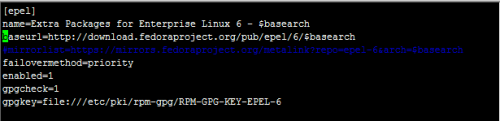

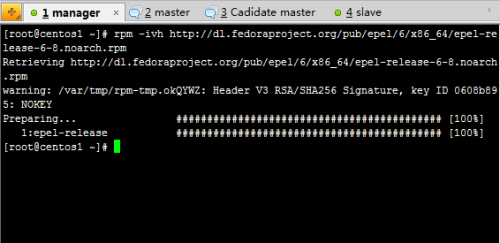

1、在配置好IP地址后检查selinux,iptables设置,关闭 selinux ,iptables 服务以便后期主从同步不出错注:时间要同步2、在四台机器都配置epel源(以manager为例)

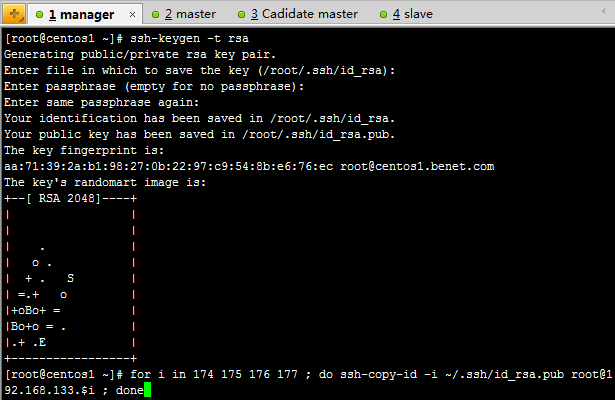

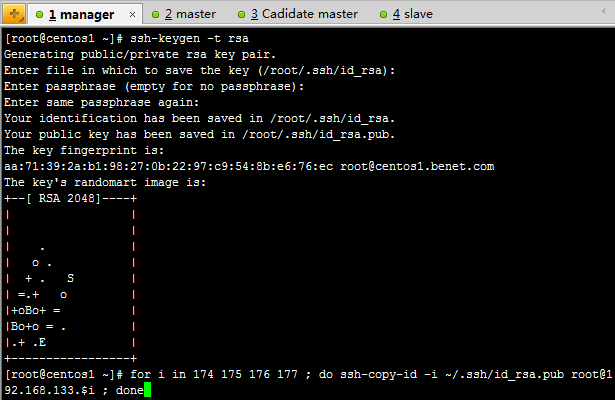

3、建立ssh无交互登录环境,每台主机同样的操作(以manager为例)

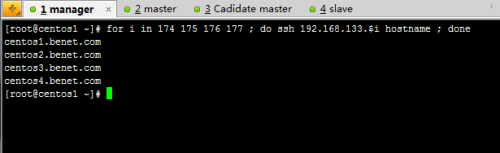

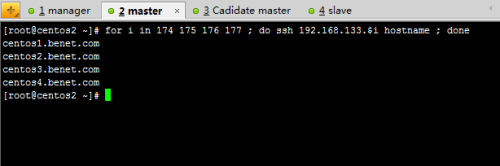

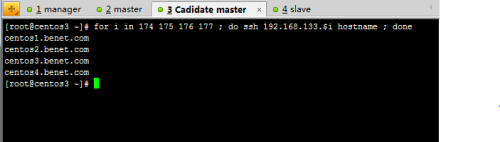

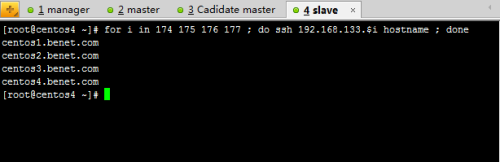

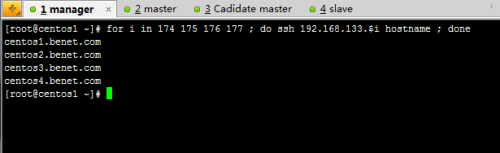

测试ssh无交互登录

manager:

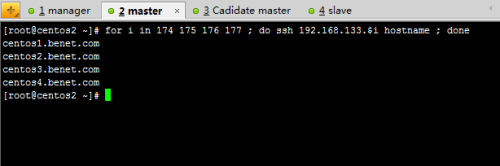

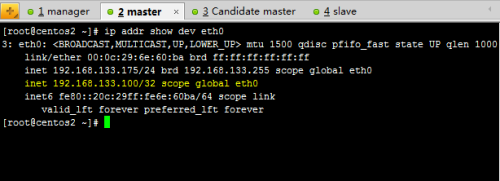

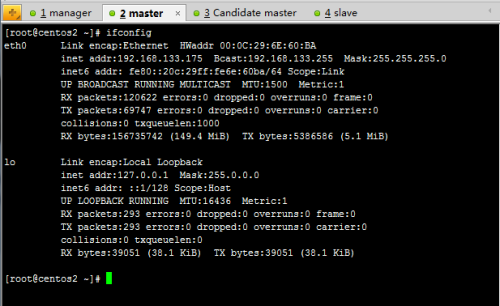

master:

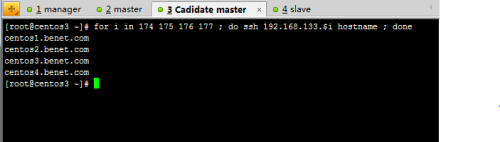

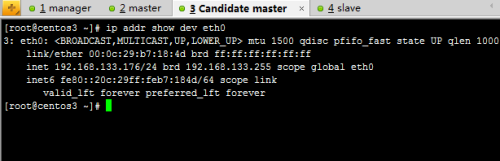

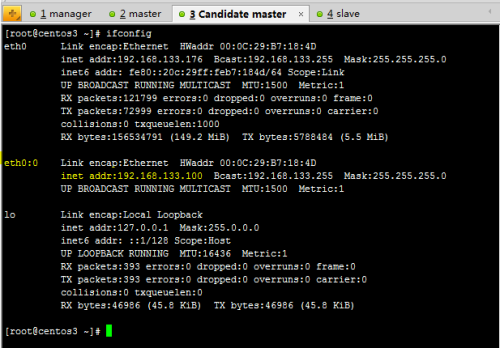

Cadidate master:

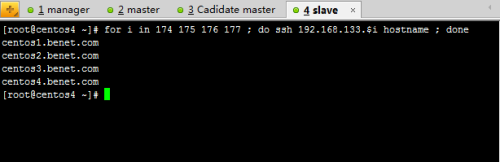

slave:

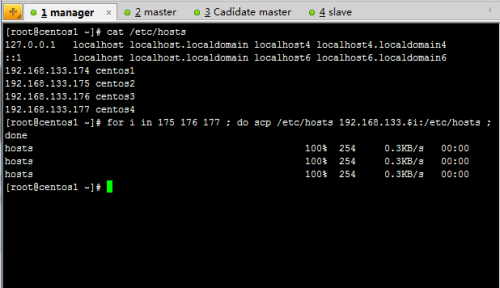

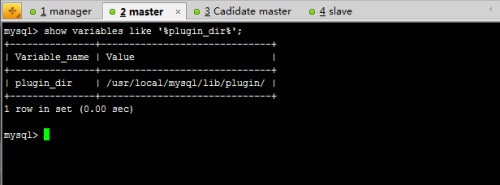

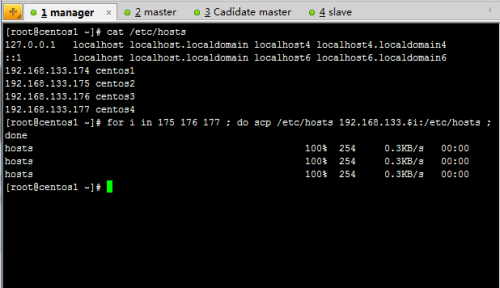

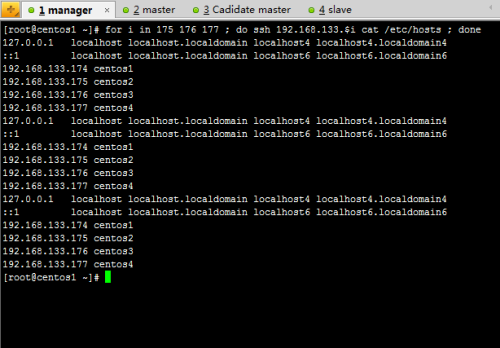

4、配置hosts环境

查看每台主机的hosts文件

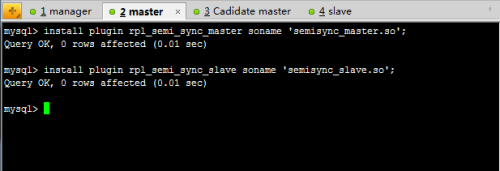

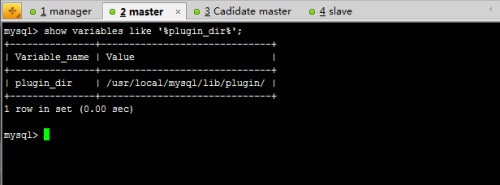

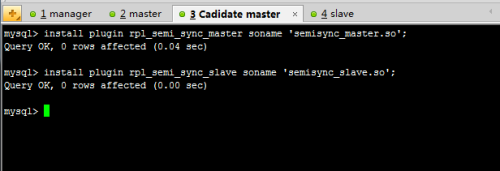

注:mysql半同步插件是由谷歌提供,具体位置/usr/local/mysql/lib/plugin/下,一个是master用的semisync_master.so,一个是slave用的semisync_slave.so,下面我们就来具体配置一下。

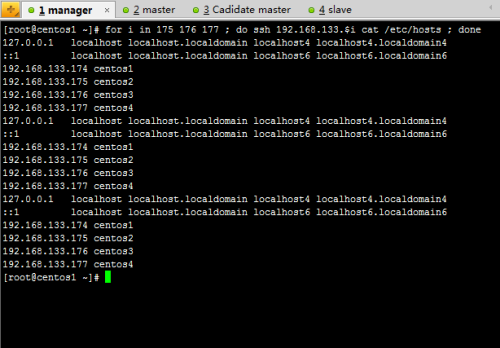

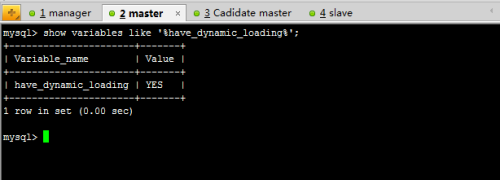

如果不清楚Plugin的目录,用如下查找:

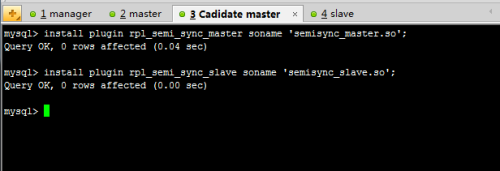

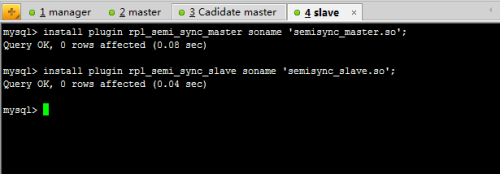

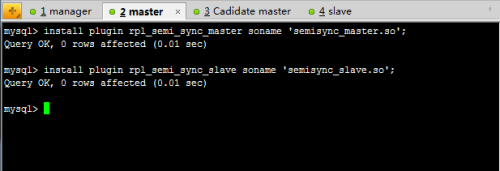

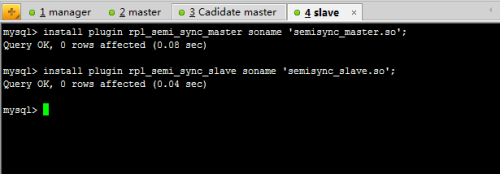

所有mysql数据库服务器,安装半同步插件(semisync_master.so,semisync_slave.so)

master:

Cadidate master:

slave:

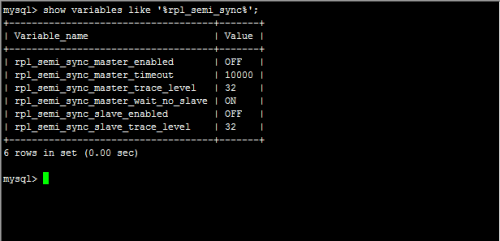

检查Plugin是否已正确安装:

mysql> show plugins;

或

mysql> select * from information_schema.plugins;

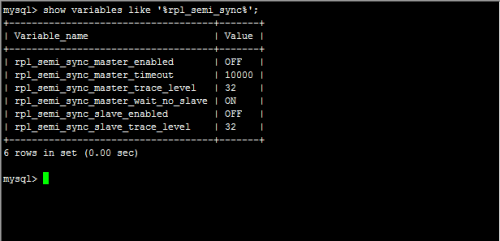

查看半同步相关信息

上图可以看到半同复制插件已经安装,只是还没有启用,所以是off

2、修改my.cnf文件,配置主从同步:

注:若主MYSQL服务器已经存在,只是后期才搭建从MYSQL服务器,在置配数据同步前应先将主MYSQL服务器的要同步的数据库拷贝到从MYSQL服务器上(如先在主MYSQL上备份数据库,再用备份在从MYSQL服务器上恢复)

master mysql主机:

server-id = 1

log-bin=mysql-bin

binlog_format=mixed

log-bin-index=mysql-bin.index

rpl_semi_sync_master_enabled=1

rpl_semi_sync_master_timeout=10000

rpl_semi_sync_slave_enabled=1

relay_log_purge=0

relay-log= relay-bin

relay-log-index = slave-relay-bin.index

注:

rpl_semi_sync_master_enabled=1 1表是启用,0表示关闭

rpl_semi_sync_master_timeout=10000:毫秒单位,该参数主服务器等待确认消息10秒后,不再等待,变为异步方式。

Candicate master主机:

server-id = 2

log-bin=mysql-bin

binlog_format=mixed

log-bin-index=mysql-bin.index

relay_log_purge=0

relay-log= relay-bin

relay-log-index = slave-relay-bin.index

rpl_semi_sync_master_enabled=1

rpl_semi_sync_master_timeout=10000

rpl_semi_sync_slave_enabled=1

注:relay_log_purge=0,禁止 SQL 线程在执行完一个 relay log 后自动将其删除,对于MHA场景下,对于某些滞后从库的恢复依赖于其他从库的relaylog,因此采取禁用自动删除功能

Slave主机:

Server-id = 3

log-bin =mysql-bin

relay-log= relay-bin

relay-log-index = slave-relay-bin.index

read_only = 1

rpl_semi_sync_slave_enabled=1

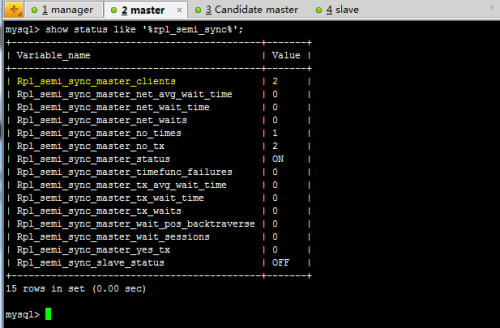

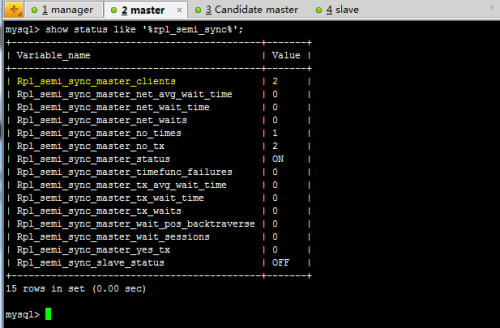

查看半同步相关信息

mysql>show variables like ‘%rpl_semi_sync%’;

查看半同步状态:

mysql>show status like ‘%rpl_semi_sync%’;

有几个状态参数值得关注的:

rpl_semi_sync_master_status :显示主服务是异步复制模式还是半同步复制模式

rpl_semi_sync_master_clients :显示有多少个从服务器配置为半同步复制模式

rpl_semi_sync_master_yes_tx :显示从服务器确认成功提交的数量

rpl_semi_sync_master_no_tx :显示从服务器确认不成功提交的数量

rpl_semi_sync_master_tx_avg_wait_time :事务因开启 semi_sync ,平均需要额外等待的时间

rpl_semi_sync_master_net_avg_wait_time :事务进入等待队列后,到网络平均等待时间

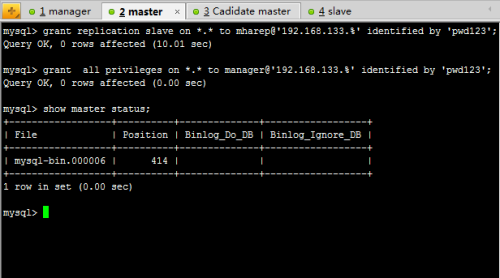

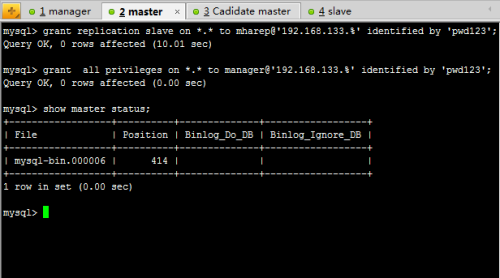

master:

第一条grant命令是创建一个用于主从复制的帐号,在master和candicate master的主机上创建即可。

第二条grant命令是创建MHA管理账号,所有mysql服务器上都需要执行。MHA会在配置文件里要求能远程登录到数据库,所以要进行必要的赋权。

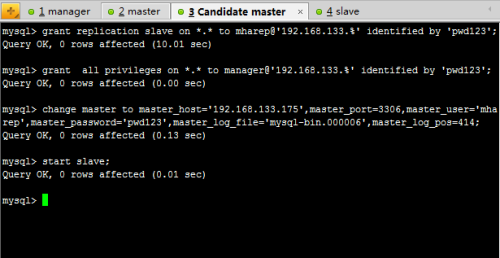

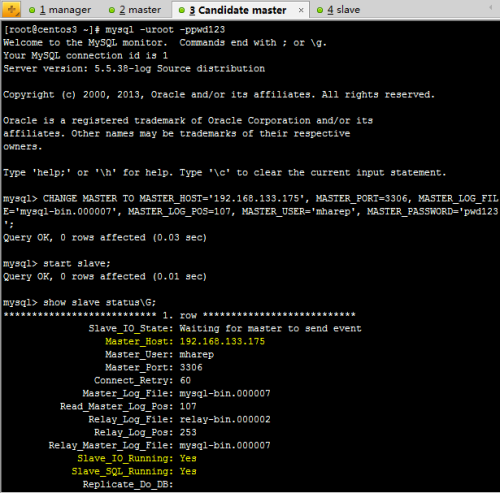

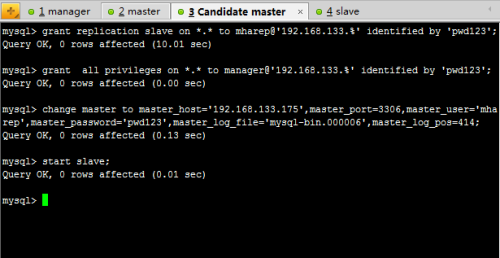

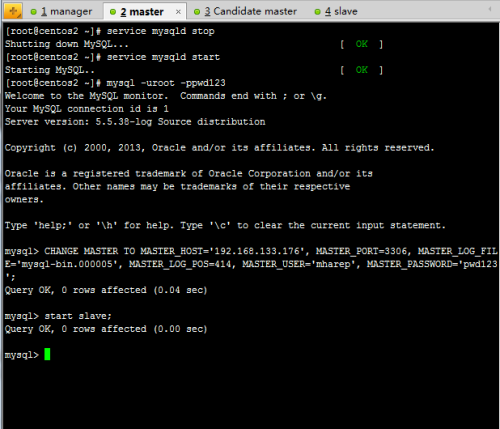

Candidate master:

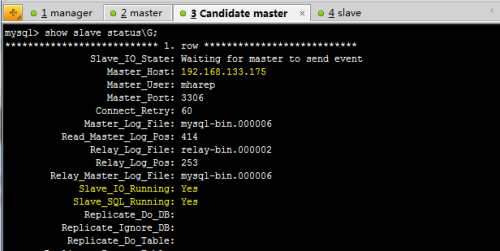

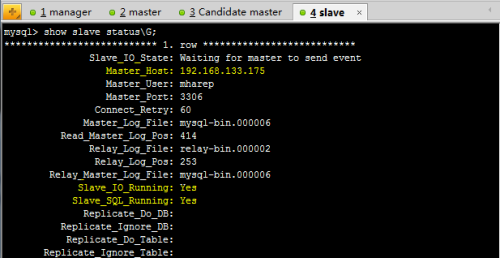

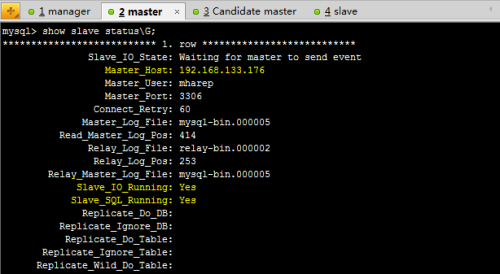

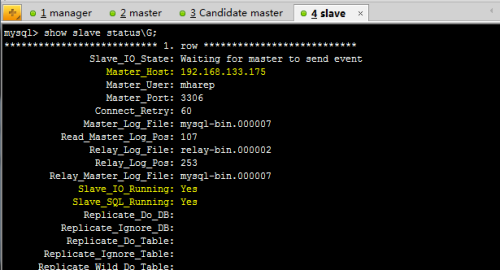

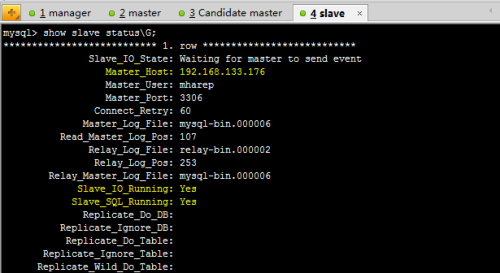

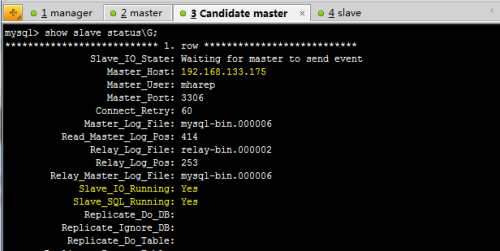

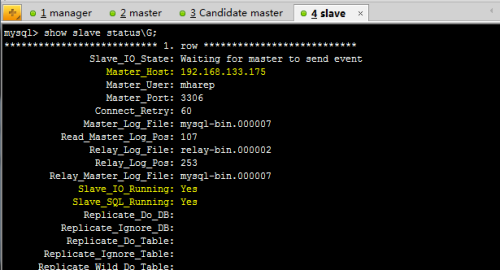

查看从的状态,以下两个值必须为yes,代表从服务器能正常连接主服务器

Slave_IO_Running:Yes

Slave_SQL_Running:Yes

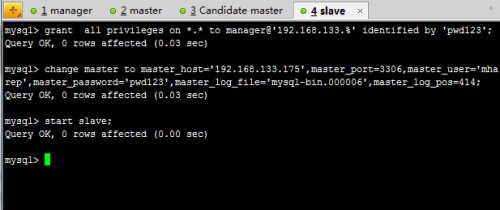

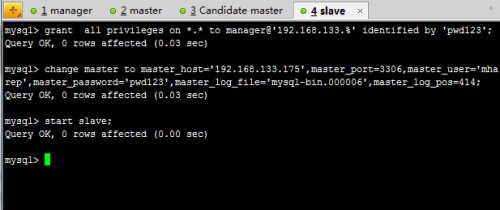

Slave:

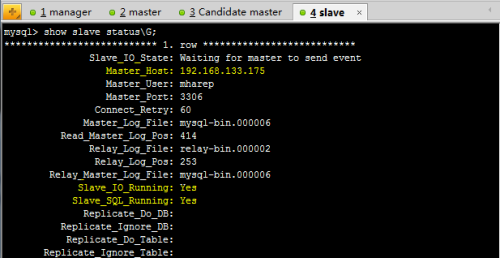

查看从的状态,以下两个值必须为yes,代表从服务器能正常连接主服务器

Slave_IO_Running:Yes

Slave_SQL_Running:Yes

查看master服务器的半同步状态:

mysql>show status like ‘%rpl_semi_sync%’;

三、配置mysql-mha

mha包括manager节点和data节点,data节点包括原有的MySQL复制结构中的主机,至少3台,即1主2从,当masterfailover后,还能保证主从结构;只需安装node包。manager server:运行监控脚本,负责monitoring 和 auto-failover;需要安装node包和manager包。

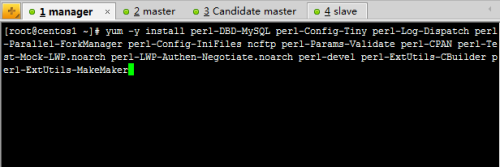

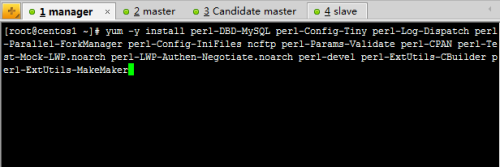

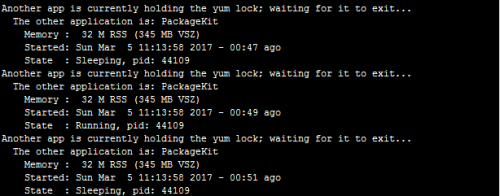

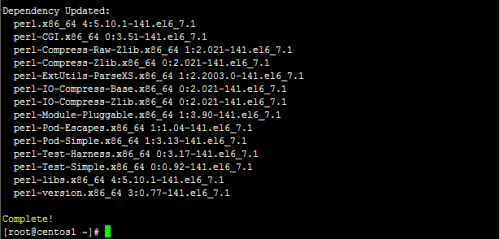

1、在所有主机上安装mha所依赖的软件包(以manager主机为例)

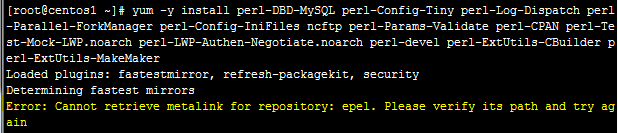

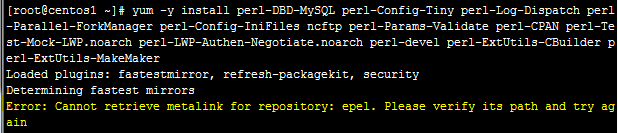

yum -yinstall perl-DBD-MySQL perl-Config-Tiny perl-Log-Dispatchperl-Parallel-ForkManager perl-Config-IniFiles ncftp perl-Params-Validateperl-CPAN perl-Test-Mock-LWP.noarch perl-LWP-Authen-Negotiate.noarch perl-develperl-ExtUtils-CBuilder perl-ExtUtils-MakeMaker安装时报如下错误

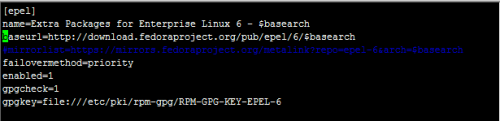

解决方法如下,例如:把/etc/yum.repos.d/epel.repo,文件第3行注释去掉,把第四行注释掉。具体如下:

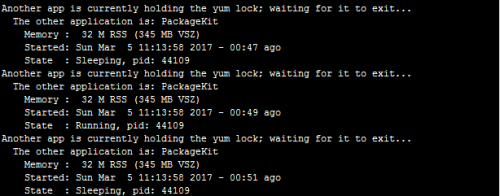

接着又报如下错误

解决方法,例如:执行rm -rf /var/run/yum.pid命令删除yum.pid文件,再次安装

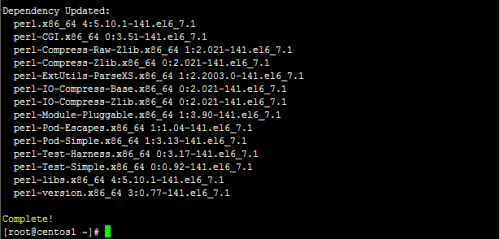

从上图可以看出安装成功

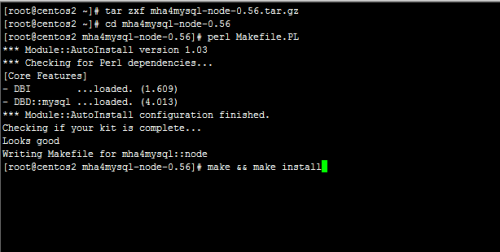

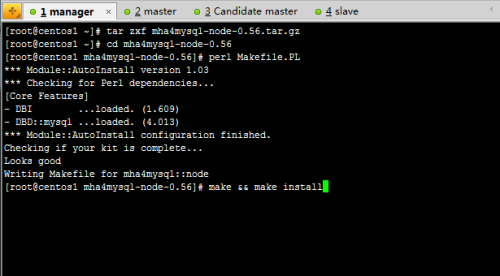

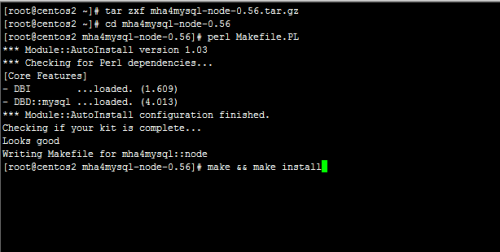

2、以下操作管理节点需要两个都安装, 在3台数据库节点只要安装MHA的node节点:在所有数据库节点上安装mha4mysql-node-0.56.tar.gz(以centos2为例)

其他两个数据节点也安装mha4mysql-node-0.56.tar.gz(过程略)

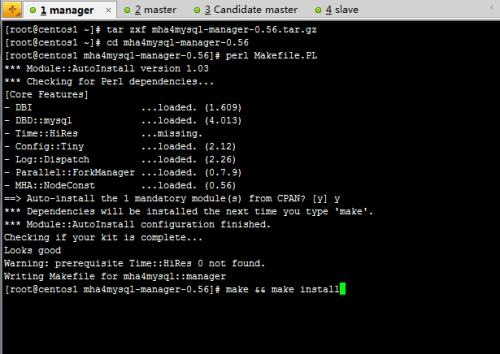

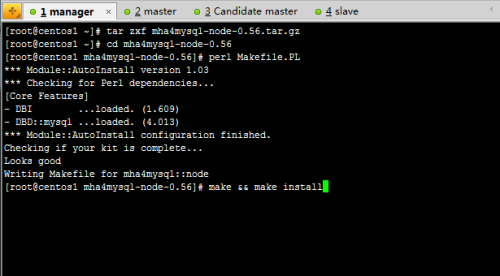

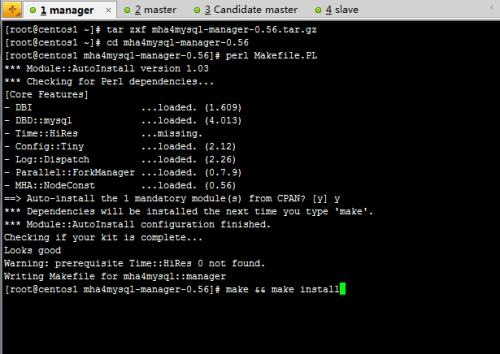

在管理节点需要两个都安装:mha4mysql-node-0.56.tar.gz和mha4mysql-manager-0.56.tar.gz

安装mha4mysql-node-0.56.tar.gz

安装mha4mysql-manager-0.56.tar.gz(确保manager主机正常连接internet)

根据提示输入。

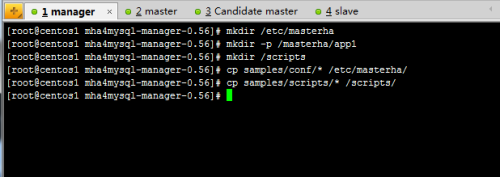

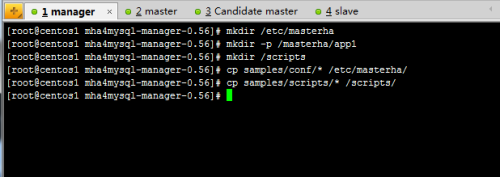

3、配置mha与绝大多数Linux应用程序类似,MHA的正确使用依赖于合理的配置文件。MHA的配置文件与mysql的my.cnf文件配置相似,采取的是param=value的方式来配置,配置文件位于管理节点,通常包括每一个mysql server的主机名,mysql用户名,密码,工作目录等等。

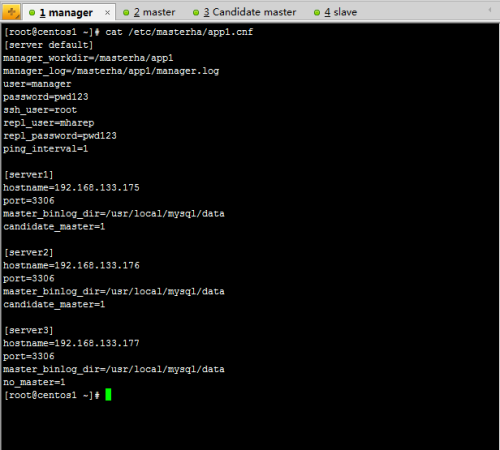

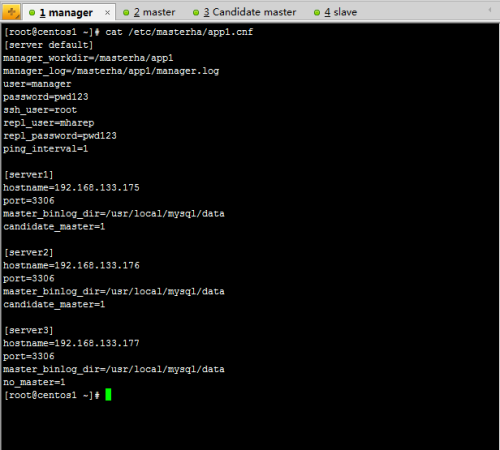

编辑/etc/masterha/app1.cnf,内容如下:

保存退出

配关配置项的解释:

manager_workdir=/masterha/app1//设置manager的工作目录

manager_log=/masterha/app1/manager.log//设置manager的日志

user=manager//设置监控用户manager

password=123456 //监控用户manager的密码

ssh_user=root //ssh连接用户

repl_user=mharep //主从复制用户

repl_password=123.abc//主从复制用户密码

ping_interval=1 //设置监控主库,发送ping包的时间间隔,默认是3秒,尝试三次没有回应的时候自动进行railover

master_binlog_dir=/usr/local/mysql/data //设置master 保存binlog的位置,以便MHA可以找到master的日志,我这里的也就是mysql的数据目录

candidate_master=1//设置为候选master,如果设置该参数以后,发生主从切换以后将会将此从库提升为主库。

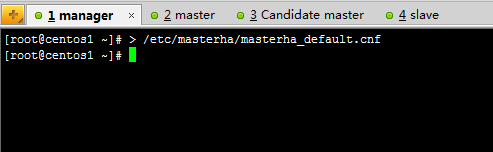

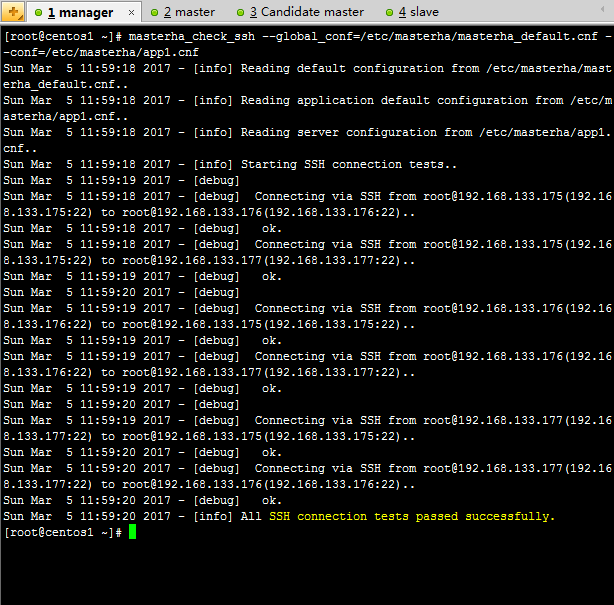

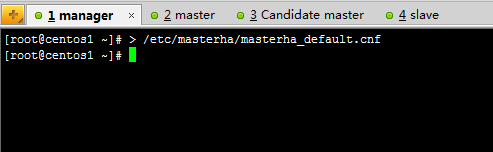

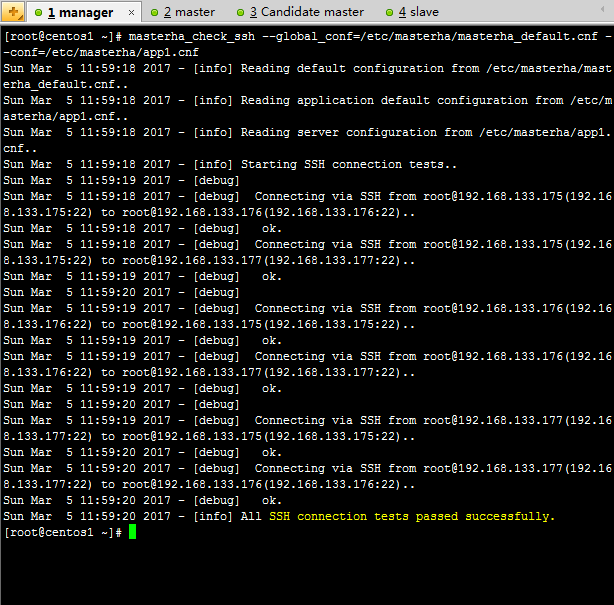

SSH 有效性验证:

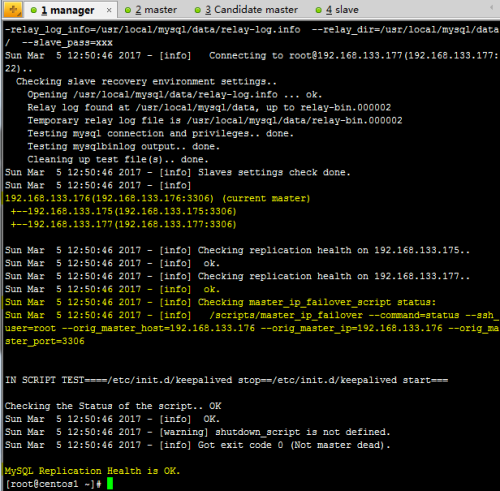

集群复制的有效性验证:

mysql必须都启动

masterha_check_repl--global_conf=/etc/masterha/masterha_default.cnf --conf=/etc/masterha/app1.cnf

Sun Mar 5 12:00:45 2017 - [info] Reading default configuration from/etc/masterha/masterha_default.cnf..

Sun Mar 5 12:00:45 2017 - [info] Reading application default configuration from/etc/masterha/app1.cnf..

Sun Mar 5 12:00:45 2017 - [info] Reading server configuration from/etc/masterha/app1.cnf..

Sun Mar 5 12:00:45 2017 - [info] MHA::MasterMonitor version 0.56.

Sun Mar 5 12:00:45 2017 - [info] GTID failover mode = 0

Sun Mar 5 12:00:45 2017 - [info] Dead Servers:

Sun Mar 5 12:00:45 2017 - [info] Alive Servers:

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.176(192.168.133.176:3306)

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.177(192.168.133.177:3306)

Sun Mar 5 12:00:45 2017 - [info] Alive Slaves:

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.176(192.168.133.176:3306) Version=5.5.38-log (oldest major version between slaves) log-bin:enabled

Sun Mar 5 12:00:45 2017 - [info] Replicating from 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] Primary candidate for the new Master (candidate_master is set)

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.177(192.168.133.177:3306) Version=5.5.38-log (oldest major versionbetween slaves) log-bin:enabled

Sun Mar 5 12:00:45 2017 - [info] Replicating from 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] Notcandidate for the new Master (no_master is set)

Sun Mar 5 12:00:45 2017 - [info] Current AliveMaster: 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] Checking slave configurations..

Sun Mar 5 12:00:45 2017 - [info] read_only=1 is not set on slave 192.168.133.176(192.168.133.176:3306).

Sun Mar 5 12:00:45 2017 - [warning] relay_log_purge=0 is not set on slave192.168.133.176(192.168.133.176:3306).

Sun Mar 5 12:00:45 2017 - [warning] relay_log_purge=0 is not set on slave 192.168.133.177(192.168.133.177:3306).

Sun Mar 5 12:00:45 2017 - [info] Checking replication filtering settings..

Sun Mar 5 12:00:45 2017 - [info] binlog_do_db= , binlog_ignore_db=

Sun Mar 5 12:00:45 2017 - [info] Replication filtering check ok.

Sun Mar 5 12:00:45 2017 - [info] GTID (with auto-pos) is not supported

Sun Mar 5 12:00:45 2017 - [info] Starting SSH connection tests..

Sun Mar 5 12:00:47 2017 - [info] All SSH connection tests passed successfully.

Sun Mar 5 12:00:47 2017 - [info] Checking MHA Node version..

Sun Mar 5 12:00:48 2017 - [info] Versioncheck ok.

Sun Mar 5 12:00:48 2017 - [info] Checking SSH publickey authentication settingson the current master..

Sun Mar 5 12:00:48 2017 - [info] HealthCheck: SSH to 192.168.133.175 is reachable.

Sun Mar 5 12:00:48 2017 - [info] Master MHA Node version is 0.56.

Sun Mar 5 12:00:48 2017 - [info] Checking recovery script configurations on192.168.133.175(192.168.133.175:3306)..

Sun Mar 5 12:00:48 2017 - [info] Executing command: save_binary_logs --command=test --start_pos=4--binlog_dir=/usr/local/mysql/data --output_file=/var/tmp/save_binary_logs_test--manager_version=0.56 --start_file=mysql-bin.000006

Sun Mar 5 12:00:48 2017 - [info] Connecting to root@192.168.133.175(192.168.133.175:22)..

Creating /var/tmp if not exists.. ok.

Checking output directory is accessible or not..

ok.

Binlog found at /usr/local/mysql/data, up to mysql-bin.000006

Sun Mar 5 12:00:49 2017 - [info] Binlog setting check done.

Sun Mar 5 12:00:49 2017 - [info] Checking SSH publickey authentication andchecking recovery script configurations on all alive slave servers..

Sun Mar 5 12:00:49 2017 - [info] Executing command : apply_diff_relay_logs --command=test--slave_user='manager' --slave_host=192.168.133.176 --slave_ip=192.168.133.176--slave_port=3306 --workdir=/var/tmp --target_version=5.5.38-log--manager_version=0.56--relay_log_info=/usr/local/mysql/data/relay-log.info --relay_dir=/usr/local/mysql/data/ --slave_pass=xxx

Sun Mar 5 12:00:49 2017 - [info] Connecting to root@192.168.133.176(192.168.133.176:22)..

Checking slave recovery environment settings..

Opening /usr/local/mysql/data/relay-log.info ... ok.

Relay log found at /usr/local/mysql/data, up to relay-bin.000002

Temporary relay log file is /usr/local/mysql/data/relay-bin.000002

Testing mysql connection and privileges.. done.

Testing mysqlbinlog output.. done.

Cleaning up test file(s).. done.

Sun Mar 5 12:00:49 2017 - [info] Executing command : apply_diff_relay_logs --command=test--slave_user='manager' --slave_host=192.168.133.177 --slave_ip=192.168.133.177--slave_port=3306 --workdir=/var/tmp --target_version=5.5.38-log--manager_version=0.56 --relay_log_info=/usr/local/mysql/data/relay-log.info --relay_dir=/usr/local/mysql/data/ --slave_pass=xxx

Sun Mar 5 12:00:49 2017 - [info] Connecting to root@192.168.133.177(192.168.133.177:22)..

Checking slave recovery environment settings..

Opening /usr/local/mysql/data/relay-log.info ... ok.

Relay log found at /usr/local/mysql/data, up to relay-bin.000002

Temporary relay log file is /usr/local/mysql/data/relay-bin.000002

Testing mysql connection and privileges.. done.

Testing mysqlbinlog output.. done.

Cleaning up test file(s).. done.

Sun Mar 5 12:00:50 2017 - [info] Slaves settings check done.

Sun Mar 5 12:00:50 2017 - [info]

192.168.133.175(192.168.133.175:3306)(current master)

+--192.168.133.176(192.168.133.176:3306)

+--192.168.133.177(192.168.133.177:3306)

Sun Mar 5 12:00:50 2017 - [info] Checking replication health on192.168.133.176..

Sun Mar 5 12:00:50 2017 - [info] ok.

Sun Mar 5 12:00:50 2017 - [info] Checking replication health on192.168.133.177..

Sun Mar 5 12:00:50 2017 - [info] ok.

Sun Mar 5 12:00:50 2017 - [warning] master_ip_failover_script is not defined.

Sun Mar 5 12:00:50 2017 - [warning] shutdown_script is not defined.

Sun Mar 5 12:00:50 2017 - [info] Got exit code 0 (Not master dead).

MySQL ReplicationHealth is OK.

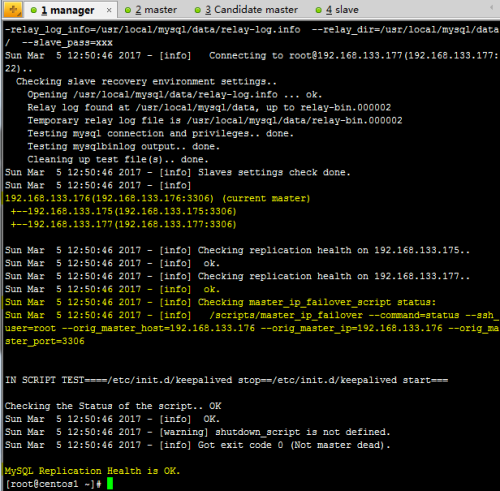

验证成功的话会自动识别出所有服务器和主从状况

注:验证成功的话会自动识别出所有服务器和主从状况

在验证时,若遇到这个错误:Can't exec "mysqlbinlog" ......

解决方法是在所有服务器上执行:

ln -s /usr/local/mysql/bin/* /usr/local/bin/

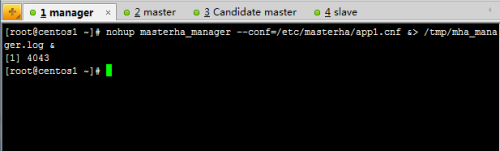

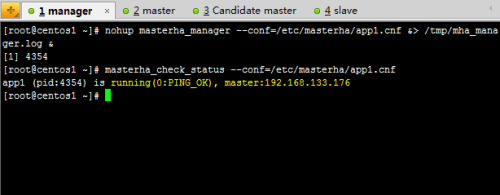

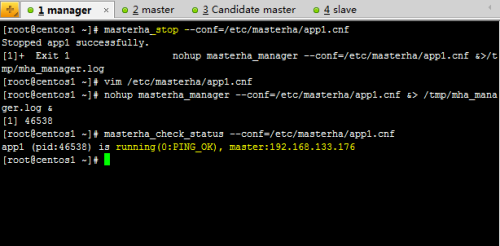

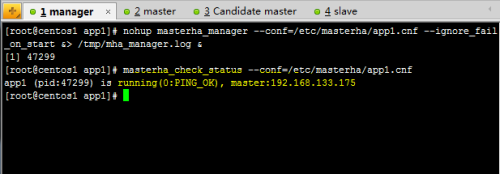

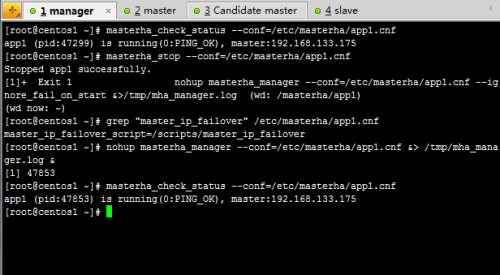

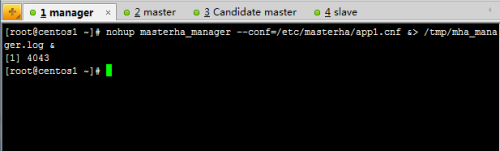

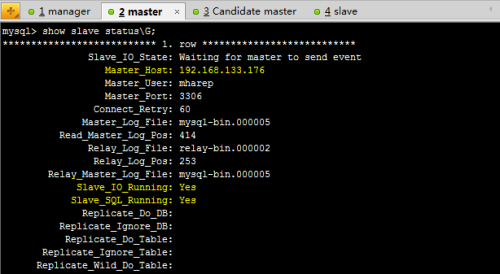

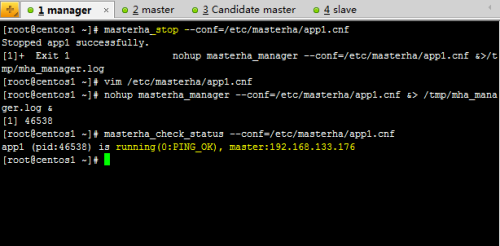

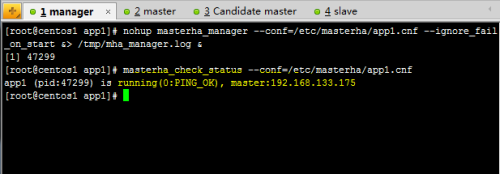

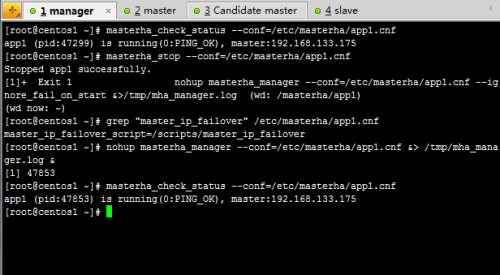

启动 manager:

注:在应用Unix/Linux时,我们一般想让某个程序在后台运行,于是我们将常会用&在程序结尾来让程序自动运行。比如我们要运行mysql在后台: /usr/local/mysql/bin/mysqld_safe –user=mysql&。可是有很多程序并不想mysqld一样,这样我们就需要nohup命令,

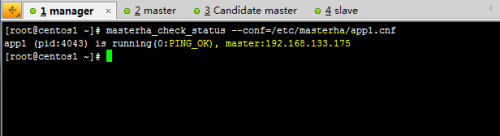

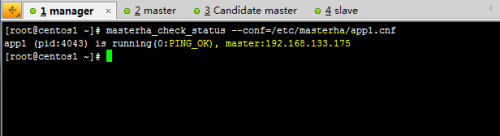

状态检查:

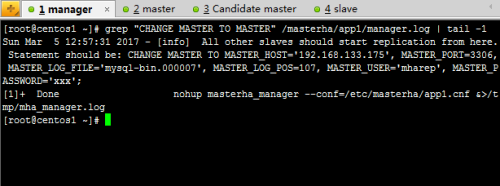

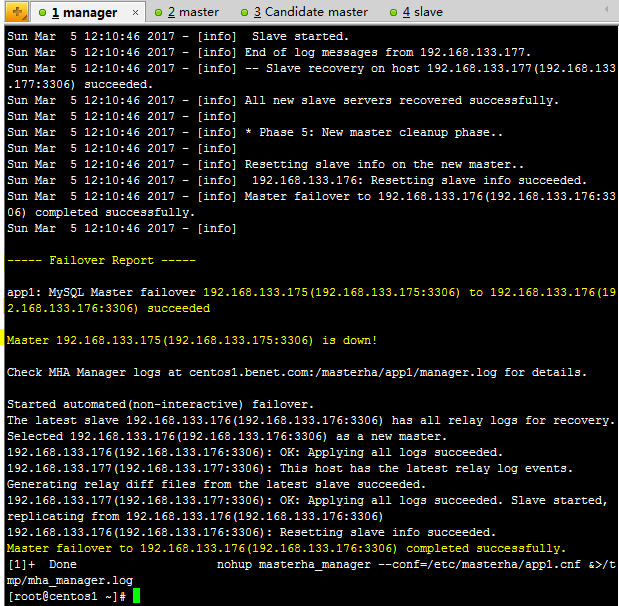

故障转移验证:(自动failover)

master dead后,MHA当时已经开启,候选Master库(Slave)会自动failover为Master.

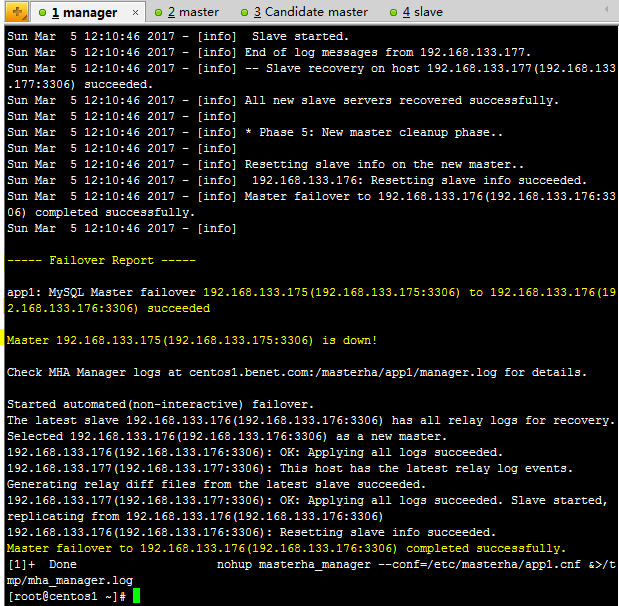

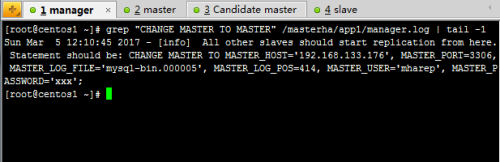

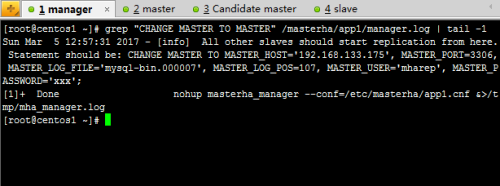

2)查看 MHA 日志

上面的配置文件中指定了日志位置为 /masterha/app1/manager.log

从日志信息中可以看到master failover 已经成功了,并可以看出故障转移的大体流程

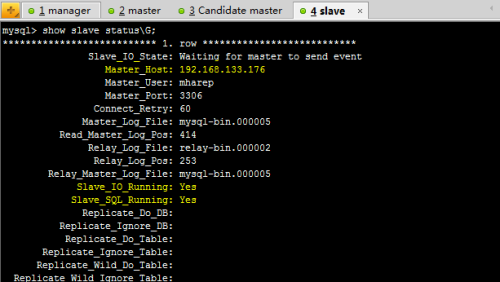

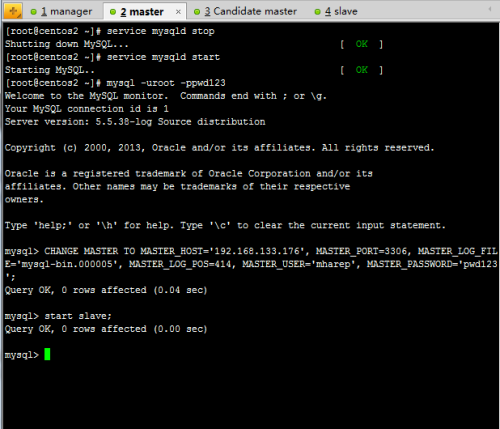

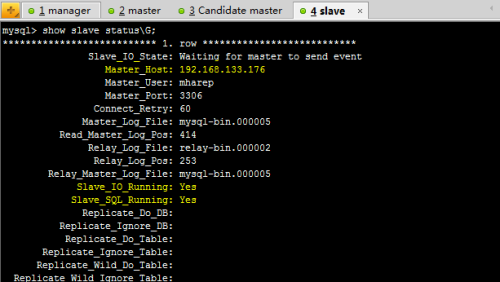

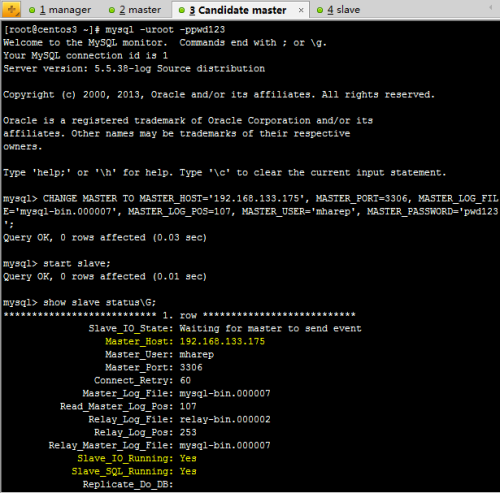

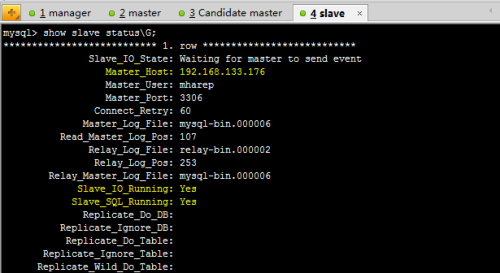

3)检查 slave2 的复制

登录 slave(192.168.133.177)的Mysql,查看 slave 状态

可以看到master 的 IP 现在为 192.168.133.176,已经切换到和192.168.133.176同步了,本来是和192.168.133.175同步的,说明 MHA 已经把Candidatemaster(centos3)提升为了新的master,IO线程和SQL线程也正确运行,MHA 搭建成功

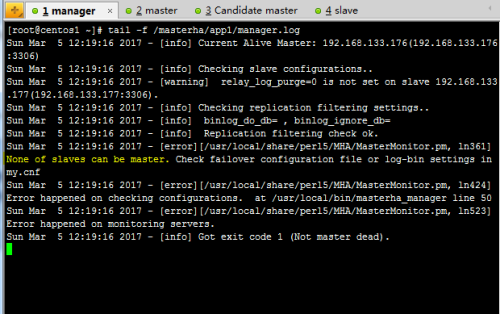

MHA Manager 端日常主要操作步骤

1)检查是否有下列文件,有则删除。

发生主从切换后,MHAmanager服务会自动停掉,且在manager_workdir(/masterha/app1)目录下面生成文件app1.failover.complete,若要启动MHA,必须先确保无此文件)

2)检查MHA当前置:

# masterha_check_repl --conf=/etc/masterha/app1.cnf

3)启动MHA:

#nohup masterha_manager --conf=/etc/masterha/app1.cnf&>/tmp/mha_manager.log &

当有slave 节点宕掉时,默认是启动不了的,加上 --ignore_fail_on_start即使有节点宕掉也能启动MHA,如下:

#nohup masterha_manager --conf=/etc/masterha/app1.cnf --ignore_fail_on_start&>/tmp/mha_manager.log &

4)停止MHA: masterha_stop --conf=/etc/masterha/app1.cnf

5)检查状态:

# masterha_check_status --conf=/etc/masterha/app1.cnf

6)检查日志:

#tail -f /masterha/app1/manager.log

7)主从切换后续工作

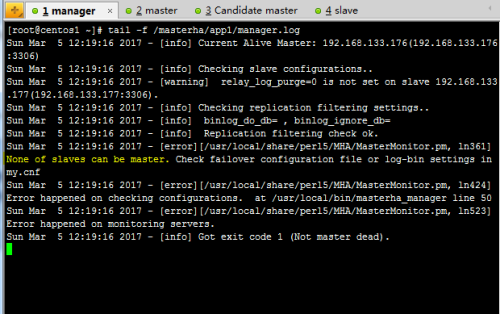

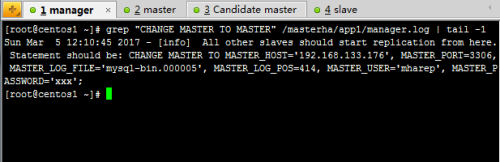

重构:

重构就是你的主挂了,切换到Candicatemaster上,Candicate master变成了主,因此重构的一种方案原主库修复成一个新的slave

主库切换后,把原主库修复成新从库,然后重新执行以上5步。原主库数据文件完整的情况下,可通过以下方式找出最后执行的CHANGE MASTER命令:

启动manager:

注意:如果正常,会显示"PING_OK",否则会显示"NOT_RUNNING",这代表MHA监控没有开启。

定期删除中继日志

在配置主从复制中,slave上设置了参数relay_log_purge=0,所以slave节点需要定期删除中继日志,建议每个slave节点删除中继日志的时间错开。

corntab -e

0 5 * * * /usr/local/bin/purge_relay_logs - -user=root --password=pwd123--port=3306 --disable_relay_log_purge>>/var/log/purge_relay.log 2>&1

四、配置VIP:

vip配置可以采用两种方式,一种通过keepalived的方式管理虚拟ip的浮动;另外一种通过脚本方式启动虚拟ip的方式(即不需要keepalived或者heartbeat类似的软件)。

1、keepalived方式管理虚拟ip,keepalived配置方法如下:

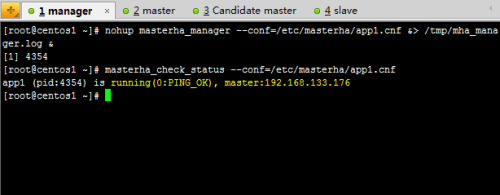

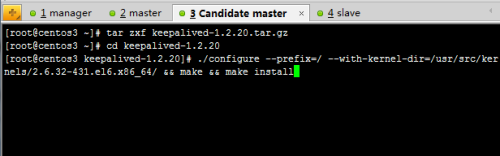

下载软件进行并进行安装(两台master,准确的说一台是master,另外一台是备选master,在没有切换以前是slave)

在centos2和centos3上安装软件包keepalived

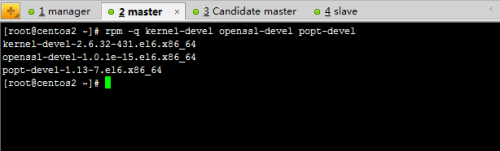

安装keepalived软件包与服务控制

在编译安装Keepalived之前,必须先安装内核开发包kernel-devel以及openssl-devel、popt-devel等支持库。

若没有安装则通过rpm或yum工具进行安装

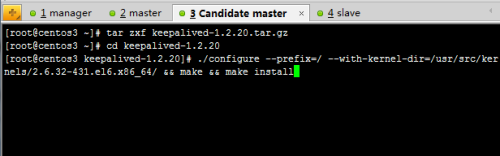

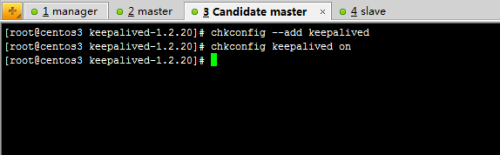

编译安装Keepalived

使用指定的linux内核位置对keepalived进行配置,并将安装路径指定为根目录,这样就无需额外创建链接文件了,配置完成后,依次执行make、make install进行安装。

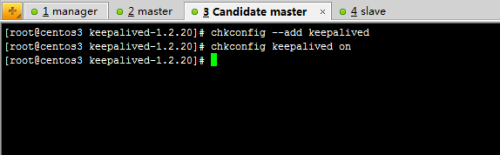

使用keepalived服务

执行make install操作之后,会自动生成/etc/init.d/keepalived脚本文件,但还需要手动添加为系统服务,这样就可以使用service、chkconfig工具来对keepalived服务程序进行管理了。

Centos2主机也完成keepalived安装,与centos3一样,安装过程略

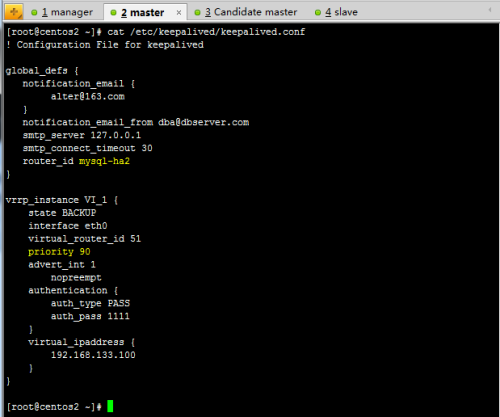

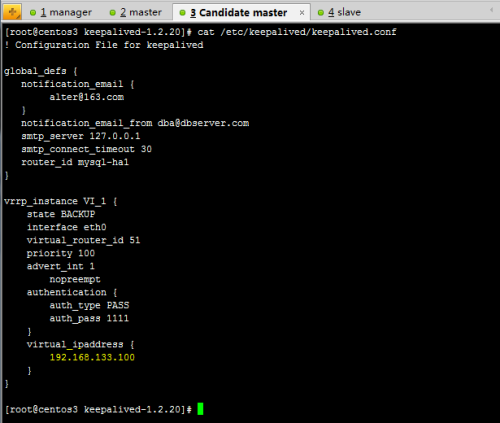

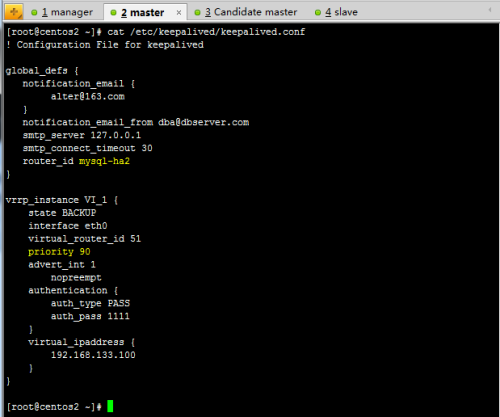

注:若开启了防火墙,需要关闭防火墙或创建规则。

修改Keepalived的配置文件(在master上配置)

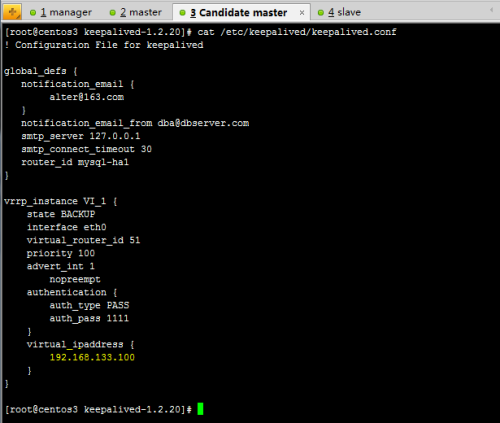

在候选master上配置

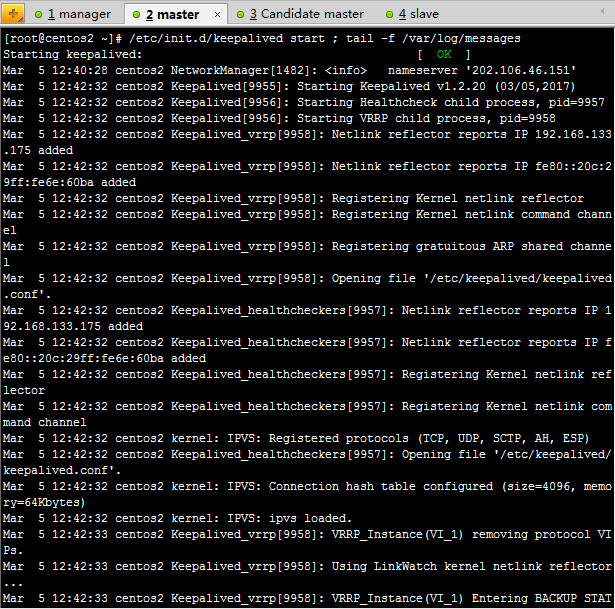

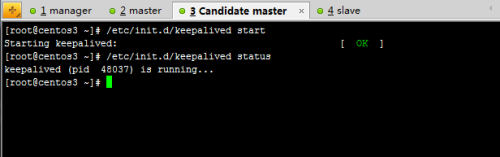

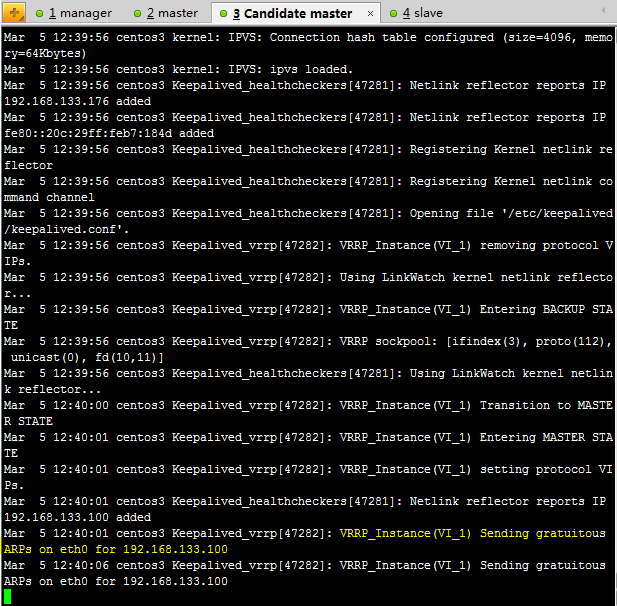

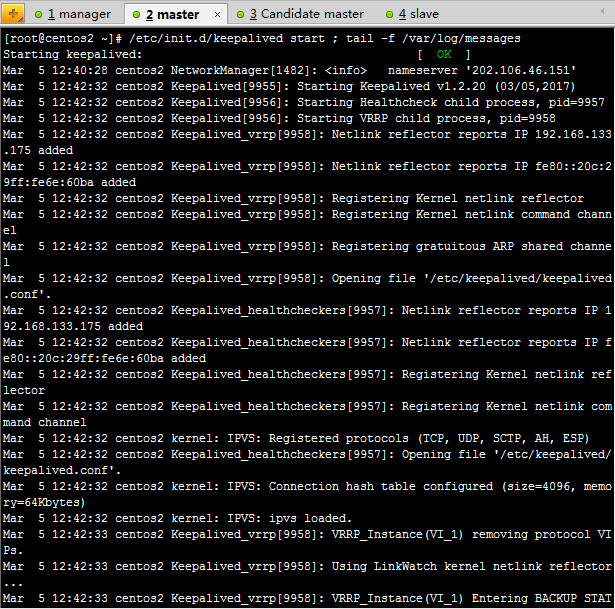

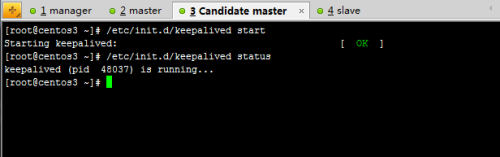

启动keepalived服务,在master上启动并查看日志

#/etc/init.d/keepalivedstart ; tail -f/var/log/messages

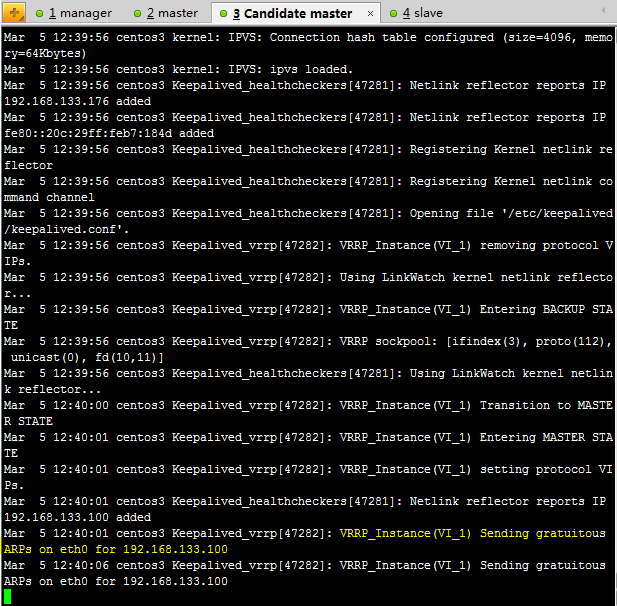

发现已经将虚拟ip 192.168.1.100绑定了网卡eth0上

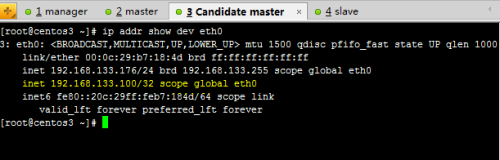

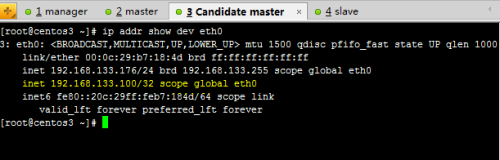

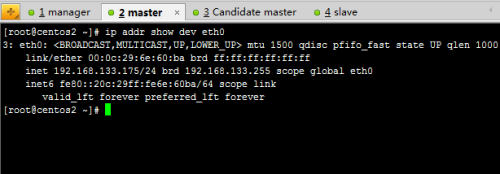

查看eth0网卡是否绑定了VIP

在另外一台服务器,候选master上启动keepalived服务,并观察

#/etc/init.d/keepalivedstart ; tail -f/var/log/messages

查看eth0网卡绑定情况

从上面的信息可以看到keepalived已经配置成功

注意:

上面两台服务器的keepalived都设置为了BACKUP模式,在keepalived中2种模式,分别是master->backup模式和backup->backup模式。这两种模式有很大区别。在master->backup模式下,一旦主库宕机,虚拟ip会自动漂移到从库,当主库修复后,keepalived启动后,还会把虚拟ip抢占过来,即使设置了非抢占模式(nopreempt)抢占ip的动作也会发生。在backup->backup模式下,当主库宕机后虚拟ip会自动漂移到从库上,当原主库恢复和keepalived服务启动后,并不会抢占新主的虚拟ip,即使是优先级高于从库的优先级别,也不会发生抢占。为了减少ip漂移次数,通常是把修复好的主库当做新的备库。

2、MHA引入keepalived(MySQL服务进程挂掉时通过MHA 停止keepalived):

要想把keepalived服务引入MHA,我们只需要修改切换时触发的脚本文件master_ip_failover即可,在该脚本中添加在master发生宕机时对keepalived的处理。

编辑脚本/scripts/master_ip_failover,修改后如下。

[root@centos1~]# cat /scripts/master_ip_failover

#!/usr/bin/envperl

usestrict;

usewarnings FATAL => 'all';

useGetopt::Long;

my(

$command, $ssh_user, $orig_master_host, $orig_master_ip,

$orig_master_port, $new_master_host,$new_master_ip, $new_master_port

);

my$vip = '192.168.133.100';

my$ssh_start_vip = "/etc/init.d/keepalived start";

my$ssh_stop_vip = "/etc/init.d/keepalived stop";

GetOptions(

'command=s' => \$command,

'ssh_user=s' => \$ssh_user,

'orig_master_host=s' =>\$orig_master_host,

'orig_master_ip=s' => \$orig_master_ip,

'orig_master_port=i' =>\$orig_master_port,

'new_master_host=s' => \$new_master_host,

'new_master_ip=s' => \$new_master_ip,

'new_master_port=i' => \$new_master_port,

);

exit&main();

submain {

print "\n\nIN SCRIPTTEST====$ssh_stop_vip==$ssh_start_vip===\n\n";

if ( $command eq "stop" ||$command eq "stopssh" ) {

my $exit_code = 1;

eval {

print "Disabling the VIP onold master: $orig_master_host \n";

&stop_vip();

$exit_code = 0;

};

if ($@) {

warn "Got Error: $@\n";

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "start" ) {

my $exit_code = 10;

eval {

print "Enabling the VIP - $vipon the new master - $new_master_host \n";

&start_vip();

$exit_code = 0;

};

if ($@) {

warn $@;

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "status" ) {

print "Checking the Status of thescript.. OK \n";

#`ssh $ssh_user\@cluster1 \"$ssh_start_vip \"`;

exit 0;

}

else {

&usage();

exit 1;

}

}

#A simple system call that enable the VIP on the new master

substart_vip() {

`ssh $ssh_user\@$new_master_host \"$ssh_start_vip \"`;

}

#A simple system call that disable the VIP on the old_master

substop_vip() {

return 0 unless ($ssh_user);

`ssh $ssh_user\@$orig_master_host \"$ssh_stop_vip \"`;

}

subusage {

print

"Usage: master_ip_failover--command=start|stop|stopssh|status --orig_master_host=host --orig_master_ip=ip--orig_master_port=port --new_master_host=host --new_master_ip=ip--new_master_port=port\n";

}

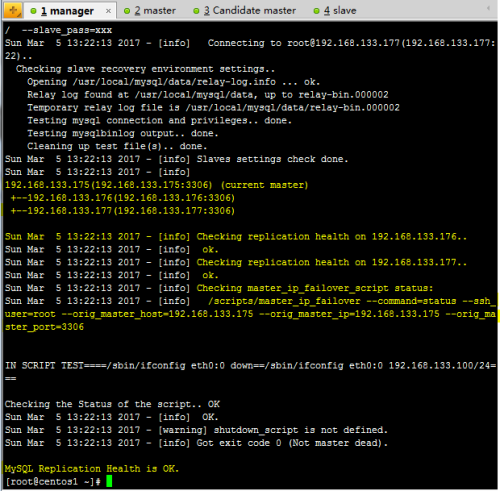

现在已经修改这个脚本了,接下来我们在/etc/masterha/app1.cnf 中调用故障切换脚本

停止MHA:

#masterha_stop --conf=/etc/masterha/app1.cnf

在配置文件/etc/masterha/app1.cnf 中启用下面的参数(在[server default下面添加])

master_ip_failover_script=/scripts/master_ip_failover

启动MHA:

#nohup masterha_manager --conf=/etc/masterha/app1.cnf &> /tmp/mha_manager.log &

检查状态:

[root@centos1 ~]# masterha_check_status --conf=/etc/masterha/app1.cnf

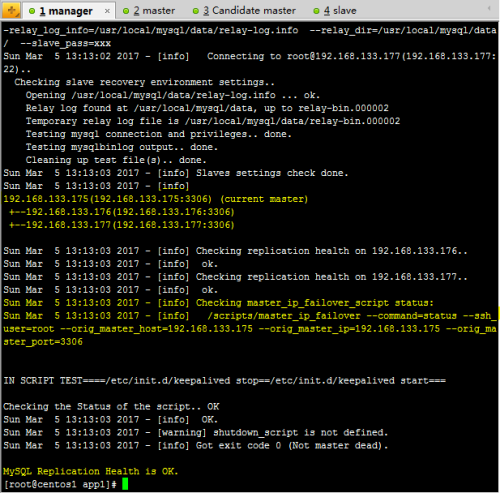

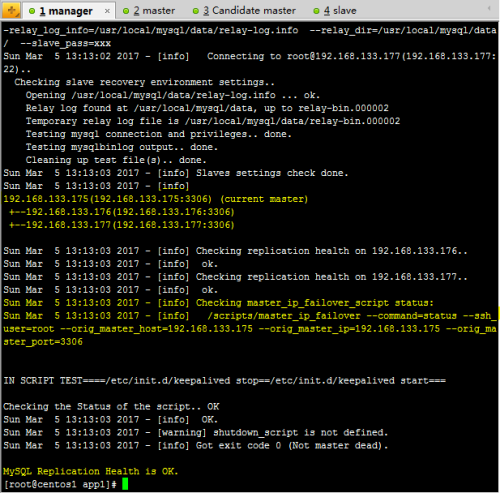

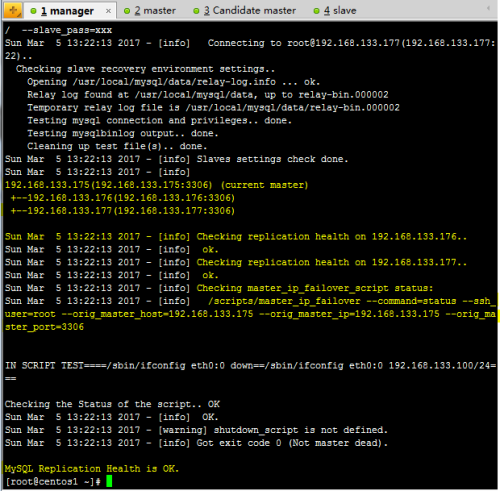

再检查集群状态,看是否会报错。

可以看见已经没有报错了。

/scripts/master_ip_failover添加或者修改的内容意思是当主库数据库发生故障时,会触发MHA切换,MHA Manager会停掉主库上的keepalived服务,触发虚拟ip漂移到备选从库,从而完成切换。

当然可以在keepalived里面引入脚本,这个脚本监控mysql是否正常运行,如果不正常,则调用该脚本杀掉keepalived进程(参考MySQL 高可用性keepalived+mysql双主)。

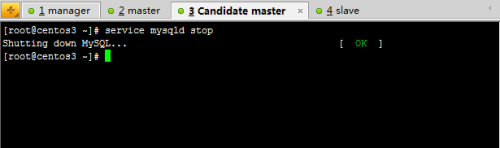

测试:

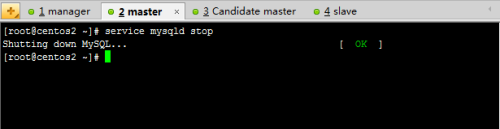

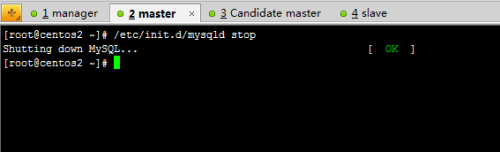

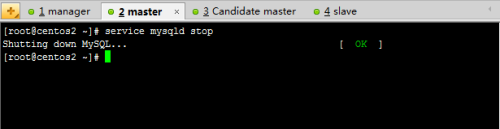

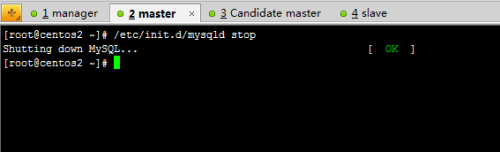

在master上停止mysqld服务

到slave(192.168.133.177)查看slave的状态:

从上图可以看出slave指向了新的master服务器192.168.133.175(在故障切换前指向的是192.168.133.176)

查看VIP绑定:

在192.168.133.176上查看vip绑定

在192.168.133.175上查看vip绑定

从上面的显示结果可以看出vip地址漂移到了192.168.133.175

主从切换后续工作

重构:

重构就是你的主挂了,切换到Candicate master上,Candicate master变成了主,因此重构的一种方案原主库修复成一个新的slave

主库切换后,把原主库修复成新从库,原主库数据文件完整的情况下,可通过以下方式找出最后执行的CHANGE MASTER命令:

将192.168.133.176(原主库)修复成从库

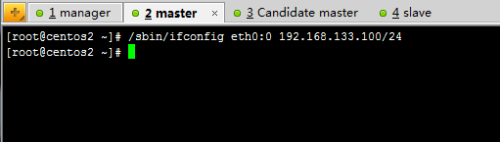

启动keepalived

启动mha manager:

[root@centos1 app1]# rm -fr app1.failover.complete

2、通过脚本实现VIP切换

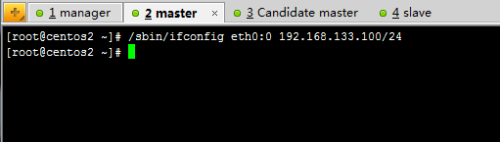

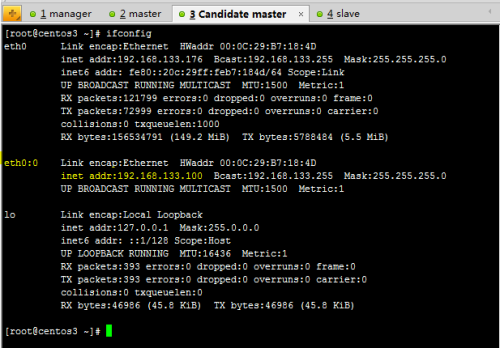

通过脚本的方式管理VIP。这里是修改/scripts/master_ip_failover,也可以使用其他的语言完成,比如php语言。使用php脚本编写的failover这里就不介绍了。修改完成后内容如下,而且如果使用脚本管理vip的话,需要手动在master服务器上绑定一个vip

[root@centos2 ~]# /sbin/ifconfig eth0:0 192.168.133.100/24

在mha-manager上修改/scripts/master_ip_failover,内容如下

[root@centos1 ~]# cat/scripts/master_ip_failover

#!/usr/bin/env perl

use strict;

use warnings FATAL => 'all';

use Getopt::Long;

my (

$command, $ssh_user, $orig_master_host, $orig_master_ip,

$orig_master_port, $new_master_host, $new_master_ip, $new_master_port

);

my $vip = '192.168.133.100/24';

my $key = '0';

my $ssh_start_vip = "/sbin/ifconfigeth0:$key $vip";

my $ssh_stop_vip = "/sbin/ifconfigeth0:$key down";

GetOptions(

'command=s' =>\$command,

'ssh_user=s' =>\$ssh_user,

'orig_master_host=s' => \$orig_master_host,

'orig_master_ip=s' =>\$orig_master_ip,

'orig_master_port=i' => \$orig_master_port,

'new_master_host=s' =>\$new_master_host,

'new_master_ip=s' =>\$new_master_ip,

'new_master_port=i' =>\$new_master_port,

);

exit &main();

sub main {

print "\n\nIN SCRIPTTEST====$ssh_stop_vip==$ssh_start_vip===\n\n";

if ( $command eq "stop" || $command eq "stopssh" ) {

my $exit_code = 1;

eval {

print "Disabling the VIP onold master: $orig_master_host \n";

&stop_vip();

$exit_code = 0;

};

if ($@) {

warn "Got Error: $@\n";

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "start" ) {

my $exit_code = 10;

eval {

print "Enabling the VIP - $vipon the new master - $new_master_host \n";

&start_vip();

$exit_code = 0;

};

if ($@) {

warn $@;

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "status" ) {

print "Checking the Status of the script.. OK \n";

exit 0;

}

else {

&usage();

exit 1;

}

}

sub start_vip() {

`ssh $ssh_user\@$new_master_host \" $ssh_start_vip \"`;

}

sub stop_vip() {

return 0 unless ($ssh_user);

`ssh $ssh_user\@$orig_master_host \" $ssh_stop_vip \"`;

}

sub usage {

print

"Usage: master_ip_failover --command=start|stop|stopssh|status--orig_master_host=host --orig_master_ip=ip --orig_master_port=port--new_master_host=host --new_master_ip=ip --new_master_port=port\n";

}

4)停止MHA: masterha_stop --conf=/etc/masterha/app1.cnf

[root@centos1~]# grep "master_ip_failover" /etc/masterha/app1.cnf

master_ip_failover_script=/scripts/master_ip_failover

启动MHA:

[root@centos1~]# nohup masterha_manager --conf=/etc/masterha/app1.cnf & >/tmp/mha_manager.log &

5)检查状态:

再检查集群状态,看是否会报错。

测试:

在master上停掉mysql服务

到slave(192.168.133.177)查看slave的状态:

从上图可以看出slave指向了新的master服务器(192.168.133.176)

查看VIP

从上图可以看到centos2(原来的master)释放了VIP,centos03(新的master)接管了VIP地址

主从切换后续工作

主库切换后,把原主库修复成新从库,相关操作请参考前面相关操作。

为了防止脑裂发生,推荐生产环境采用脚本的方式来管理虚拟ip,而不是使用keepalived来完成。到此为止,基本MHA集群已经配置完毕。

总结:

MHA软件由两部分组成,Manager工具包和Node工具包,具体的说明如下。

Manager工具包主要包括以下几个工具:

masterha_check_ssh检查MHA的SSH配置状况

masterha_check_repl检查MySQL复制状况

masterha_manger启动MHA

masterha_check_status检测当前MHA运行状态

masterha_master_monitor检测master是否宕机

masterha_master_switch控制故障转移(自动或者手动)

masterha_conf_host添加或删除配置的server信息

Node工具包(这些工具通常由MHA Manager的脚本触发,无需人为操作)主要包括以下几个工具:

save_binary_logs保存和复制master的二进制日志

apply_diff_relay_logs识别差异的中继日志事件并将其差异的事件应用于其他的slave

filter_mysqlbinlog去除不必要的ROLLBACK事件(MHA已不再使用这个工具)

purge_relay_logs清除中继日志(不会阻塞SQL线程)

MHA(Master HighAvailability)目前在MySQL高可用方面是一个相对成熟的解决方案,它由日本DeNA公司youshimaton(现就职于Facebook公司)开发,是一套优秀的作为MySQL高可用性环境下故障切换和主从提升的高可用软件。在MySQL故障切换过程中,MHA能做到在0~30秒之内自动完成数据库的故障切换操作,并且在进行故障切换的过程中,MHA能在最大程度上保证数据的一致性,以达到真正意义上的高可用。

MHA里有两个角色一个是MHA Node(数据节点)另一个是MHA Manager(管理节点)。

MHA Manager可以单独部署在一台独立的机器上管理多个master-slave集群,也可以部署在一台slave节点上。MHA Node运行在每台MySQL服务器上,MHA Manager会定时探测集群中的master节点,当master出现故障时,它可以自动将最新数据的slave提升为新的master,然后将所有其他的slave重新指向新的master。整个故障转移过程对应用程序完全透明。

在MHA自动故障切换过程中,MHA试图从宕机的主服务器上保存二进制日志,最大程度的保证数据的不丢失,但这并不总是可行的。例如,如果主服务器硬件故障或无法通过ssh访问,MHA没法保存二进制日志,只进行故障转移而丢失了最新的数据。使用MySQL 5.5的半同步复制,可以大大降低数据丢失的风险。MHA可以与半同步复制结合起来。如果只有一个slave已经收到了最新的二进制日志,MHA可以将最新的二进制日志应用于其他所有的slave服务器上,因此可以保证所有节点的数据一致性。

注:从MySQL5.5开始,MySQL以插件的形式支持半同步复制。如何理解半同步呢?首先我们来看看异步,全同步的概念:

异步复制(Asynchronous replication)

MySQL默认的复制即是异步的,主库在执行完客户端提交的事务后会立即将结果返给给客户端,并不关心从库是否已经接收并处理,这样就会有一个问题,主如果crash掉了,此时主上已经提交的事务可能并没有传到从上,如果此时,强行将从提升为主,可能导致新主上的数据不完整。

全同步复制(Fully synchronous replication)

指当主库执行完一个事务,所有的从库都执行了该事务才返回给客户端。因为需要等待所有从库执行完该事务才能返回,所以全同步复制的性能必然会受到严重的影响。

半同步复制(Semisynchronous replication)

介于异步复制和全同步复制之间,主库在执行完客户端提交的事务后不是立刻返回给客户端,而是等待至少一个从库接收到并写到relay log中才返回给客户端。相对于异步复制,半同步复制提高了数据的安全性,同时它也造成了一定程度的延迟,这个延迟最少是一个TCP/IP往返的时间。所以,半同步复制最好在低延时的网络中使用。

下面来看看半同步复制的原理图:

总结:异步与半同步异同

默认情况下MySQL的复制是异步的,Master上所有的更新操作写入Binlog之后并不确保所有的更新都被复制到Slave之上。异步操作虽然效率高,但是在Master/Slave出现问题的时候,存在很高数据不同步的风险,甚至可能丢失数据。

MySQL5.5引入半同步复制功能的目的是为了保证在master出问题的时候,至少有一台Slave的数据是完整的。在超时的情况下也可以临时转入异步复制,保障业务的正常使用,直到一台salve追赶上之后,继续切换到半同步模式。

工作原理:

相较于其它HA软件,MHA的目的在于维持MySQL Replication中Master库的高可用性,其最大特点是可以修复多个Slave之间的差异日志,最终使所有Slave保持数据一致,然后从中选择一个充当新的Master,并将其它Slave指向它。

-从宕机崩溃的master保存二进制日志事件(binlogevents)。

-识别含有最新更新的slave。

-应用差异的中继日志(relay log)到其它slave。

-应用从master保存的二进制日志事件(binlogevents)。

-提升一个slave为新master。

-使其它的slave连接新的master进行复制。

目前MHA主要支持一主多从的架构,要搭建MHA,要求一个复制集群中必须最少有三台数据库服务器,一主二从,即一台充当master,一台充当备用master,另外一台充当从库,因为至少需要三台服务器。

接下来部署MHA,具体的搭建环境如下

| 角色 | IP地址 | 主机名 | Server id | 类型 | os |

| Manager | 192.168.133.174 | Centos1 | 管理节点 | Centos6.5x86_64 | |

| Master | 192.168.133.175 | Centos2 | 1 | 主mysql(写入) | Centos6.5x86_64 |

Candidate | 192.168.133.176 | Centos3 | 2 | 从mysql(读) | Centos6.5x86_64 |

| slave | 192.168.133.177 | Centos4 | 3 | 从mysql(读) | Centos6.5x86_64 |

一、基础环境准备

1、在配置好IP地址后检查selinux,iptables设置,关闭 selinux ,iptables 服务以便后期主从同步不出错注:时间要同步2、在四台机器都配置epel源(以manager为例)

3、建立ssh无交互登录环境,每台主机同样的操作(以manager为例)

测试ssh无交互登录

manager:

master:

Cadidate master:

slave:

4、配置hosts环境

查看每台主机的hosts文件

二、配置mysql半同步复制为了尽可能的减少主库硬件损坏宕机造成的数据丢失,因此在配置MHA的同时建议配置成MySQL的半同步复制。

注:mysql半同步插件是由谷歌提供,具体位置/usr/local/mysql/lib/plugin/下,一个是master用的semisync_master.so,一个是slave用的semisync_slave.so,下面我们就来具体配置一下。

如果不清楚Plugin的目录,用如下查找:

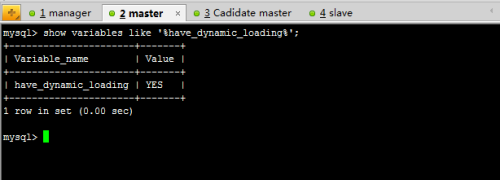

1、分别在主从节点上安装相关的插件(master,Candicatemaster,slave)在MySQL上安装插件需要数据库支持动态载入。检查是否支持,用如下检测:

所有mysql数据库服务器,安装半同步插件(semisync_master.so,semisync_slave.so)

master:

Cadidate master:

slave:

检查Plugin是否已正确安装:

mysql> show plugins;

或

mysql> select * from information_schema.plugins;

查看半同步相关信息

上图可以看到半同复制插件已经安装,只是还没有启用,所以是off

2、修改my.cnf文件,配置主从同步:

注:若主MYSQL服务器已经存在,只是后期才搭建从MYSQL服务器,在置配数据同步前应先将主MYSQL服务器的要同步的数据库拷贝到从MYSQL服务器上(如先在主MYSQL上备份数据库,再用备份在从MYSQL服务器上恢复)

master mysql主机:

server-id = 1

log-bin=mysql-bin

binlog_format=mixed

log-bin-index=mysql-bin.index

rpl_semi_sync_master_enabled=1

rpl_semi_sync_master_timeout=10000

rpl_semi_sync_slave_enabled=1

relay_log_purge=0

relay-log= relay-bin

relay-log-index = slave-relay-bin.index

注:

rpl_semi_sync_master_enabled=1 1表是启用,0表示关闭

rpl_semi_sync_master_timeout=10000:毫秒单位,该参数主服务器等待确认消息10秒后,不再等待,变为异步方式。

Candicate master主机:

server-id = 2

log-bin=mysql-bin

binlog_format=mixed

log-bin-index=mysql-bin.index

relay_log_purge=0

relay-log= relay-bin

relay-log-index = slave-relay-bin.index

rpl_semi_sync_master_enabled=1

rpl_semi_sync_master_timeout=10000

rpl_semi_sync_slave_enabled=1

注:relay_log_purge=0,禁止 SQL 线程在执行完一个 relay log 后自动将其删除,对于MHA场景下,对于某些滞后从库的恢复依赖于其他从库的relaylog,因此采取禁用自动删除功能

Slave主机:

Server-id = 3

log-bin =mysql-bin

relay-log= relay-bin

relay-log-index = slave-relay-bin.index

read_only = 1

rpl_semi_sync_slave_enabled=1

查看半同步相关信息

mysql>show variables like ‘%rpl_semi_sync%’;

查看半同步状态:

mysql>show status like ‘%rpl_semi_sync%’;

有几个状态参数值得关注的:

rpl_semi_sync_master_status :显示主服务是异步复制模式还是半同步复制模式

rpl_semi_sync_master_clients :显示有多少个从服务器配置为半同步复制模式

rpl_semi_sync_master_yes_tx :显示从服务器确认成功提交的数量

rpl_semi_sync_master_no_tx :显示从服务器确认不成功提交的数量

rpl_semi_sync_master_tx_avg_wait_time :事务因开启 semi_sync ,平均需要额外等待的时间

rpl_semi_sync_master_net_avg_wait_time :事务进入等待队列后,到网络平均等待时间

master:

第一条grant命令是创建一个用于主从复制的帐号,在master和candicate master的主机上创建即可。

第二条grant命令是创建MHA管理账号,所有mysql服务器上都需要执行。MHA会在配置文件里要求能远程登录到数据库,所以要进行必要的赋权。

Candidate master:

查看从的状态,以下两个值必须为yes,代表从服务器能正常连接主服务器

Slave_IO_Running:Yes

Slave_SQL_Running:Yes

Slave:

查看从的状态,以下两个值必须为yes,代表从服务器能正常连接主服务器

Slave_IO_Running:Yes

Slave_SQL_Running:Yes

查看master服务器的半同步状态:

mysql>show status like ‘%rpl_semi_sync%’;

三、配置mysql-mha

mha包括manager节点和data节点,data节点包括原有的MySQL复制结构中的主机,至少3台,即1主2从,当masterfailover后,还能保证主从结构;只需安装node包。manager server:运行监控脚本,负责monitoring 和 auto-failover;需要安装node包和manager包。

1、在所有主机上安装mha所依赖的软件包(以manager主机为例)

yum -yinstall perl-DBD-MySQL perl-Config-Tiny perl-Log-Dispatchperl-Parallel-ForkManager perl-Config-IniFiles ncftp perl-Params-Validateperl-CPAN perl-Test-Mock-LWP.noarch perl-LWP-Authen-Negotiate.noarch perl-develperl-ExtUtils-CBuilder perl-ExtUtils-MakeMaker安装时报如下错误

解决方法如下,例如:把/etc/yum.repos.d/epel.repo,文件第3行注释去掉,把第四行注释掉。具体如下:

接着又报如下错误

解决方法,例如:执行rm -rf /var/run/yum.pid命令删除yum.pid文件,再次安装

从上图可以看出安装成功

2、以下操作管理节点需要两个都安装, 在3台数据库节点只要安装MHA的node节点:在所有数据库节点上安装mha4mysql-node-0.56.tar.gz(以centos2为例)

其他两个数据节点也安装mha4mysql-node-0.56.tar.gz(过程略)

在管理节点需要两个都安装:mha4mysql-node-0.56.tar.gz和mha4mysql-manager-0.56.tar.gz

安装mha4mysql-node-0.56.tar.gz

安装mha4mysql-manager-0.56.tar.gz(确保manager主机正常连接internet)

根据提示输入。

3、配置mha与绝大多数Linux应用程序类似,MHA的正确使用依赖于合理的配置文件。MHA的配置文件与mysql的my.cnf文件配置相似,采取的是param=value的方式来配置,配置文件位于管理节点,通常包括每一个mysql server的主机名,mysql用户名,密码,工作目录等等。

编辑/etc/masterha/app1.cnf,内容如下:

保存退出

配关配置项的解释:

manager_workdir=/masterha/app1//设置manager的工作目录

manager_log=/masterha/app1/manager.log//设置manager的日志

user=manager//设置监控用户manager

password=123456 //监控用户manager的密码

ssh_user=root //ssh连接用户

repl_user=mharep //主从复制用户

repl_password=123.abc//主从复制用户密码

ping_interval=1 //设置监控主库,发送ping包的时间间隔,默认是3秒,尝试三次没有回应的时候自动进行railover

master_binlog_dir=/usr/local/mysql/data //设置master 保存binlog的位置,以便MHA可以找到master的日志,我这里的也就是mysql的数据目录

candidate_master=1//设置为候选master,如果设置该参数以后,发生主从切换以后将会将此从库提升为主库。

SSH 有效性验证:

集群复制的有效性验证:

mysql必须都启动

masterha_check_repl--global_conf=/etc/masterha/masterha_default.cnf --conf=/etc/masterha/app1.cnf

Sun Mar 5 12:00:45 2017 - [info] Reading default configuration from/etc/masterha/masterha_default.cnf..

Sun Mar 5 12:00:45 2017 - [info] Reading application default configuration from/etc/masterha/app1.cnf..

Sun Mar 5 12:00:45 2017 - [info] Reading server configuration from/etc/masterha/app1.cnf..

Sun Mar 5 12:00:45 2017 - [info] MHA::MasterMonitor version 0.56.

Sun Mar 5 12:00:45 2017 - [info] GTID failover mode = 0

Sun Mar 5 12:00:45 2017 - [info] Dead Servers:

Sun Mar 5 12:00:45 2017 - [info] Alive Servers:

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.176(192.168.133.176:3306)

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.177(192.168.133.177:3306)

Sun Mar 5 12:00:45 2017 - [info] Alive Slaves:

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.176(192.168.133.176:3306) Version=5.5.38-log (oldest major version between slaves) log-bin:enabled

Sun Mar 5 12:00:45 2017 - [info] Replicating from 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] Primary candidate for the new Master (candidate_master is set)

Sun Mar 5 12:00:45 2017 - [info] 192.168.133.177(192.168.133.177:3306) Version=5.5.38-log (oldest major versionbetween slaves) log-bin:enabled

Sun Mar 5 12:00:45 2017 - [info] Replicating from 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] Notcandidate for the new Master (no_master is set)

Sun Mar 5 12:00:45 2017 - [info] Current AliveMaster: 192.168.133.175(192.168.133.175:3306)

Sun Mar 5 12:00:45 2017 - [info] Checking slave configurations..

Sun Mar 5 12:00:45 2017 - [info] read_only=1 is not set on slave 192.168.133.176(192.168.133.176:3306).

Sun Mar 5 12:00:45 2017 - [warning] relay_log_purge=0 is not set on slave192.168.133.176(192.168.133.176:3306).

Sun Mar 5 12:00:45 2017 - [warning] relay_log_purge=0 is not set on slave 192.168.133.177(192.168.133.177:3306).

Sun Mar 5 12:00:45 2017 - [info] Checking replication filtering settings..

Sun Mar 5 12:00:45 2017 - [info] binlog_do_db= , binlog_ignore_db=

Sun Mar 5 12:00:45 2017 - [info] Replication filtering check ok.

Sun Mar 5 12:00:45 2017 - [info] GTID (with auto-pos) is not supported

Sun Mar 5 12:00:45 2017 - [info] Starting SSH connection tests..

Sun Mar 5 12:00:47 2017 - [info] All SSH connection tests passed successfully.

Sun Mar 5 12:00:47 2017 - [info] Checking MHA Node version..

Sun Mar 5 12:00:48 2017 - [info] Versioncheck ok.

Sun Mar 5 12:00:48 2017 - [info] Checking SSH publickey authentication settingson the current master..

Sun Mar 5 12:00:48 2017 - [info] HealthCheck: SSH to 192.168.133.175 is reachable.

Sun Mar 5 12:00:48 2017 - [info] Master MHA Node version is 0.56.

Sun Mar 5 12:00:48 2017 - [info] Checking recovery script configurations on192.168.133.175(192.168.133.175:3306)..

Sun Mar 5 12:00:48 2017 - [info] Executing command: save_binary_logs --command=test --start_pos=4--binlog_dir=/usr/local/mysql/data --output_file=/var/tmp/save_binary_logs_test--manager_version=0.56 --start_file=mysql-bin.000006

Sun Mar 5 12:00:48 2017 - [info] Connecting to root@192.168.133.175(192.168.133.175:22)..

Creating /var/tmp if not exists.. ok.

Checking output directory is accessible or not..

ok.

Binlog found at /usr/local/mysql/data, up to mysql-bin.000006

Sun Mar 5 12:00:49 2017 - [info] Binlog setting check done.

Sun Mar 5 12:00:49 2017 - [info] Checking SSH publickey authentication andchecking recovery script configurations on all alive slave servers..

Sun Mar 5 12:00:49 2017 - [info] Executing command : apply_diff_relay_logs --command=test--slave_user='manager' --slave_host=192.168.133.176 --slave_ip=192.168.133.176--slave_port=3306 --workdir=/var/tmp --target_version=5.5.38-log--manager_version=0.56--relay_log_info=/usr/local/mysql/data/relay-log.info --relay_dir=/usr/local/mysql/data/ --slave_pass=xxx

Sun Mar 5 12:00:49 2017 - [info] Connecting to root@192.168.133.176(192.168.133.176:22)..

Checking slave recovery environment settings..

Opening /usr/local/mysql/data/relay-log.info ... ok.

Relay log found at /usr/local/mysql/data, up to relay-bin.000002

Temporary relay log file is /usr/local/mysql/data/relay-bin.000002

Testing mysql connection and privileges.. done.

Testing mysqlbinlog output.. done.

Cleaning up test file(s).. done.

Sun Mar 5 12:00:49 2017 - [info] Executing command : apply_diff_relay_logs --command=test--slave_user='manager' --slave_host=192.168.133.177 --slave_ip=192.168.133.177--slave_port=3306 --workdir=/var/tmp --target_version=5.5.38-log--manager_version=0.56 --relay_log_info=/usr/local/mysql/data/relay-log.info --relay_dir=/usr/local/mysql/data/ --slave_pass=xxx

Sun Mar 5 12:00:49 2017 - [info] Connecting to root@192.168.133.177(192.168.133.177:22)..

Checking slave recovery environment settings..

Opening /usr/local/mysql/data/relay-log.info ... ok.

Relay log found at /usr/local/mysql/data, up to relay-bin.000002

Temporary relay log file is /usr/local/mysql/data/relay-bin.000002

Testing mysql connection and privileges.. done.

Testing mysqlbinlog output.. done.

Cleaning up test file(s).. done.

Sun Mar 5 12:00:50 2017 - [info] Slaves settings check done.

Sun Mar 5 12:00:50 2017 - [info]

192.168.133.175(192.168.133.175:3306)(current master)

+--192.168.133.176(192.168.133.176:3306)

+--192.168.133.177(192.168.133.177:3306)

Sun Mar 5 12:00:50 2017 - [info] Checking replication health on192.168.133.176..

Sun Mar 5 12:00:50 2017 - [info] ok.

Sun Mar 5 12:00:50 2017 - [info] Checking replication health on192.168.133.177..

Sun Mar 5 12:00:50 2017 - [info] ok.

Sun Mar 5 12:00:50 2017 - [warning] master_ip_failover_script is not defined.

Sun Mar 5 12:00:50 2017 - [warning] shutdown_script is not defined.

Sun Mar 5 12:00:50 2017 - [info] Got exit code 0 (Not master dead).

MySQL ReplicationHealth is OK.

验证成功的话会自动识别出所有服务器和主从状况

注:验证成功的话会自动识别出所有服务器和主从状况

在验证时,若遇到这个错误:Can't exec "mysqlbinlog" ......

解决方法是在所有服务器上执行:

ln -s /usr/local/mysql/bin/* /usr/local/bin/

启动 manager:

注:在应用Unix/Linux时,我们一般想让某个程序在后台运行,于是我们将常会用&在程序结尾来让程序自动运行。比如我们要运行mysql在后台: /usr/local/mysql/bin/mysqld_safe –user=mysql&。可是有很多程序并不想mysqld一样,这样我们就需要nohup命令,

状态检查:

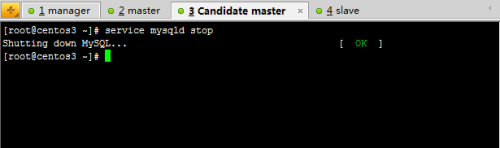

故障转移验证:(自动failover)

master dead后,MHA当时已经开启,候选Master库(Slave)会自动failover为Master.

验证的方式是先停掉 master(centos2),因为之前的配置文件中,把Candicatemaster(centos3)作为了候选人,那么就到 slave(centos4) 上查看 master 的 IP 是否变为了 centos3 的 IP1)停掉 master

2)查看 MHA 日志

上面的配置文件中指定了日志位置为 /masterha/app1/manager.log

从日志信息中可以看到master failover 已经成功了,并可以看出故障转移的大体流程

3)检查 slave2 的复制

登录 slave(192.168.133.177)的Mysql,查看 slave 状态

可以看到master 的 IP 现在为 192.168.133.176,已经切换到和192.168.133.176同步了,本来是和192.168.133.175同步的,说明 MHA 已经把Candidatemaster(centos3)提升为了新的master,IO线程和SQL线程也正确运行,MHA 搭建成功

MHA Manager 端日常主要操作步骤

1)检查是否有下列文件,有则删除。

发生主从切换后,MHAmanager服务会自动停掉,且在manager_workdir(/masterha/app1)目录下面生成文件app1.failover.complete,若要启动MHA,必须先确保无此文件)

2)检查MHA当前置:

# masterha_check_repl --conf=/etc/masterha/app1.cnf

3)启动MHA:

#nohup masterha_manager --conf=/etc/masterha/app1.cnf&>/tmp/mha_manager.log &

当有slave 节点宕掉时,默认是启动不了的,加上 --ignore_fail_on_start即使有节点宕掉也能启动MHA,如下:

#nohup masterha_manager --conf=/etc/masterha/app1.cnf --ignore_fail_on_start&>/tmp/mha_manager.log &

4)停止MHA: masterha_stop --conf=/etc/masterha/app1.cnf

5)检查状态:

# masterha_check_status --conf=/etc/masterha/app1.cnf

6)检查日志:

#tail -f /masterha/app1/manager.log

7)主从切换后续工作

重构:

重构就是你的主挂了,切换到Candicatemaster上,Candicate master变成了主,因此重构的一种方案原主库修复成一个新的slave

主库切换后,把原主库修复成新从库,然后重新执行以上5步。原主库数据文件完整的情况下,可通过以下方式找出最后执行的CHANGE MASTER命令:

启动manager:

注意:如果正常,会显示"PING_OK",否则会显示"NOT_RUNNING",这代表MHA监控没有开启。

定期删除中继日志

在配置主从复制中,slave上设置了参数relay_log_purge=0,所以slave节点需要定期删除中继日志,建议每个slave节点删除中继日志的时间错开。

corntab -e

0 5 * * * /usr/local/bin/purge_relay_logs - -user=root --password=pwd123--port=3306 --disable_relay_log_purge>>/var/log/purge_relay.log 2>&1

四、配置VIP:

vip配置可以采用两种方式,一种通过keepalived的方式管理虚拟ip的浮动;另外一种通过脚本方式启动虚拟ip的方式(即不需要keepalived或者heartbeat类似的软件)。

1、keepalived方式管理虚拟ip,keepalived配置方法如下:

下载软件进行并进行安装(两台master,准确的说一台是master,另外一台是备选master,在没有切换以前是slave)

在centos2和centos3上安装软件包keepalived

安装keepalived软件包与服务控制

在编译安装Keepalived之前,必须先安装内核开发包kernel-devel以及openssl-devel、popt-devel等支持库。

若没有安装则通过rpm或yum工具进行安装

编译安装Keepalived

使用指定的linux内核位置对keepalived进行配置,并将安装路径指定为根目录,这样就无需额外创建链接文件了,配置完成后,依次执行make、make install进行安装。

使用keepalived服务

执行make install操作之后,会自动生成/etc/init.d/keepalived脚本文件,但还需要手动添加为系统服务,这样就可以使用service、chkconfig工具来对keepalived服务程序进行管理了。

Centos2主机也完成keepalived安装,与centos3一样,安装过程略

注:若开启了防火墙,需要关闭防火墙或创建规则。

修改Keepalived的配置文件(在master上配置)

在候选master上配置

启动keepalived服务,在master上启动并查看日志

#/etc/init.d/keepalivedstart ; tail -f/var/log/messages

发现已经将虚拟ip 192.168.1.100绑定了网卡eth0上

查看eth0网卡是否绑定了VIP

在另外一台服务器,候选master上启动keepalived服务,并观察

#/etc/init.d/keepalivedstart ; tail -f/var/log/messages

查看eth0网卡绑定情况

从上面的信息可以看到keepalived已经配置成功

注意:

上面两台服务器的keepalived都设置为了BACKUP模式,在keepalived中2种模式,分别是master->backup模式和backup->backup模式。这两种模式有很大区别。在master->backup模式下,一旦主库宕机,虚拟ip会自动漂移到从库,当主库修复后,keepalived启动后,还会把虚拟ip抢占过来,即使设置了非抢占模式(nopreempt)抢占ip的动作也会发生。在backup->backup模式下,当主库宕机后虚拟ip会自动漂移到从库上,当原主库恢复和keepalived服务启动后,并不会抢占新主的虚拟ip,即使是优先级高于从库的优先级别,也不会发生抢占。为了减少ip漂移次数,通常是把修复好的主库当做新的备库。

2、MHA引入keepalived(MySQL服务进程挂掉时通过MHA 停止keepalived):

要想把keepalived服务引入MHA,我们只需要修改切换时触发的脚本文件master_ip_failover即可,在该脚本中添加在master发生宕机时对keepalived的处理。

编辑脚本/scripts/master_ip_failover,修改后如下。

[root@centos1~]# cat /scripts/master_ip_failover

#!/usr/bin/envperl

usestrict;

usewarnings FATAL => 'all';

useGetopt::Long;

my(

$command, $ssh_user, $orig_master_host, $orig_master_ip,

$orig_master_port, $new_master_host,$new_master_ip, $new_master_port

);

my$vip = '192.168.133.100';

my$ssh_start_vip = "/etc/init.d/keepalived start";

my$ssh_stop_vip = "/etc/init.d/keepalived stop";

GetOptions(

'command=s' => \$command,

'ssh_user=s' => \$ssh_user,

'orig_master_host=s' =>\$orig_master_host,

'orig_master_ip=s' => \$orig_master_ip,

'orig_master_port=i' =>\$orig_master_port,

'new_master_host=s' => \$new_master_host,

'new_master_ip=s' => \$new_master_ip,

'new_master_port=i' => \$new_master_port,

);

exit&main();

submain {

print "\n\nIN SCRIPTTEST====$ssh_stop_vip==$ssh_start_vip===\n\n";

if ( $command eq "stop" ||$command eq "stopssh" ) {

my $exit_code = 1;

eval {

print "Disabling the VIP onold master: $orig_master_host \n";

&stop_vip();

$exit_code = 0;

};

if ($@) {

warn "Got Error: $@\n";

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "start" ) {

my $exit_code = 10;

eval {

print "Enabling the VIP - $vipon the new master - $new_master_host \n";

&start_vip();

$exit_code = 0;

};

if ($@) {

warn $@;

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "status" ) {

print "Checking the Status of thescript.. OK \n";

#`ssh $ssh_user\@cluster1 \"$ssh_start_vip \"`;

exit 0;

}

else {

&usage();

exit 1;

}

}

#A simple system call that enable the VIP on the new master

substart_vip() {

`ssh $ssh_user\@$new_master_host \"$ssh_start_vip \"`;

}

#A simple system call that disable the VIP on the old_master

substop_vip() {

return 0 unless ($ssh_user);

`ssh $ssh_user\@$orig_master_host \"$ssh_stop_vip \"`;

}

subusage {

"Usage: master_ip_failover--command=start|stop|stopssh|status --orig_master_host=host --orig_master_ip=ip--orig_master_port=port --new_master_host=host --new_master_ip=ip--new_master_port=port\n";

}

现在已经修改这个脚本了,接下来我们在/etc/masterha/app1.cnf 中调用故障切换脚本

停止MHA:

#masterha_stop --conf=/etc/masterha/app1.cnf

在配置文件/etc/masterha/app1.cnf 中启用下面的参数(在[server default下面添加])

master_ip_failover_script=/scripts/master_ip_failover

启动MHA:

#nohup masterha_manager --conf=/etc/masterha/app1.cnf &> /tmp/mha_manager.log &

检查状态:

[root@centos1 ~]# masterha_check_status --conf=/etc/masterha/app1.cnf

再检查集群状态,看是否会报错。

可以看见已经没有报错了。

/scripts/master_ip_failover添加或者修改的内容意思是当主库数据库发生故障时,会触发MHA切换,MHA Manager会停掉主库上的keepalived服务,触发虚拟ip漂移到备选从库,从而完成切换。

当然可以在keepalived里面引入脚本,这个脚本监控mysql是否正常运行,如果不正常,则调用该脚本杀掉keepalived进程(参考MySQL 高可用性keepalived+mysql双主)。

测试:

在master上停止mysqld服务

到slave(192.168.133.177)查看slave的状态:

从上图可以看出slave指向了新的master服务器192.168.133.175(在故障切换前指向的是192.168.133.176)

查看VIP绑定:

在192.168.133.176上查看vip绑定

在192.168.133.175上查看vip绑定

从上面的显示结果可以看出vip地址漂移到了192.168.133.175

主从切换后续工作

重构:

重构就是你的主挂了,切换到Candicate master上,Candicate master变成了主,因此重构的一种方案原主库修复成一个新的slave

主库切换后,把原主库修复成新从库,原主库数据文件完整的情况下,可通过以下方式找出最后执行的CHANGE MASTER命令:

将192.168.133.176(原主库)修复成从库

启动keepalived

启动mha manager:

[root@centos1 app1]# rm -fr app1.failover.complete

2、通过脚本实现VIP切换

通过脚本的方式管理VIP。这里是修改/scripts/master_ip_failover,也可以使用其他的语言完成,比如php语言。使用php脚本编写的failover这里就不介绍了。修改完成后内容如下,而且如果使用脚本管理vip的话,需要手动在master服务器上绑定一个vip

[root@centos2 ~]# /sbin/ifconfig eth0:0 192.168.133.100/24

在mha-manager上修改/scripts/master_ip_failover,内容如下

[root@centos1 ~]# cat/scripts/master_ip_failover

#!/usr/bin/env perl

use strict;

use warnings FATAL => 'all';

use Getopt::Long;

my (

$command, $ssh_user, $orig_master_host, $orig_master_ip,

$orig_master_port, $new_master_host, $new_master_ip, $new_master_port

);

my $vip = '192.168.133.100/24';

my $key = '0';

my $ssh_start_vip = "/sbin/ifconfigeth0:$key $vip";

my $ssh_stop_vip = "/sbin/ifconfigeth0:$key down";

GetOptions(

'command=s' =>\$command,

'ssh_user=s' =>\$ssh_user,

'orig_master_host=s' => \$orig_master_host,

'orig_master_ip=s' =>\$orig_master_ip,

'orig_master_port=i' => \$orig_master_port,

'new_master_host=s' =>\$new_master_host,

'new_master_ip=s' =>\$new_master_ip,

'new_master_port=i' =>\$new_master_port,

);

exit &main();

sub main {

print "\n\nIN SCRIPTTEST====$ssh_stop_vip==$ssh_start_vip===\n\n";

if ( $command eq "stop" || $command eq "stopssh" ) {

my $exit_code = 1;

eval {

print "Disabling the VIP onold master: $orig_master_host \n";

&stop_vip();

$exit_code = 0;

};

if ($@) {

warn "Got Error: $@\n";

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "start" ) {

my $exit_code = 10;

eval {

print "Enabling the VIP - $vipon the new master - $new_master_host \n";

&start_vip();

$exit_code = 0;

};

if ($@) {

warn $@;

exit $exit_code;

}

exit $exit_code;

}

elsif ( $command eq "status" ) {

print "Checking the Status of the script.. OK \n";

exit 0;

}

else {

&usage();

exit 1;

}

}

sub start_vip() {

`ssh $ssh_user\@$new_master_host \" $ssh_start_vip \"`;

}

sub stop_vip() {

return 0 unless ($ssh_user);

`ssh $ssh_user\@$orig_master_host \" $ssh_stop_vip \"`;

}

sub usage {

"Usage: master_ip_failover --command=start|stop|stopssh|status--orig_master_host=host --orig_master_ip=ip --orig_master_port=port--new_master_host=host --new_master_ip=ip --new_master_port=port\n";

}

4)停止MHA: masterha_stop --conf=/etc/masterha/app1.cnf

[root@centos1~]# grep "master_ip_failover" /etc/masterha/app1.cnf

master_ip_failover_script=/scripts/master_ip_failover

启动MHA:

[root@centos1~]# nohup masterha_manager --conf=/etc/masterha/app1.cnf & >/tmp/mha_manager.log &

5)检查状态:

再检查集群状态,看是否会报错。

测试:

在master上停掉mysql服务

到slave(192.168.133.177)查看slave的状态:

从上图可以看出slave指向了新的master服务器(192.168.133.176)

查看VIP

从上图可以看到centos2(原来的master)释放了VIP,centos03(新的master)接管了VIP地址

主从切换后续工作

主库切换后,把原主库修复成新从库,相关操作请参考前面相关操作。

为了防止脑裂发生,推荐生产环境采用脚本的方式来管理虚拟ip,而不是使用keepalived来完成。到此为止,基本MHA集群已经配置完毕。

总结:

MHA软件由两部分组成,Manager工具包和Node工具包,具体的说明如下。

Manager工具包主要包括以下几个工具:

masterha_check_ssh检查MHA的SSH配置状况

masterha_check_repl检查MySQL复制状况

masterha_manger启动MHA

masterha_check_status检测当前MHA运行状态

masterha_master_monitor检测master是否宕机

masterha_master_switch控制故障转移(自动或者手动)

masterha_conf_host添加或删除配置的server信息

Node工具包(这些工具通常由MHA Manager的脚本触发,无需人为操作)主要包括以下几个工具:

save_binary_logs保存和复制master的二进制日志

apply_diff_relay_logs识别差异的中继日志事件并将其差异的事件应用于其他的slave

filter_mysqlbinlog去除不必要的ROLLBACK事件(MHA已不再使用这个工具)

purge_relay_logs清除中继日志(不会阻塞SQL线程)

相关文章推荐

- MySQL高可用性大杀器之MHA

- MySQL高可用性大杀器之MHA

- mysql 高可用性工具MHA

- mysql 高可用性工具MHA

- MySQL高可用性大杀器之MHA

- MySQL高可用性大杀器之MHA

- MySQL高可用性大杀器之MHA | 火丁笔记

- [MHA]mysql-master-ha:mysql master高可用性管理工具 (转)

- MySQL高可用性之MHA

- MySQL高可用性大杀器之MHA

- MySQL高可用性大杀器之MHA

- MySQL高可用性大杀器之MHA

- 高可用性、负载均衡的mysql集群解决方案 -- 2

- 高可用性、负载均衡的mysql集群解决方案(data+sql+mgm节点)

- 使用DRBD+Heartbeat+Replication实现MYSQL高可用性 推荐

- MySQL+DRBD+HeartBeat实现高可用性

- drbd+corosync+pacemaker实现mysql服务器的高可用性群集

- 使用MMM搭建Mysql同步高可用性

- 使用MHA做mysql的高可用

- mysql-master-ha:mysql master高可用性管理工具