swish激活函数

2020-07-14 04:42

218 查看

swish激活函数

函数公式

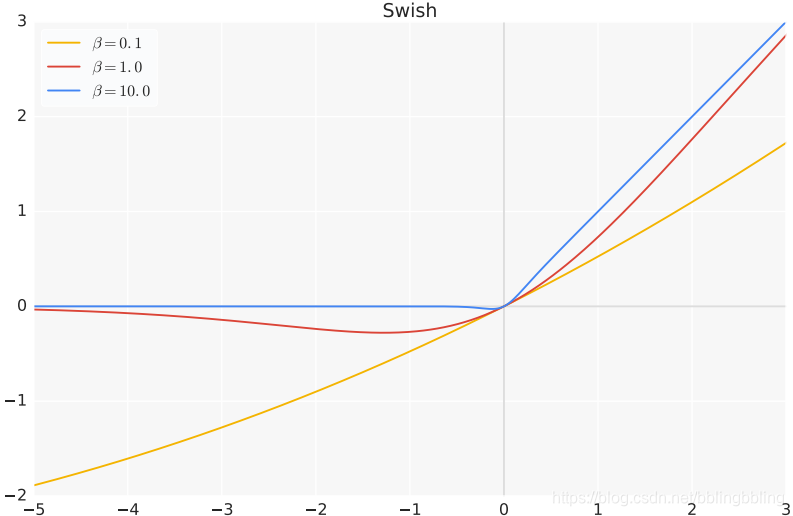

函数图像

当β\betaβ取不同的值时,函数图像如下:

当β\betaβ = 0时,Swish激活函数变为线性函数 f(x) = x2\frac{x}{2}2x,

当β\betaβ = ∞\infty∞ 时,Swish激活函数变为0或x,相当于Relu,

所以,Swish函数可以看作是介于线性函数与ReLU函数之间的平滑函数。

——————————————————————————————————

Swish函数的求导过程为:

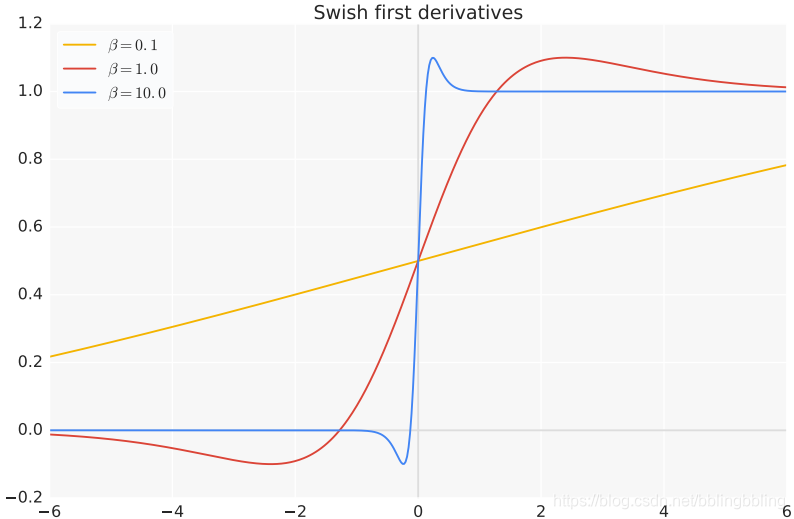

导数图像如下:

函数特点

1.Swish函数和其一阶导数都具有平滑特性;

2.有下界,无上界,非单调。

对比mish激活函数

mish激活函数参考:mish激活函数

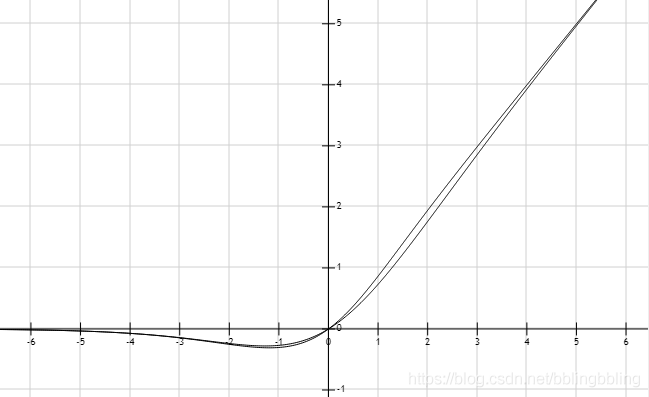

函数图像对比如下:

相关文章推荐

- 自门控激活函数Swish

- 谷歌大脑自门控激活函数Swish

- 激活函数(ReLU, Swish, Maxout)

- 最全面:python绘制Sigmoid、Tanh、Swish、ELU、SELU、ReLU、ReLU6、Leaky ReLU、Mish、hard-Sigmoid、hard-Swish等激活函数(有源码)

- 谷歌大脑的 Swish 激活函数与 ReLU 激活函数对比

- 深度学习—激活函数详解(Sigmoid、tanh、ReLU、ReLU6及变体P-R-Leaky、ELU、SELU、Swish、Mish、Maxout、hard-sigmoid、hard-swish)

- Google提出的新型激活函数:Swish

- Google提出的新型激活函数:Swish

- 谷歌大脑提出新型激活函数Swish惹争议:可直接替换并优于ReLU?(附机器之心测试)

- 【Swish激活函数】

- 谷歌大脑的 Swish 激活函数与 ReLU 激活函数对比

- 常用激活函数(激励函数)理解与总结

- cs231n学习笔记-激活函数-BN-参数优化

- 几种常见的激活函数

- Tensorflow 激活函数 activation function

- 神经网络激活函数总结

- 激活函数

- 几种常见的激活函数

- 几种常见的激活函数

- ReLu(Rectified Linear Units)激活函数