LTP 4.0!单模型完成6项自然语言处理任务 - 知乎

2020-06-16 11:03

239 查看

钉钉、微博极速扩容黑科技,点击观看阿里云弹性计算年度发布会!>>>

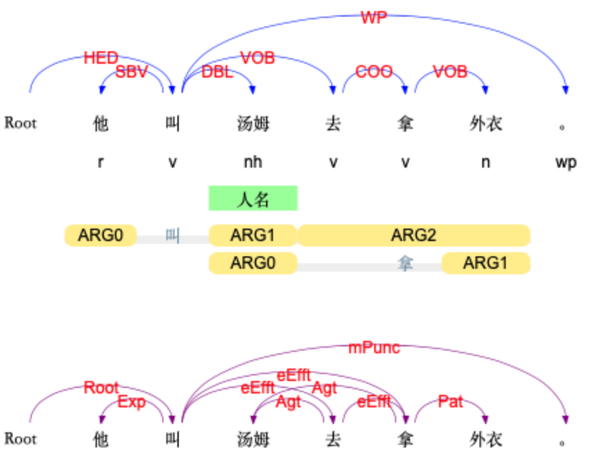

语言技术平台(Language Technology Platform, LTP)是哈工大社会计算与信息检索研究中心(HIT-SCIR)历时多年研发的一整套高效、高精度的中文自然语言处理开源基础技术平台。该平台集词法分析(分词、词性标注、命名实体识别)、句法分析(依存句法分析)和语义分析(语义角色标注、语义依存分析)等多项自然语言处理技术于一体。其中句法分析、语义分析等多项关键技术多次在CoNLL国际评测中获得了第1名。此外,平台还荣获了2010年中国中文信息学会科学技术一等奖、2016年黑龙江省科技进步一等奖。国内外众多研究单位和知名企业通过签署协议以及收费授权的方式使用该平台。

哈工大SCIR本科生冯云龙等同学在车万翔教授指导下,于近日对LTP进行了新一轮的全面升级,并推出了LTP 4.0版本。此次升级的主要改进为:

- 基于多任务学习框架进行统一学习,使得全部六项任务可以共享语义信息,达到了知识迁移的效果。既有效提升了系统的运行效率,又极大缩小了模型的占用空间

- 基于预训练模型进行统一的表示 ,有效提升了各项任务的准确率

- 基于教师退火模型蒸馏出单一的多任务模型,进一步提高了系统的准确率

- 基于PyTorch框架开发,提供了原生的Python调用接口,通过pip包管理系统一键安装,极大提高了系统的易用性

下表列出了新旧版LTP在精度、效率和模型大小方面的对比:

为了模型的小巧易用,本次发布的版本基于 哈工大讯飞联合实验室发布的 中文ELECTRA Small预训练模型。后续将陆续发布基于不同预训练模型的版本,从而为用户提供更多准确率和效率平衡点的选择。

测试环境如下:

- Python 3.7

- LTP 4.0 Batch Size = 1

- CentOS 3.10.0-1062.9.1.el7.x86_64

- Intel(R) Xeon(R) CPU E5-2640 v4 @ 2.40GHz

备注:速度数据在人民日报命名实体测试数据上获得,速度计算方式均为所有任务顺序执行的结果。另外,语义角色标注与语义依存新旧版采用的语料不相同,因此无法直接比较(新版语义依存使用SemEval 2016语料,语义角色标注使用CTB语料)。

欢迎访问http://ltp.ai/

http://ltp.ai/ ltp.ai获取平台的源代码、模型及更详细的介绍信息,敬请提出反馈意见。

本期责任编辑:张伟男

本期编辑:赖勇魁

相关文章推荐

- 论文阅读:Deep Neural Networks with Multitask Learning(多任务模型应w用到自然语言处理)

- caffe初步实践---------使用训练好的模型完成语义分割任务

- 自然语言处理(NLP)的发展历程,神经语言模型多任务学习介绍, ECM模型介绍等

- caffe初步实践---------使用训练好的模型完成语义分割任务

- caffe初步实践---------使用训练好的模型完成语义分割任务(使用vocfcn32)

- 复现《Bilateral Multi-Perspective Matching for Natural Language Sentences》中的模型完成问答任务

- 批处理脚本配合windows计划任务自动完成日构建

- 完成端口模型

- 第九周C++任务四。建立一个二维数组类Douary,完成矩阵的输入、输出、加、减、相等判断等操作

- [转]在计算机程序中,完成重复的任务有两种方式:递归和迭代(循环)。

- 如何让thinkphp在模型中自动完成session赋值小教程

- 斯坦福大学自然语言处理第四课“语言模型(Language Modeling)

- SOCKET编程进阶之Overlapped IO完成例程模型

- Activiti学习入门(5) -- 学习完成指定的任务

- Django中使用celery完成异步任务

- iphone OS 4.0操作系统中多任务~禁止后台执行的方法

- 语言模型预训练方法(ELMo、GPT和BERT)——自然语言处理(NLP)

- [原创]另类调用 printf 完成任务的方法

- Socket I/O模型之重叠I/O(overlapped I/O)--完成例程方式

- 今天好像无法完成任务了啊