【吴恩达深度学习专栏】浅层神经网络(Shallow neural networks)——为什么需要非线性激活函数?(why need a nonlinear activation function?)

2020-03-25 18:31

555 查看

文章目录

3.7 为什么需要非线性激活函数?(why need a nonlinear activation function?)

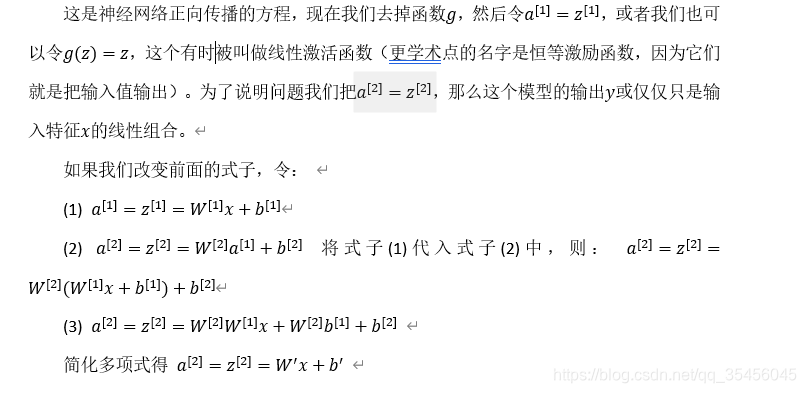

为什么神经网络需要非线性激活函数?事实证明:要让你的神经网络能够计算出有趣的函数,你必须使用非线性激活函数,证明如下:

如果你是用线性激活函数或者叫恒等激励函数,那么神经网络只是把输入线性组合再输出。

我们稍后会谈到深度网络,有很多层的神经网络,很多隐藏层。事实证明,如果你使用线性激活函数或者没有使用一个激活函数,那么无论你的神经网络有多少层一直在做的只是计算线性函数,所以不如直接去掉全部隐藏层。在我们的简明案例中,事实证明如果你在隐藏层用线性激活函数,在输出层用sigmoid函数,那么这个模型的复杂度和没有任何隐藏层的标准Logistic回归是一样的,如果你愿意的话,可以证明一下。

总而言之,不能在隐藏层用线性激活函数,可以用ReLU或者tanh或者leaky ReLU或者其他的非线性激活函数,唯一可以用线性激活函数的通常就是输出层;除了这种情况,会在隐层用线性函数的,除了一些特殊情况,比如与压缩有关的,那方面在这里将不深入讨论。在这之外,在隐层使用线性激活函数非常少见。因为房价都是非负数,所以我们也可以在输出层使用ReLU函数这样你的^y都大于等于0。

理解为什么使用非线性激活函数对于神经网络十分关键,接下来我们讨论梯度下降,并在下一个视频中开始讨论梯度下降的基础——激活函数的导数。

- 点赞

- 收藏

- 分享

- 文章举报

汪雯琦

发布了854 篇原创文章 · 获赞 1192 · 访问量 15万+

私信

关注

汪雯琦

发布了854 篇原创文章 · 获赞 1192 · 访问量 15万+

私信

关注

相关文章推荐

- 【吴恩达深度学习专栏】浅层神经网络(Shallow neural networks)——激活函数的导数(Derivatives of activation functions)

- 【吴恩达深度学习专栏】浅层神经网络(Shallow neural networks)——直观理解反向传播(Backpropagation intuition)

- 【吴恩达深度学习专栏】浅层神经网络(Shallow neural networks)——神经网络的梯度下降(Gradient descent for neural networks)

- 机器学习-神经网络之激活函数(Activation Function)

- 深度神经网络及TensorFlow实现1-激活函数(Activation Function)

- 浅谈深度学习中的激活函数 - The Activation Function in Deep Learning

- daidingdaiding——ML之Activation function:机器学习、深度学习中常用的激活函数配图、代码集合

- 神经网络之激活函数(Activation Function)

- AndrewNg神经网络和深度学习笔记-Week3-6激活函数

- 浅谈深度学习中的激活函数 - The Activation Function in Deep Learning

- 神经网络与深度学习之激活函数

- 深度学习笔记之神经网络、激活函数、目标函数和深度的初步认识

- 吴恩达深度学习笔记(19)-非线性激活函数的作用

- The Activation Function in Deep Learning 浅谈深度学习中的激活函数

- Coursera deeplearning.ai 深度学习笔记1-3-Shallow Neural Networks-浅层神经网络原理推导与代码实现

- 深度学习中的数学与技巧(13):神经网络之激活函数

- 浅谈深度学习中的激活函数 - The Activation Function in Deep Learning

- 神经网络之激活函数(Activation Function)

- 神经网络之激活函数(Activation Function)

- 神经网络之激活函数(activation function)