[贝叶斯八]之极大似然估计

2018-02-08 22:01

387 查看

一、简单介绍

极大似然估计是根据观察数据来估计模型参数的方法,即“模型已定,模型未知”。它是参数估计的一种方法,请参考《概率论与数理统计(浙大第四版)》中参数估计。举个例子,大家都知道抛硬币的实验: 假设有一枚不规则的硬币,要计算它正面朝上的概率。其实就是估计一个二分布的参数。现在我们开始做实验,抛了10次,得到相应的结果。那么如何根据这些结果来估计我们的参数呢?这就是极大似然估计要处理的一个场景。

二、理论推导

我们假设[x1,x2,x3,x4,.......,xn][x1,x2,x3,x4,.......,xn]是独立同分布的采样,θθ是模型参数。因为采样是独立的,所以该采样出现的概率可以用如下连乘表示。L(θ)=L(x1,x2,......,xn;θ)=∏i=1n p(xi;θ),θ∈Θ.(1)(2)(1)L(θ)=L(x1,x2,......,xn;θ)(2)=∏i=1n p(xi;θ),θ∈Θ.

这一概率随着θθ取值而变化,它是θθ的函数,L(θ)L(θ)称为样本的似然函数(注意,这里[x1,x2,x3,x4……xn][x1,x2,x3,x4……xn]是已知的样本值,他们都是常数)。显然,这个事件已经发生了,那么按照人类的常理来说,我们认为概率越大的事件越可能发生,也就是我们可以认为θθ参数肯定是在L(θ)L(θ)最大的时候取得的。由此,我们的问题变成了如何来最大化L(θ)L(θ)。这也就是极大似然估计的想法。

对于计算来说连乘不太好算,所以一般取对数。

LL(θ)=log ∏i=1n p(xi;θ)=∑i=1n log p(xi;θ)(3)(4)(3)LL(θ)=log ∏i=1n p(xi;θ)(4)=∑i=1n log p(xi;θ)

最终我们要求的 θ^ θ^ 可以写成如下式子。

θ^ =argmaxθ LL(θ)(5)(5)θ^ =argmaxθ LL(θ)

三、例题

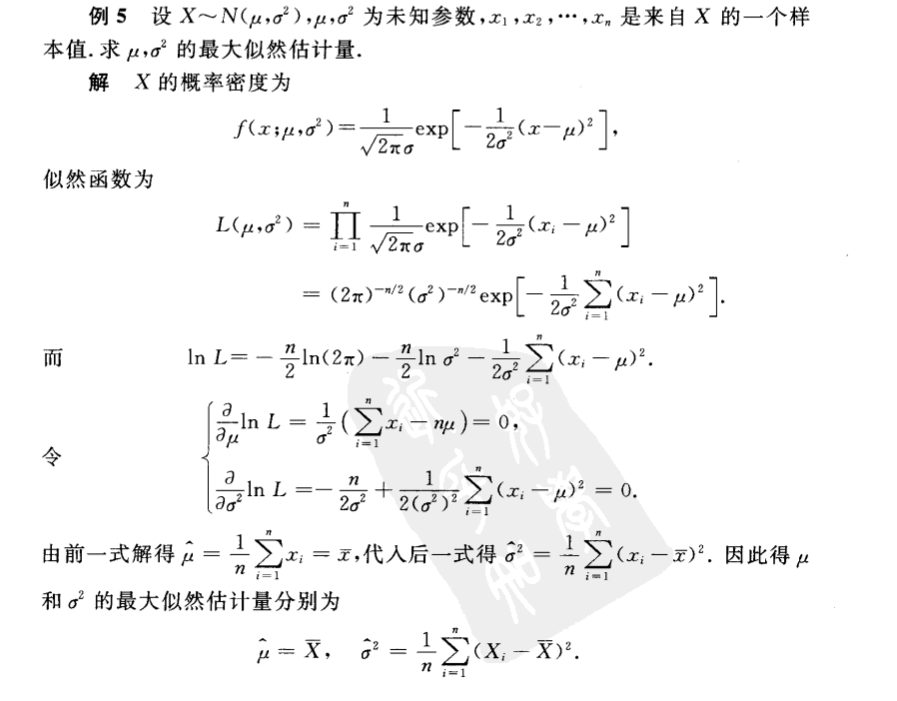

例题均来自于概率论浙大第4版(在此再次表示感谢~)。例题1:

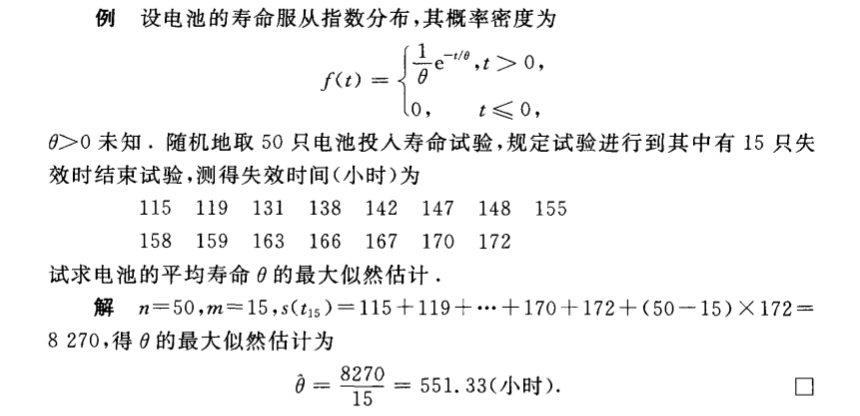

例题2:

四、参考文献

[1] 《概率论与数理统计(浙大第4版)》[2] 周志华. 《机器学习》[M]. 清华大学出版社, 2016.

[3] http://jermmy.xyz/2017/09/30/2017-9-30-maximum-likelihood-estimation/

<个人网页blog已经上线,一大波干货即将来袭:https://faiculty.com/>

/* 版权声明:公开学习资源,只供线上学习,不可转载,如需转载请联系本人 .*/

相关文章推荐

- 统计学习方法学习笔记(一)--极大似然估计与贝叶斯估计原理及区别

- 极大似然估计和贝叶斯估计

- 极大似然估计与贝叶斯估计

- 参数估计(极大似然估计,极大后验概率估计,贝叶斯估计)

- 极大似然估计与贝叶斯估计

- 极大似然估计与贝叶斯估计

- 极大似然估计和贝叶斯估计

- 极大似然估计 极大后验估计 贝叶斯估计 最小二乘法

- 极大似然估计与贝叶斯估计

- 机器学习2-极大似然估计与贝叶斯估计

- 极大似然估计

- Maximum Likelihood Estimation极大似然估计

- 极大似然估计的直观解释-转

- Maximum Likelihood Method极大似然估计的朴素理解

- 贝叶斯估计

- 贝叶斯估计 极大似然

- 极大似然估计

- 人工智能里的数学修炼 | 模型参数求解:极大似然估计

- 极大似然估计

- 极大似然估计的直观解释