机器学习_线性回归和逻辑回归(及python)

2017-12-14 10:29

411 查看

【1】线性回归和逻辑回归是用着同样的回归思想。但是注意两种在几何意义中完全不同。

【2】线性回归设函数为:y=wx

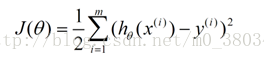

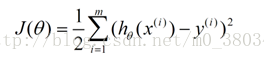

线性回归的损失函数:

几何意义:要求点到之间的距离越小越好,要求点越接近于直线。

【2.5】其实分类问题也可以用线性回归,但是在线性回归分类问题中,对噪声很铭感且无法找到一个合理的阈值。所以我们想找一个相对值,用概率来回归。

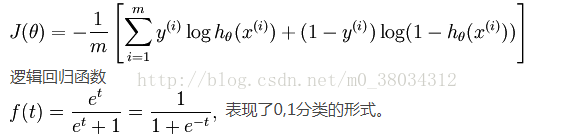

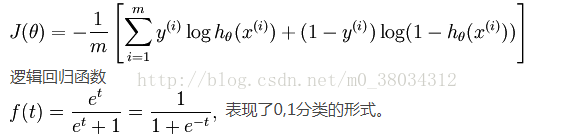

【3】逻辑回归的损失函数本与线性回归相同,但是因为不是凸函数。所以写成了下面的形式:

其中y的取值为{0、1},当y为1时,要求h(x)尽可能接近于1,-log(h(x))才会尽可能的小。

h(x)为逻辑回归函数。本质为h(g(x)),h(x)接近于1在几何上体现为,g(x)接近于无穷。

即几何意义为:样本点 x 要离g(x)这条线尽可能的远。

几何意义为:区分类的线。(注意和线性回归不同,线性回归的y值是占用一维的。而逻辑回归的y只体现在圈圈查查,在几何上本身并不在一维度)

【3】逻辑回归python代码博客:http://blog.csdn.net/cherdw/article/details/54891073 参数/正则化等

http://lib.csdn.net/article/machinelearning/37592

【2】线性回归设函数为:y=wx

线性回归的损失函数:

几何意义:要求点到之间的距离越小越好,要求点越接近于直线。

【2.5】其实分类问题也可以用线性回归,但是在线性回归分类问题中,对噪声很铭感且无法找到一个合理的阈值。所以我们想找一个相对值,用概率来回归。

【3】逻辑回归的损失函数本与线性回归相同,但是因为不是凸函数。所以写成了下面的形式:

其中y的取值为{0、1},当y为1时,要求h(x)尽可能接近于1,-log(h(x))才会尽可能的小。

h(x)为逻辑回归函数。本质为h(g(x)),h(x)接近于1在几何上体现为,g(x)接近于无穷。

即几何意义为:样本点 x 要离g(x)这条线尽可能的远。

几何意义为:区分类的线。(注意和线性回归不同,线性回归的y值是占用一维的。而逻辑回归的y只体现在圈圈查查,在几何上本身并不在一维度)

【3】逻辑回归python代码博客:http://blog.csdn.net/cherdw/article/details/54891073 参数/正则化等

http://lib.csdn.net/article/machinelearning/37592

相关文章推荐

- 机器学习——Python实现逻辑回归

- Python实现机器学习一(实现一元线性回归)

- 用Python开始机器学习(3:数据拟合与广义线性回归)

- 机器学习实战——线性回归和局部加权线性回归(含python中复制的四种情形!)

- Python学习(机器学习_线性回归)

- Python学习(机器学习_多变量线性回归)

- 机器学习线性回归(linear regression)/梯度下降法(gradient descent)/最大似然函数/--附python代码

- 机器学习经典算法详解及Python实现--线性回归(Linear Regression)算法

- python机器学习库sklearn——线性回归

- python机器学习——线性回归

- Python机器学习及实践——简介篇3(逻辑回归)

- PYTHON机器学习实战——线性回归 Linear Regression

- PYTHON机器学习实战——逻辑回归

- 机器学习经典算法具体解释及Python实现--线性回归(Linear Regression)算法

- 用Python开始机器学习(3:数据拟合与广义线性回归)

- 【机器学习实战-python3】线性回归

- 用Python开始机器学习(3:数据拟合与广义线性回归)

- python机器学习案例系列教程——逻辑分类/逻辑回归LR/一般线性回归(softmax回归)

- 机器学习(一)——线性回归、分类与逻辑回归

- Python数据分析与机器学习-Python实现逻辑回归与梯度下降策略