搭建基于mesos的spark集群

2017-02-07 17:10

351 查看

1、准备

1)、安装scala(略)

2)、安装mesos,参见《mesos 1.1.0集群搭建》

2、安装

3、启动

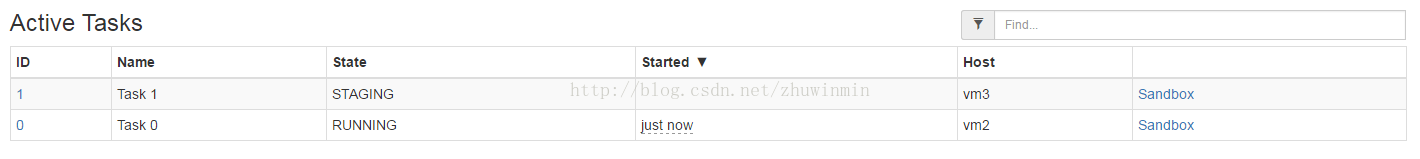

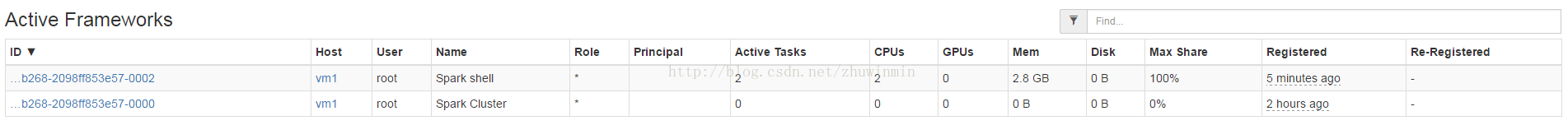

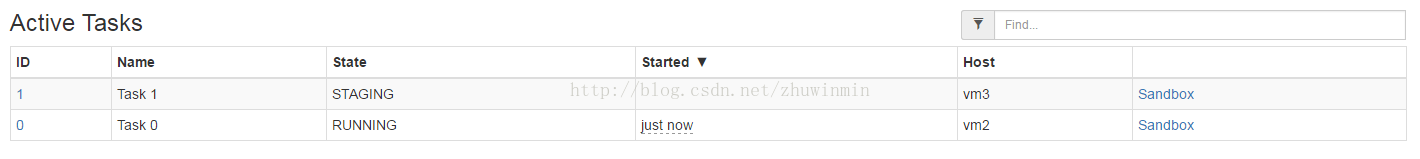

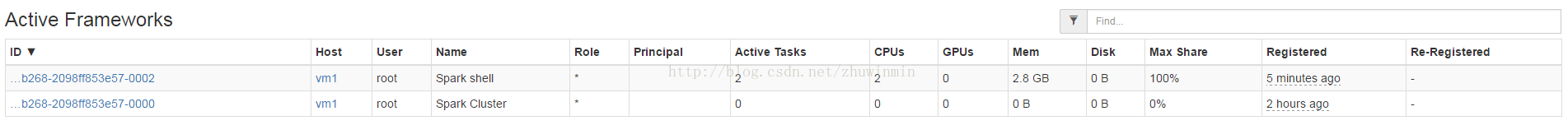

可以看到在tasks、frameworks、agents中分配到资源了(动态分配的,如果是在排队中,则没有分配到资源)。

1)、安装scala(略)

2)、安装mesos,参见《mesos 1.1.0集群搭建》

2、安装

# mkdir /usr/local/spark # cd /usr/local/spark # wget http://d3kbcqa49mib13.cloudfront.net/spark-2.0.1-bin-hadoop2.7.tgz # tar -zxvf spark-2.0.1-bin-hadoop2.7.tgz # cd /usr/local/spark/spark-2.0.1-bin-hadoop2.7/conf # cat spark-defaults.conf.template > spark-defaults.conf # vim spark-defaults.conf spark.io.compression.codec lzf # cat spark-env.sh.template > spark-env.sh # vim spark-env.sh export MESOS_NATIVE_JAVA_LIBRARY=/usr/local/mesos/mesos/lib/libmesos.so export SPARK_EXECUTOR_URI=/usr/local/spark/spark.tar.gz #export SPARK_EXECUTOR_URI=hdfs://spark.tar.gzSPARK_EXECUTOR_URI 最好用分布式文件系统hdfs

3、启动

# cd cd /usr/local/spark/spark-2.0.1-bin-hadoop2.7/sbin # ./start-mesos-dispatcher.sh --master mesos://192.168.30.97:50504、冒烟

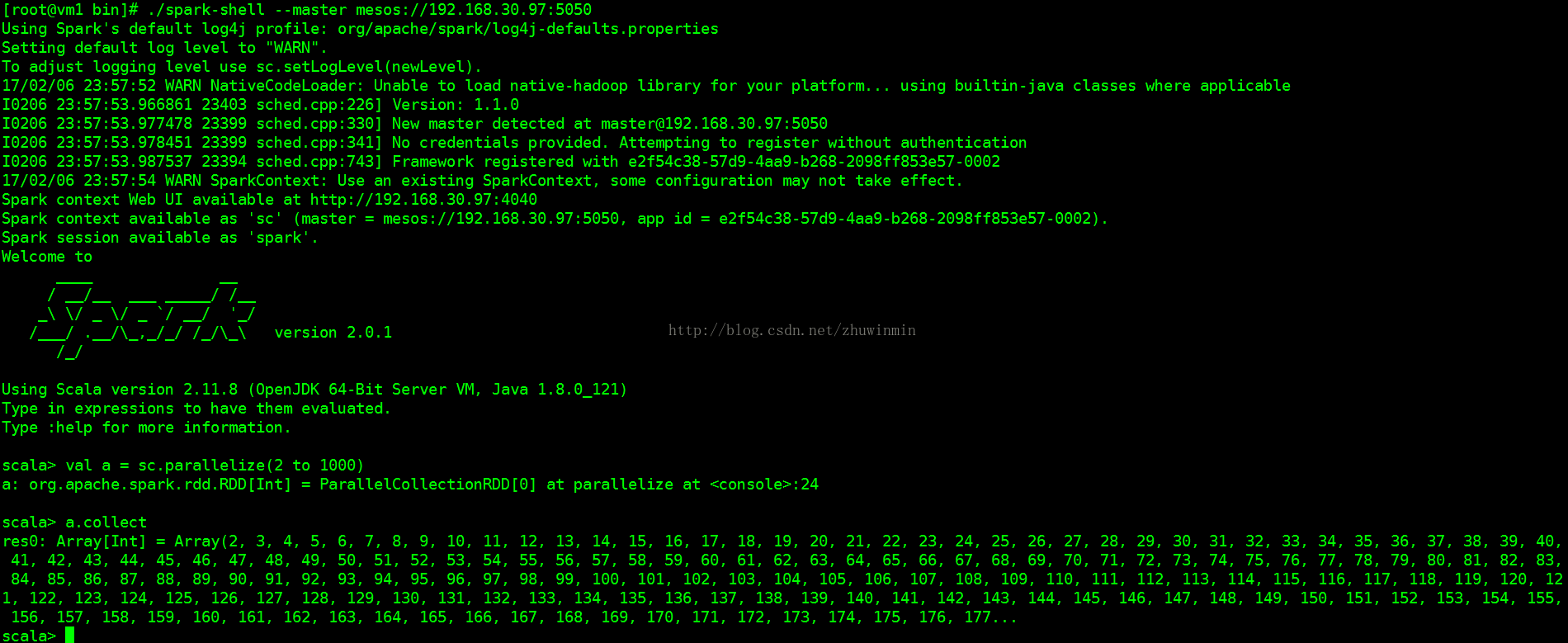

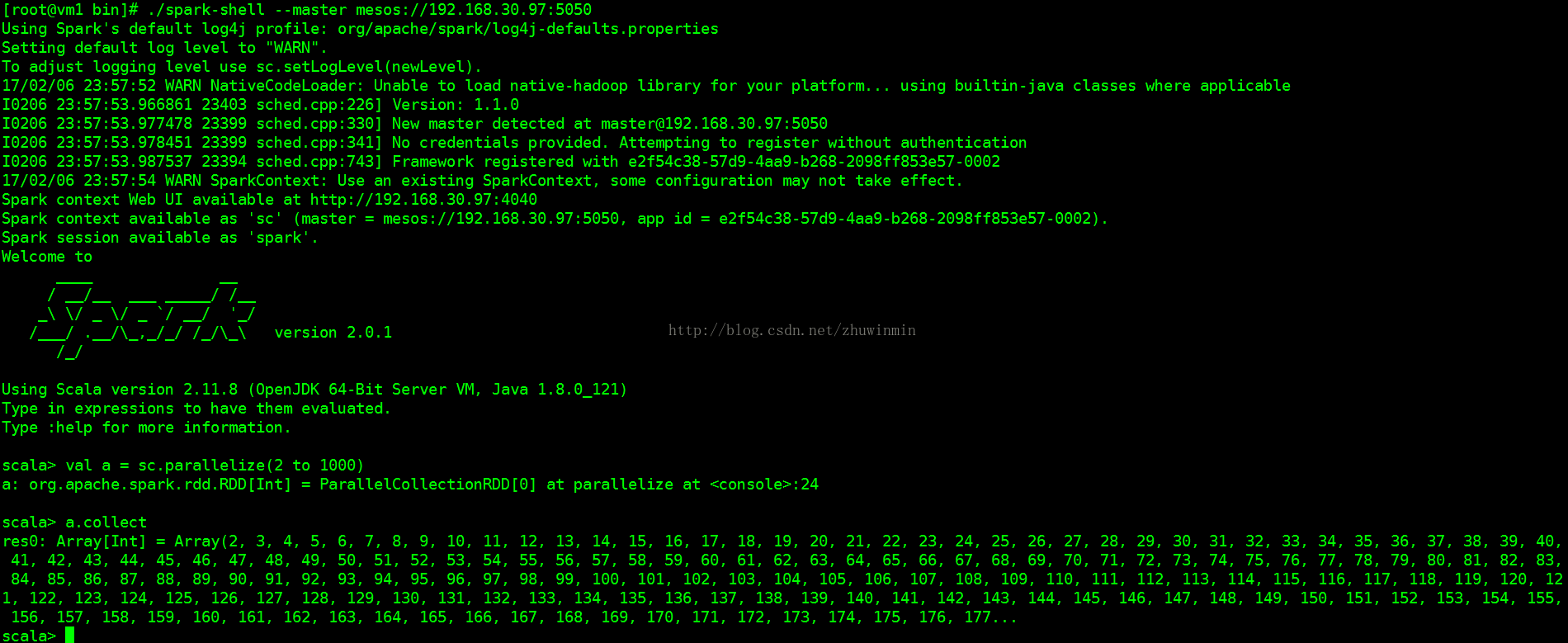

#cd /usr/local/spark/spark-2.0.1-bin-hadoop2.7/bin #./spark-shell --master mesos://192.168.30.97:5050 scala> val a = sc.parallelize(2 to 1000) scala> a.collect

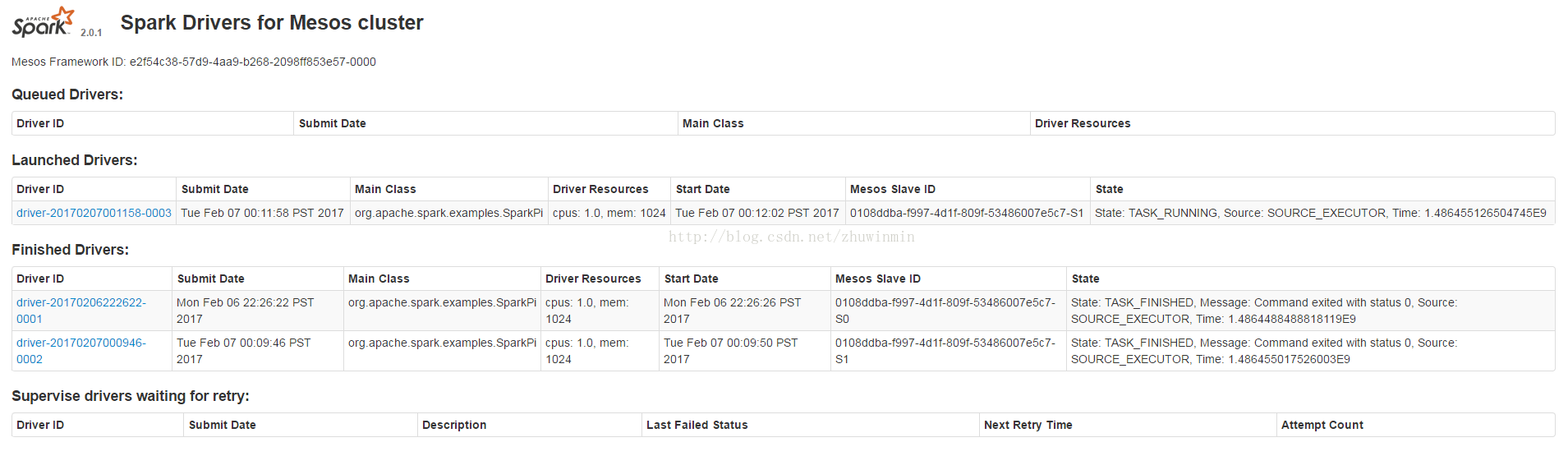

可以看到在tasks、frameworks、agents中分配到资源了(动态分配的,如果是在排队中,则没有分配到资源)。

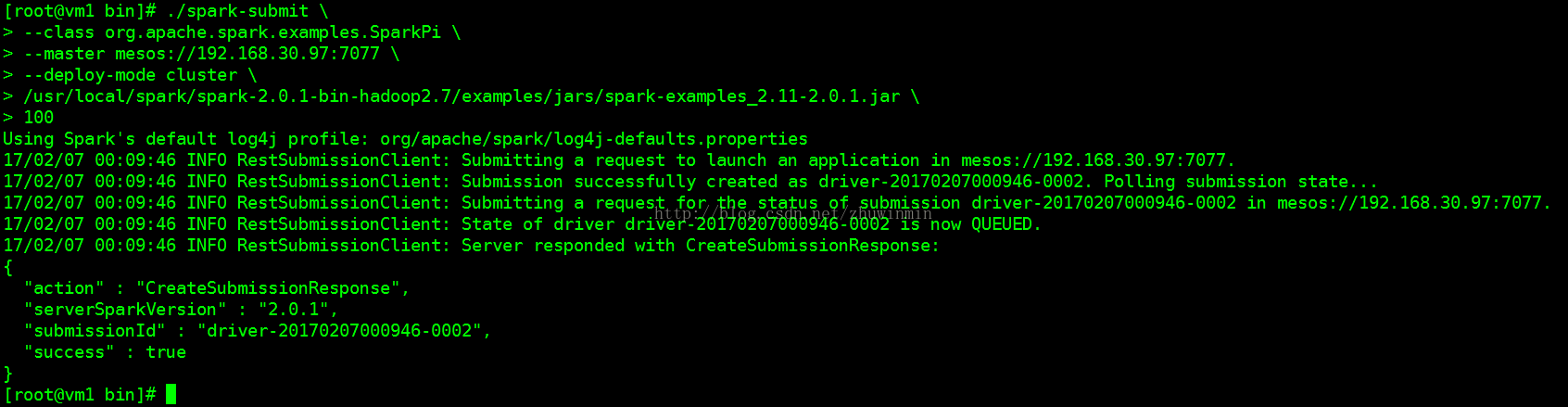

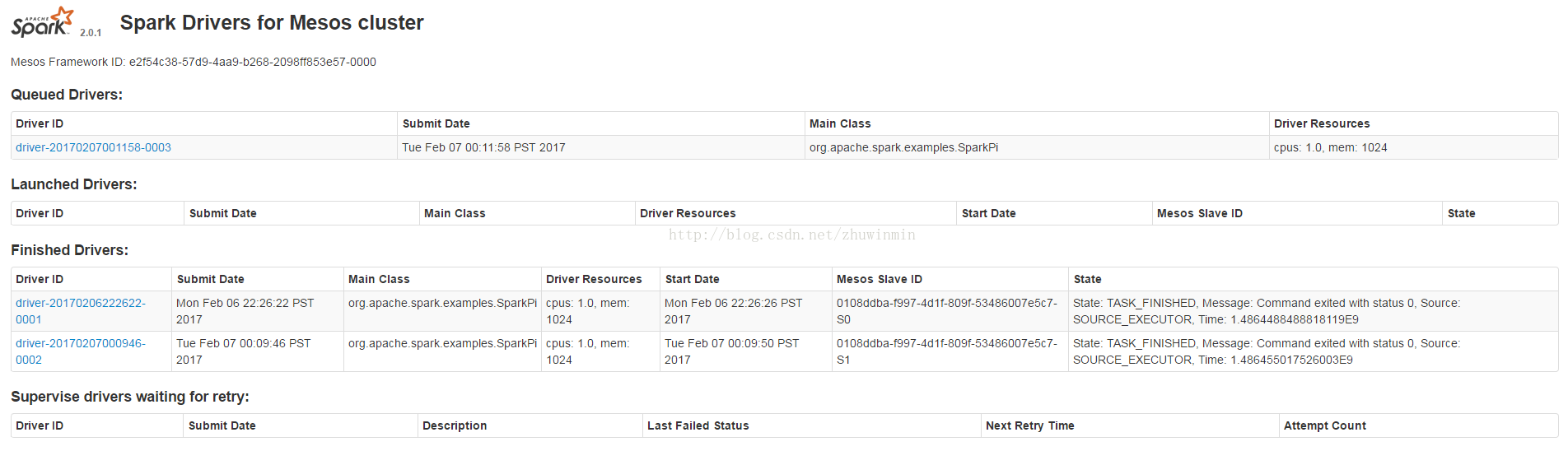

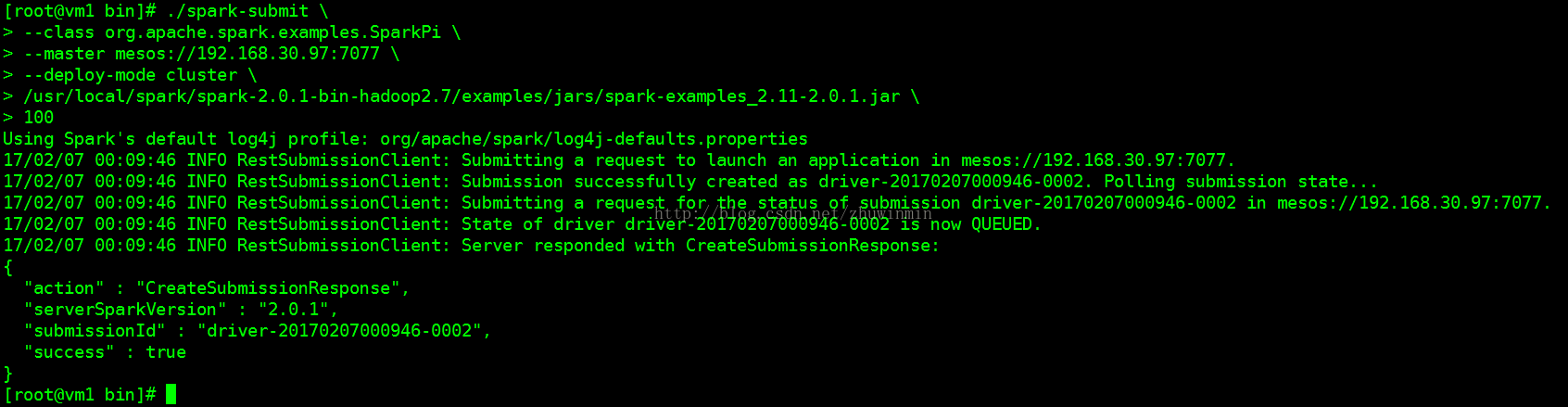

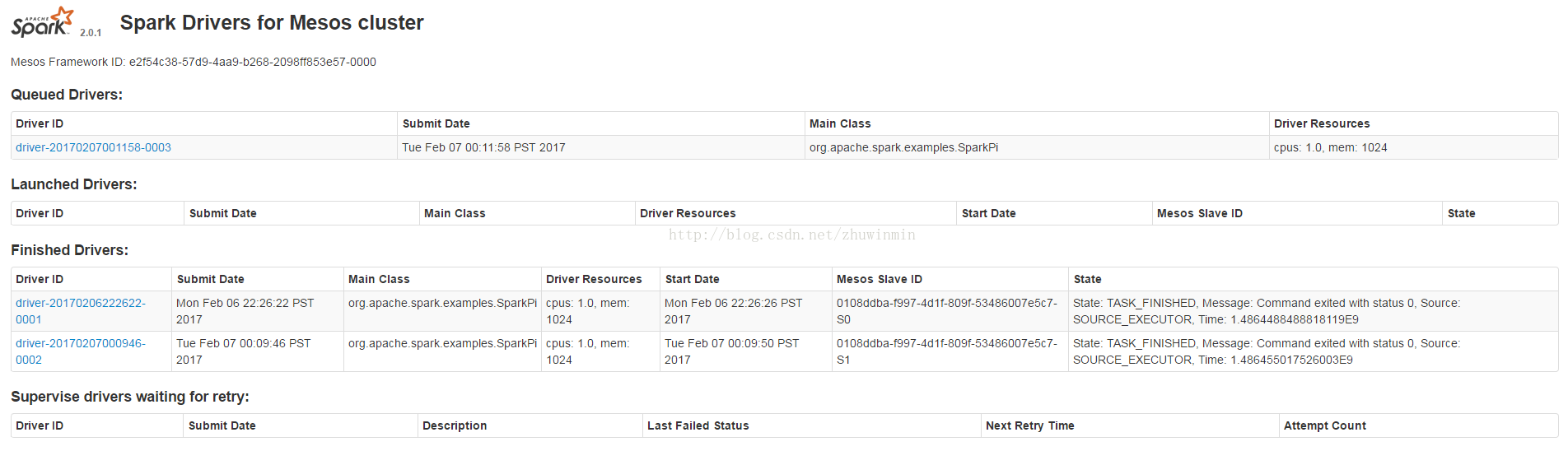

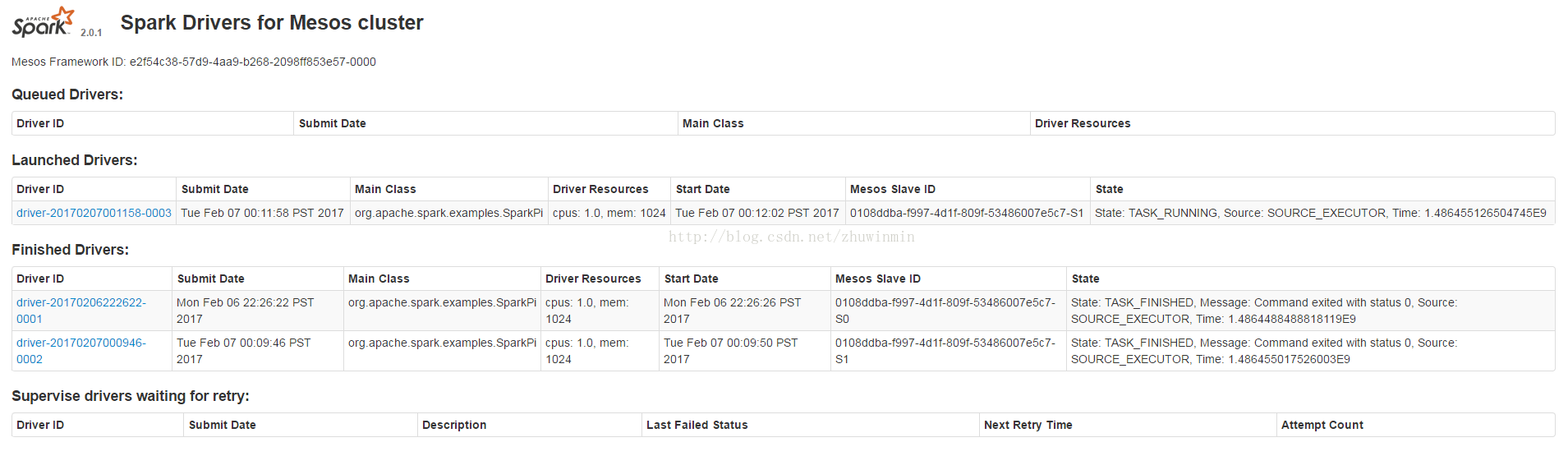

#./spark-submit \ --class org.apache.spark.examples.SparkPi \ --master mesos://192.168.30.97:7077 \ --deploy-mode cluster \ /usr/local/spark/spark-2.0.1-bin-hadoop2.7/examples/jars/spark-examples_2.11-2.0.1.jar \ 100

相关文章推荐

- 7.基于yarn的Spark集群搭建

- Spark HA 集群搭建【1、基于文件系统的手动HA 2、基于zk的自动HA】

- 基于docker搭建跨主机的spark集群并配置notebook(二)

- 使用VMware进行基于Ubuntu16.04LTS的Spark集群搭建

- Spark集群基于Zookeeper的HA搭建部署笔记(转)

- spark学习1--centOS7.2下基于hadoop2.7.3的spark2.0集群环境搭建

- [置顶] CentOS7 基于Hadoop2.7 的Spark2.0集群搭建

- spark2.0.2基于hadoop2.4搭建分布式集群

- Spark集群基于Zookeeper的HA搭建部署

- Spark集群基于Zookeeper的HA搭建部署

- 基于树莓派的Spark集群搭建

- 基于mesos集群中spark是如何提交任务的

- Spark集群基于Zookeeper的HA搭建部署

- 从0开始搭建基于Zookeeper的Spark集群

- CentOS7 基于Hadoop2.7 的Spark2.0集群搭建

- Spark集群基于Zookeeper的HA搭建部署笔记

- 基于docker的spark-hadoop分布式集群之一: 环境搭建

- 基于Vmware Workstation上的hadoop集群搭建Spark集群

- 基于docker搭建跨主机的spark集群并配置notebook(一)

- CentOS7 基于Hadoop2.7 的Spark2.0集群搭建