Ubuntu16.04 下 Spark2.0.2+Hadoop2.7.3+Zookeeper3.4.9+HBase1.1.7集群环境搭建--3

2016-12-08 00:00

916 查看

接着上篇:https://my.oschina.net/u/988386/blog/802045

接着上篇:https://my.oschina.net/u/988386/blog/802052

上篇安装完成了hadoop、zookeeper,下面安装hbase。

安装hbase(2台机器配置基本相同)

配置hbase-env.sh

export JAVA_HOME=/usr/lib/jvm/java #注意路径

export HBASE_LOG_DIR=/usr/local/hbase/logs

export HBASE_MANAGES_ZK=false

配置regionservers

删除原来内容,添加2行如下:

配置hbase-site.xml

启动停止

/usr/local/hbase/bin/start-hbase.sh /usr/local/hbase/bin/stop-hbase.sh

检查安装情况:

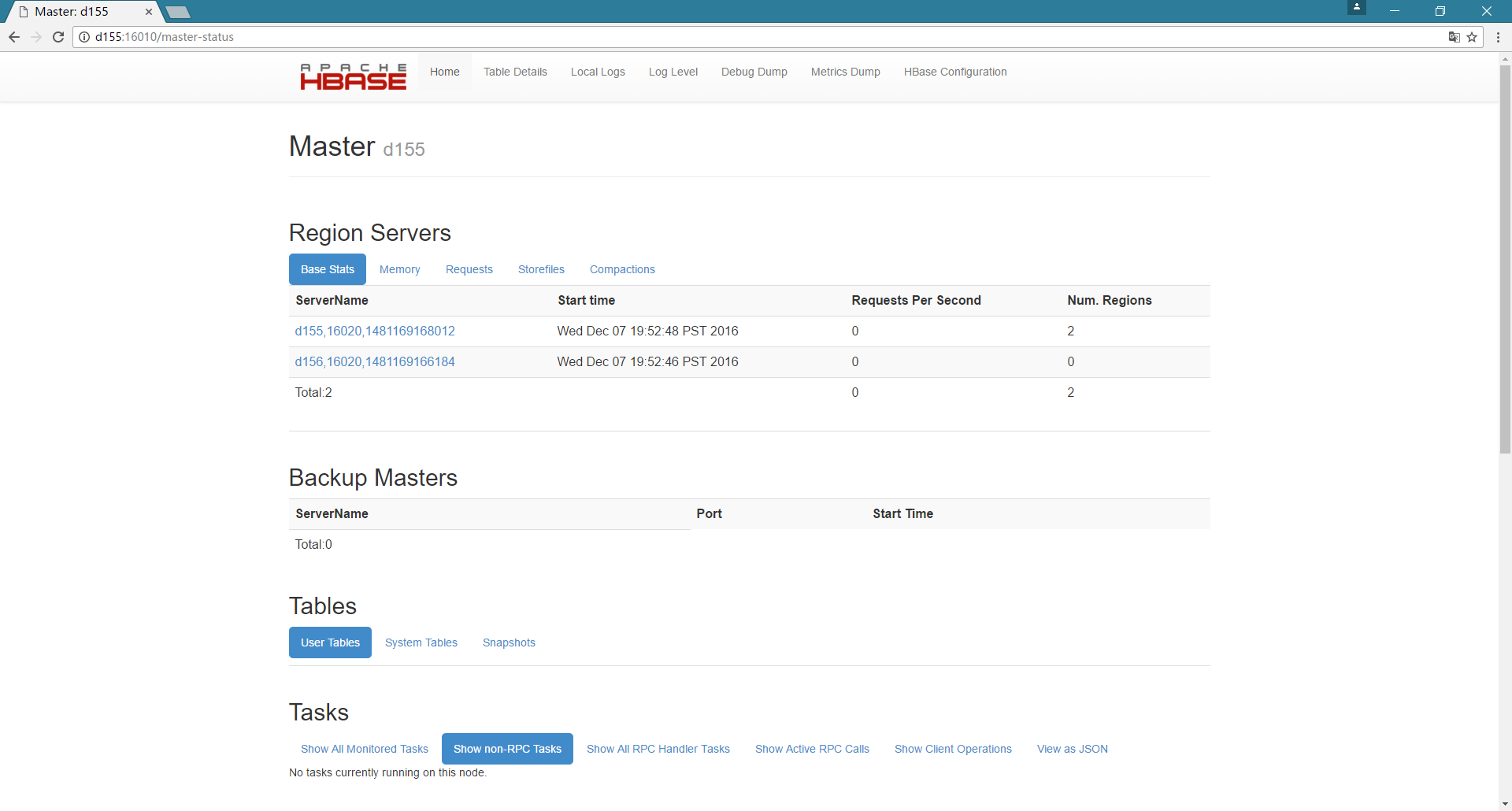

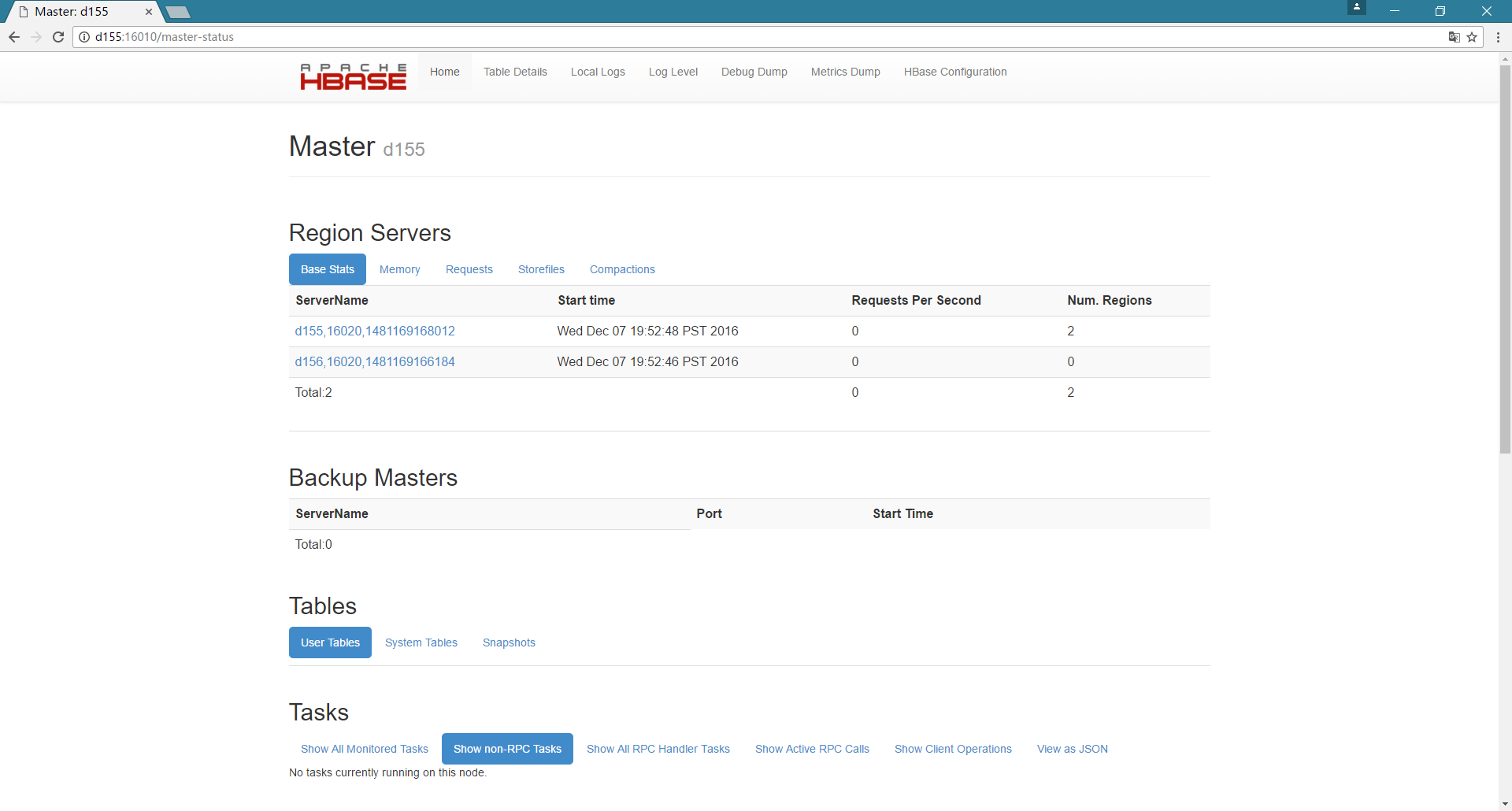

浏览器访问 http://d155:16010/master-status

命令jps

接着上篇:https://my.oschina.net/u/988386/blog/802052

上篇安装完成了hadoop、zookeeper,下面安装hbase。

安装hbase(2台机器配置基本相同)

#!/bin/bash

PATH_FILE="/etc/profile"

#安装包路径

HBASE_TAR="/home/hdp/Downloads/hbase-1.1.7-bin.tar.gz"

HBASE_INSTALL_HOME="/usr/local"

#安装hbase

if [ -d $HBASE_INSTALL_HOME/hbase ]

then

sudo rm -rf $HBASE_INSTALL_HOME/hbase

fi

#解压hbase

sudo tar -zxvf $HBASE_TAR -C $HBASE_INSTALL_HOME

#修改文件名称

sudo mv $HBASE_INSTALL_HOME/hbase-1.1.7 $HBASE_INSTALL_HOME/hbase

#将所有者修改为hadoop

sudo chown -R hadoop $HBASE_INSTALL_HOME/hbase

#设置环境变量

if [ -z $HBASE_HOME ]

then

sudo echo "export HBASE_HOME=\"$HBASE_INSTALL_HOME/hbase\"" >> $PATH_FILE

sudo echo "export PATH=\"\${HBASE_HOME}/bin:\$PATH\"" >> $PATH_FILE

#刷新环境变量

source /etc/profile

fi配置hbase-env.sh

export JAVA_HOME=/usr/lib/jvm/java #注意路径

export HBASE_LOG_DIR=/usr/local/hbase/logs

export HBASE_MANAGES_ZK=false

配置regionservers

删除原来内容,添加2行如下:

d155 d156

配置hbase-site.xml

<configuration> <property> <name>hbase.rootdir</name> <value>hdfs://d155:9000/hbase</value> </property> <property> <name>hbase.cluster.distributed</name> <value>true</value> </property> <property> <name>hbase.zookeeper.quorum</name> <value>d155,d156</value> </property> <property> <name>hbase.master</name> <value>hdfs://d155:60000</value> </property> <property> <name>hbase.zookeeper.property.dataDir</name> <value>/usr/local/zookeeper/data</value> </property> <property> <name>hbase.zookeeper.property.clientPort</name> <value>2181</value> </property> </configuration>

启动停止

/usr/local/hbase/bin/start-hbase.sh /usr/local/hbase/bin/stop-hbase.sh

检查安装情况:

浏览器访问 http://d155:16010/master-status

命令jps

d155主机包含ResourceManager、SecondaryNameNode、NameNode、HQuorumPeer、HMaster等,则表示启动成功,例如 2212 ResourceManager 2999 Jps 2697 HQuorumPeer 1917 NameNode 2078 SecondaryNameNode 2751 HMaster d156主机包含DataNode、NodeManager、HRegionServer、HQuorumPeer等,则表示启用成功,例如 17540 Jps 17142 NodeManager 17338 HRegionServer 17278 HQuorumPeer 17055 DataNode

相关文章推荐

- Ubuntu16.04 下 Spark2.0.2+Hadoop2.7.3+Zookeeper3.4.9+HBase1.1.7集群环境搭建--4

- Ubuntu16.04 下 Spark2.0.2+Hadoop2.7.3+Zookeeper3.4.9+HBase1.1.7集群环境搭建

- Ubuntu16.04 下 Spark2.0.2+Hadoop2.7.3+Zookeeper3.4.9+HBase1.1.7集群环境搭建--5

- Ubuntu16.04 下 Spark2.0.2+Hadoop2.7.3+Zookeeper3.4.9+HBase1.1.7集群环境搭建--2

- 集群RedHat6.5+JDK1.8+Hadoop2.7.3+Spark2.1.1+zookeeper3.4.6+kafka2.11+flume1.6环境搭建步骤

- 单机RedHat6.5+JDK1.8+Hadoop2.7.3+Spark2.1.1+zookeeper3.4.6+kafka2.11+flume1.6环境搭建步骤

- hadoop-2.7.4+hbase-1.3.1+zookeeper-3.4.9搭建分布式集群环境

- Zookeeper3.4.9集群搭建(基于hadoop2.7.3)

- Ubuntu16.04+hadoop2.7.3环境搭建

- hadoop-2.7.4+hbase-1.3.1+zookeeper-3.4.9搭建分布式集群环境

- Hadoop2.6.0 + Spark1.4.0 在Ubuntu14.10环境下的伪分布式集群的搭建(实践可用)

- hadoop、zookeeper、hbase、spark集群环境搭建

- CentOS7下 Hadoop2.7.3+Spark2.1.0 集群环境搭建(1NN+2DN)

- ubuntu16.04搭建Hadoop2.7.2+spark1.6.1+mysql+hive2.0.0伪分布学习环境

- ubuntu16.04搭建hadoop集群环境

- RedHat6.5+JDK1.8+Hadoop2.7.3+Spark2.1.1+zookeeper3.4.6+kafka2.11+flume1.6环境搭建步骤

- CentOS7下 Hadoop2.7.3+Spark2.1.0 集群环境搭建(1NN+2DN)

- Hadoop2.7.3+HBase1.2.5+ZooKeeper3.4.6搭建分布式集群环境

- spark2.0.2环境搭建(hadoop2.7.3)——启动关闭

- ubuntu16.04(64位)+Hadoop2.7.3伪分布式环境下部署Spark