逻辑回归公式推导过程

2016-10-18 17:34

309 查看

1 逻辑回归模型

回归是一种极易理解的模型,就相当于y=f(x),表明自变量x与因变量y的关系。最常见问题有如医生治病时的望、闻、问、切,之后判定病人是否生病或生了什么病,其中的望闻问切就是获取自变量x,即特征数据,判断是否生病就相当于获取因变量y,即预测分类。最简单的回归是线性回归,在此借用Andrew NG的讲义,有如图1.a所示,X为数据点——肿瘤的大小,Y为观测值——是否是恶性肿瘤。通过构建线性回归模型,如h θ (x)所示,构建线性回归模型后,即可以根据肿瘤大小,预测是否为恶性肿瘤h θ (x)≥.05为恶性,h θ (x)<0.5为良性。

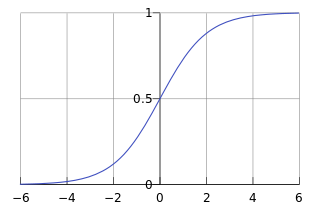

然而线性回归的鲁棒性很差,例如在图1.b的数据集上建立回归,因最右边噪点的存在,使回归模型在训练集上表现都很差。这主要是由于线性回归在整个实数域内敏感度一致,而分类范围,需要在[0,1]。逻辑回归就是一种减小预测范围,将预测值限定为[0,1]间的一种回归模型,其回归方程与回归曲线如图2所示。逻辑曲线在z=0时,十分敏感,在z>>0或z<<0处,都不敏感,将预测值限定为(0,1)。

2 什么是逻辑回归?

Logistic回归与多重线性回归实际上有很多相同之处,最大的区别就在于它们的因变量不同,其他的基本都差不多。正是因为如此,这两种回归可以归于同一个家族,即广义线性模型(generalizedlinear model)。

这一家族中的模型形式基本上都差不多,不同的就是因变量不同。

如果是连续的,就是多重线性回归;

如果是二项分布,就是Logistic回归;

如果是Poisson分布,就是Poisson回归;

如果是负二项分布,就是负二项回归。

Logistic回归的因变量可以是二分类的,也可以是多分类的,但是二分类的更为常用,也更加容易解释。所以实际中最常用的就是二分类的Logistic回归。

Logistic回归的主要用途:

寻找危险因素:寻找某一疾病的危险因素等;

预测:根据模型,预测在不同的自变量情况下,发生某病或某种情况的概率有多大;

判别:实际上跟预测有些类似,也是根据模型,判断某人属于某病或属于某种情况的概率有多大,也就是看一下这个人有多大的可能性是属于某病。

Logistic回归主要在流行病学中应用较多,比较常用的情形是探索某疾病的危险因素,根据危险因素预测某疾病发生的概率,等等。例如,想探讨胃癌发生的危险因素,可以选择两组人群,一组是胃癌组,一组是非胃癌组,两组人群肯定有不同的体征和生活方式等。这里的因变量就是是否胃癌,即“是”或“否”,自变量就可以包括很多了,例如年龄、性别、饮食习惯、幽门螺杆菌感染等。自变量既可以是连续的,也可以是分类的。

常规步骤

Regression问题的常规步骤为:

寻找h函数(即hypothesis);

构造J函数(损失函数);

想办法使得J函数最小并求得回归参数(θ)

3 构造预测函数h

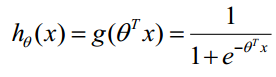

Logistic回归虽然名字里带“回归”,但是它实际上是一种分类方法,主要用于两分类问题(即输出只有两种,分别代表两个类别),所以利用了Logistic函数(或称为Sigmoid函数),函数形式为:

Sigmoid 函数在有个很漂亮的“S”形,如下图所示(引自维基百科):

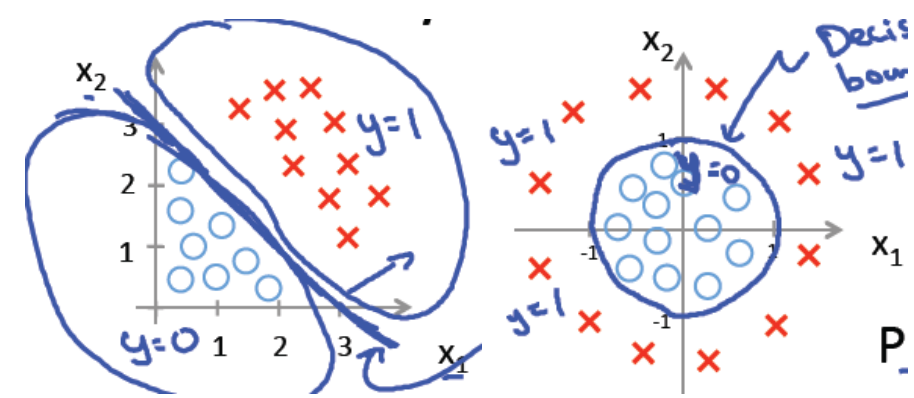

下面左图是一个线性的决策边界,右图是非线性的决策边界。

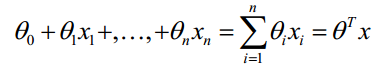

对于线性边界的情况,边界形式如下:

构造预测函数为:

函数

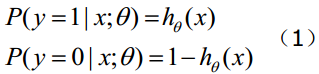

的值有特殊的含义,它表示结果取1的概率,因此对于输入x分类结果为类别1和类别0的概率分别为:

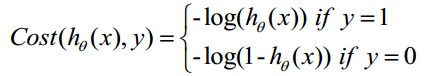

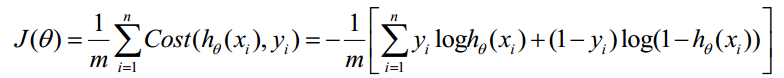

构造损失函数J

Cost函数和J函数如下,它们是基于最大似然估计推导得到的。

下面详细说明推导的过程:

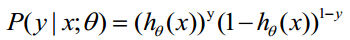

(1)式综合起来可以写成:

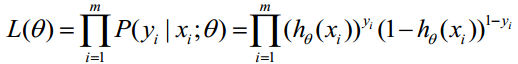

取似然函数为:

对数似然函数为:

最大似然估计就是求使

取最大值时的θ,其实这里可以使用梯度上升法求解,求得的θ就是要求的最佳参数。但是,在Andrew Ng的课程中将

取为下式,即:

因为乘了一个负的系数-1/m,所以取

最小值时的θ为要求的最佳参数。

梯度下降法求的最小值

θ更新过程:

θ更新过程可以写成:

相关文章推荐

- 双层神经网络与逻辑回归正反向传播数学公式简要推导

- 逻辑回归-参数迭代公式推导

- 逻辑回归梯度下降公式详细推导

- 机器学习-逻辑回归-参数迭代公式推导

- 逻辑回归LR推导(sigmoid,损失函数,梯度,参数更新公式)

- 逻辑回归模型及LBFGS的Sherman Morrison(SM) 公式推导

- 逻辑回归模型的代价函数对参数的偏导数--推导过程

- 逻辑斯蒂回归(LR)原理详解及公式推导

- 广义线性模型和逻辑回归的公式推导

- 逻辑回归中代价函数求导的推导过程

- Logistic Regression(逻辑回归)原理及公式推导

- [小白式机器学习(一)] logistic regression(LR)对数几率回归 / 逻辑回归 公式推导

- 转载-机器学习-逻辑回归-参数迭代公式推导

- 逻辑斯蒂回归公式推导

- Logistic Regression(逻辑回归)原理及公式推导

- [机器学习]逻辑回归公式推导及其梯度下降法的Python实现

- 机器学习-逻辑回归-参数迭代公式推导

- 逻辑回归公式推导

- 逻辑回归原理及推导过程

- 逻辑回归迭代公式推导