利用 word2vec 训练的字向量进行中文分词

2016-09-03 17:02

316 查看

http://blog.csdn.net/itplus/article/details/17122431

相关链接:《Deep Learning 在中文分词和词性标注任务中的应用》《Deep Learning for Chinese Word Segmentation and POS tagging》《UFLDL 教程学习笔记(一)神经网络》《HMM 自学教程(六)维特比算法》《为什么我们喜欢用 sigmoid 这类 S 型非线性变换?》作者: peghoty 出处: http://blog.csdn.net/itplus/article/details/17122431欢迎转载/分享, 但请务必声明文章出处.

相关链接:《Deep Learning 在中文分词和词性标注任务中的应用》《Deep Learning for Chinese Word Segmentation and POS tagging》《UFLDL 教程学习笔记(一)神经网络》《HMM 自学教程(六)维特比算法》《为什么我们喜欢用 sigmoid 这类 S 型非线性变换?》作者: peghoty 出处: http://blog.csdn.net/itplus/article/details/17122431欢迎转载/分享, 但请务必声明文章出处.

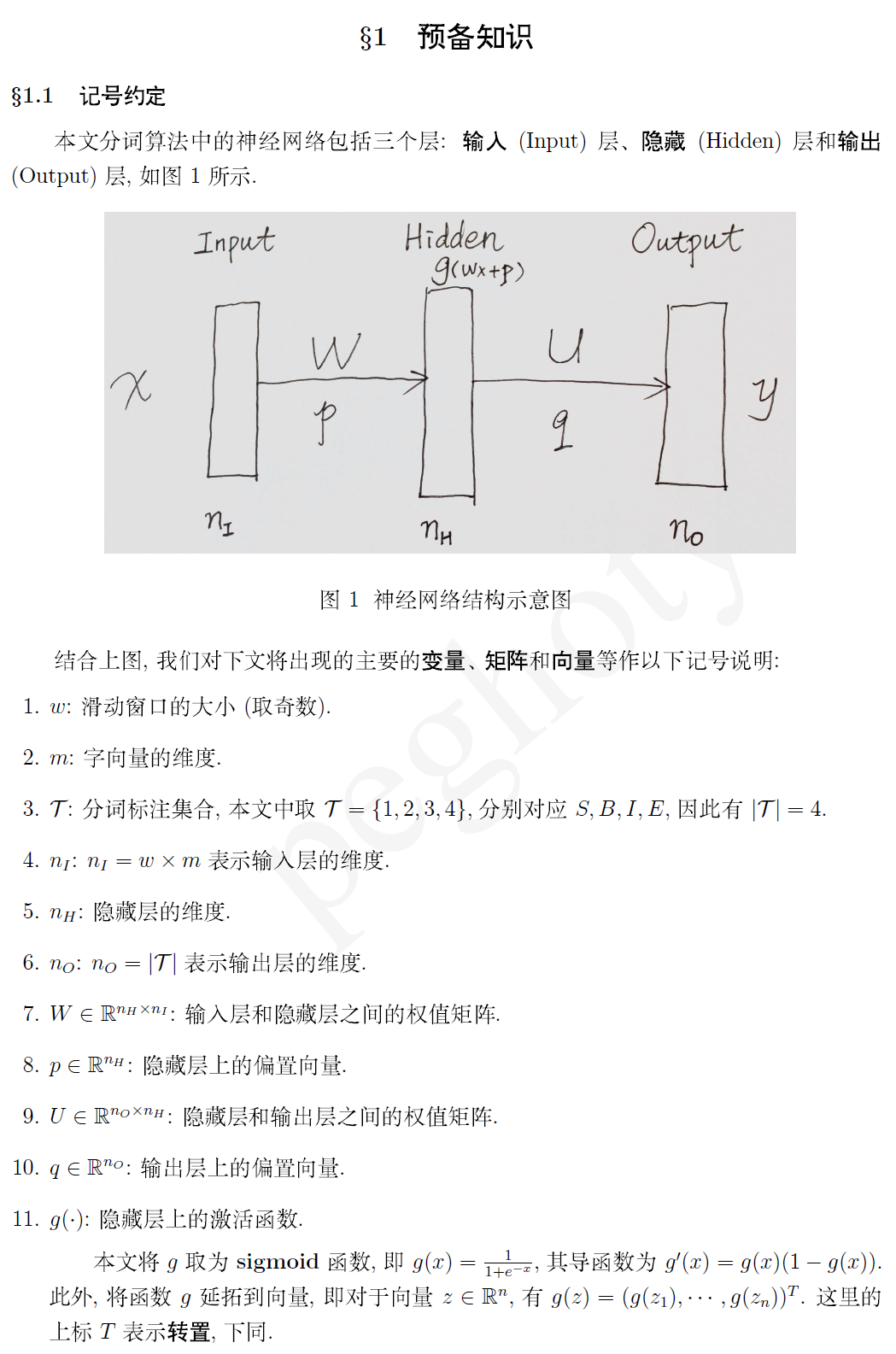

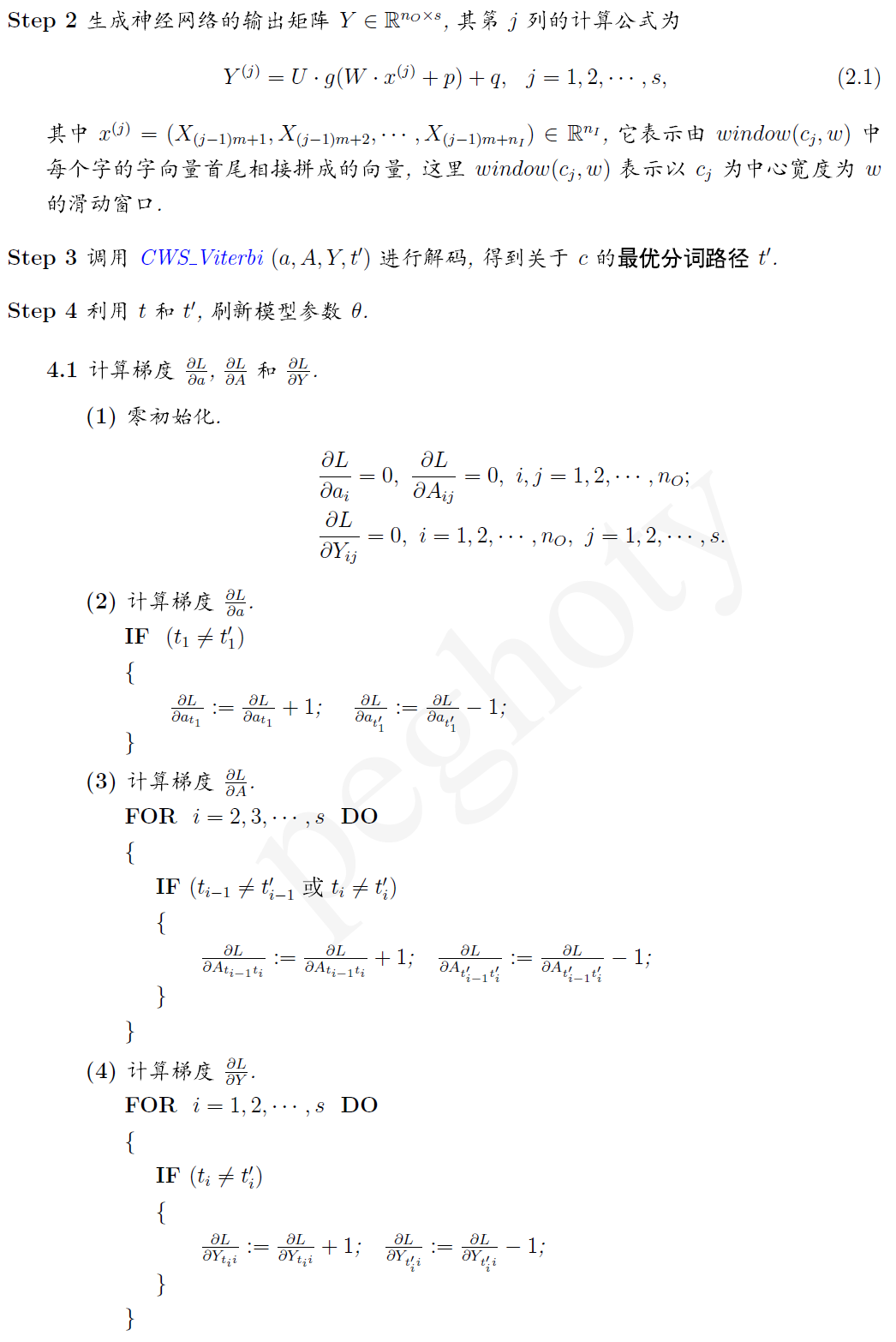

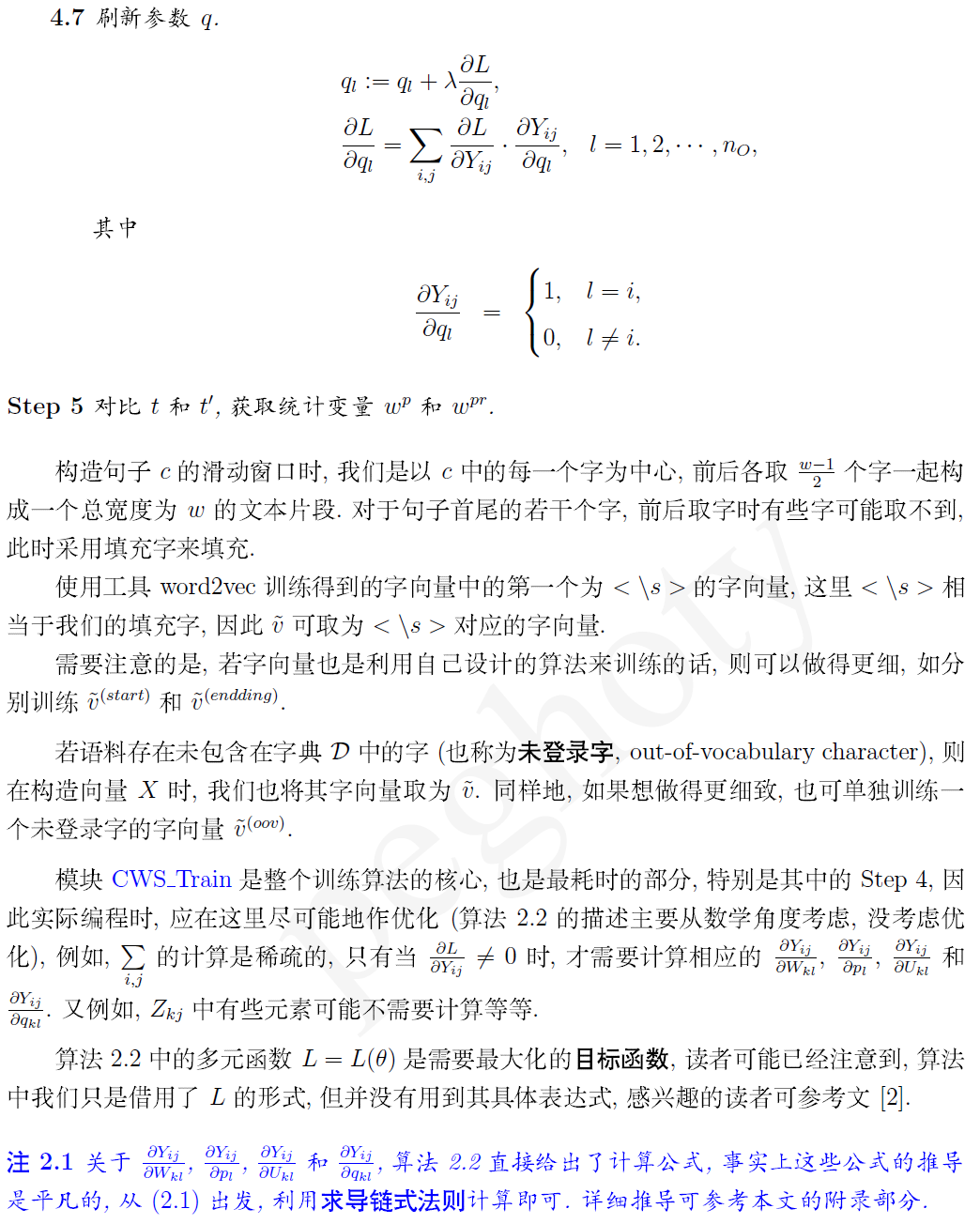

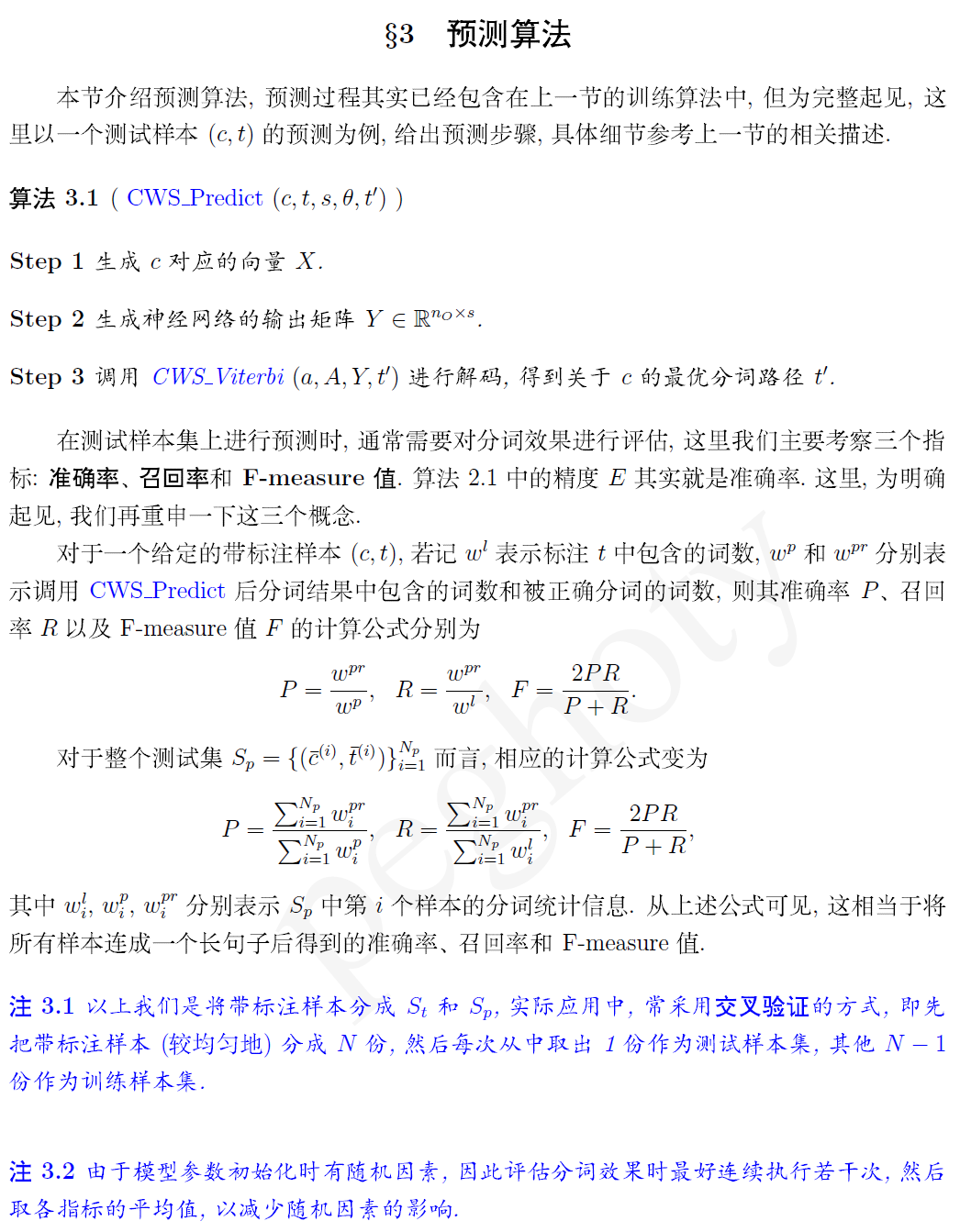

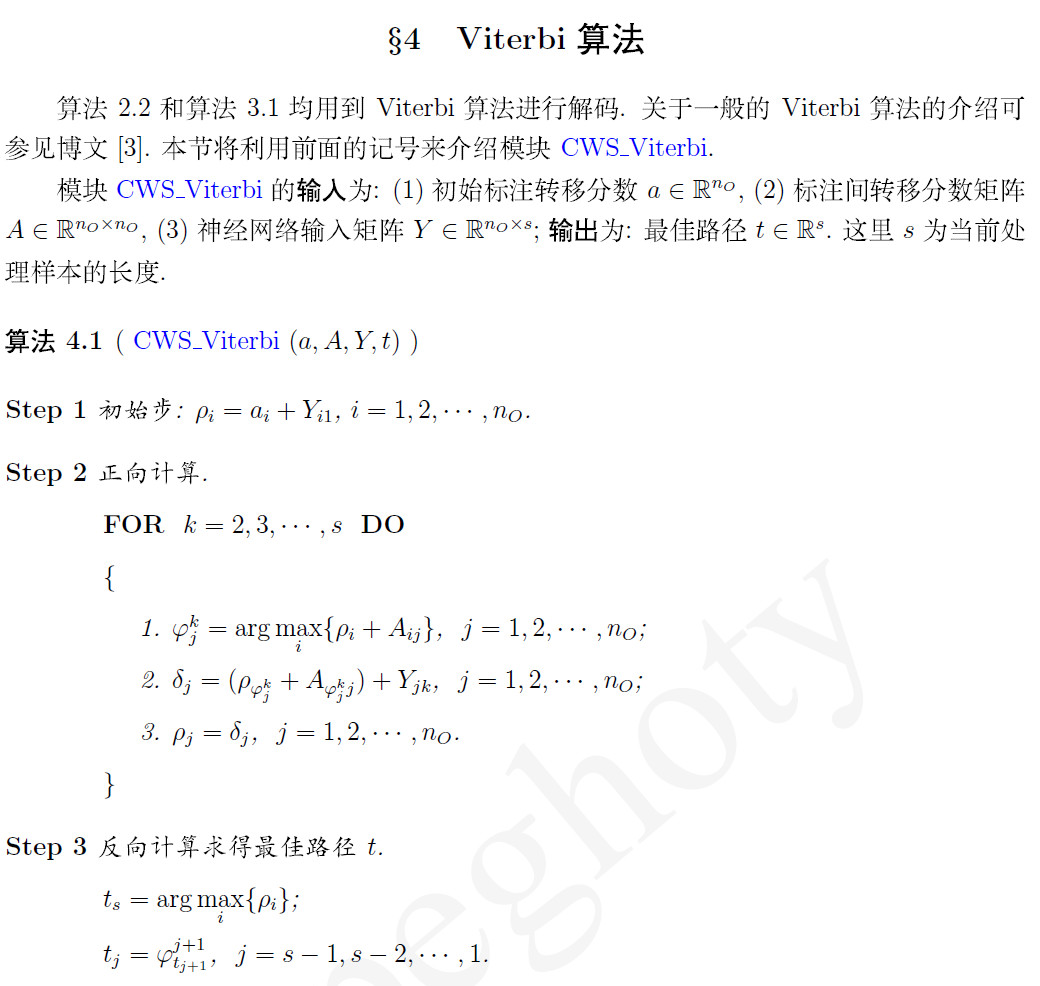

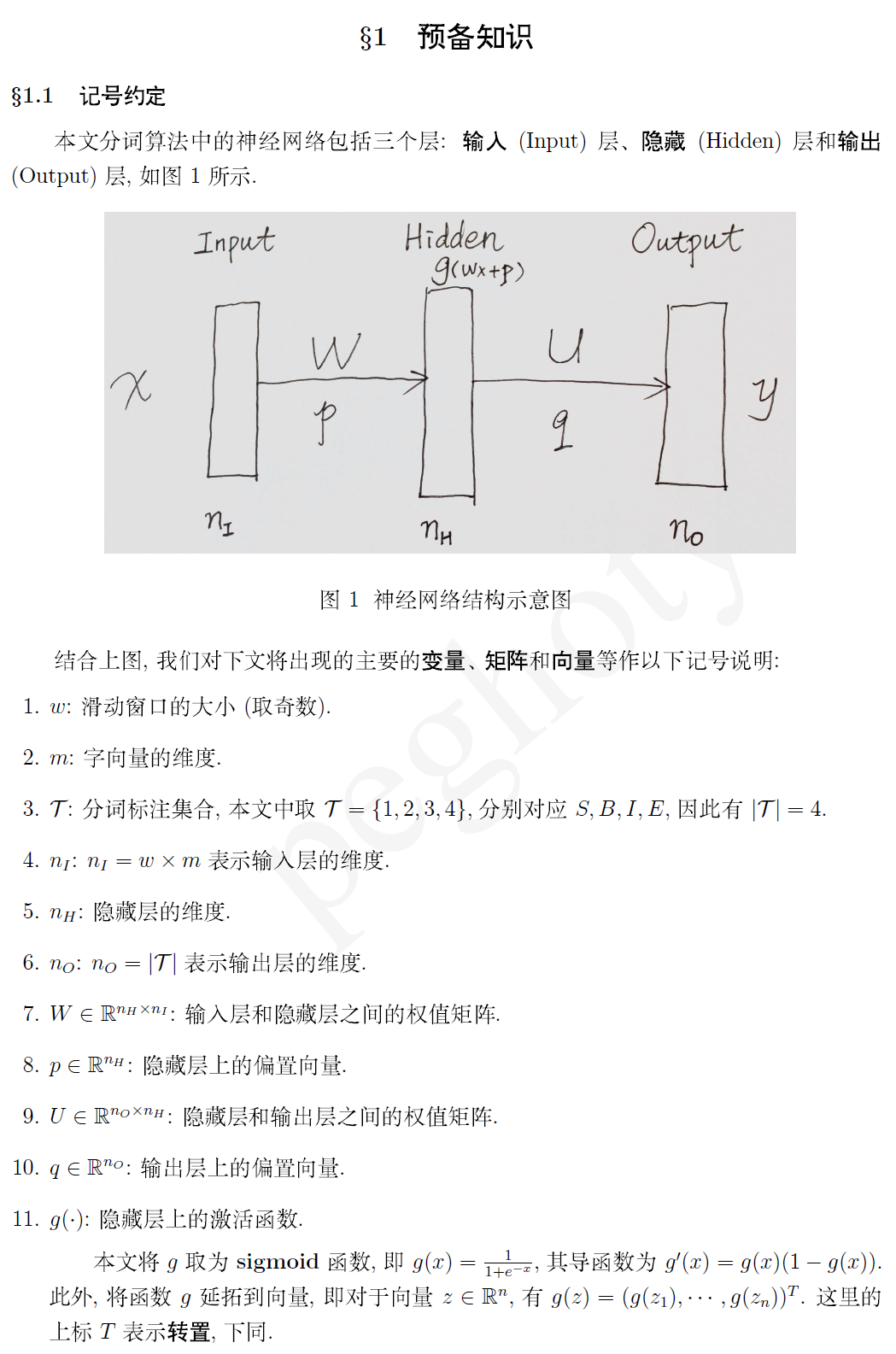

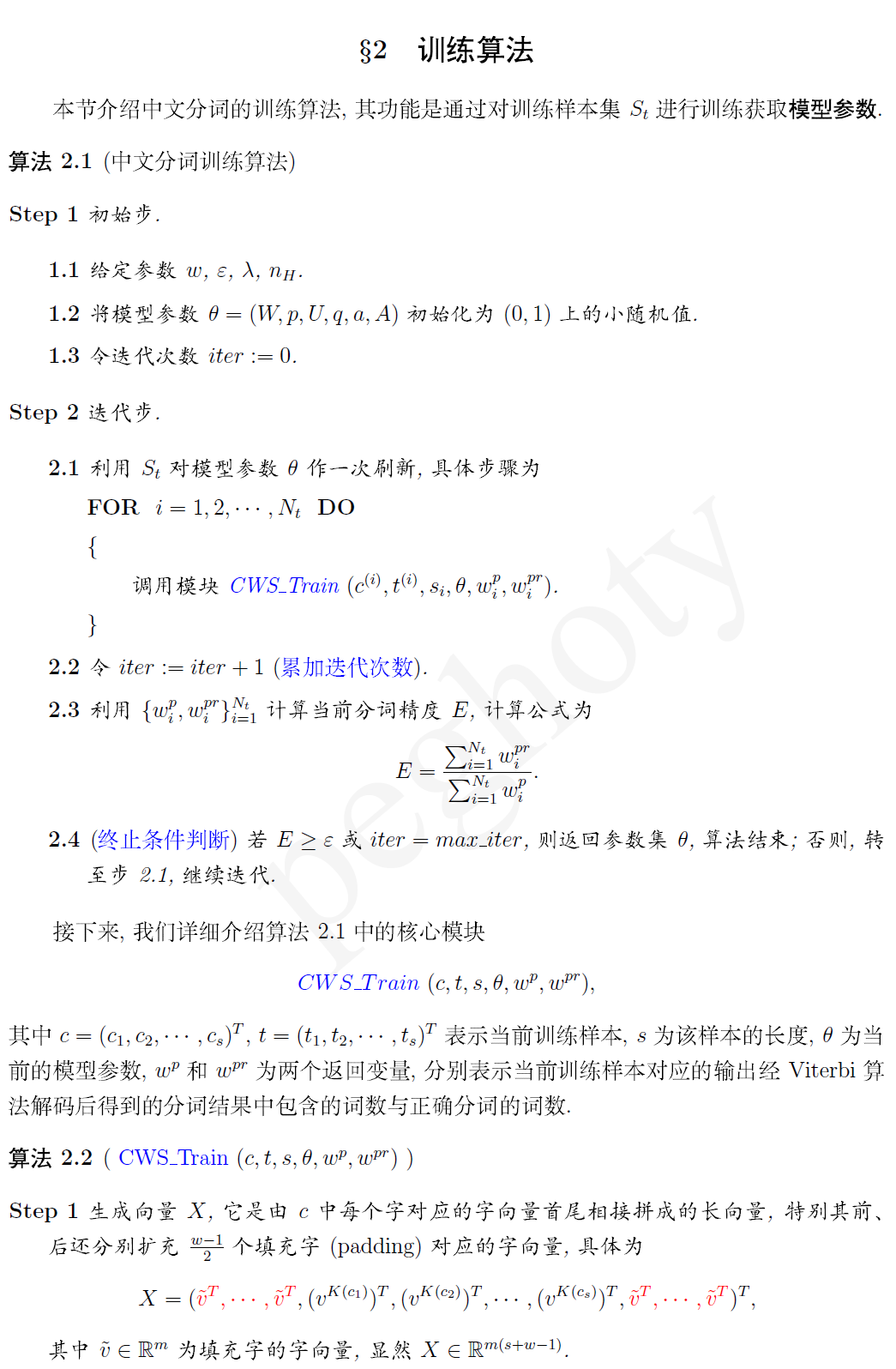

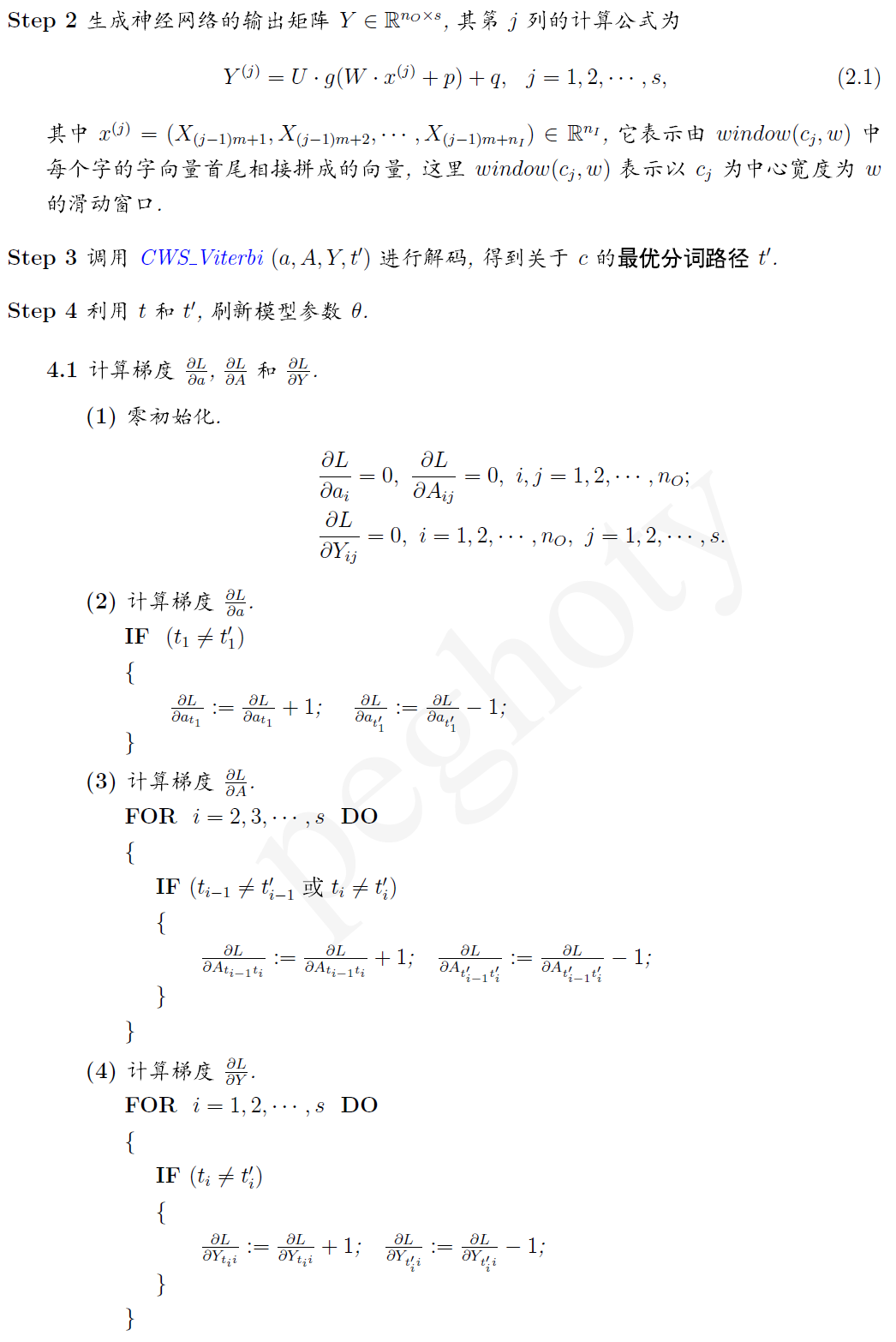

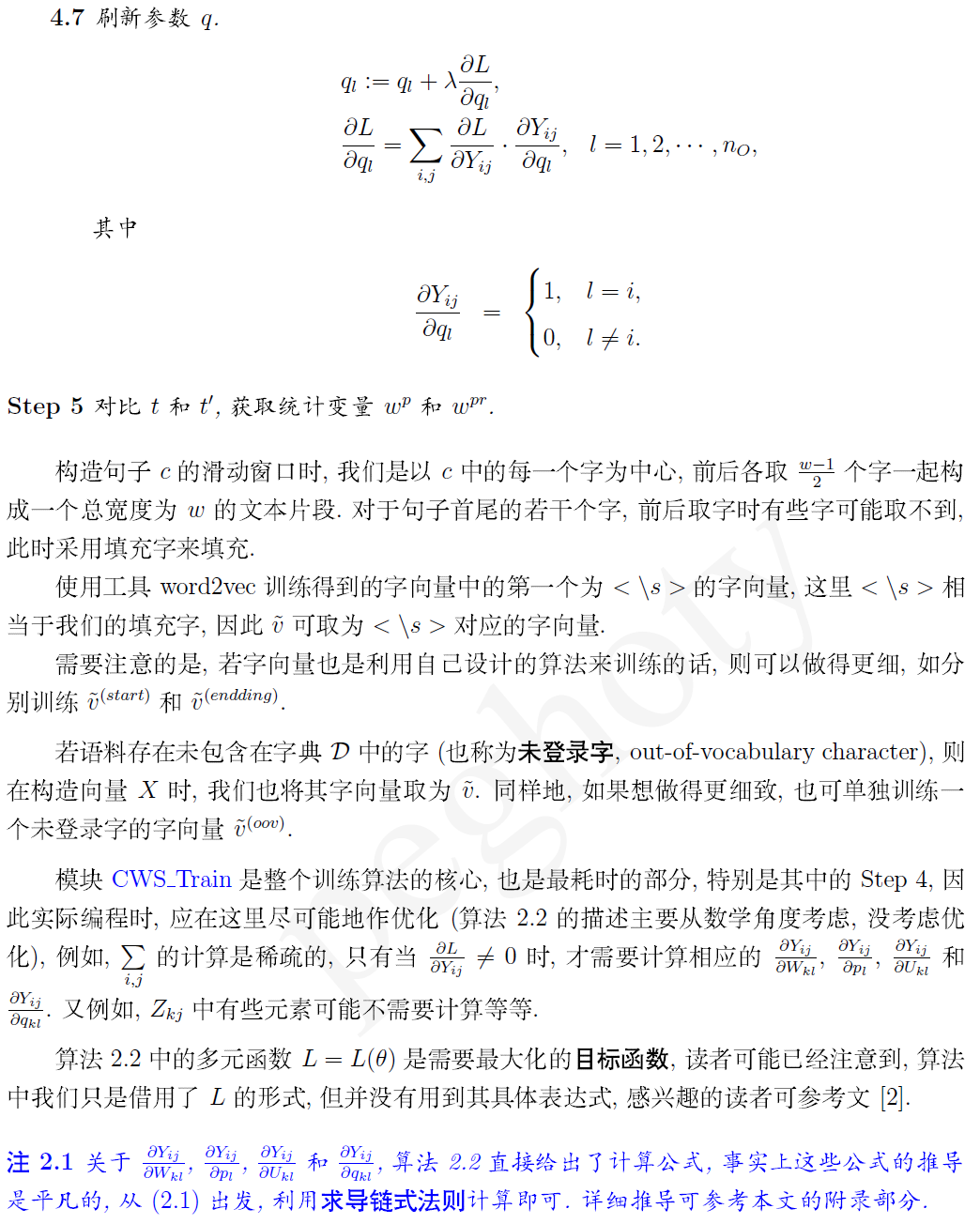

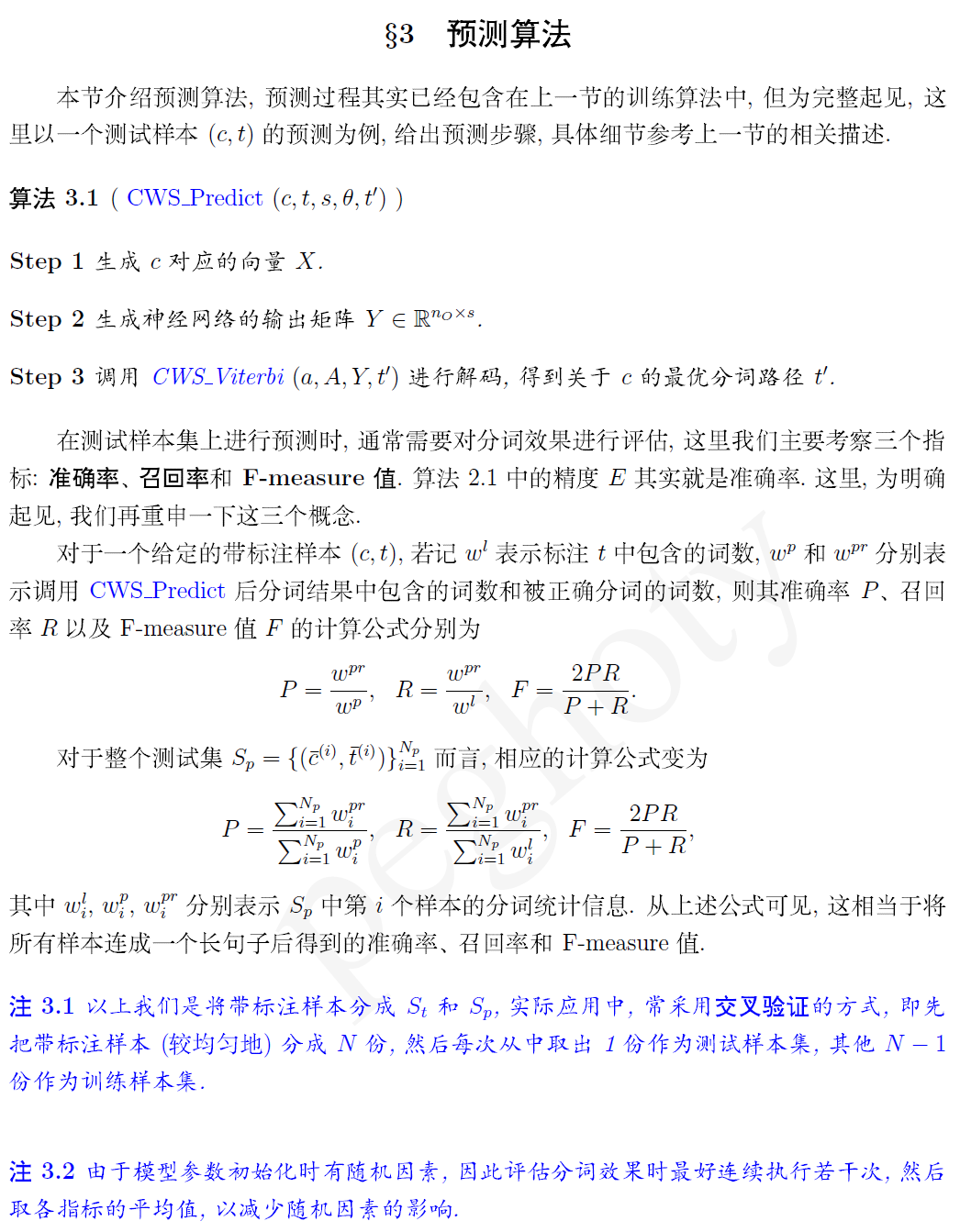

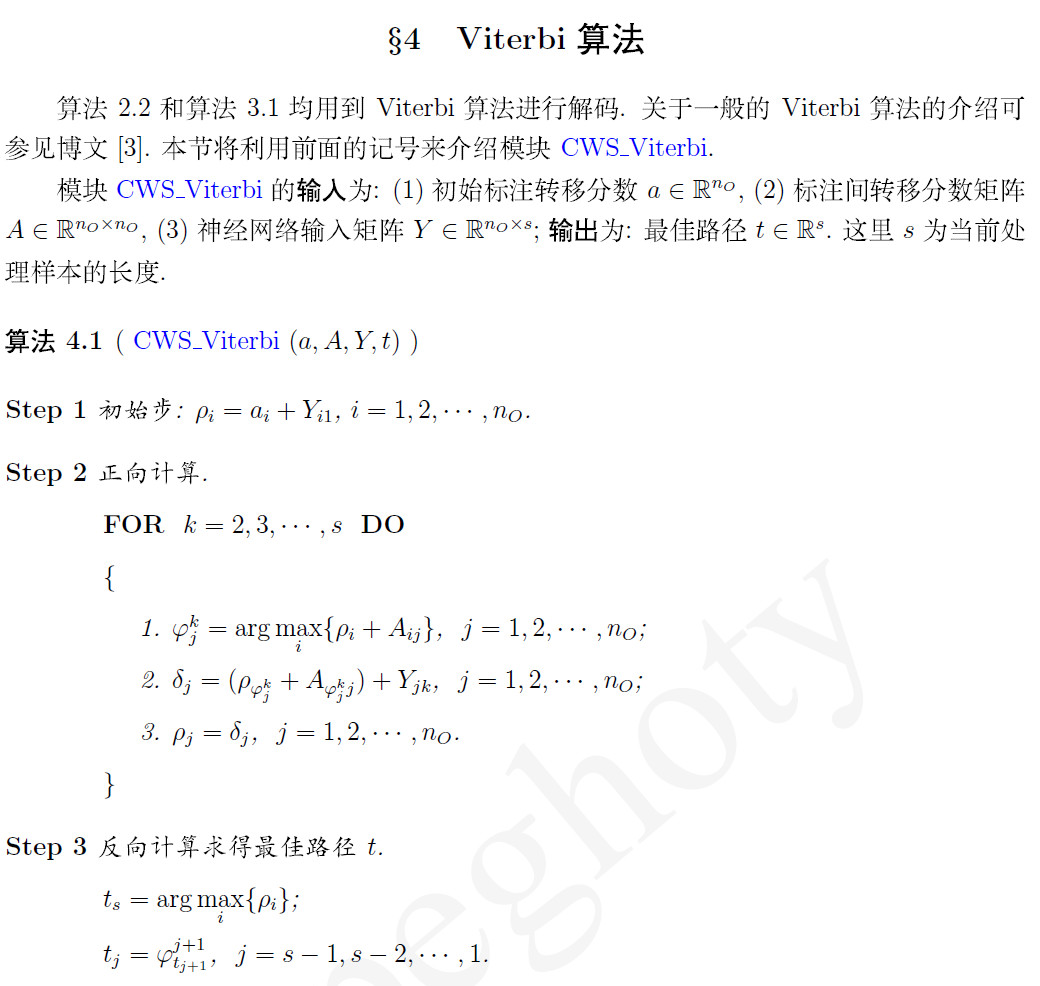

最近针对之前发表的一篇博文《Deep Learning 在中文分词和词性标注任务中的应用》中的算法做了一个实现,感觉效果还不错。本文主要是将我在程序实现过程中的一些数学细节整理出来,借此优化一下自己的代码,也希望为对此感兴趣的朋友提供点参考。文中重点介绍训练算法中的模型参数计算,以及 Viterbi 解码算法。

相关链接:《Deep Learning 在中文分词和词性标注任务中的应用》《Deep Learning for Chinese Word Segmentation and POS tagging》《UFLDL 教程学习笔记(一)神经网络》《HMM 自学教程(六)维特比算法》《为什么我们喜欢用 sigmoid 这类 S 型非线性变换?》作者: peghoty 出处: http://blog.csdn.net/itplus/article/details/17122431欢迎转载/分享, 但请务必声明文章出处.

相关链接:《Deep Learning 在中文分词和词性标注任务中的应用》《Deep Learning for Chinese Word Segmentation and POS tagging》《UFLDL 教程学习笔记(一)神经网络》《HMM 自学教程(六)维特比算法》《为什么我们喜欢用 sigmoid 这类 S 型非线性变换?》作者: peghoty 出处: http://blog.csdn.net/itplus/article/details/17122431欢迎转载/分享, 但请务必声明文章出处.

相关文章推荐

- 利用 word2vec 训练的字向量进行中文分词

- 利用 word2vec 训练的字向量进行中文分词

- 利用 word2vec 训练的字向量进行中文分词

- 利用 word2vec 训练的字向量进行中文分词

- 利用 word2vec 训练的字向量进行中文分词

- 利用 word2vec 训练的字向量进行中文分词

- word2vec词向量训练及中文文本相似度计算

- 利用Word2Vec训练词向量过程

- [zt]word2vec词向量训练及中文文本相似度计算

- 利用结巴和WordCloud进行中文分词及图云绘制入门

- 用Word2vec训练中文wiki,构造词向量并做词聚类

- 利用条件随机场模型进行中文分词

- 利用Ansj中文分词工具对段落进行切词

- 用word2vec训练文本摘要的词向量模型

- windows下用Anaconda3做基于维基百科中文word2vec训练

- 利用庖丁解牛工具进行中文分词

- windows10 训练word2vec 中文语料

- 利用统计进行中文分词与词性分析

- 用word2vec对语料进行训练

- 使用word2vec训练wiki中文语料