应用梯度下降和随机梯度下降时的几个注意点

2013-05-09 11:25

281 查看

转:http://webdancer.is-programmer.com/posts/35983

随机梯度下降算法的基本思想,在前面已经说过了。在应用梯度下降的时候有几个要注意的点,再重新记录一下。

当学习速率为50时,不收敛;当学习速率为0.01时收敛过慢,所以在训练时候一定要选择恰当的参数。

[2]http://openclassroom.stanford.edu/TestFolder/courses/ufldl/exercises/ex1/ex1.html

随机梯度下降算法的基本思想,在前面已经说过了。在应用梯度下降的时候有几个要注意的点,再重新记录一下。

1.收敛

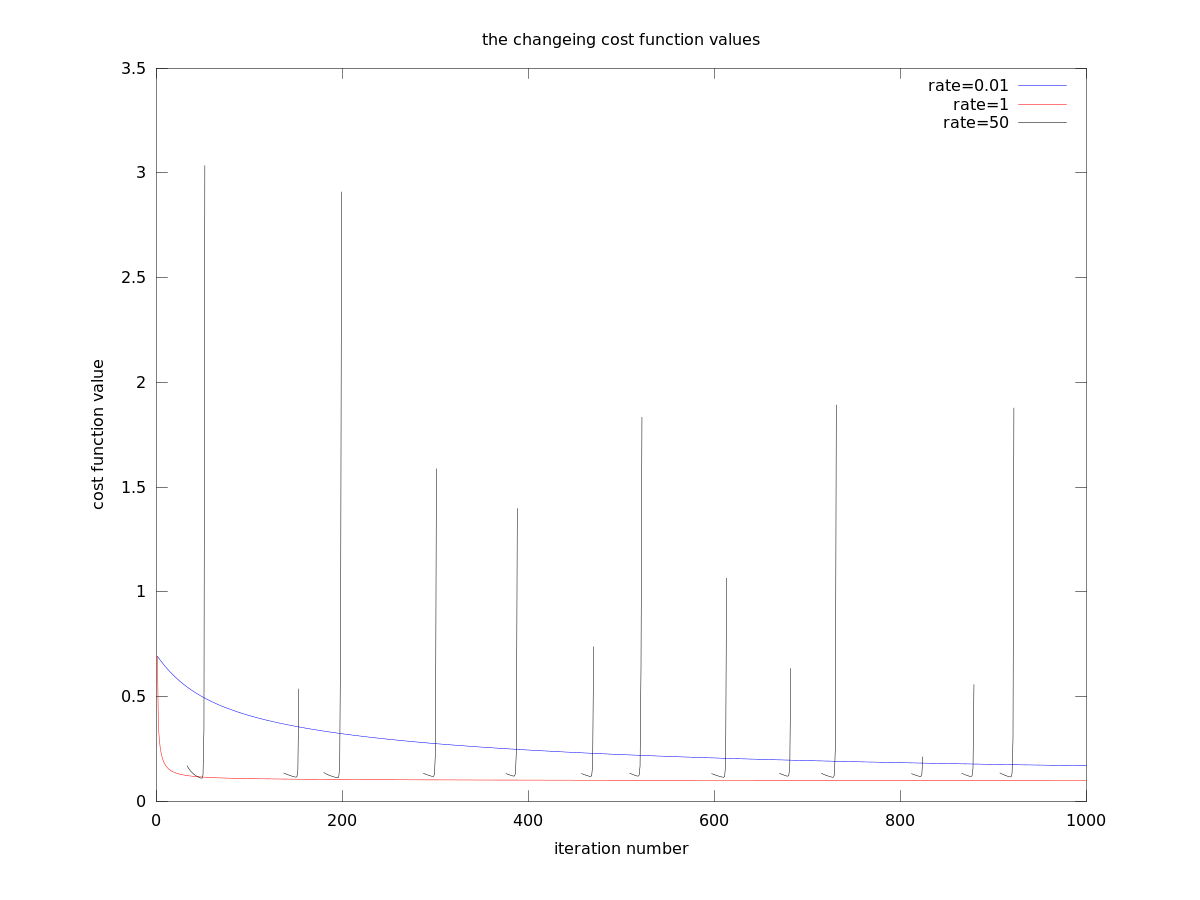

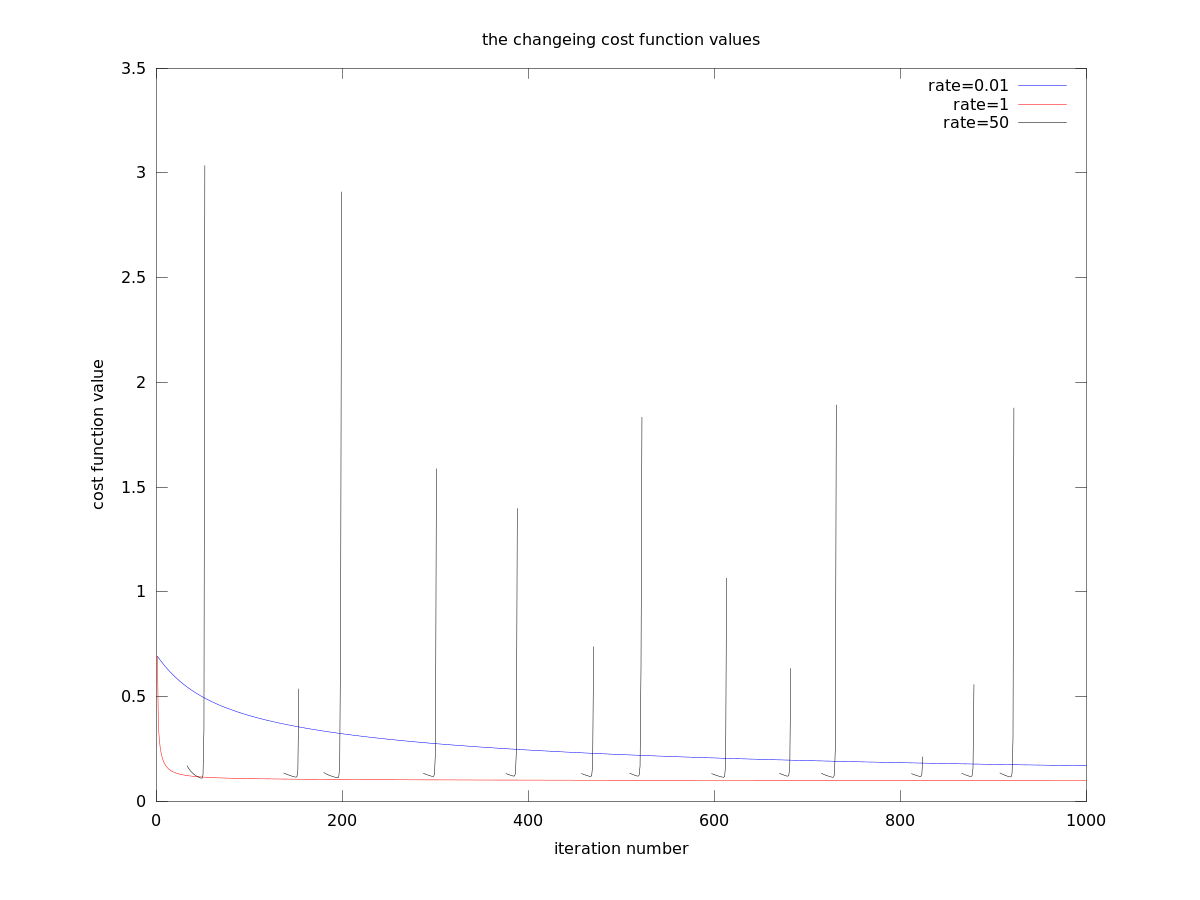

我们在应用梯度下降的时候,一定要关注是否收敛。一般来说,E(θ)收敛到一定的值,所求出来的参数也是基本相同的。能使用梯度下降的求解的问题,影响我们求解的是它的学习速率(可以参考前面的内容)。速率过大,可能不收敛;速率过小,收敛速度过慢,所以我们必须恰当的选择学习速率η。通过下面的例子看以看到[1]:

当学习速率为50时,不收敛;当学习速率为0.01时收敛过慢,所以在训练时候一定要选择恰当的参数。

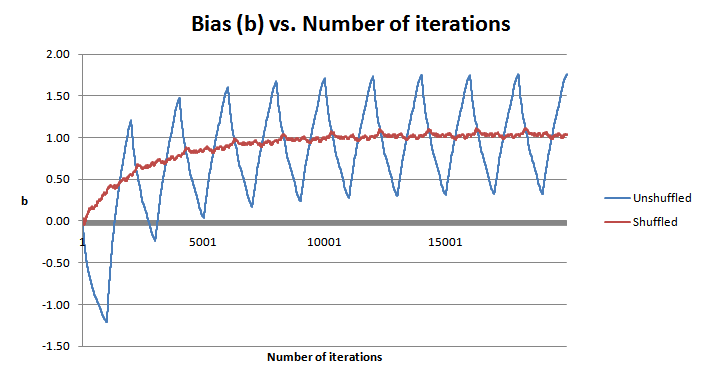

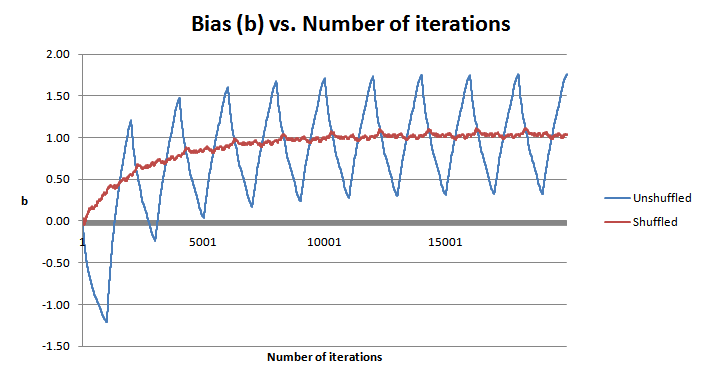

2.随机shuffle

在随机梯度学习算法中,如果训练集中正例和负例都聚集在一块。不进行shuffle可能会造成'wavy'现象[2],如下图所示:

[引用]:

[1]自己实现的logistic regression model,然后在上面做的实验,得出的图1。 https://github.com/seaslee/ML_algorithm.git[2]http://openclassroom.stanford.edu/TestFolder/courses/ufldl/exercises/ex1/ex1.html

相关文章推荐

- 监督学习应用与梯度下降

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 梯度下降,随机梯度下降,mini-batch梯度下降

- batch gradient descent(批量梯度下降) 和 stochastic gradient descent(随机梯度下降) C++版

- 最优化方法:梯度下降(批梯度下降和随机梯度下降)

- 机器学习第二节-监督学习应用.梯度下降

- 随机梯度下降,批量梯度下降,牛顿法,拟牛顿法

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比

- 机器学习笔记二:监督学习应用:梯度下降

- 梯度下降、随机梯度下降(SGD)、批量梯度下降(BGD)的对比

- 线性回归 最小二乘 梯度下降 随机梯度下降

- 监督学习应用与梯度下降

- Andrew Ng 机器学习 第一课 监督学习应用.梯度下降 笔记

- 监督学习应用与梯度下降

- 梯度下降VS随机梯度下降

- 梯度、梯度下降,随机梯度下降

- 第二课 监督学习应用 梯度下降

- 梯度下降 随机梯度下降 批量梯度下降

- 神经网络算法学习---梯度下降和随机梯度下降

- 随机梯度下降(Stochastic gradient descent)和 批量梯度下降(Batch gradient descent )的公式对比、实现对比