pytorch学习——Softmax与分类模型

2020-03-01 20:13

92 查看

Softmax与分类模型

Softmax原理

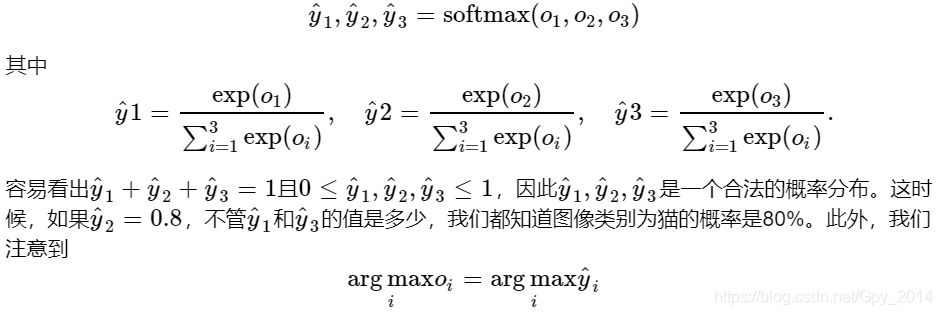

softmax通过下式将输出值变换成值为正且和为1的概率分布:

因此softmax运算不改变预测类别输出。

pytorch定义softmax函数如下:

def softmax(X): X_exp = X.exp() partition = X_exp.sum(dim=1, keepdim=True) return X_exp / partition

定义softmax回归模型:

def net(X): return softmax(torch.mm(X.view((-1, num_inputs)), W) + b)

交叉熵损失函数

对于分类问题常用交叉熵损失函数:

def cross_entropy(y_hat, y): return - torch.log(y_hat.gather(1, y.view(-1, 1)))

模型训练和预测

在训练好softmax回归模型后,给定任一样本特征,就可以预测每个输出类别的概率。通常,我们把预测概率最大的类别作为输出类别。使用准确率(accuracy)来评价模型的表现。它等于正确预测数量与总预测数量之比。

- 点赞

- 收藏

- 分享

- 文章举报

哆来咪发呀

发布了3 篇原创文章 · 获赞 0 · 访问量 68

私信

关注

哆来咪发呀

发布了3 篇原创文章 · 获赞 0 · 访问量 68

私信

关注

相关文章推荐

- TensorFlow学习Day3读取csv文件,动手写个logistic,softmax分类模型

- tensorflow学习-示例1(MNIST数据集合上的softmax分类模型)

- 深度学习新应用:在PyTorch中用单个2D图像创建3D模型

- 文本情感分类:深度学习模型

- 统计学习:泛化能力、生成模型、判别模型、分类、标注和回归问题

- (三)tensorflow学习之旅——mnist的softmax分类示例

- <模型汇总_9> 深度学习网络的表达方式汇总及模型分类方法

- 线性回归、Softmax与分类模型、多层感知机

- OpenCV3与深度学习实例-使用GoogLeNet模型进行图片分类识别

- 一种自动分类数据方法2_判断模型好坏_学习曲线 luikimfai

- 文本情感分类(二):深度学习模型

- caffe的python接口学习(6):用训练好的模型(caffemodel)来分类新的图片

- caffe的python接口学习:用训练好的模型(caffemodel或者h5)来分类新的图片

- 【转】[caffe]深度学习之图像分类模型AlexNet解读

- 深度学习图像处理:双线性CNN (Bilinear cnn)- 细粒度图像分类模型

- 利用分类模型学习特征权重

- [caffe]深度学习之图像分类模型AlexNet解读

- 机器学习笔记(IX)线性模型(V)多分类学习

- 文本情感分类:深度学习模型(2)

- 文本情感分类:深度学习模型(2)