CNN经典网络:ResNet系列

2019-07-27 17:11

148 查看

版权声明:本文为博主原创文章,遵循 CC 4.0 by-sa 版权协议,转载请附上原文出处链接和本声明。

本文链接:https://blog.csdn.net/qq_39382877/article/details/97530654

ResNetV1

论文:https://arxiv.org/pdf/1512.03385v1.pdf

代码:参考Tensorflow/slim

特点

第一次提出残差结构,主要解决两个问题

- 梯度消失

- 随着网络深度增加,性能没有提升反而有所下降

如下图,本来要学习H(x),现在转换为F(x)+x,二者效果相同,但是优化难度下降,并且因为多了一个x,使得求导时总有1,避免了梯度消失问题。

进一步拓展残差结构:

网络结构

ResNet主要有34层、50层、101层、152层,主要也就是stage的重复次数不同,整体结构基本一致。

但也计算残差结构使得网络可以变得很深,甚至超过100多层。

ResNetV2

论文:https://arxiv.org/pdf/1603.05027.pdf

代码:参考Tensorflow/slim

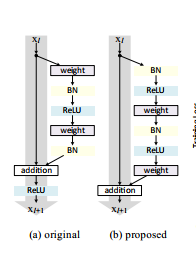

与ResNetV1的区别

主要也就是BN、Relu的顺序提到了Conv之前,并且分析了这样的结果是最好的。

网络结构

与V1相比,只是ResNet-block有了改变而已,整个网络结构基本还是一致的。

相关文章推荐

- CNN经典网络模型摘要--AlexNet、ZFnet、GoogleNet、VGG、ResNet

- Deep Learning(一):CNN经典网络模型摘要--AlexNet、ZFnet、GoogleNet、VGG、ResNet

- CNN系列学习(七):ResNet

- CNN经典网络模型发展史:LeNet, AlexNet, VGGNet, GoogLeNet, ResNet, DenseNet(持续更新)

- CNN经典网络模型摘要--AlexNet、ZFnet、GoogleNet、VGG、ResNet

- CNN经典网络模型摘要--AlexNet、ZFnet、GoogleNet、VGG、ResNet

- R-CNN系列object detection方法概述

- 【R-CNN系列目标检测】(7)SSD算法

- CNN代码系列之训练源文件及头文件(二)

- [ResNet]系列 SENet

- 深度学习——CNN经典网络总结

- 论文笔记:CNN经典结构1(AlexNet,ZFNet,OverFeat,VGG,GoogleNet,ResNet)

- R-CNN,SPP-NET, Fast-R-CNN,Faster-R-CNN, YOLO, SSD系列深度学习检测方法梳理

- CNN发展简史——ResNet(五)

- R-CNN系列阅读笔记(1): R-CNN

- 深度学习检测方法梳理:R-CNN,SPP-NET, Fast-R-CNN,Faster-R-CNN, YOLO, SSD系列

- Deep Learning-TensorFlow (9) CNN卷积神经网络_《TensorFlow实战》及经典网络模型(下)

- 【论文笔记】物体检测系列 Light-Head R-CNN: In Defense of Two-Stage Object Detector

- 【R-CNN系列目标检测】(5)YOLO算法

- R-CNN系列阅读笔记(2): SPP-Net