Py之jieba:Python包之jieba包——中文分词最好的组件——Jason niu

2018-03-14 20:24

417 查看

python的第三方包里,jieba应该算得上是分词领域的佼佼者,想要使用python做文本分析,分词是必不可少的一个环节。

(1)支持三种分词模式:

(1)精确模式:试图将句子最精确的切开,适合文本分析。

(2)全模式:把句子中所有可以成词的词语都扫描出来,速度非常快,但是不能解决歧义。

(3)搜索引擎模式:在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词。

(2)支持繁体分词

(3)支持自定义词典

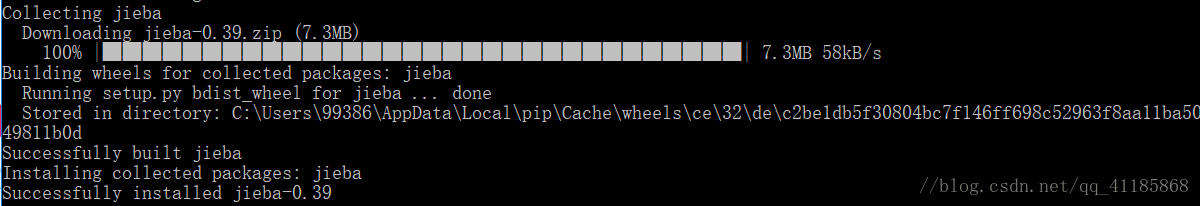

jieba包的安装:pip install jieba

好啦,大功告成,开始使用吧!

(1)支持三种分词模式:

(1)精确模式:试图将句子最精确的切开,适合文本分析。

(2)全模式:把句子中所有可以成词的词语都扫描出来,速度非常快,但是不能解决歧义。

(3)搜索引擎模式:在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词。

(2)支持繁体分词

(3)支持自定义词典

jieba包的安装:pip install jieba

好啦,大功告成,开始使用吧!

相关文章推荐

- Python中文分词组件jieba

- Python中文分词组件 jieba

- Python中文分词组件 jieba

- 在Python里安装Jieba中文分词组件

- “结巴”中文分词:做最好的 Python 中文分词组件

- 在Python里安装Jieba中文分词组件

- Python中文分词组件 jieba

- Python 中文分词组件 jieba

- Python中文分词组件jieba

- 在Python里安装Jieba中文分词组件

- 基于Python3.6编写的jieba分词组件+Scikit-Learn库+朴素贝叶斯算法小型中文自动分类程序

- python基础===jieba模块,Python 中文分词组件

- 在Python里安装Jieba中文分词组件

- 在Python里安装Jieba中文分词组件

- python中文分词jieba的高级应用

- 使用python jieba库进行中文分词

- Py之snownlp:python包之snownlp中文处理包详细攻略——Jason niu

- Python 文本挖掘:jieba中文分词和词性标注

- Python jieba 中文分词与词频统计

- python中文分词工具:结巴分词jieba