深度学习: smooth L1 loss 计算

2017-12-20 15:24

411 查看

RPN的目标函数是分类和回归损失的和,分类采用 交叉熵,回归采用稳定的 Smooth L1,

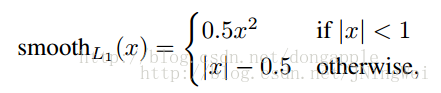

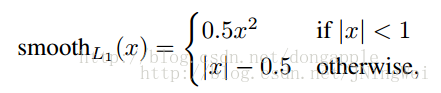

SmoothL1公式 为:

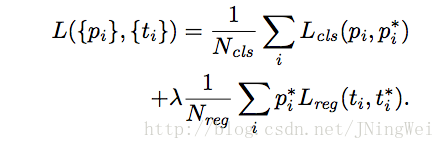

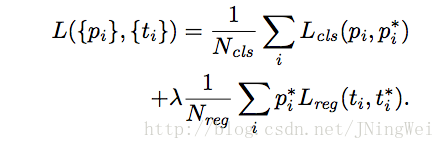

整体损失函数 具体为:

[1] Faster R-CNN原理介绍

[2] 深度网络中softmax_loss、Smooth L1 loss计算以及反向传播推导

SmoothL1公式 为:

整体损失函数 具体为:

[1] Faster R-CNN原理介绍

[2] 深度网络中softmax_loss、Smooth L1 loss计算以及反向传播推导

相关文章推荐

- 深度网络中softmax_loss、Smooth L1 loss计算以及反向传播推导

- 深度学习: softmax loss 计算

- 深度学习之数值计算(二)poor conditioning

- 百度DMLC分布式深度机器学习开源项目(简称“深盟”)上线了如xgboost(速度快效果好的Boosting模型)、CXXNET(极致的C++深度学习库)、Minerva(高效灵活的并行深度学习引擎)以及Parameter Server(一小时训练600T数据)等产品,在语音识别、OCR识别、人脸识别以及计算效率提升上发布了多个成熟产品。

- Faster RCNN训练出现问题:smooth_L1_loss_layer.cpp:28] Check failed: bottom[0]->channels() == bottom[1]->cha

- 认知计算与深度学习

- 深度学习/高性能计算解决方案架构师

- 深度学习网络模型训练中loss为nans的总结

- 深度学习在单图像超分辨率上的应用:SRCNN、Perceptual loss、SRResNet

- 京东DNN实验室:大数据、深度学习与计算平台的实践

- Win7(64位)+VS2013+cuda7.5环境下搭建深度学习Caffe计算框架

- 【深度学习-CNN】CNN中的参数与计算量

- Tensorflow 实战google深度学习框架 09 计算图保存,与模型读取

- 谢源:计算存储一体化,在存储里做深度学习,架构创新实现下一代AI芯片

- 二十一世纪计算 | 深度学习革命: 进展、前景和困境

- 神经网络和深度学习-第二周神经网络基础-第八节:计算图的导数计算

- 神经网络和深度学习-第二周神经网络基础-第八节:计算图的导数计算

- 深度学习loss函数理解

- 深度学习笔记——Word2vec和Doc2vec应用举例:词和句子的相似度计算

- 深度学习之数值计算 (一)overflow and underflow