【基本知识】Flume基本环境搭建以及原理

系统:CentOS6.5

JDK:1.8.0_144

Flume:flume-ng-1.6.0-cdh5.12.0

一、什么是Flume

flume 作为 cloudera 开发的实时日志收集系统,受到了业界的认可与广泛应用。Flume 初始的发行版本目前被统称为 Flume OG(original generation),属于 cloudera。但随着 FLume 功能的扩展,Flume OG 代码工程臃肿、核心组件设计不合理、核心配置不标准等缺点暴露出来,尤其是在 Flume OG 的最后一个发行版本 0.94.0 中,日志传输不稳定的现象尤为严重,为了解决这些问题,2011 年 10 月 22 号,cloudera 完成了 Flume-728,对 Flume 进行了里程碑式的改动:重构核心组件、核心配置以及代码架构,重构后的版本统称为 Flume NG(next generation);改动的另一原因是将 Flume 纳入 apache 旗下,cloudera Flume 改名为 Apache Flume。

flume的特点:

flume是一个分布式、可靠、和高可用的海量日志采集、聚合和传输的系统。支持在日志系统中定制各类数据发送方,用于收集数据;同时,Flume提供对数据进行简单处理,并写到各种数据接受方(比如文本、HDFS、Hbase等)的能力 。

flume的数据流由事件(Event)贯穿始终。事件是Flume的基本数据单位,它携带日志数据(字节数组形式)并且携带有头信息,这些Event由Agent外部的Source生成,当Source捕获事件后会进行特定的格式化,然后Source会把事件推入(单个或多个)Channel中。你可以把Channel看作是一个缓冲区,它将保存事件直到Sink处理完该事件。Sink负责持久化日志或者把事件推向另一个Source。

flume的可靠性 :

当节点出现故障时,日志能够被传送到其他节点上而不会丢失。Flume提供了三种级别的可靠性保障,从强到弱依次分别为:end-to-end(收到数据agent首先将event写到磁盘上,当数据传送成功后,再删除;如果数据发送失败,可以重新发送。),Store on failure(这也是scribe采用的策略,当数据接收方crash时,将数据写到本地,待恢复后,继续发送),Besteffort(数据发送到接收方后,不会进行确认)。

flume的可恢复性:

还是靠Channel。推荐使用FileChannel,事件持久化在本地文件系统里(性能较差)。

二、Flume工作原理

Flume的数据流由事件(Event)贯穿始终。事件是Flume的基本数据单位,它携带日志数据(字节数组形式)并且携带有头信息,这些Event由Agent外部的Source生成,当Source捕获事件后会进行特定的格式化,然后Source会把事件推入(单个或多个)Channel中。可以把Channel看作是一个缓冲区,它将保存事件直到Sink处理完该事件。Sink负责持久化日志或者把事件推向另一个Source。以下是Flume的一些核心概念:

(1)Events:一个数据单元,带有一个可选的消息头,可以是日志记录、avro 对象等。

(2)Agent:JVM中一个独立的Flume进程,每台机器运行一个Agent,但一个Agent可以包含多个Source、Channel、Sink组件。

(3)Client:运行于一个独立线程,用于生产数据并将其发送给Agent。

(4)Source:用来消费传递到该组件的Event,从Client收集数据,传递给Channel。

(5)Channel:中转Event的一个临时存储,保存Source组件传递过来的Event,其实就是连接 Source 和 Sink ,有点像一个消息队列。

(6)Sink:从Channel收集数据,运行在一个独立线程。

Flume以Agent为最小的独立运行单位,一个Agent就是一个JVM。单Agent由Source、Sink和Channel三大组件构成,如下图所示:

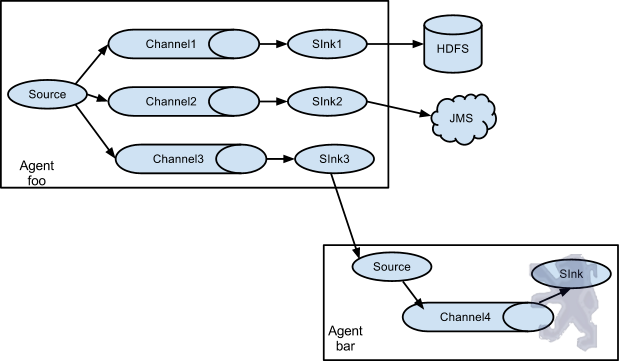

值得注意的是,Flume提供了大量内置的Source、Channel和Sink类型。不同类型的Source、Channel和Sink可以自由组合。组合方式基于用户设置的配置文件,非常灵活。比如:Channel可以把事件暂存在内存里,也可以持久化到本地硬盘上;Sink可以把日志写入HDFS、HBase、ES甚至是另外一个Source等等。Flume支持用户建立多级流,也就是说多个Agent可以协同工作,并且支持Fan-in、Fan-out、Contextual Routing、Backup Routes,这也正是NB之处。如图所示:

图1

图2

三、下载安装

1.需要JDK1.6+

2.下载版本分为CDH和Apache版本,如果是个人机器集群安装,建议使用CDH版本,CDH的各组件的版本号要对应

CDH5各组件下载地址:http://archive.cloudera.com/cdh5/cdh/5/

3.将下载的包解压出来之后就已经完成了50%,剩下的内容就需要修改一些配置文件

4.设置环境变量

vim ~/.bash_profile

FLUME_HOME="/opt/module/flume" export PATH=$PATH:$FLUME_HOME/bin

source ~/.bash_profile

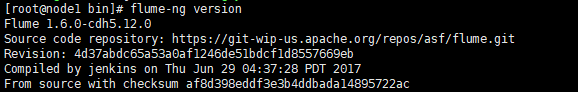

验证

/opt/module/flume/bin/flume-ng version

四、修改配置文件

# 指定Agent的组件名称 sunny.sources = so1 sunny.channels = ch1 sunny.sinks = si1 # 指定Flume source要监听的路径(logs/flume目录要提前建立好) sunny.sources.so1.type = spooldir sunny.sources.so1.spoolDir = /usr/sunny/logs/flume # 指定Flume sink sunny.sinks.si1.type = logger # 绑定source和sink到channel上 sunny.sinks.si1.channel = ch1 sunny.sources.so1.channels = ch1 # 指定Flume channel sunny.channels.ch1.type = memory sunny.channels.ch1.capacity = 1000 sunny.channels.ch1.transactionCapacity = 100

五、启动

cd /opt/module/flume/ bin/flume-ng agent --conf conf --conf-file conf/flume.conf --name sunny -Dflume.root.logger=INFO,console

| 参数 | 作用 | 举例 |

|---|---|---|

| –conf 或 -c | 指定配置文件夹,包含flume-env.sh和log4j的配置文件 | –conf conf |

| –conf-file 或 -f | 配置文件地址 | –conf-file conf/flume.conf |

| –name 或 -n | agent名称 | –name a1 |

| -z | zookeeper连接字符串 | -z zkhost:2181,zkhost1:2181 |

| -p | zookeeper中的存储路径前缀 | -p /flume |

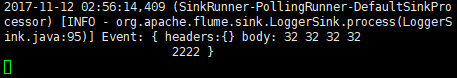

然后另开一个客户端,新增一个日志文件,编辑内容

cd /usr/sunny/logs/flume vim test.log

在开启的客户端就可以看到内容

六、其他source

1.Avro

# Name the components on this agent a1.sources = r1 a1.sinks = k1 a1.channels = c1 # Describe/configure the source a1.sources.r1.type = netcat a1.sources.r1.bind = localhost a1.sources.r1.port = 44444 # Describe the sink a1.sinks.k1.type = logger # Use a channel that buffers events in memory a1.channels.c1.type = memory a1.channels.c1.capacity = 1000 a1.channels.c1.transactionCapacity = 100 # Bind the source and sink to the channel a1.sources.r1.channels = c1 a1.sinks.k1.channel = c1

// 运行FlumeAgent,监听本机的44444端口 $ flume-ng agent -c conf -f example/netcat.conf -n a1 -Dflume.root.logger=INFO,console

// 打开另一终端,通过telnet登录localhost的44444,输入测试数据 $ telnet localhost 44444

2.Spool

Spool用于监测配置的目录下新增的文件,并将文件中的数据读取出来。需要注意两点:拷贝到spool目录下的文件不可以再打开编辑、spool目录下不可包含相应的子目录。具体示例如下:

// 创建两个Flume配置文件 $ cd app/cdh/flume-1.6.0-cdh5.7.1 $ cp conf/flume-conf.properties.template example/spool1.conf $ cp conf/flume-conf.properties.template example/spool2.conf

// 配置spool1.conf用于监控目录avro_data的文件,将文件内容发送到本地60000端口 $ vim example/spool1.conf # Namethe components local1.sources= r1 local1.sinks= k1 local1.channels= c1 # Source local1.sources.r1.type= spooldir local1.sources.r1.spoolDir= /home/hadoop/avro_data # Sink local1.sinks.k1.type= avro local1.sinks.k1.hostname= localhost local1.sinks.k1.port= 60000 #Channel local1.channels.c1.type= memory # Bindthe source and sink to the channel local1.sources.r1.channels= c1 local1.sinks.k1.channel= c1

// 配置spool2.conf用于从本地60000端口获取数据并写入HDFS # Namethe components a1.sources= r1 a1.sinks= k1 a1.channels= c1 # Source a1.sources.r1.type= avro a1.sources.r1.channels= c1 a1.sources.r1.bind= localhost a1.sources.r1.port= 60000 # Sink a1.sinks.k1.type= hdfs a1.sinks.k1.hdfs.path= hdfs://localhost:9000/user/wcbdd/flumeData a1.sinks.k1.rollInterval= 0 a1.sinks.k1.hdfs.writeFormat= Text a1.sinks.k1.hdfs.fileType= DataStream # Channel a1.channels.c1.type= memory a1.channels.c1.capacity= 10000 # Bind the source and sink to the channel a1.sources.r1.channels= c1 a1.sinks.k1.channel= c1

// 分别打开两个终端,运行如下命令启动两个Flume Agent $ flume-ng agent -c conf -f example/spool2.conf -n a1 $ flume-ng agent -c conf -f example/spool1.conf -n local1

// 查看本地文件系统中需要监控的avro_data目录内容 $ cd avro_data $ cat avro_data.txt

Flume内置了大量的Source,其中Avro Source、Thrift Source、Spooling Directory Source、Kafka Source具有较好的性能和较广泛的使用场景。下面是Source的一些参考资料:

(1)*******

(2)*******

(3)*******

(4)*******

(5)*******

(6)*******

(7)*******

(8)*******

七、Flume所支持的Sources、Channels、Sinks

| Sources | Channels | Sinks |

|---|---|---|

|

|

|

- mysql 复制 总结(一) 基本概念以及环境搭建

- Spring mvc 环境搭建以及基本应用

- 刚搭建的linux环境的基本优化以及优化脚本---菜鸟初写

- HLS 基本知识及环境搭建

- ArcGIS API for JavaScript开发环境搭建与发布以及基本功能实现

- java基础 day01 基础知识环境搭建以及注释

- android环境的搭建以及基本控件介绍

- OpenGL学习笔记(一):环境搭建、三维空间坐标系理解以及OpenGL的基本使用

- solr环境的搭建以及基本的使用方法

- java语言的跨平台原理以及环境的搭建

- Swift的开发环境搭建以及基本语法详解

- Cadence基础知识2(环境搭建、原理图库制作、原理图绘制、快捷键)

- mysql集群搭建一——集群基本概念以及windows集群环境搭建

- spring基本环境搭建,以及需要用到的一些包

- linux 基本操作以及搭建Java开发环境

- 对struts2的基本知识和环境的搭建(配图解)

- JSP运行原理以及Windows平台下JSP环境的搭建

- kafka学习(一) ---- 基本概念以及环境搭建

- 学习MyBatis从零开始_01(基础环境搭建以及基本使用)

- 设计配色的基本知识以及原理