【机器学习】逻辑回归(Linear Regression)模型推导

2017-11-01 16:29

651 查看

LR中文翻译作逻辑斯蒂回归,用于二分类。为什么回归和分类搅在一起了呢。因为可以这样想:线性回归 y=θTx 得到的结果是一个实数。如果我们将这个结果“压缩”到 [0,1] 之间,那么就可以表示概率接近1的程度,进而可以用来二分类。

最简单的“压缩”可以是单位阶跃函数:

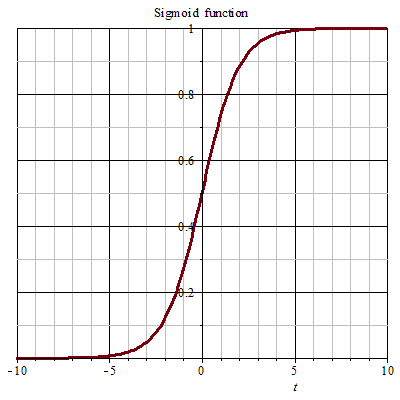

但单位阶跃函数是不连续的,在求导的过程中会产生问题。所以,我们用sigmoid函数来近似单位阶跃函数:

σ(x)=11+e−x

可以看到,在0附近其函数值变化较快。

从而我们得到:

样本 xi 属于1的概率:

hθ(xi)=p(yi=1|xi)=σ(θTxi)=11+e−θTxi

样本 xi 属于0的概率:

p(yi=0|xi)=1−σ(θTxi)=e−θTxi1+e−θTxi

将两式合并:

p(y|x)=(hθ(x))y(1−hθ(x))1−y

对所有样本取最大似然:

L(θ)=∏i=1mp(yi|xi)

记 hθ(x)=g(θTx)=11+e−θTx

取对数得:

l(θ)=logL(θ)=log∏i=1mp(yi|xi)=∑i=1mlogp(yi|xi)=∑i=1mlog[(hθ(xi))yi(1−hθ(xi))1−yi]=∑i=1m[yilog(hθ(xi))+(1−yi)log(1−hθ(xi))]=∑i=1m[yilog(g(θTxi))+(1−yi)log(1−g(θTxi))]

sigmoid函数导数形式为: σ′(x)=σ(x)(1−σ(x))

参数第 j 个分量的梯度:

∂l(θ)∂θj=∑i=1m[yi1g∂g∂θj−(1−yi)11−g∂g∂θj]=∑i=1m[yi1gg′∂(θTxi)∂θj−(1−yi)11−gg′∂(θTxi)∂θj]=∑i=1m[yi1gg(1−g)xji−(1−yi)11−gg(1−g)xji]=∑i=1m(yi−g(θTxi))xji

由于要求最大似然,所以用梯度上升法:

θjk+1=θjk+η∑i=1m(yi−g(θTkxi))xji

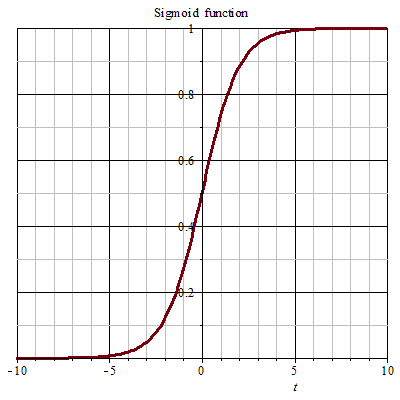

最简单的“压缩”可以是单位阶跃函数:

但单位阶跃函数是不连续的,在求导的过程中会产生问题。所以,我们用sigmoid函数来近似单位阶跃函数:

σ(x)=11+e−x

可以看到,在0附近其函数值变化较快。

从而我们得到:

样本 xi 属于1的概率:

hθ(xi)=p(yi=1|xi)=σ(θTxi)=11+e−θTxi

样本 xi 属于0的概率:

p(yi=0|xi)=1−σ(θTxi)=e−θTxi1+e−θTxi

将两式合并:

p(y|x)=(hθ(x))y(1−hθ(x))1−y

对所有样本取最大似然:

L(θ)=∏i=1mp(yi|xi)

记 hθ(x)=g(θTx)=11+e−θTx

取对数得:

l(θ)=logL(θ)=log∏i=1mp(yi|xi)=∑i=1mlogp(yi|xi)=∑i=1mlog[(hθ(xi))yi(1−hθ(xi))1−yi]=∑i=1m[yilog(hθ(xi))+(1−yi)log(1−hθ(xi))]=∑i=1m[yilog(g(θTxi))+(1−yi)log(1−g(θTxi))]

sigmoid函数导数形式为: σ′(x)=σ(x)(1−σ(x))

参数第 j 个分量的梯度:

∂l(θ)∂θj=∑i=1m[yi1g∂g∂θj−(1−yi)11−g∂g∂θj]=∑i=1m[yi1gg′∂(θTxi)∂θj−(1−yi)11−gg′∂(θTxi)∂θj]=∑i=1m[yi1gg(1−g)xji−(1−yi)11−gg(1−g)xji]=∑i=1m(yi−g(θTxi))xji

由于要求最大似然,所以用梯度上升法:

θjk+1=θjk+η∑i=1m(yi−g(θTkxi))xji

相关文章推荐

- (斯坦福机器学习课程笔记)用广义线性模型推导逻辑回归模型

- [置顶] 吴恩达机器学习笔记——指数分布族&广义线性模型&逻辑回归概率模型推导

- 机器学习-逻辑回归-参数迭代公式推导

- 逻辑回归模型的代价函数对参数的偏导数--推导过程

- 机器学习之逻辑回归改善模型

- 机器学习之逻辑斯提回归(Logistic Regression)模型

- 机器学习——线性模型之逻辑回归

- 机器学习逻辑回归模型总结——从原理到sklearn实践

- 机器学习模型(二)最大熵模型与逻辑斯蒂回归模型

- python机器学习库sklearn——数据归一化、标准化、特征选择、逻辑回归、贝叶斯分类器、KNN模型、支持向量机、参数优化

- 逻辑回归模型及LBFGS的Sherman Morrison(SM) 公式推导

- 机器学习 —— 基础整理(五)线性回归;二项Logistic回归;Softmax回归及其梯度推导;广义线性模型

- 机器学习(二)广义线性模型:逻辑回归与Softmax分类

- [小白式机器学习(一)] logistic regression(LR)对数几率回归 / 逻辑回归 公式推导

- [小白式机器学习(一)] logistic regression(LR)对数几率回归 / 逻辑回归 公式推导

- 机器学习总结(二)——逻辑斯谛回归和最大熵模型

- [置顶] 【机器学习 sklearn】逻辑斯蒂回归模型--Logistics regression

- 机器学习逻辑回归模型总结——从原理到sklearn实践

- 机器学习模型——逻辑回归Logistic Regression

- 转载-机器学习-逻辑回归-参数迭代公式推导