Spark整合Hive

2017-10-23 17:34

197 查看

安装hive

解压hive到指定的目录中,一般解压在/usr/local/hive

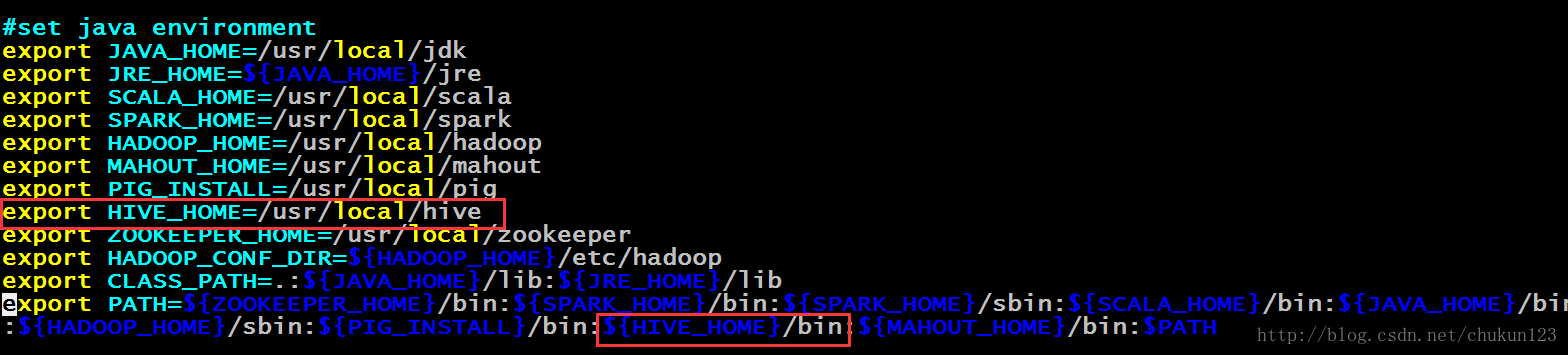

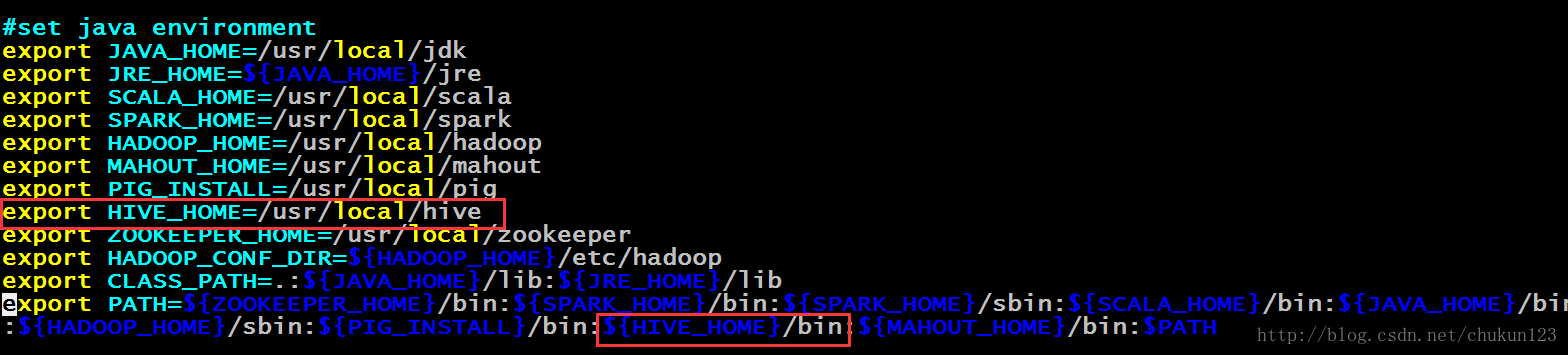

配置系统环境

配置hive-env.sh的环境

配置hadoop的家目录,配置hive的家目录,已及配置hive配置文件的目录

配置hive-site.xml

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

注意,我用的是windows下的mysql,还有,将mysql的驱动jar包放在hive的lib下

启动hive,启动之前必须初始化数据库:我初始化的是mysql数据库

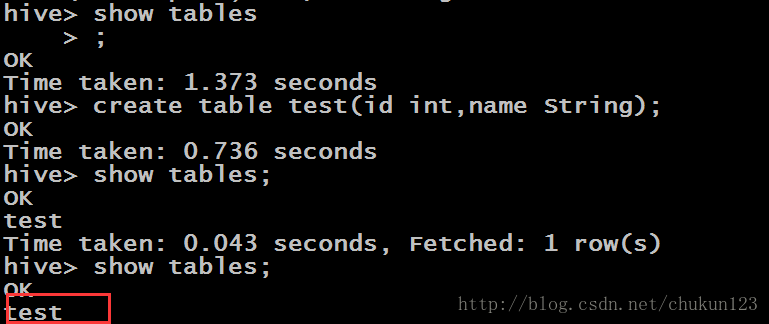

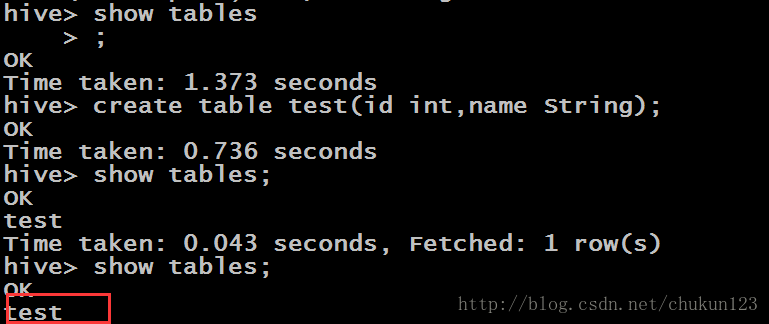

启动hive

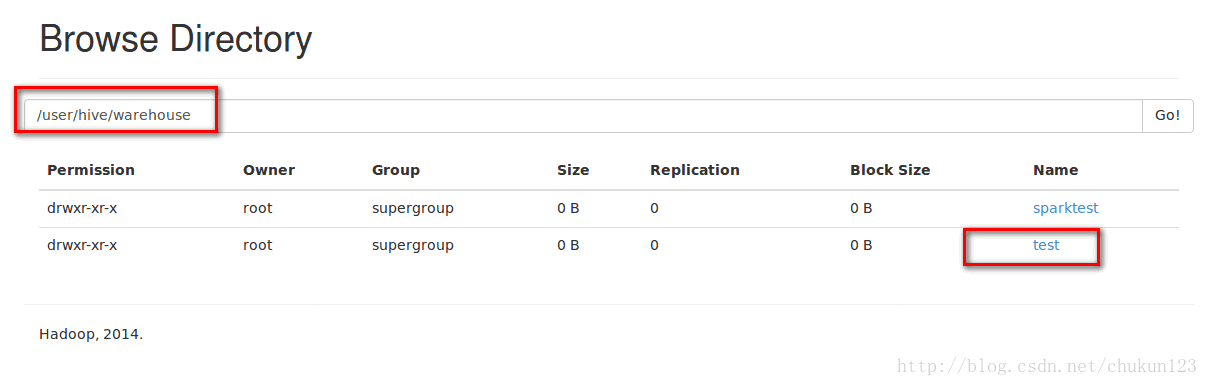

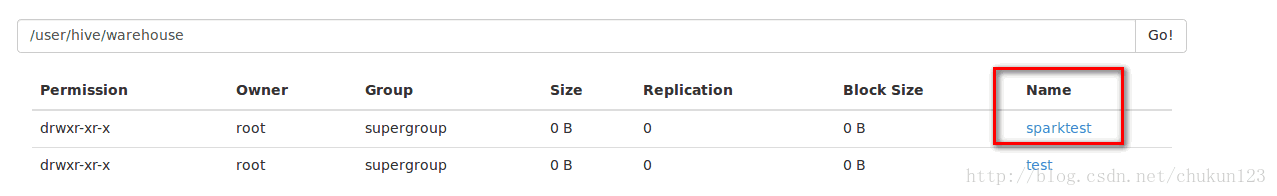

HDFS上面也有建好的数据表

启动spark,启动之前将mysql的驱动包,加入到spark的lib下

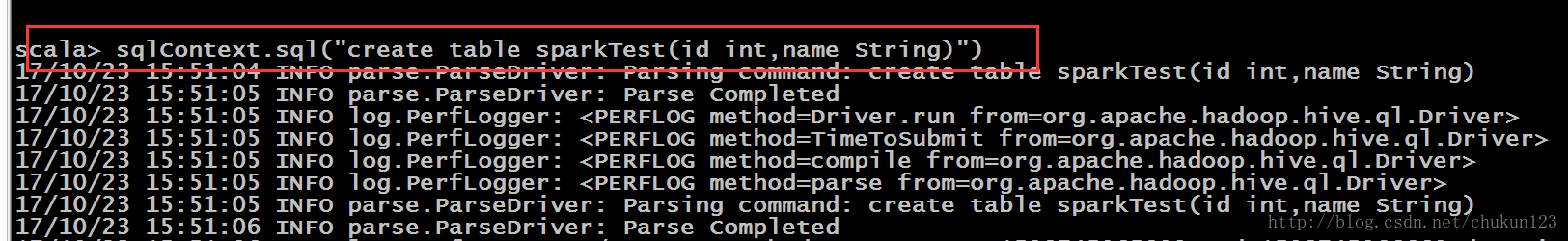

启动spark-shell

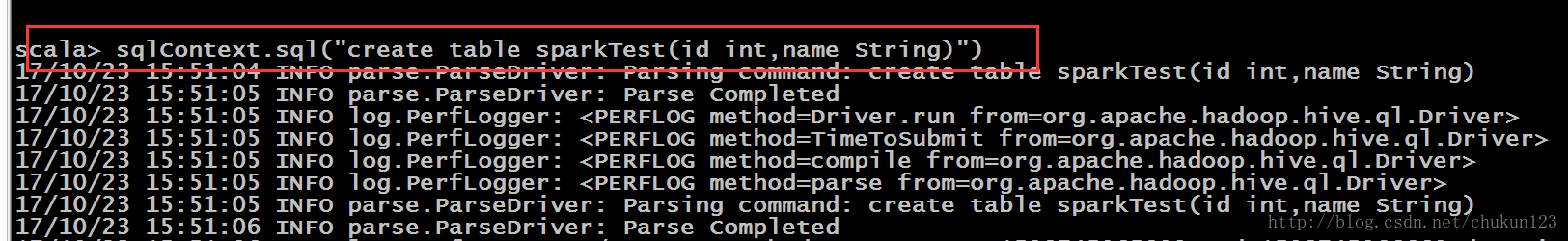

建表:

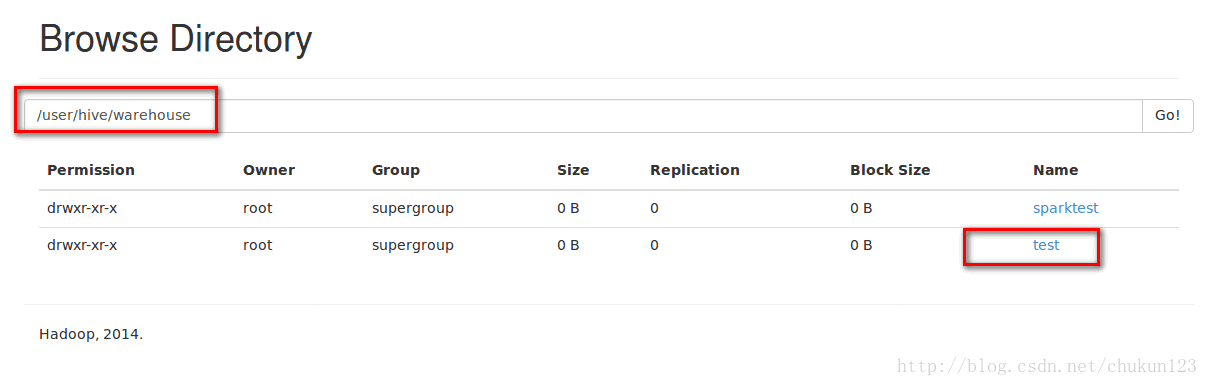

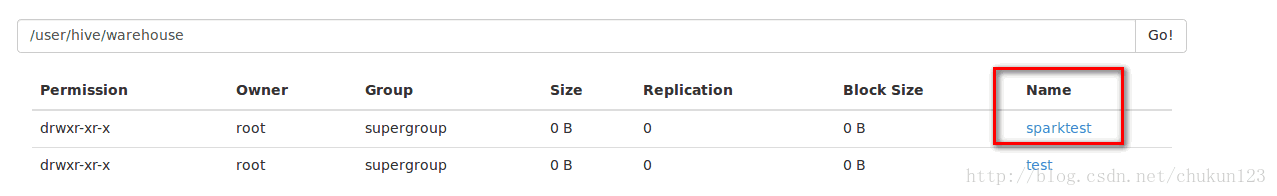

HDFS上面也有spark建好的数据表

Spark整合hive完毕

宁波注射除皱医院http://www.iyestar.com/wzx/zscz/

解压hive到指定的目录中,一般解压在/usr/local/hive

tar -zxvf hive-xxx.tar.gz1

配置系统环境

配置hive-env.sh的环境

配置hadoop的家目录,配置hive的家目录,已及配置hive配置文件的目录

配置hive-site.xml

<property> <name>hive.metastore.local</name> <value>true</value> <description/> </property> <!--配置mysql--> <property> <name>javax.jdo.option.ConnectionURL</name> <value>jdbc:mysql://192.168.1.3:3306/hive</value> <description/> </property> <property> <name>javax.jdo.option.ConnectionDriverName</name> <value>com.mysql.jdbc.Driver</value> <description/> </property> <property> <name>javax.jdo.option.ConnectionUserName</name> <value>root</value> <description/> </property> <property> <name>javax.jdo.option.ConnectionPassword</name> <value>mysql</value> <description/> </property>1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

注意,我用的是windows下的mysql,还有,将mysql的驱动jar包放在hive的lib下

启动hive,启动之前必须初始化数据库:我初始化的是mysql数据库

./schemaTool --initSchema --dbType mysql1

启动hive

./hive1

HDFS上面也有建好的数据表

启动spark,启动之前将mysql的驱动包,加入到spark的lib下

启动spark-shell

建表:

HDFS上面也有spark建好的数据表

Spark整合hive完毕

宁波注射除皱医院http://www.iyestar.com/wzx/zscz/

相关文章推荐

- 大数据学习系列之九---- Hive整合Spark和HBase以及相关测试

- spark1.4版本与CDH5.1.3版本hive整合

- spark整合hive和sql

- 大数据学习系列之九---- Hive整合Spark和HBase以及相关测试

- Shark & Hive & Spark & Hadoop2 进行整合的测试。

- Spark 整合hive 实现数据的读取输出

- 5、Spark整合Hive、HDFS,以及sqlContext的使用

- Spark-1.3.1与Hive整合实现查询分析

- Spark SQL整合Hive使用

- Spark整合Hive

- 实战 - Spark SQL 整合Hive时,报错找不到mysql驱动

- 大数据学习系列之九---- Hive整合Spark和HBase以及相关测试

- 3.sparkSQL整合Hive

- SparkSQL与Hive的整合

- SparkSQL与Hive的整合

- spark-2.0.0与hive-1.2.1整合

- Spark整合HBase,Hive

- spark sql与hive整合

- Spark-1.3.1与Hive整合实现查询分析

- Spark和hive整合的时候出现问题