逻辑回归算法之交叉熵函数理解

2017-10-16 18:28

393 查看

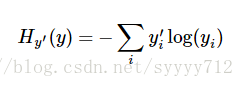

之前看到Tensorflow中文社区网站(http://www.tensorfly.cn/tfdoc/tutorials/mnist_beginners.htm)中训练MNIST数据集有一个交叉熵函数,

当时不是特别理解,想了很久为什么这个函数就可以表示代价函数,后来经过学习吴恩达课程之后明白了,如果有初学者一开始想不明白这个函数,可以参考我以下的解释:

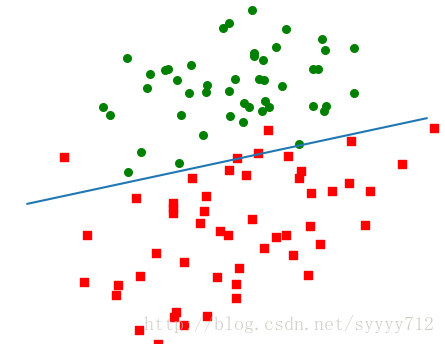

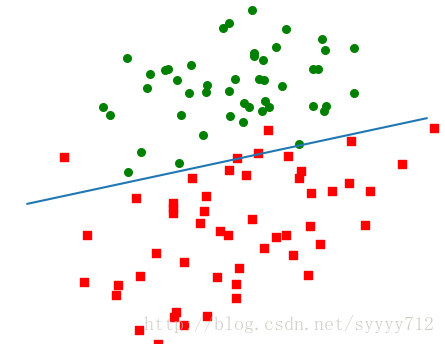

首先训练MNIST数据集的算法采用的是分类算法,和我们上次模拟房价的线性回归不一样,对于分类算法输出值都是离散值,线性回归算法输出是连续值,接下来我们讲一下广泛使用且典型的二元逻辑回归算法,逻辑回归算法的总体思路是将样本进行聚类分类,同一类样本放一起,将不同类的样本分离,如下图

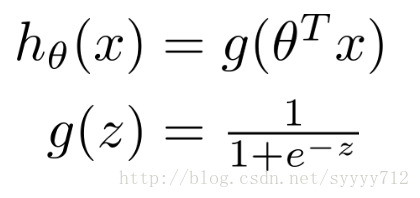

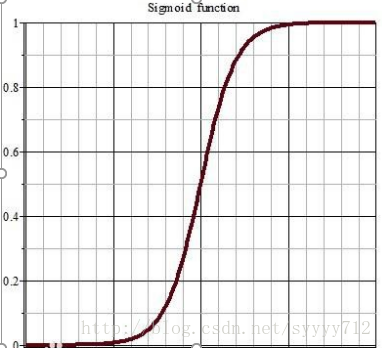

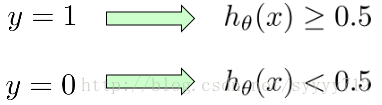

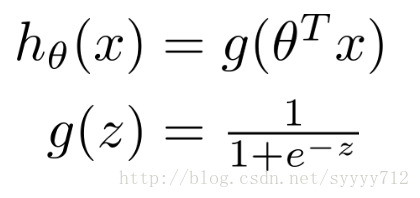

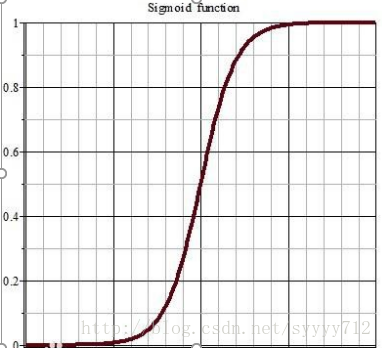

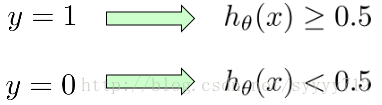

对于二元逻辑回归算法中,其输出值只能是0或者1。上节说到了线性回归模型的数学模型,现给出逻辑回归算法的数学模型,

当

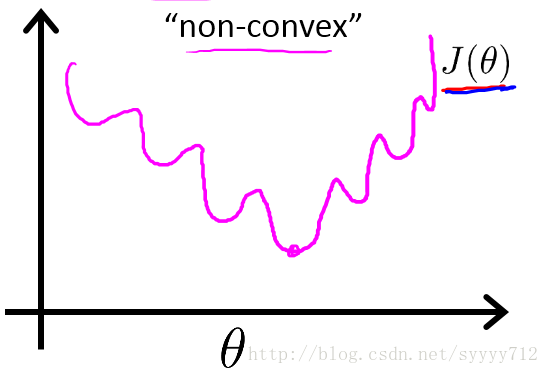

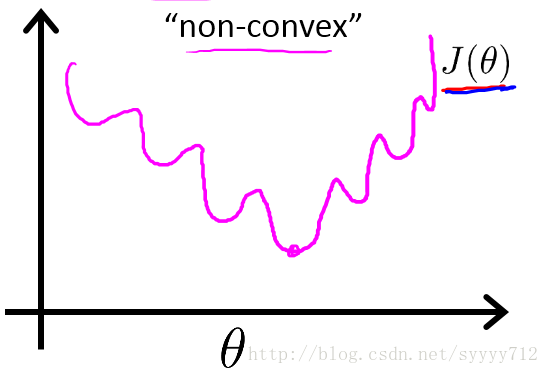

现已经给出了逻辑回归算法的数学模型,如果我们采用传统的平方误差函数,其画出的代价函数图就不会是一个凸函数,而是有很多局部最优点的歪歪扭扭的函数图像如下:

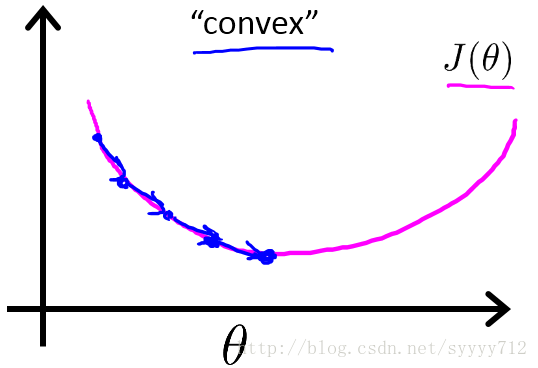

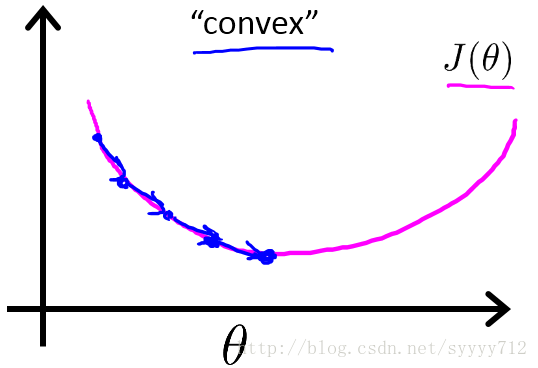

这类函数图像不是我们所想要的,因为有太多局部最优点了,我们需要一个全局最优点并且曲线光滑,如下图是我们所想要得到的代价函数曲线图

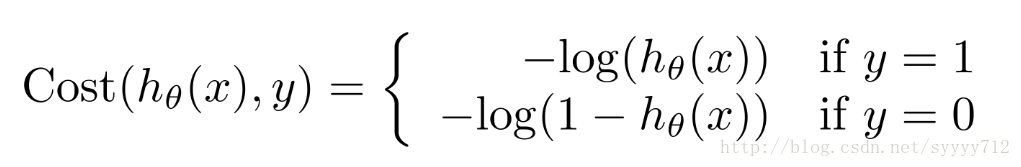

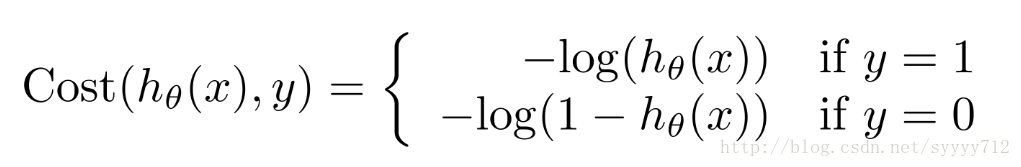

为了达到尽可能使得曲线光滑以及尽可能使得类似于像这种一元二次函数,因此我们给出代价函数表达式如下表示:

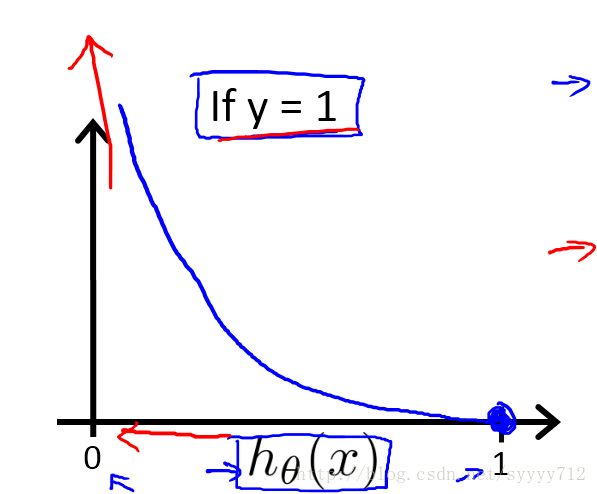

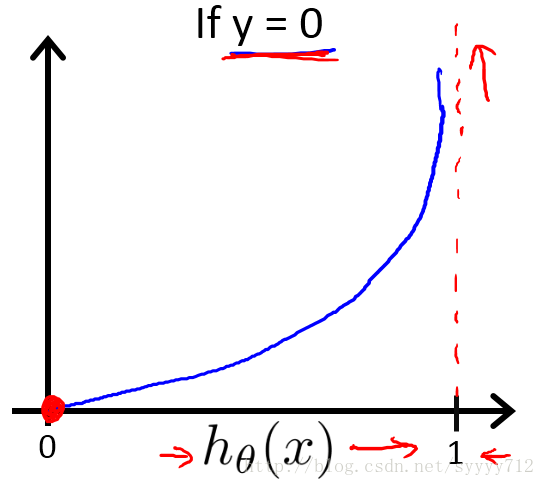

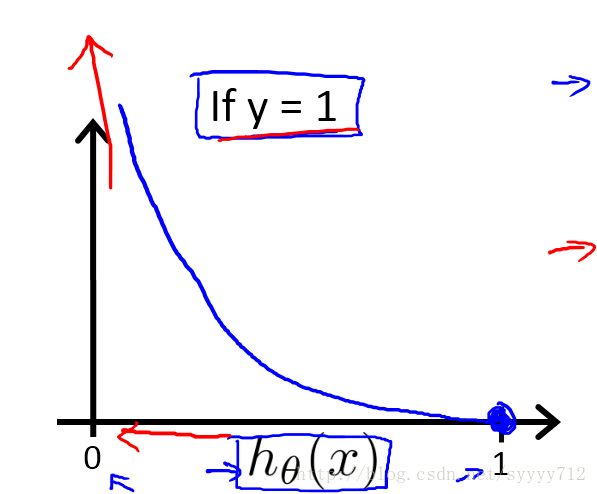

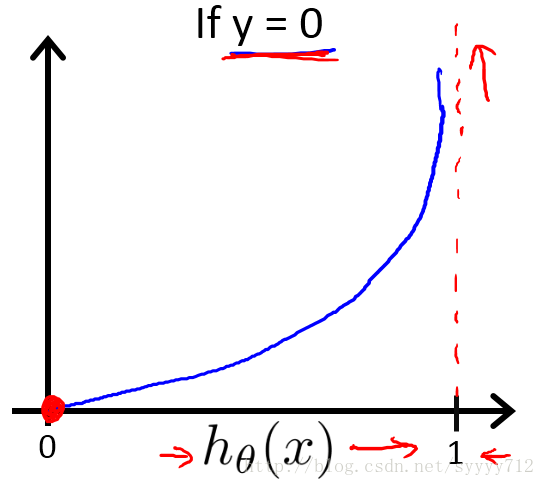

这个代价函数是一个分段函数,分别给出了y=0和y=1的代价函数图,从图中可以看出这个代价满足了凸函数的要求且没有局部最优点,只有全局最优点。

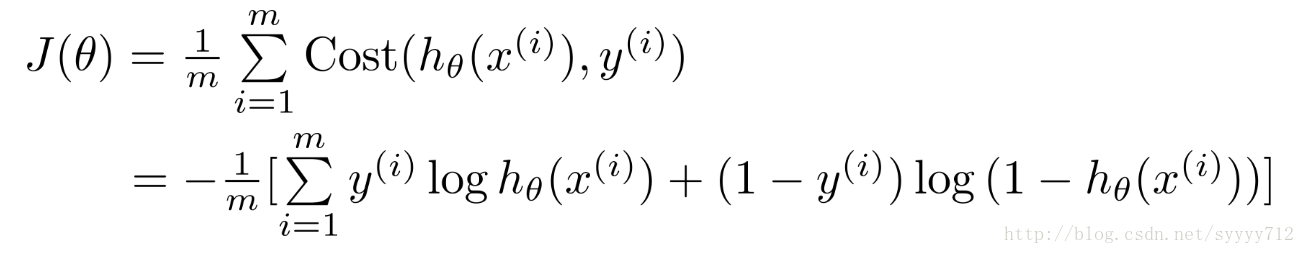

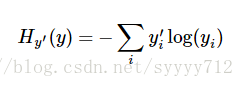

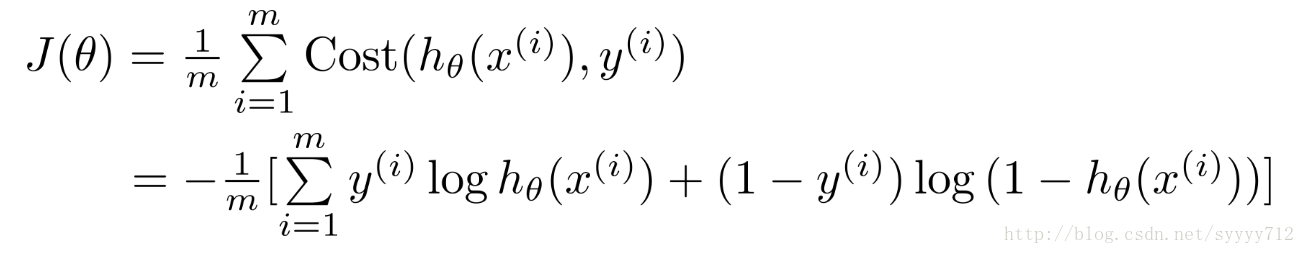

这是将分段函数组合成一个函数的表达式,看到这里应该明白了为什么训练MNIST用了交叉熵函数,因为这是一个分类问题,手写数字0-9,对应十个0和1标签,标签在某一个位置上为1代表对应的这个手写数字。标签值只有0和1,属于离散值,交叉熵函数对应了y=1的分段函数。以上是本人的理解,希望对您有所帮助!

当时不是特别理解,想了很久为什么这个函数就可以表示代价函数,后来经过学习吴恩达课程之后明白了,如果有初学者一开始想不明白这个函数,可以参考我以下的解释:

首先训练MNIST数据集的算法采用的是分类算法,和我们上次模拟房价的线性回归不一样,对于分类算法输出值都是离散值,线性回归算法输出是连续值,接下来我们讲一下广泛使用且典型的二元逻辑回归算法,逻辑回归算法的总体思路是将样本进行聚类分类,同一类样本放一起,将不同类的样本分离,如下图

对于二元逻辑回归算法中,其输出值只能是0或者1。上节说到了线性回归模型的数学模型,现给出逻辑回归算法的数学模型,

当

现已经给出了逻辑回归算法的数学模型,如果我们采用传统的平方误差函数,其画出的代价函数图就不会是一个凸函数,而是有很多局部最优点的歪歪扭扭的函数图像如下:

这类函数图像不是我们所想要的,因为有太多局部最优点了,我们需要一个全局最优点并且曲线光滑,如下图是我们所想要得到的代价函数曲线图

为了达到尽可能使得曲线光滑以及尽可能使得类似于像这种一元二次函数,因此我们给出代价函数表达式如下表示:

这个代价函数是一个分段函数,分别给出了y=0和y=1的代价函数图,从图中可以看出这个代价满足了凸函数的要求且没有局部最优点,只有全局最优点。

这是将分段函数组合成一个函数的表达式,看到这里应该明白了为什么训练MNIST用了交叉熵函数,因为这是一个分类问题,手写数字0-9,对应十个0和1标签,标签在某一个位置上为1代表对应的这个手写数字。标签值只有0和1,属于离散值,交叉熵函数对应了y=1的分段函数。以上是本人的理解,希望对您有所帮助!

相关文章推荐

- 对于《机器学习实战》中逻辑斯谛回归算法公式理解

- 逻辑回归 S函数 极大似然 这三者的理解 结合具体案例

- 【机器学习经典算法源码分析系列】-- 逻辑回归

- 机器学习逻辑回归:算法兑现为python代码

- 逻辑回归模型算法研究与案例分析

- 逻辑回归 代价函数 Java实现

- 机器学习故事汇-逻辑回归算法

- 逻辑回归二分类理解

- 逻辑回归和朴素贝叶斯算法实现二值分类(matlab代码)

- 《BI那点儿事》Microsoft 逻辑回归算法——预测股票的涨跌

- 局部加权回归、逻辑斯谛回归、感知器算法—斯坦福ML公开课笔记3

- 局部加权回归、逻辑斯蒂回归、感知器算法—斯坦福ML公开课笔记3

- 机器学习常用算法(3)逻辑回归

- <转>Spark Mllib逻辑回归算法分析

- derivative of cost function for Logistic Regression 逻辑回归代价函数偏导证明

- 逻辑回归、决策树和支持向量机的直观理解

- 机器学习各个算法2---逻辑回归

- 逻辑回归中代价函数求导推导

- 逻辑回归中代价函数的选择.凸优化问题

- Logistic Regression--逻辑回归算法汇总**