搭建ELK(ElasticSearch+Logstash+Kibana)日志分析系统(十) elasticsearch集群部署

2017-09-14 18:47

1321 查看

摘要:

这一节我们介绍elasticsearch集群的配置

搭建环境:

vmware 12.X + ubuntu 16.04两台 + elasticsearch 5.5.1 + logstash 5.5.1

1、首先,我们修改elasticsearch文件夹下/config下的elasticsearch.yml文件

第1个节点:我们让它作为master节点,只负责管理,不存储数据

第2个节点:我们让它作为data节点,不负责管理,只存储数据

2、在两个ubuntu系统中分别运行elasticsearch

主节点运行成功

数据节点运行成功

到这里,elsticsearch集群已经搭建成功了,接下来我们测试一下

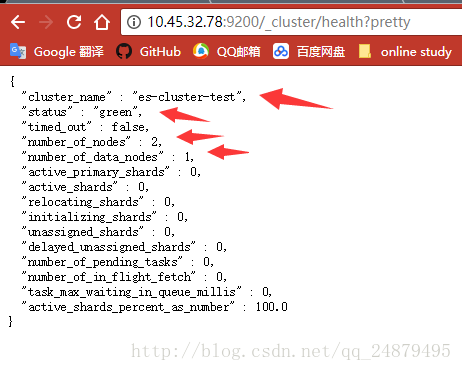

3、在外部windows中打开浏览器,分别访问两个elasticsearch

首先输入

结果为:

然后输入

4、然后我们在ip尾号为103的master节点上,运行logstash,配置文件依然为第6节中的配置文件,详见搭建ELK(ElasticSearch+Logstash+Kibana)日志分析系统(六) ElasticSearch demo演示

运行成功后输入

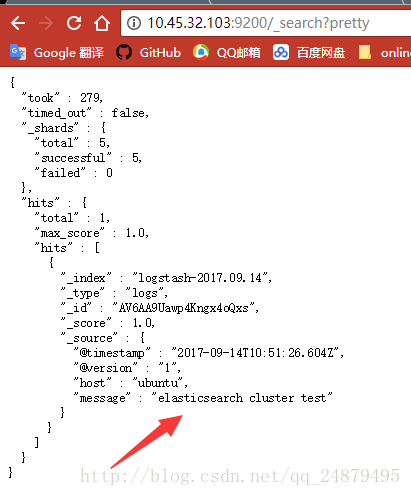

5、接着在外部windows中打开浏览器,分别访问两个elasticsearch

首先输入

结果为:

然后输入

结果为:

6、总结

在这个小集群当中,我们将10.45.32.78服务器上的elasticsearch设置为master节点,当时不存储数据;将10.45.32.103服务器上节点设置为数据节点。

集群跑起来之后,我们分别通过两个ip访问两个节点,得到的结果是一样的。

然后我们在78服务器上运行logstash,可以看到再次访问两个结点,都能看到输出的信息。

elk日志分析系统的强大,是不是开始体现出来了……

这一节我们介绍elasticsearch集群的配置

搭建环境:

vmware 12.X + ubuntu 16.04两台 + elasticsearch 5.5.1 + logstash 5.5.1

1、首先,我们修改elasticsearch文件夹下/config下的elasticsearch.yml文件

第1个节点:我们让它作为master节点,只负责管理,不存储数据

cluster.name: es-cluster-test node.name: node-master node.master: true node.data: false network.host: 10.45.32.103 ##第一台ubuntu的局域网ip http.port: 9200 discovery.zen.ping.unicast.hosts: ["10.45.32.78", "10.45.32.103"] discovery.zen.minimum_master_nodes: 1

第2个节点:我们让它作为data节点,不负责管理,只存储数据

cluster.name: es-cluster-test node.name: node-data node.master: false node.data: true network.host: 10.45.32.103 ##第一台ubuntu的局域网ip http.port: 9200 discovery.zen.ping.unicast.hosts: ["10.45.32.78", "10.45.32.103"] discovery.zen.minimum_master_nodes: 1

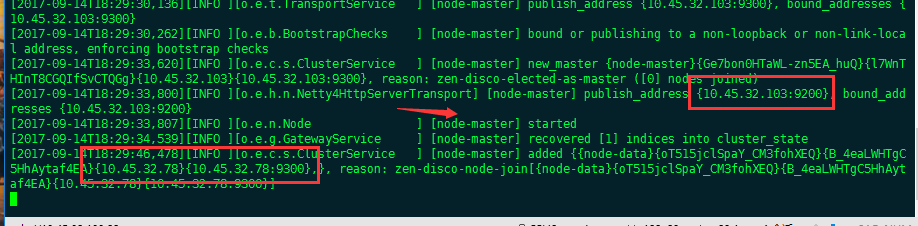

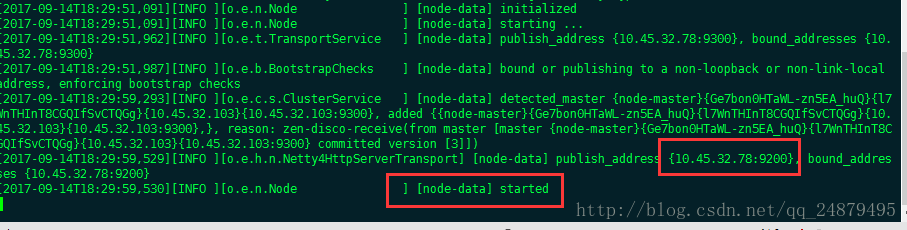

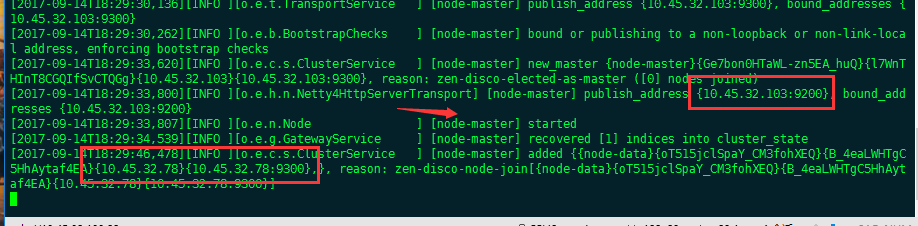

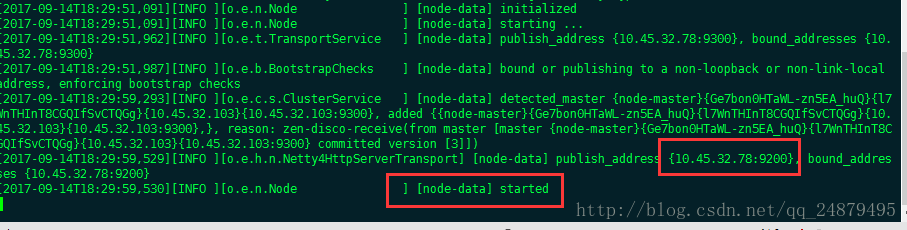

2、在两个ubuntu系统中分别运行elasticsearch

主节点运行成功

数据节点运行成功

到这里,elsticsearch集群已经搭建成功了,接下来我们测试一下

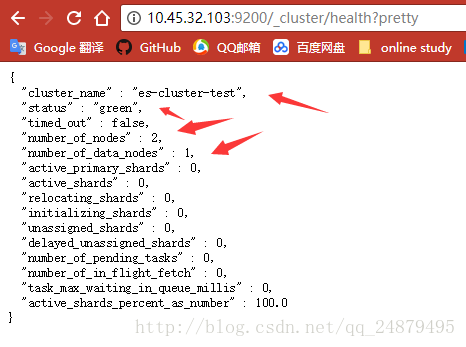

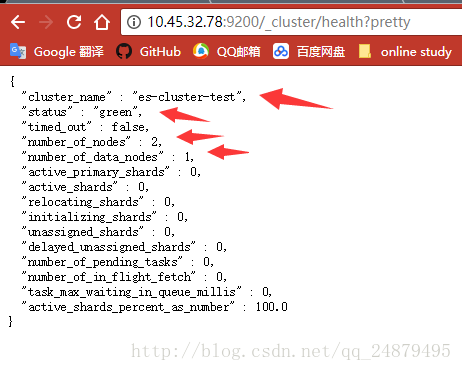

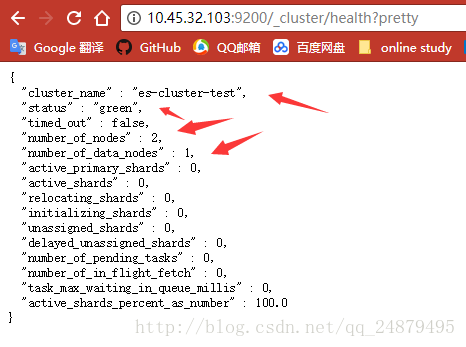

3、在外部windows中打开浏览器,分别访问两个elasticsearch

首先输入

http://10.45.32.103:9200/_cluster/health?pretty

结果为:

然后输入

http://10.45.32.78:9200/_cluster/health?pretty

4、然后我们在ip尾号为103的master节点上,运行logstash,配置文件依然为第6节中的配置文件,详见搭建ELK(ElasticSearch+Logstash+Kibana)日志分析系统(六) ElasticSearch demo演示

运行成功后输入

elasticsearch cluster test

5、接着在外部windows中打开浏览器,分别访问两个elasticsearch

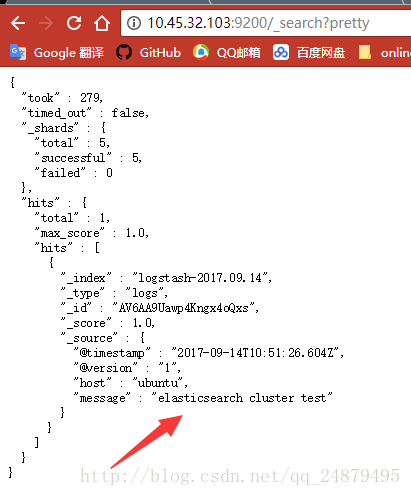

首先输入

http://10.45.32.103:9200/_search?pretty

结果为:

然后输入

http://10.45.32.78:9200/_search?pretty

结果为:

6、总结

在这个小集群当中,我们将10.45.32.78服务器上的elasticsearch设置为master节点,当时不存储数据;将10.45.32.103服务器上节点设置为数据节点。

集群跑起来之后,我们分别通过两个ip访问两个节点,得到的结果是一样的。

然后我们在78服务器上运行logstash,可以看到再次访问两个结点,都能看到输出的信息。

elk日志分析系统的强大,是不是开始体现出来了……

相关文章推荐

- ELK(日志分析系统): Elasticsearch + Logstash + Kibana集群环境部署及应用

- kubernetes上部署Fluentd+Elasticsearch+kibana日志收集系统

- ELK( ElasticSearch+ Logstash+ Kibana)分布式日志系统部署文档

- fluentd结合kibana、elasticsearch实时搜索分析hadoop集群日志<转>

- logstash日志收集分析系统elasticsearch&kibana 推荐

- ELK(ElasticSearch, Logstash, Kibana)实时日志分析平台部署

- 用Kibana+Logstash+Elasticsearch快速搭建实时日志查询、收集与分析系统

- fluentd结合kibana、elasticsearch实时搜索分析hadoop集群日志

- fluentd结合kibana、elasticsearch实时搜索分析hadoop集群日志

- 部署 elk 日志系统 elasticsearch、logstash、 kibana

- fluentd结合kibana、elasticsearch实时搜索分析hadoop集群日志

- 实时日志收集-查询-分析系统(Flume+ElasticSearch+Kibana)

- 实时日志收集-查询-分析系统(Flume+ElasticSearch+Kibana)

- Flume-ng 1.6.0+ Elasticsearch 1.7.2+ Kibana4 日志收集分析系统环境搭建及介绍

- 搭建ELK(ElasticSearch+Logstash+Kibana)日志分析系统(八) elasticsearch配置外网访问及常见错误处理

- 用Kibana+Logstash+Elasticsearch快速搭建实时日志查询、收集与分析系统

- fluentd结合kibana、elasticsearch实时搜索分析hadoop集群日志

- Flume1.7.0+Elasticsearch1.7.5+Kibana4.11日志收集分析系统环境搭建

- 搭建ELK(ElasticSearch+Logstash+Kibana)日志分析系统(七) elasticsearch.yml配置文件详细说明

- 实时日志收集-查询-分析系统(Flume+ElasticSearch+Kibana)