kNN(K-Nearest Neighbor)最邻近规则分类

2017-08-30 23:18

423 查看

基本想法:

在距离空间里,如果一个样本的最接近的k个邻居里,绝大多数属于某个类别,则该样本也属于这个类别。俗话叫,“随大流”。思路是:如果一个样本在特征空间的k个最相思(即特征空间中最近邻)的样本的大多数属于某一类别,则该样本也属于这一类别。

算法描述:

[plain]

view plain

copy

print?

1. 依公式计算 Item 与 D1、D2 … …、Dj 之相似度。得到Sim(Item, D1)、Sim(Item, D2)… …、Sim(Item, Dj)。

2. 将Sim(Item, D1)、Sim(Item, D2)… …、Sim(Item, Dj)排序,若是超过相似度阈值t则放入邻居案例集合NN。

3. 自邻居案例集合NN中取出前k名,依多数决,得到Item可能类别。

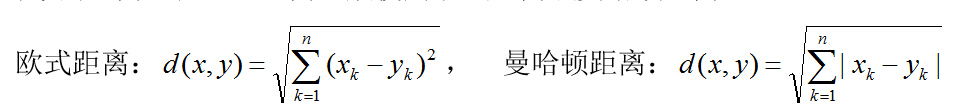

距离一般使用欧式距离或者曼哈顿距离:

KNN通过依据k个对象中占优的类别进行决策,而不是单一的对象类别决策。

参数K的选取:

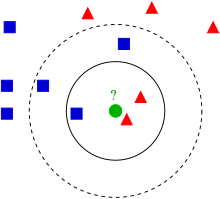

如何选择一个最佳的K值取决于数据。一般情况下,在分类时较大的K值能够减小噪声的影响。但会使类别之间的界限变得模糊。比如下图,

待测样本(绿色圆圈)既可能分到红色三角形类,也可能分到蓝色正方形类。如果k取3,从图可见,待测样本的3个邻居在实线的内圆里,按多数投票结果,它属于红色三角形类,票数1:2.但是如果k取5,那么待测样本的最邻近的5个样本在虚线的圆里,按表决法,它又属于蓝色正方形类,票数2(红色三角形):3(蓝色正方形)。

python实现

首先呢,需要说明的是本文用的是python3.4.3,用法与2.7有些出入,建立一个KNN.py文件对算法可行性进行验证。

#coding:utf-8

from numpy import *

import operator

##给出训练数据以及对应的类别

def createDataSet():

group = array([[1.0,2.0],[1.2,0.1],[0.1,1.4],[0.3,3.5]])

labels = ['A','A','B','B']

return group,labels

###通过KNN进行分类

def classify(input,dataSe t,label,k):

dataSize = dataSet.shape[0]

####计算欧式距离

diff = tile(input,(dataSize,1)) - dataSet

sqdiff = diff ** 2

squareDist = sum(sqdiff,axis = 1)###行向量分别相加,从而得到新的一个行向量

dist = squareDist ** 0.5

##对距离进行排序

sortedDistIndex = argsort(dist)##argsort()根据元素的值从大到小对元素进行排序,返回下标

classCount={}

for i in range(k):

voteLabel = label[sortedDistIndex[i]]

###对选取的K个样本所属的类别个数进行统计

classCount[voteLabel] = classCount.get(voteLabel,0) + 1

###选取出现的类别次数最多的类别

maxCount = 0

for key,value in classCount.items():

if value > maxCount:

maxCount = value

classes = key

return classes

接下来,在命令窗口输入:

#-*-coding:utf-8 -*-

import sys

sys.path.append("...文件路径...")

import KNN

from numpy import *

dataSet,labels = KNN.createDataSet()

input = array([1.1,0.3])

K = 3

output = KNN.classify(input,dataSet,labels,K)

print("测试数据为:",input,"分类结果为:",output)

回车之后结果为:

测试数据为:[1.1 0.3] 分类为:A

例子(电影分类):

| 电影名称 | 打斗次数 | 接吻次数 | 电影类型 |

| California Man | 3 | 104 | Romance |

| He’s Not Really into Dudes | 2 | 100 | Romance |

| Beautiful Woman | 1 | 81 | Romance |

| Kevin Longblade | 101 | 10 | Action |

| Robo Slayer 3000 | 99 | 5 | Action |

| Amped II | 98 | 2 | Action |

| 未知 | 18 | 90 | Unknown |

下面调用python的sklearn模块求解:(转自KNN算法介绍)

[python]

view plain

copy

print?

import numpy as np

from sklearn import neighbors

knn = neighbors.KNeighborsClassifier() #取得knn分类器

data = np.array([[3,104],[2,100],[1,81],[101,10],[99,5],[98,2]]) # <span style="font-family: Arial, Helvetica, sans-serif;">data对应着打斗次数和接吻次数</span>

labels = np.array([1,1,1,2,2,2]) #<span style="font-family: Arial, Helvetica, sans-serif;">labels则是对应Romance和Action</span>

knn.fit(data,labels) #导入数据进行训练'''

knn.predict([18,90])

说明:

首先,用labels数组中的1和2代表Romance和Aciton,因为sklearn不接受字符数组作为标志,只能用1,2这样的int型数据来表示,后面处理可以将1和2映射到Romance和Action上来。fit则是用data和labels进行训练,data对应的是打斗次数和接吻次数构成的向量,称之为特征向量。labels则是这个数据所代表的电影所属的类型。调用predict 进行预测,将未知电影的特征向量代入,则能分析出该未知电影所属的类型。此处计算结果为1,也就是该未知电影属于Romance,和直觉相符。

KNN属于比较完善的算法,但是由于其效率不是很高,因此现在很少有用,仅供参考!

相关文章推荐

- kNN(K-Nearest Neighbor)最邻近规则分类

- KNN最邻近规则分类算法实践实现【Python实现】

- 机器学习分类篇-最邻近规则分类KNN

- 机器学习——最邻近规则分类(K Nearest Neighbor)KNN算法

- 【机器学习】3.最邻近规则分类KNN算法

- kNN(K-Nearest Neighbor)最邻近规则分类

- 机器学习 -- KNN(k-Nearest Neighbor)最邻近规则分类算法

- 2-2 Python实现最邻近规则KNN分类应用

- kNN(K-Nearest Neighbor)最邻近规则分类

- 机器学习分类篇-最邻近规则分类KNN

- kNN(K-Nearest Neighbor)最邻近规则分类中的三大问题(K值选取、距离度量、分类决策规则)

- kNN(K-Nearest Neighbor)最邻近规则分类

- kNN(K-Nearest Neighbor)最邻近规则分类

- kNN(K-Nearest Neighbor)最邻近规则分类

- KNN(K-Nearest Neighbor)最邻近规则分类

- 机器学习算法:kNN(K-Nearest Neighbor)最邻近规则分类

- kNN(K-Nearest Neighbor)最邻近规则分类

- kNN(K-Nearest Neighbor)最邻近规则分类

- kNN(K-Nearest Neighbor)最邻近规则分类

- kNN(K-Nearest Neighbor)最邻近规则分类