机器学习实战精读--------logistic回归

2017-08-21 22:48

369 查看

Logistic回归的主要目的:寻找一个非线性函数sigmod最佳的拟合参数

拟合、插值和逼近是数值分析的三大工具

回归:对一直公式的位置参数进行估计

拟合:把平面上的一些系列点,用一条光滑曲线连接起来

logistic主要思想:根据现有数据对分类边界线建立回归公式、以此进行分类

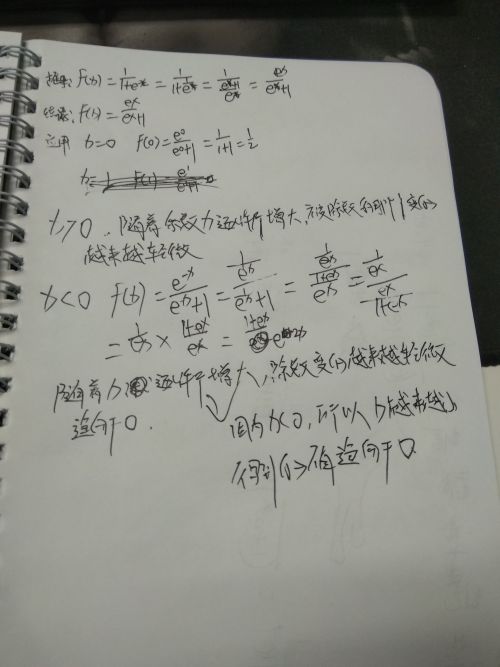

sigmoid函数:在神经网络中它是所谓的激励函数。当输入大于0时,输出趋向于1,输入小于0时,输出趋向0,输入为0时,输出为0.5

梯度上升:要找到某个函数的最大值,最好的方法是沿着该函数的梯度方向探寻

收敛:随着迭代的运行算法的结果和真实结果的误差越来越小,且趋向于一个固定值。

爬山算法:是完完全全的贪心算法,每次鼠目寸光的选择一个当前最优解,英雌只能搜寻到局部最优值

模拟退火算法:也是一种贪心算法但它的sou索过程引入了随机因素,模拟退火算法以一定的概念来接受一个比当前解要差的解,因此有可能会跳出这个局部最优解,达到全局最优解。

处理数据中的缺失值:

使用可用特征的均值来填补缺失值

使用特殊值来填补缺失值,如-1

忽略有缺失值的样本

使用相似样本的均值添补缺失值

使用其它机器学习算法预测缺失值

标签与特征不同,很难确定采用某个合适的值来替换。

拟合、插值和逼近是数值分析的三大工具

回归:对一直公式的位置参数进行估计

拟合:把平面上的一些系列点,用一条光滑曲线连接起来

logistic主要思想:根据现有数据对分类边界线建立回归公式、以此进行分类

sigmoid函数:在神经网络中它是所谓的激励函数。当输入大于0时,输出趋向于1,输入小于0时,输出趋向0,输入为0时,输出为0.5

梯度上升:要找到某个函数的最大值,最好的方法是沿着该函数的梯度方向探寻

收敛:随着迭代的运行算法的结果和真实结果的误差越来越小,且趋向于一个固定值。

爬山算法:是完完全全的贪心算法,每次鼠目寸光的选择一个当前最优解,英雌只能搜寻到局部最优值

模拟退火算法:也是一种贪心算法但它的sou索过程引入了随机因素,模拟退火算法以一定的概念来接受一个比当前解要差的解,因此有可能会跳出这个局部最优解,达到全局最优解。

处理数据中的缺失值:

使用可用特征的均值来填补缺失值

使用特殊值来填补缺失值,如-1

忽略有缺失值的样本

使用相似样本的均值添补缺失值

使用其它机器学习算法预测缺失值

标签与特征不同,很难确定采用某个合适的值来替换。

#coding:utf-8

from numpy import *

import math

def loadDataSet():

dataMat = []; labelMat = []

fr = open('testSet.txt')

for line in fr.readlines():

lineArr = line.strip().split()

dataMat.append([1.0, float(lineArr[0]), float(lineArr[1])])

labelMat.append(int(lineArr[2]))

return dataMat,labelMat

def sigmoid(inX):

return longfloat(1.0/(1+exp(-inX))) #sigmoid函数公式

def gradAscent(dataMatIn, classLabels):

#dataMatIn 一个2维的数组;classLabels 类别标签

dataMatrix = mat(dataMatIn) #转换为矩阵

labelMat = mat(classLabels).transpose() #得到矩阵的转置矩阵

m,n = shape(dataMatrix) #读取矩阵的长度,二维矩阵,返回两个值

alpha = 0.001 #向目标移动的步长

maxCycles = 500 #迭代次数

weights = ones((n,1)) #ones()函数用以创建指定形状和类型的数组,默认情况下返回的类型是float64。但是,如果使用ones()函数时指定了数据类型,那么返回的就是该类型

for k in range(maxCycles):

h = sigmoid(dataMatrix*weights) #matrix mult

error = (labelMat - h) #vector subtraction

weights = weights + alpha * dataMatrix.transpose()* error #matrix mult

return weights

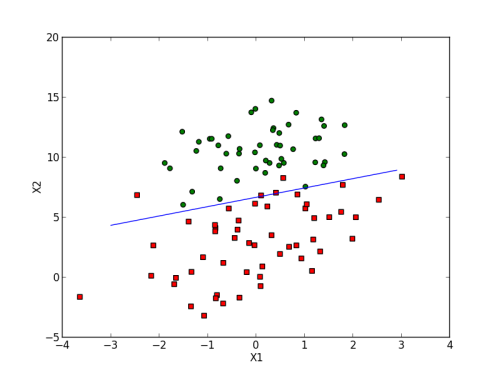

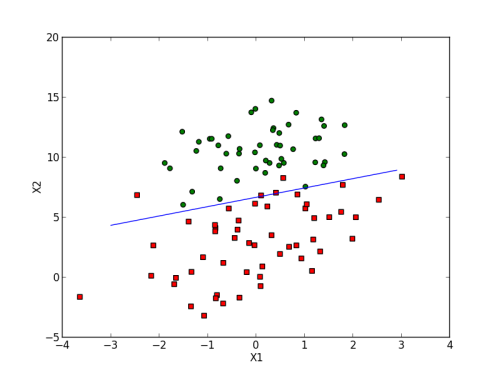

def plotBestFit(weights):

import matplotlib as mpl

mpl.use('Agg') #为了防止出现:RuntimeError: could not open display报错

import matplotlib.pyplot as plt

dataMat,labelMat=loadDataSet()

dataArr = array(dataMat)

n = shape(dataArr)[0]

xcord1 = []; ycord1 = []

xcord2 = []; ycord2 = []

for i in range(n):

if int(labelMat[i])== 1:

xcord1.append(dataArr[i,1]); ycord1.append(dataArr[i,2])

else:

xcord2.append(dataArr[i,1]); ycord2.append(dataArr[i,2])

fig = plt.figure() #figure: 控制dpi、边界颜色、图形大小、和子区( subplot)设置

ax = fig.add_subplot(111) # 参数111的意思是:将画布分割成1行1列,图像画在从左到右从上到下的第1块,

ax.scatter(xcord1, ycord1, s=30, c='red', marker='s')

ax.scatter(xcord2, ycord2, s=30, c='green')

x = arange(-3.0, 3.0, 0.1)

y = (-weights[0]-weights[1]*x)/weights[2]

ax.plot(x, y)

plt.xlabel('X1'); plt.ylabel('X2');

plt.savefig('plotBestFit.png') #因为我是腾讯云服务器,没有图形界面,所以我保存为图片。

#随机梯度上升算法

def stocGradAscent0(dataMatrix, classLabels):

m,n = shape(dataMatrix)

alpha = 0.01

weights = ones(n) #initialize to all ones

for i in range(m):

h = sigmoid(sum(dataMatrix[i]*weights))

error = classLabels[i] - h

weights = weights + alpha * error * dataMatrix[i] #回归系数的更新操作

return weights

#改进的随机梯度上升算法

def stocGradAscent1(dataMatrix, classLabels, numIter=150): #较之前的增加了一个迭代次数作为第三个参数,默认值150

m,n = shape(dataMatrix)

weights = ones(n)

for j in range(numIter):

dataIndex = range(m)

for i in range(m):

alpha = 4/(1.0+j+i)+0.0001

randIndex = int(random.uniform(0,len(dataIndex))) #样本随机选择

h = sigmoid(sum(dataMatrix[randIndex]*weights))

error = classLabels[randIndex] - h

weights = weights + alpha * error * dataMatrix[randIndex] #回归系数的更新操作

del(dataIndex[randIndex])

return weights

#以回归系数和特征向量作为输入计算对应的sigmoid值

def classifyVector(inX, weights):

prob = sigmoid(sum(inX*weights))

if prob > 0.5: return 1.0 #如果sigmoid值大于0.5函数返回1,否则返回0

else: return 0.0

#打开测试集和训练集,并对数据进行格式化处理的函数

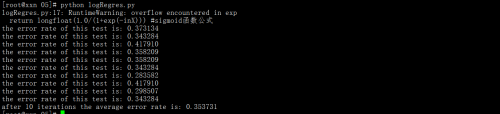

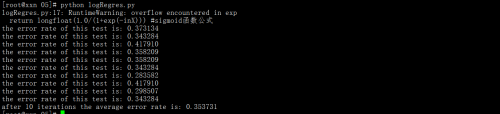

def colicTest():

frTrain = open('horseColicTraining.txt'); frTest = open('horseColicTest.txt')

trainingSet = []; trainingLabels = []

for line in frTrain.readlines():

currLine = line.strip().split('\t')

lineArr =[]

for i in range(21):

lineArr.append(float(currLine[i]))

trainingSet.append(lineArr)

trainingLabels.append(float(currLine[21]))

trainWeights = stocGradAscent1(array(trainingSet), trainingLabels, 1000) #计算回归系数向量

errorCount = 0; numTestVec = 0.0

for line in frTest.readlines():

numTestVec += 1.0

currLine = line.strip().split('\t')

lineArr =[]

for i in range(21):

lineArr.append(float(currLine[i]))

if int(classifyVector(array(lineArr), trainWeights))!= int(currLine[21]):

errorCount += 1

errorRate = (float(errorCount)/numTestVec)

print "the error rate of this test is: %f" % errorRate

return errorRate

#调用函数colicTest()10次,并求结果的平均值

def multiTest():

numTests = 10; errorSum=0.0

for k in range(numTests):

errorSum += colicTest()

print "after %d iterations the average error rate is: %f" % (numTests, errorSum/float(numTests))

相关文章推荐

- 【机器学习实战】5.Logistic回归(1)

- 机器学习实战精读--------决策树 推荐

- 机器学习实战精读--------K-均值聚类算法

- 【机器学习实战-python3】Logistic回归

- python机器学习实战4:Logistic回归

- 机器学习实战——第五章:Logistic回归

- Python学习-机器学习实战-ch05 Logistic回归

- 机器学习实战(4) ——Logistic回归(python实现)

- 机器学习实战之logistic回归

- 机器学习实战 - Logistic回归

- 机器学习实战第五章——Logistic回归

- 机器学习实战-Logistic回归

- 机器学习实战-logistic回归原理

- 机器学习实战精读--------朴素贝叶斯(NBC)

- 机器学习实战第五章 - Logistic回归(包括GD和SGD的比较)

- 机器学习实战:Logistic回归

- 机器学习实战精读--------FP-growth算法

- 机器学习实战代码详解(五)Logistic回归

- 机器学习实战第5章 Logistic回归的weights

- [机器学习实战] -Logistic回归