Python安装jieba包,进行分词

2017-07-17 18:44

471 查看

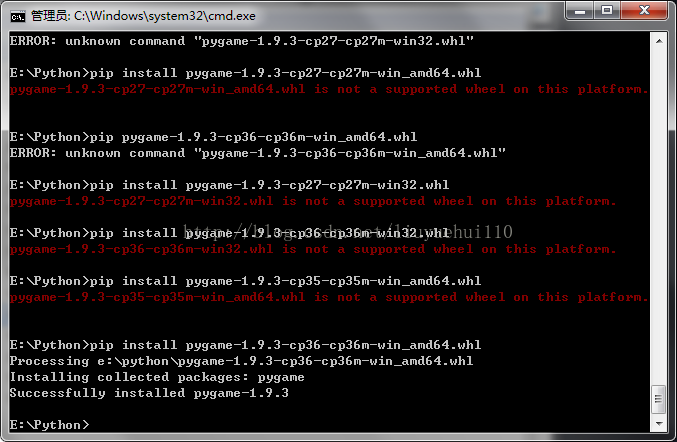

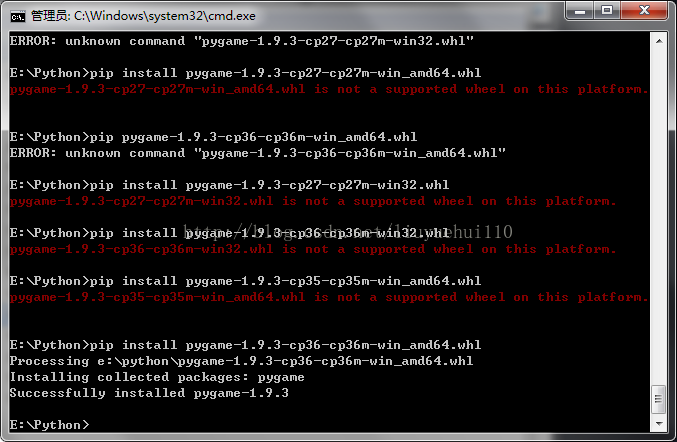

1,下载jieba包

运行->cmd->pip install jieba

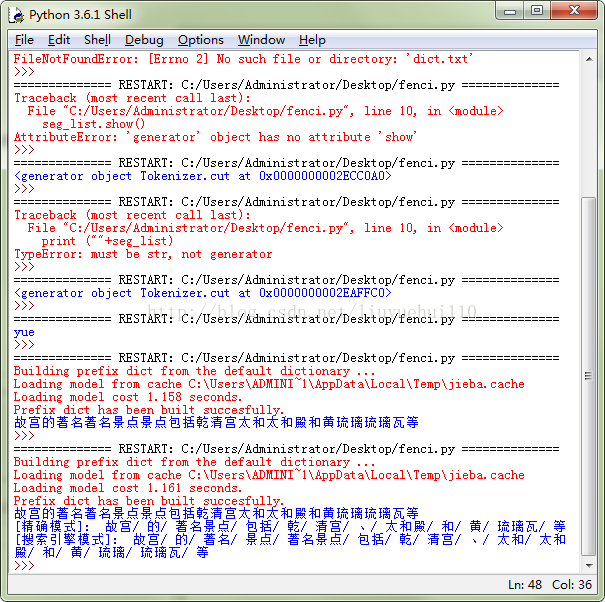

2,实现全模式 ,精准模式和搜索引擎模式的分词

#encoding=utf-8

import jieba

#导入自定义词典

#jieba.load_userdict("dict.txt")

#全模式

text = "故宫的著名景点包括乾清宫、太和殿和黄琉璃瓦等"

seg_list = jieba.cut(text, cut_all=True);

print (''.join(seg_list))

#精确模式

seg_list = jieba.cut(text, cut_all=False)

print (u"[精确模式]: ", "/ ".join(seg_list))

#搜索引擎模式

seg_list = jieba.cut_for_search(text)

print (u"[搜索引擎模式]: ", "/ ".join(seg_list))

运行->cmd->pip install jieba

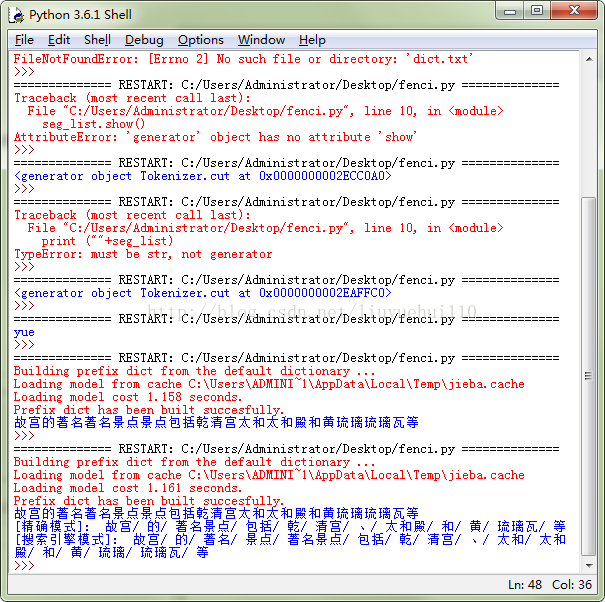

2,实现全模式 ,精准模式和搜索引擎模式的分词

#encoding=utf-8

import jieba

#导入自定义词典

#jieba.load_userdict("dict.txt")

#全模式

text = "故宫的著名景点包括乾清宫、太和殿和黄琉璃瓦等"

seg_list = jieba.cut(text, cut_all=True);

print (''.join(seg_list))

#精确模式

seg_list = jieba.cut(text, cut_all=False)

print (u"[精确模式]: ", "/ ".join(seg_list))

#搜索引擎模式

seg_list = jieba.cut_for_search(text)

print (u"[搜索引擎模式]: ", "/ ".join(seg_list))

相关文章推荐

- Python使用jieba分词并用weka进行文本分类

- 在PyCharm(Python集成开发环境)中安装jieba中文分词工具包

- 在Python里安装Jieba中文分词组件

- 使用python 的结巴(jieba)库进行中文分词

- jieba 分词 centos 安装,python使用

- 在Python里安装Jieba中文分词组件

- Python:通过gensim和jieba分词进行文本相似度分析

- 使用Python+jieba和java+庖丁分词在Spark集群上进行中文分词统计

- 在Python里安装Jieba中文分词组件

- 使用python jieba库进行中文分词

- 使用Python+jieba和java+庖丁分词在Spark集群上进行中文分词统计

- 在Python里安装Jieba中文分词组件

- 中文分词:python-jieba-安装及使用样例

- 在Python里安装Jieba中文分词组件

- python-jieba分词的安装和使用

- python调用中科院分词器进行中文分词

- 使用最大逆向法,利用python进行简易中文分词

- 用条件随机场CRF进行字标注中文分词(Python实现)

- window 中同时安装不同版本的python如何进行环境切换和对应版本的pip install

- python jieba分词(标注词性)