hadoop3种集群方式搭建---独立模式

2017-07-03 21:13

393 查看

1.独立模式

1.1安装

a)下载jdk-8u65-linux-x64.tar.gz

b)tar开

$>su centos ; cd ~

$>mkdir downloads

$>cp /mnt/hdfs/downloads/bigdata/jdk-8u65-linux-x64.tar.gz ~/downlooads

$>tar -xzvf jdk-8u65-linux-x64.tar.gz

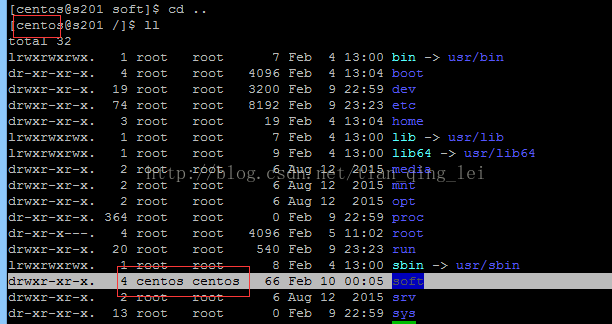

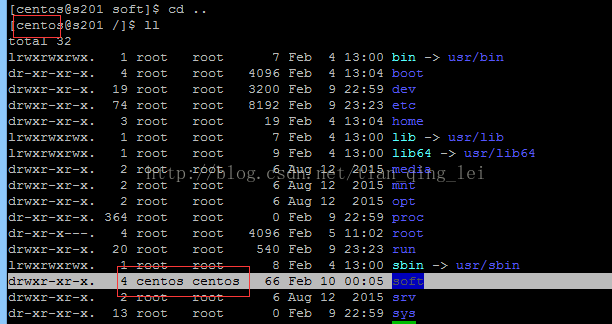

c)创建/soft文件夹

$>sudo mkdir /soft

$>sudo chown centos:centos /soft

d)移动tar开的文件到/soft下

$>mv ~/downloads/jdk-1.8.0_65 /soft/

e)创建符号连接

$>ln -s /soft/jdk-1.8.0_65 /soft/jdk

f)验证jdk安装是否成功

$>cd /soft/jdk/bin

$>./java -version

1.2 配置jdk环境变量

1.编辑/etc/profile

$>sudo nano /etc/profile

...

export JAVA_HOME=/soft/jdk

export PATH=$PATH:$JAVA_HOME/bin

2.使环境变量即刻生效

$>source /etc/profile

3.进入任意目录下,测试是否ok

$>cd ~

$>java -version

注意点

你创建文件夹一定和你登陆的用户一致

1.3 安装HADOOP软件

1.安装hadoop

a)下载hadoop-2.7.3.tar.gz

b)tar开

$>su centos ; cd ~

$>cp /mnt/hdfs/downloads/bigdata/hadoop-2.7.3.tar.gz ~/downloads

$>tar -xzvf hadoop-2.7.3.tar.gz

c)无

d)移动tar开的文件到/soft下

$>mv ~/downloads/hadoop-2.7.3 /soft/

e)创建符号连接

$>ln -s /soft/hadoop-2.7.3 /soft/hadoop

f)验证hadoop安装是否成功

$>cd /soft/hadoop/bin

$>./hadoop version

2.配置hadoop环境变量

$>sudo nano /etc/profile

...

export JAVA_HOME=/soft/jdk

exprot PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/soft/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

3.生效

$>source /etc/profile

4.进入任意目录下,测试是否ok

$>cd ~

$>hadoop version

5.nothing !

不需要启用单独的hadoop进程。

6.hafs dfs -ls /home 和 linux中的ls效果一样

1.1安装

a)下载jdk-8u65-linux-x64.tar.gz

b)tar开

$>su centos ; cd ~

$>mkdir downloads

$>cp /mnt/hdfs/downloads/bigdata/jdk-8u65-linux-x64.tar.gz ~/downlooads

$>tar -xzvf jdk-8u65-linux-x64.tar.gz

c)创建/soft文件夹

$>sudo mkdir /soft

$>sudo chown centos:centos /soft

d)移动tar开的文件到/soft下

$>mv ~/downloads/jdk-1.8.0_65 /soft/

e)创建符号连接

$>ln -s /soft/jdk-1.8.0_65 /soft/jdk

f)验证jdk安装是否成功

$>cd /soft/jdk/bin

$>./java -version

1.2 配置jdk环境变量

1.编辑/etc/profile

$>sudo nano /etc/profile

...

export JAVA_HOME=/soft/jdk

export PATH=$PATH:$JAVA_HOME/bin

2.使环境变量即刻生效

$>source /etc/profile

3.进入任意目录下,测试是否ok

$>cd ~

$>java -version

注意点

你创建文件夹一定和你登陆的用户一致

1.3 安装HADOOP软件

1.安装hadoop

a)下载hadoop-2.7.3.tar.gz

b)tar开

$>su centos ; cd ~

$>cp /mnt/hdfs/downloads/bigdata/hadoop-2.7.3.tar.gz ~/downloads

$>tar -xzvf hadoop-2.7.3.tar.gz

c)无

d)移动tar开的文件到/soft下

$>mv ~/downloads/hadoop-2.7.3 /soft/

e)创建符号连接

$>ln -s /soft/hadoop-2.7.3 /soft/hadoop

f)验证hadoop安装是否成功

$>cd /soft/hadoop/bin

$>./hadoop version

2.配置hadoop环境变量

$>sudo nano /etc/profile

...

export JAVA_HOME=/soft/jdk

exprot PATH=$PATH:$JAVA_HOME/bin

export HADOOP_HOME=/soft/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

3.生效

$>source /etc/profile

4.进入任意目录下,测试是否ok

$>cd ~

$>hadoop version

5.nothing !

不需要启用单独的hadoop进程。

6.hafs dfs -ls /home 和 linux中的ls效果一样

相关文章推荐

- Maven安装编译Spark,搭建Spark独立集群模式(Hadoop架构之上)

- Ubuntu 上搭建伪分布式模式Hadoop集群 步骤与分析

- Linux下Hadoop集群的搭建(2)—单机模式

- hadoop集群监控工具--ganglia的搭建(YUM的方式)

- hadoop集群搭建(三)配置ubermo模式

- 搭建Spark集群(独立模式)

- hadoop2.x分布式集群安装配置 ~hadoop3种模式的介绍

- hadoop2.6集群模式搭建

- 生产环境 hadoop集群监控工具--ganglia的搭建(YUM的方式)

- hadoop2.5.2的本地模式、伪分布式集群、分布式集群和HDFS系统的高可用的环境搭建

- vmware方式搭建hadoop-1.2.1 集群

- Hadoop分布式集群搭建(二 )完全分布式模式

- windows eclipse hadoop 集群开发环境搭建(分布式模式)

- 基于Hadoop分布式集群YARN模式下的TensorFlowOnSpark平台搭建

- hadoop集群搭建多用户模式的hive

- 虚拟机搭建Hadoop集群(1) ---nat模式

- 搭建mongodb副本集群,keyfile和ssl方式,用户认证模式

- Hadoop单机模式集群搭建

- 基于Hadoop分布式集群YARN模式下的TensorFlowOnSpark平台搭建

- HADOOP集群搭建实战(HA高可靠性模式)