机器学习:线性判别式分析(LDA)

2017-06-13 14:15

218 查看

1.概述

线性判别式分析(Linear Discriminant Analysis),简称为LDA。也称为Fisher线性判别(Fisher Linear Discriminant,FLD),是模式识别的经典算法,在1996年由Belhumeur引入模式识别和人工智能领域。

基本思想是将高维的模式样本投影到最佳鉴别矢量空间,以达到抽取分类信息和压缩特征空间维数的效果,投影后保证模式样本在新的子空间有最大的类间距离和最小的类内距离,即模式在该空间中有最佳的可分离性。

LDA与PCA都是常用的降维技术。PCA主要是从特征的协方差角度,去找到比较好的投影方式。LDA更多的是考虑了标注,即希望投影后不同类别之间数据点的距离更大,同一类别的数据点更紧凑。

但是LDA有两个假设:1.样本数据服从正态分布,2.各类得协方差相等。虽然这些在实际中不一定满足,但是LDA被证明是非常有效的降维方法,其线性模型对于噪音的鲁棒性效果比较好,不容易过拟合。

2.图解说明(图片来自网络)

View Code

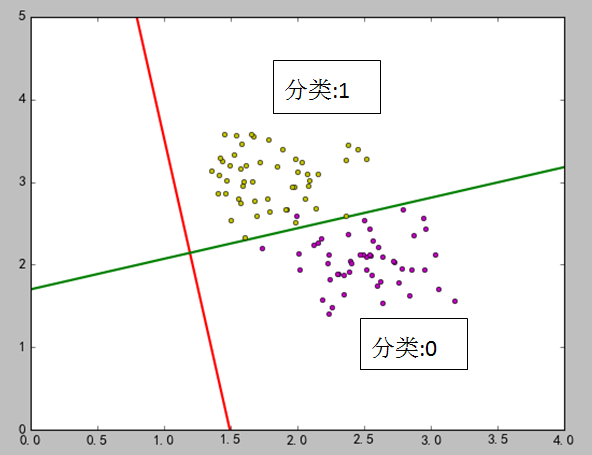

4)结果图

在上图中,红线是LDA之后求出来的,绿线是通过数学的两直线相交的关系求出来的。在代码中,选取了两个点:[1.8, 3.2],[2.7, 1.7],如果直接用训练出的模型进行预测,点[1.8, 3.2] 属于类型1,点[2.7, 1.7]属于类型0.如果通过线与点的关系,使用绿线进行判断,0.14×1.8+2.2=2.45 <3.2,所以点[1.8, 3.2]在绿线上面,因此属于分类1。0.14×2.7+2.2=2.578>1.7,所以点[2.7, 1.7]在绿线下面,因此属于分类0.

对应投影是一维的情况,个人感觉如果能求出绿线的方程,无论是从预测计算还是理解,都比较方便。但是由于样本点分布的不确定性,绿线的斜率好求,但是截距难找,所以LDA算法并没有给出相关的属性内容。

线性判别式分析(Linear Discriminant Analysis),简称为LDA。也称为Fisher线性判别(Fisher Linear Discriminant,FLD),是模式识别的经典算法,在1996年由Belhumeur引入模式识别和人工智能领域。

基本思想是将高维的模式样本投影到最佳鉴别矢量空间,以达到抽取分类信息和压缩特征空间维数的效果,投影后保证模式样本在新的子空间有最大的类间距离和最小的类内距离,即模式在该空间中有最佳的可分离性。

LDA与PCA都是常用的降维技术。PCA主要是从特征的协方差角度,去找到比较好的投影方式。LDA更多的是考虑了标注,即希望投影后不同类别之间数据点的距离更大,同一类别的数据点更紧凑。

但是LDA有两个假设:1.样本数据服从正态分布,2.各类得协方差相等。虽然这些在实际中不一定满足,但是LDA被证明是非常有效的降维方法,其线性模型对于噪音的鲁棒性效果比较好,不容易过拟合。

2.图解说明(图片来自网络)

from sklearn.datasets.samples_generator import make_blobs

import numpy as np

import matplotlib.pyplot as plt

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis

from itertools import cycle

##产生随机数据的中心

centers = [[2.5, 2],[1.8, 3] ]

##产生的数据个数

n_samples=100

##生产数据

X, labels = make_blobs(n_samples=n_samples, centers= centers, cluster_std=0.3,

random_state =0)

clf = LinearDiscriminantAnalysis()

clf.fit(X,labels)

##直线的斜率和截距

#print(clf.coef_) #-7.16451571 10.65392594]

##选取两个数进行预测

#print(clf.predict([[1.8, 3.2]])) #1

#print(clf.predict([[2.7, 1.7]]))#0

##读取直线的斜率和截距

k1 = clf.coef_[0,0]

b1 = clf.coef_[0,1]

##绘图

plt.figure(1)

plt.clf()

'''

说明:

1)为了方便计算及说明,函数式1、2都采用了近似值

y的斜率为-7.165,所以y1的斜率为0.14

2)由于近似值或者绘图精度的问题,当y1斜率为0.14时与y不垂直,

效果图中的绿色直线是下面函数绘制的:y1=0.37*x+1.7,即斜率为0.37

'''

#画LDA直线

x=np.linspace(0,4,50) ##在0-15直接画100个连续点

#y=k1*x+b1

y=-7.165*x+10.7 ##函数式1

plt.plot(x,y,color="red",linewidth=2)

#画与LDA直线垂直的直线

y1=0.14*x+2.2 ##函数式2

#y1=0.37*x+1.7 ##这个函数仅仅是为了绘制效果图用

plt.plot(x,y1,color="g",linewidth=2)

colors = cycle('mykbgrcmykbgrcmykbgrcmyk')

for k, col in zip(range(len(clf.classes_)), colors):

##根据lables中的值是否等于k,重新组成一个True、False的数组

my_members = labels == k

##X[my_members, 0] 取出my_members对应位置为True的值的横坐标

plt.plot(X[my_members, 0], X[my_members, 1],'o',c = col ,markersize=4)

plt.axis([0, 4, 0, 5])

plt.show()View Code

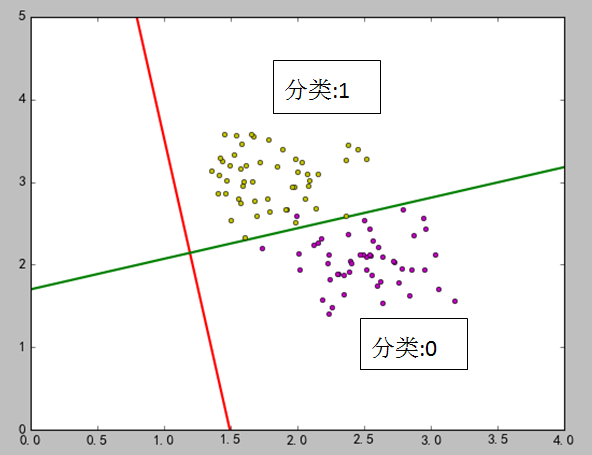

4)结果图

在上图中,红线是LDA之后求出来的,绿线是通过数学的两直线相交的关系求出来的。在代码中,选取了两个点:[1.8, 3.2],[2.7, 1.7],如果直接用训练出的模型进行预测,点[1.8, 3.2] 属于类型1,点[2.7, 1.7]属于类型0.如果通过线与点的关系,使用绿线进行判断,0.14×1.8+2.2=2.45 <3.2,所以点[1.8, 3.2]在绿线上面,因此属于分类1。0.14×2.7+2.2=2.578>1.7,所以点[2.7, 1.7]在绿线下面,因此属于分类0.

对应投影是一维的情况,个人感觉如果能求出绿线的方程,无论是从预测计算还是理解,都比较方便。但是由于样本点分布的不确定性,绿线的斜率好求,但是截距难找,所以LDA算法并没有给出相关的属性内容。

相关文章推荐

- 机器学习-特征选择(降维) 线性判别式分析(LDA)

- (转载)机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学-线性判别分析(LDA), 主成分分析(PCA)

- 线性判别式分析-LDA-Linear Discriminant Analysis

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学-线性判别分析(LDA), 主成分分析(PCA)

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)

- 线性判别式分析-LDA-Linear Discriminant Analysis

- 机器学习中的数学(4)-线性判别分析(LDA), 主成分分析(PCA)