L1和L2正则化

2017-05-24 14:50

176 查看

L1和L2正则化

L1与L2正则化都是防止模型过拟合,其方式略有不同。具体请见下文。

1 L1正则化

L1正则化(1范数)是指,各权值(变量、特征)绝对值之和。其作用是产生权值的稀疏模型,也就是让大部分权值为0.

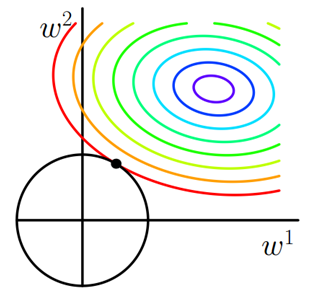

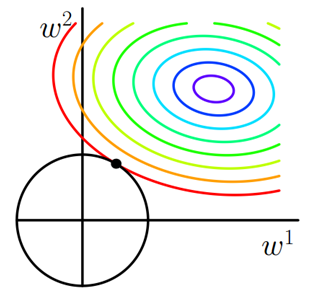

为什么能产生权值稀疏模型?因为如下图所示,各权值绝对值之和后得到一个矩阵,很容易在矩阵的顶点位置使得目标函数为极值,此时大部分权值就为0。

适用场景:线性回归

2 L2正则化

L1正则化(2范数)是指,各权值(变量、特征)平方和开根。其作用是让大部分权值接近0,防止模型过拟合。

二维平面下L2正则化的函数图形是个圆,与方形相比,在权值接近0,而不是完全0时,使得目标函数为极值,这就是为什么L2正则化不具有稀疏性的原因,但又能达到防止模型过拟合。

适用场景:大部分模型

L1与L2正则化都是防止模型过拟合,其方式略有不同。具体请见下文。

1 L1正则化

L1正则化(1范数)是指,各权值(变量、特征)绝对值之和。其作用是产生权值的稀疏模型,也就是让大部分权值为0.

为什么能产生权值稀疏模型?因为如下图所示,各权值绝对值之和后得到一个矩阵,很容易在矩阵的顶点位置使得目标函数为极值,此时大部分权值就为0。

适用场景:线性回归

2 L2正则化

L1正则化(2范数)是指,各权值(变量、特征)平方和开根。其作用是让大部分权值接近0,防止模型过拟合。

二维平面下L2正则化的函数图形是个圆,与方形相比,在权值接近0,而不是完全0时,使得目标函数为极值,这就是为什么L2正则化不具有稀疏性的原因,但又能达到防止模型过拟合。

适用场景:大部分模型

相关文章推荐

- 正则化方法:L1和L2 regularization、数据集扩增、dropout

- L1、L2正则化

- 笔记︱范数正则化L0、L1、L2-岭回归&Lasso回归(稀疏与特征工程)

- 正则化方法:L1和L2 regularization、数据集扩增、dropout

- [置顶] 机器学习损失函数、L1-L2正则化的前世今生

- TensorFlow学习笔记4——正则化方法:L1和L2 regularization、数据集扩增、dropout

- [置顶] 【机器学习 sklearn】模型正则化L1-Lasso,L2-Ridge

- 最小二乘拟合,L1、L2正则化约束

- l1和l2正则化的区别 - 面试错题集

- L1,L2正则化的区别

- 正则化方法:L1和L2 regularization、数据集扩增、dropout

- 校招算法工程师常见面试题及答案总结01——L1和L2正则化

- 岭回归、lasso、ElasticNet、正则化、L1、L2小结

- 正则化方法:L1和L2 regularization、数据集扩增、dropout

- 正则化方法:L1和L2 regularization、数据集扩增、dropout

- 正则化方法:L1和L2 regularization、数据集扩增、dropout

- L0,L1,L2正则化浅析

- L1 L2正则化

- L0,L1,L2正则化--广义线性模型

- 正则化方法:L1和L2 regularization及区别、数据集扩增、dropout