Hadoop集群搭建(hadoop+zookeeper+hbase)Ubuntu14.04

2017-05-14 17:42

615 查看

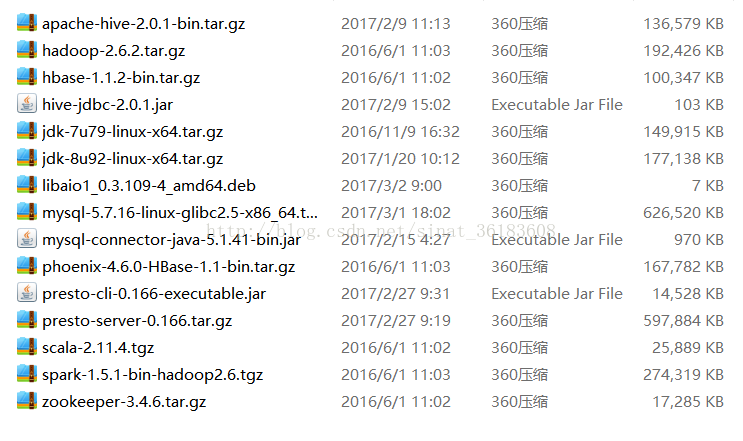

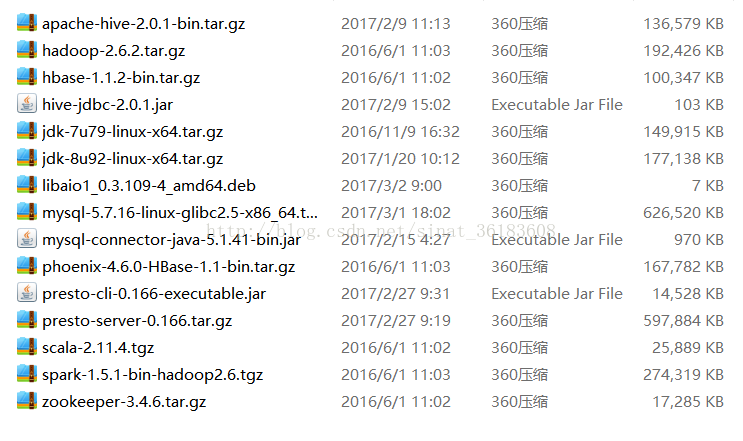

注:先下载如下安装包(方便):

一、准备工作

装好了Ubuntu系统之后,在安装Hadoop前还需要做一些必备工作。

1.创建hadoop用户

如果你安装 Ubuntu 的时候不是用的 hadoop 用户,那么最好增加一个名为 hadoop 的用户,密码随意指定。首先打开终端,输入如下命令创建新用户 :

这条命令创建了可以登陆的 hadoop 用户,并使用 /bin/bash 作为shell。

接着使用如下命令修改密码,按提示输入两次密码

可为 hadoop 用户增加管理员权限,方便部署,避免一些对新手来说比较棘手的权限问题:

完整的运行情况如下:

2.修改机器名称

主机的 /etc/hostname 中,修改机器名为master,将其他主机命令为slave1、slave2等。接着在 /etc/hosts 中,把所有集群的主机信息都写进去。

配置好后可以在各个主机上执行ping Master和ping Slave1测试一下,看是否相互ping得通。

3.配置内网静态ip地址

sudo vim /etc/network/interface

加上如下内容:

auto eth0

iface eth0 inet static

address 172.16.1.43 //IP地址需要改,其他的不能改

gateway 172.16.1.254

netmask 255.255.255.0

完成后,最好重启一下,才能看到IP地址和主机名的变化

(IP地址配置好后就可以使用putty客户端了,不需要在浏览器端了)

4.查看时间,每台机器的时间间隔最好不要超过30s

查看时间:date

修改时间:date –s “2017-01-17 09:30:00”

修改时间后要写入cmos硬件中,切换到超级管理员 sudo su root,

时间同步 hwclock –systohc , 退出超级管理员 su hadoop

二、配置SSH Server无密码登录

1.安装系统时可以选择安装open ssh,或者自己用安装包安装

2. 安装后,可以使用如下命令登陆本机(必做):

这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。

3. (1)配置一台机器自身无密码登录:首先退出刚才的 ssh,就回到了我们原先的终端窗口,先cd进入.ssh目录,然后利用 ssh-keygen 生成密钥,并将密钥加入到授权中:

再次使用ssh localhost登录就不需要输入密码了

(2)配置多台机器之间的互相无密码登录

先在第一台机器生成公钥和密钥,把公钥发给第二台机器,第二台机器加入到 .ssh目录的authorized_keys文件中,然后把authorized_keys发给第三台机器,第三台机器把它自己的公钥也加入authorized_keys,重复这个操作,直到最后一台机器。最后一台机器把它的authorized_keys文件复制到每一台机器的 .ssh目录,配置完成。过程见下图:

以master为起点

三、配置jdk

1.自行准备好压缩包,解压到opt文件夹

2.配置环境变量(jdk环境变量,和以下其他环境变量的配置均为用户变量,不是全局变量)

在文件最前面添加如下单独一行(注意 = 号前后不能有空格),并保存

接着还需要让该环境变量生效,执行如下代码:

3.检验配置是否正确

四、安装hadoop

1.准备要压缩包,解压

2. 修改文件权限:

输入如下命令来检查 Hadoop 是否可用:

成功则会显示命令用法:

3.修改配置文件

分布式模式需要修改 解压目录下的etc/hadoop 中的5个配置文件,后四个文件可点击查看官方默认设置值,这里仅设置了正常启动所必须的设置项: slaves、core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml 。

1. 文件slaves

直接打开slave文件,也可以使用vim打开

把文件中的localhost删除,把所有Slave的主机名写上,每行一个。

2. core-site.xml

3. hdfs-site.xml,因为只有一个slave,所以dfs.replication的值设为1。

4. mapred-site.xml

然后配置修改如下:

5. yarn-site.xml:

配置好后,将 master 上的 Hadoop 文件夹复制到各个节点上。

在slave1上面执行以配置权限:

接下来在master节点上启动hadoop:

通过jps查看各个节点所启动的进程,首先查看master:

可以看到master节点启动了NameNode、SecondaryNameNode、ResourceManager进程。

接着查看slave1:

slave节点则启动了DataNode和NodeManager进程。

另外也可以在master节点上通过命令bin/hdfs dfsadmin -report查看DataNode是否正常启动。

五、安装zookeeper

1、下载解压Zookeeper3.4.6

2、Zookeeper环境变量的配置

3、更改配置文件

将解压目录下conf/zoo_sample.cfg改成conf/zoo.cfg并修改成如下:

mv ./conf/zoo_sample.cfg ./conf/zoo.cfg

4、在DataDir路径下创建myid文件

5、分发到集群的其它机器(注意myid文件的数字)

6、启动与关闭zookeeper

表示启动成功!

六、安装hbase

1.下载解压缩

2.将hbase添加到环境变量中(添加完要使变量生效)

3.修改配置文件

(1)修改解压目录下conf/hbase-env.sh 这两个注释可找到语句

(2)修改conf/hbase-site.xml

(3)修改conf/regionservers文件

master

slave1

(4)把hbase复制到各个子节点,就可以启动了

/home/hadoop/opt/hbase-1.1.2/bin/start-hbase.sh

七、安装phoenix

解压缩,把解压目录下的phoenix-4.6.0-HBase-1.1-server.jar复制到每台机器的hbase目录的lib目录下,并把phoenix复制到各个节点

后重启hbase,即可进入phoenix。

/bin/sqlline.py master

八、后续附加信息

1.三个软件的启动顺序

master节点启动hadoop、zookeeper->各个子节点启动zookeeper->master节点启动hbase->用jps查看是否启动成功

2.启动命令合集

/home/hadoop/opt/hadoop-2.6.2/sbin/start-dfs.sh

/home/hadoop/opt/hadoop-2.6.2/sbin/start-yarn.sh

@master /home/hadoop/opt/zookeeper-3.4.6/bin/zkServer.shstart

/home/hadoop/opt/hbase-1.1.2/bin/start-hbase.sh

Bashrc 环境变量:

exportJAVA_HOME=/home/hadoop/opt/jdk1.7.0_79

export JRE_HOME=${JAVA_HOME}/jre

exportCLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

exportZOOKEEPER_HOME=/home/hadoop/opt/zookeeper-3.4.6

export HBASE_HOME=/home/hadoop/opt/hbase-1.1.2

exportPATH=${JAVA_HOME}/bin:$PATH:${ZOOKEEPER_HOME}/conf:${HBASE_HOME}/bin

一、准备工作

装好了Ubuntu系统之后,在安装Hadoop前还需要做一些必备工作。

1.创建hadoop用户

如果你安装 Ubuntu 的时候不是用的 hadoop 用户,那么最好增加一个名为 hadoop 的用户,密码随意指定。首先打开终端,输入如下命令创建新用户 :

$ sudo useradd -m hadoop -s /bin/bash

这条命令创建了可以登陆的 hadoop 用户,并使用 /bin/bash 作为shell。

接着使用如下命令修改密码,按提示输入两次密码

$ sudo passwd hadoop

可为 hadoop 用户增加管理员权限,方便部署,避免一些对新手来说比较棘手的权限问题:

$ sudo adduser hadoop sudo

完整的运行情况如下:

master@ubuntu:~$ sudo useradd -m hadoop -s /bin/bash [sudo] password for master: master@ubuntu:~$ sudo passwd hadoop Enter new UNIX password: Retype new UNIX password: passwd: password updated successfully master@ubuntu:~$ sudo adduser hadoop sudo [sudo] password for master: Adding user `hadoop' to group `sudo' ... Adding user hadoop to group sudo Done.

2.修改机器名称

主机的 /etc/hostname 中,修改机器名为master,将其他主机命令为slave1、slave2等。接着在 /etc/hosts 中,把所有集群的主机信息都写进去。

hadoop@ubuntu:~$ sudo vim /etc/hostname

hadoop@ubuntu:~$ sudo vim /etc/hosts

127.0.0.1 localhost 172.16.1.43 master 172.16.1.44 node1

172.16.1.45 node2

配置好后可以在各个主机上执行ping Master和ping Slave1测试一下,看是否相互ping得通。

3.配置内网静态ip地址

sudo vim /etc/network/interface

加上如下内容:

auto eth0

iface eth0 inet static

address 172.16.1.43 //IP地址需要改,其他的不能改

gateway 172.16.1.254

netmask 255.255.255.0

完成后,最好重启一下,才能看到IP地址和主机名的变化

(IP地址配置好后就可以使用putty客户端了,不需要在浏览器端了)

4.查看时间,每台机器的时间间隔最好不要超过30s

查看时间:date

修改时间:date –s “2017-01-17 09:30:00”

修改时间后要写入cmos硬件中,切换到超级管理员 sudo su root,

时间同步 hwclock –systohc , 退出超级管理员 su hadoop

二、配置SSH Server无密码登录

1.安装系统时可以选择安装open ssh,或者自己用安装包安装

$ sudo apt-get install openssh-server

2. 安装后,可以使用如下命令登陆本机(必做):

$ ssh localhost

这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。

3. (1)配置一台机器自身无密码登录:首先退出刚才的 ssh,就回到了我们原先的终端窗口,先cd进入.ssh目录,然后利用 ssh-keygen 生成密钥,并将密钥加入到授权中:

cd ~/.ssh/

ssh-keygen -t rsa

cat id_rsa.pub >> authorized_keys

再次使用ssh localhost登录就不需要输入密码了

(2)配置多台机器之间的互相无密码登录

先在第一台机器生成公钥和密钥,把公钥发给第二台机器,第二台机器加入到 .ssh目录的authorized_keys文件中,然后把authorized_keys发给第三台机器,第三台机器把它自己的公钥也加入authorized_keys,重复这个操作,直到最后一台机器。最后一台机器把它的authorized_keys文件复制到每一台机器的 .ssh目录,配置完成。过程见下图:

以master为起点

三、配置jdk

1.自行准备好压缩包,解压到opt文件夹

hadoop@master:~/opt$ sudo tar -zxvf jdk-8u45-linux-x64.tar.gz –C ~/opt/

2.配置环境变量(jdk环境变量,和以下其他环境变量的配置均为用户变量,不是全局变量)

2hadoop@master:~/opt$ sudo vim ~/.bashrc

在文件最前面添加如下单独一行(注意 = 号前后不能有空格),并保存

export JAVA_HOME=/home/hadoop/opt/jdk1.7.0_79

export JRE_HOME=${JAVA_HOME}/jreexport CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/libexport PATH=${JAVA_HOME}/bin:$PATH接着还需要让该环境变量生效,执行如下代码:

$ source ~/.bashrc # 使变量设置生效

3.检验配置是否正确

hadoop@master:~$ java -version

四、安装hadoop

1.准备要压缩包,解压

hadoop@master:~/opt$ sudo tar -zxvf hadoop-2.6.2.tar.gz

2. 修改文件权限:

sudo chown -R hadoop ~/opt/hadoop-2.6.2

输入如下命令来检查 Hadoop 是否可用:

hadoop@master:~/opt$ cd ./hadoop-2.6.2

hadoop@master:~/opt/hadoop-2.6.0$ ./bin/hadoop

成功则会显示命令用法:

Usage: hadoop [--config confdir] COMMAND where COMMAND is one of: fs run a generic filesystem user client version print the version jar <jar> run a jar file checknative [-a|-h] check native hadoop and compression libraries availability distcp <srcurl> <desturl> copy file or directories recursively archive -archiveName NAME -p <parent path> <src>* <dest> create a hadoop archive classpath prints the class path needed to get the credential interact with credential providers Hadoop jar and the required libraries daemonlog get/set the log level for each daemon trace view and modify Hadoop tracing settings or CLASSNAME run the class named CLASSNAME

Most commands print help when invoked w/o parameters.

3.修改配置文件

分布式模式需要修改 解压目录下的etc/hadoop 中的5个配置文件,后四个文件可点击查看官方默认设置值,这里仅设置了正常启动所必须的设置项: slaves、core-site.xml、hdfs-site.xml、mapred-site.xml、yarn-site.xml 。

1. 文件slaves

直接打开slave文件,也可以使用vim打开

把文件中的localhost删除,把所有Slave的主机名写上,每行一个。

2. core-site.xml

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/home/hadoop/opt/hadoop-2.6.2/tmp</value>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

</configuration>

3. hdfs-site.xml,因为只有一个slave,所以dfs.replication的值设为1。

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>master:50090</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/home/hadoop/opt/hadoop-2.6.2/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/home/hadoop/opt/hadoop-2.6.2/tmp/dfs/data</value>

</property>

</configuration>

4. mapred-site.xml

然后配置修改如下:

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

5. yarn-site.xml:

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

配置好后,将 master 上的 Hadoop 文件夹复制到各个节点上。

hadoop@master:~$ cd ~/opt/hadoop-2.6.0

hadoop@master:~/opt/hadoop-2.6.0$ rm -r tmp

hadoop@master:~/opt/hadoop-2.6.0$ cd

hadoop@master:~$ cd ~/opt

hadoop@master:~/opt$ sudo tar -zcf ./hadoop-2.6.0.tar.gz ./hadoop-2.6.0

[sudo] password for hadoop:

hadoop@master:~/opt$ scp ./hadoop-2.6.0.tar.gz slave1:/home/hadoop/opt

在slave1上面执行以配置权限:

hadoop@slave1:~$ sudo chown -R hadoop /home/hadoop/opt/hadoop-2.6.2

接下来在master节点上启动hadoop:

hadoop@master:~/opt/hadoop-2.6.0$ bin/hdfs namenode -format

hadoop@master:~/opt/hadoop-2.6.0$ sbin/start-dfs.sh

hadoop@master:~/opt/hadoop-2.6.0$ sbin/start-yarn.sh

通过jps查看各个节点所启动的进程,首先查看master:

3815 NameNode 4009 SecondaryNameNode 4330 Jps 4143 ResourceManager

可以看到master节点启动了NameNode、SecondaryNameNode、ResourceManager进程。

接着查看slave1:

3606 Jps 3510 NodeManager 3390 DataNode

slave节点则启动了DataNode和NodeManager进程。

另外也可以在master节点上通过命令bin/hdfs dfsadmin -report查看DataNode是否正常启动。

hadoop@master:~/opt/hadoop-2.6.0$ bin/hdfs dfsadmin -report Configured Capacity: 20474130432 (19.07 GB) Present Capacity: 14381412352 (13.39 GB) DFS Remaining: 14381387776 (13.39 GB) DFS Used: 24576 (24 KB) DFS Used%: 0.00% Under replicated blocks: 0 Blocks with corrupt replicas: 0 Missing blocks: 0

------------------------------------------------- Live datanodes (1):

Name: 192.168.111.135:50010 (slave1) Hostname: slave1 Decommission Status : Normal Configured Capacity: 20474130432 (19.07 GB) DFS Used: 24576 (24 KB) Non DFS Used: 6092718080 (5.67 GB) DFS Remaining: 14381387776 (13.39 GB) DFS Used%: 0.00% DFS Remaining%: 70.24% Configured Cache Capacity: 0 (0 B) Cache Used: 0 (0 B) Cache Remaining: 0 (0 B) Cache Used%: 100.00% Cache Remaining%: 0.00% Xceivers: 1 Last contact: Thu May 14 02:28:49 PDT 2015

五、安装zookeeper

1、下载解压Zookeeper3.4.6

hadoop@master:~/opt$ tar -zxvf zookeeper-3.4.6.tar.gz

2、Zookeeper环境变量的配置

hadoop@master:~$ vim ~/.bashrc

# set zookeeper environment

export ZOOKEEPER_HOME=/home/hadoop/opt/zookeeper-3.4.6

export PATH=$PATH:${ZOOKEEPER_HOME}/bin:${ZOOKEEPER_HOME}/conf3、更改配置文件

将解压目录下conf/zoo_sample.cfg改成conf/zoo.cfg并修改成如下:

mv ./conf/zoo_sample.cfg ./conf/zoo.cfg

dataDir=/home/hadoop/opt/zookeeper-3.4.6/var/data # the port at which the clients will connect clientPort=2181 server.1=master:2888:3888 server.2=slave1:2888:3888 //改成自己相应的主机名,记住server对应的数字 这个是2

4、在DataDir路径下创建myid文件

hadoop@master:~/opt/zookeeper-3.4.6$ mkdir var hadoop@master:~/opt/zookeeper-3.4.6$ cd var hadoop@master:~/opt/zookeeper-3.4.6/var$ mkdir data hadoop@master:~/opt/zookeeper-3.4.6/var$ mkdir data hadoop@master:~/opt/zookeeper-3.4.6/var$ cd data hadoop@master:~/opt/zookeeper-3.4.6/var/data$ vim myid //在myid下写主机对应的数字

5、分发到集群的其它机器(注意myid文件的数字)

hadoop@master:~$ scp -r /home/hadoop/opt/zookeeper-3.4.6 hadoop@slave1:/home/hadoop/opt

6、启动与关闭zookeeper

hadoop@master:~$ cd ~/opt/zookeeper-3.4.6/bin hadoop@master:~/opt/zookeeper-3.4.6/bin$ ./zkServer.sh start

JMX enabled by default Using config: /home/hadoop/opt/zookeeper-3.4.6/bin/../conf/zoo.cfg Starting zookeeper ... STARTED

表示启动成功!

六、安装hbase

1.下载解压缩

hadoop@master:~/opt$ tar -zxvf hbase-1.1.0.1-bin.tar.gz

2.将hbase添加到环境变量中(添加完要使变量生效)

export HBASE_HOME=/home/hadoop/opt/hbase-1.1.2

export PATH=${HBASE_HOME}/bin:$PATH3.修改配置文件

(1)修改解压目录下conf/hbase-env.sh 这两个注释可找到语句

export JAVA_HOME=/home/hadoop/opt/jdk1.7.0_79

修改文件中的HBASE_MANAGES_ZK 属性为 false

(2)修改conf/hbase-site.xml

<configuration> <property> <name>hbase.rootdir</name> <value>hdfs://master:9000/hbase</value> </property> <property> <name>hbase.cluster.distributed</name> <value>true</value> </property> <property> <name>hbase.zookeeper.quorum</name> <value>master,slave1</value> </property> <property> <name>hbase.zookeeper.property.dataDir</name> <value>/home/hadoop/opt/zookeeper-3.4.6</value> </property> </configuration>

(3)修改conf/regionservers文件

master

slave1

(4)把hbase复制到各个子节点,就可以启动了

/home/hadoop/opt/hbase-1.1.2/bin/start-hbase.sh

七、安装phoenix

解压缩,把解压目录下的phoenix-4.6.0-HBase-1.1-server.jar复制到每台机器的hbase目录的lib目录下,并把phoenix复制到各个节点

后重启hbase,即可进入phoenix。

/bin/sqlline.py master

八、后续附加信息

1.三个软件的启动顺序

master节点启动hadoop、zookeeper->各个子节点启动zookeeper->master节点启动hbase->用jps查看是否启动成功

2.启动命令合集

/home/hadoop/opt/hadoop-2.6.2/sbin/start-dfs.sh

/home/hadoop/opt/hadoop-2.6.2/sbin/start-yarn.sh

@master /home/hadoop/opt/zookeeper-3.4.6/bin/zkServer.shstart

/home/hadoop/opt/hbase-1.1.2/bin/start-hbase.sh

Bashrc 环境变量:

exportJAVA_HOME=/home/hadoop/opt/jdk1.7.0_79

export JRE_HOME=${JAVA_HOME}/jre

exportCLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

exportZOOKEEPER_HOME=/home/hadoop/opt/zookeeper-3.4.6

export HBASE_HOME=/home/hadoop/opt/hbase-1.1.2

exportPATH=${JAVA_HOME}/bin:$PATH:${ZOOKEEPER_HOME}/conf:${HBASE_HOME}/bin

相关文章推荐

- VMWare9下基于Ubuntu12.10搭建Hadoop-1.2.1集群—整合Zookeeper和Hbase

- VMWare9下基于Ubuntu12.10搭建Hadoop-1.2.1集群—整合Zookeeper和Hbase

- Hadoop0.20.2+hbase-0.92.1+zookeeper-3.3.5 虚拟机ubuntu完全集群搭建

- Hadoop+Hbase+Zookeeper集群环境搭建

- 分布式集群环境hadoop1.2.0、hbase0.94.4、zookeeper、elasticsearch搭建2

- Hadoop集群之 ZooKeeper和Hbase环境搭建

- 第八章 搭建hadoop2.2.0集群,Zookeeper集群和hbase-0.98.0-hadoop2-bin.tar.gz集群

- hadoop+hbase+zookeeper 分布式集群搭建完美运行

- 分布式集群环境hadoop1.2.0、hbase0.94.4、zookeeper、elasticsearch搭建

- Hadoop2.0集群、Hbase集群、Zookeeper集群、Hive工具、Sqoop工具、Flume工具搭建总结

- hadoop+hbase+zookeeper 分布式集群搭建 + eclipse远程连接hdfs 完美运行

- ubuntu14.04搭建hadoop集群

- hadoop、hbase、zookeeper伪集群搭建

- hadoop+hbase+zookeeper 分布式集群搭建 + eclipse远程连接hdfs 完美运行

- Hadoop 、Hbase、zookeeper 集群环境搭建

- hadoop, hbase, zookeeper集群搭建

- hadoop集群搭建之三(Hbase、zookeeper安装)

- Hadoop-2.6.0+Zookeeper-3.4.6+Spark-1.5.0+Hbase-1.1.2+Hive-1.2.0集群搭建

- Hadoop-2.6.0+Zookeeper-3.4.6+Spark-1.5.0+Hbase-1.1.2+Hive-1.2.0集群搭建