PyTorch参数初始化和Finetune

2017-04-12 16:52

761 查看

前言

这篇文章算是论坛PyTorch Forums关于参数初始化和finetune的总结,也是我在写代码中用的算是“最佳实践”吧。最后希望大家没事多逛逛论坛,有很多高质量的回答。

参数初始化

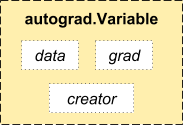

参数的初始化其实就是对参数赋值。而我们需要学习的参数其实都是Variable,它其实是对Tensor的封装,同时提供了data,grad等借口,这就意味着我们可以直接对这些参数进行操作赋值了。这就是PyTorch简洁高效所在。

所以我们可以进行如下操作进行初始化,当然其实有其他的方法,但是这种方法是PyTorch作者所推崇的:

def weight_init(m): # 使用isinstance来判断m属于什么类型 if isinstance(m, nn.Conv2d): n = m.kernel_size[0] * m.kernel_size[1] * m.out_channels m.weight.data.normal_(0, math.sqrt(2. / n)) elif isinstance(m, nn.BatchNorm2d): # m中的weight,bias其实都是Variable,为了能学习参数以及后向传播 m.weight.data.fill_(1) m.bias.data.zero_()

Finetune

往往在加载了预训练模型的参数之后,我们需要finetune模型,可以使用不同的方式finetune。

局部微调

有时候我们加载了训练模型后,只想调节最后的几层,其他层不训练。其实不训练也就意味着不进行梯度计算,PyTorch中提供的requires_grad使得对训练的控制变得非常简单。model = torchvision.models.resnet18(pretrained=True) for param in model.parameters(): param.requires_grad = False # 替换最后的全连接层, 改为训练100类 # 新构造的模块的参数默认requires_grad为True model.fc = nn.Linear(512, 100) # 只优化最后的分类层 optimizer = optim.SGD(model.fc.parameters(), lr=1e-2, momentum=0.9)

全局微调

有时候我们需要对全局都进行finetune,只不过我们希望改换过的层和其他层的学习速率不一样,这时候我们可以把其他层和新层在optimizer中单独赋予不同的学习速率。比如:ignored_params = list(map(id, model.fc.parameters()))

base_params = filter(lambda p: id(p) not in ignored_params,

model.parameters())

optimizer = torch.optim.SGD([

{'params': base_params},

{'params': model.fc.parameters(), 'lr': 1e-3}

], lr=1e-2, momentum=0.9)其中base_params使用1e-3来训练,model.fc.parameters使用1e-2来训练,momentum是二者共有的。

相关文章推荐

- python PyTorch参数初始化和Finetune

- PyTorch中使用预训练的模型初始化网络的一部分参数

- pytorch中的pre-train函数模型或者旧的模型的引用及修改(增减网络层,修改某层参数等) finetune微调等

- PyTorch参数初始化方法

- pytorch:在网络中添加可训练参数,修改预训练权重文件

- 『PyTorch』第十三弹_torch.nn.init参数初始化

- Torch 网络层 参数的初始化问题

- PyTorch参数初始化和Finetune

- Pytorch 读取参数错误 RuntimeError: cuda runtime error (10) : invalid device ordinal

- Pytorch——把模型的所有参数的梯度清0

- seetaface初始化参数调优

- Pytorch安装 与入门链接

- oracle 初始化参数SERVICE_NAMES和客户端TNS中SERVICE_NAME

- Oracle初始化参数之memory_target

- //4.创建一个数组, //实现函数init()初始化数组、 //实现empty()清空数组、 //实现reverse()函数完成数组元素的逆置。 //要求:自己设计函数的参数,返回值。

- Python class 初始化参数为 list 等 可变类型时遇到的问题

- web.xml 中以编码方式添加filter并设置初始化参数AbstractAnnotationConfigDispatchServletInitializer

- Pytorch 中的detach 和detach_

- 踩坑笔记之Pytorch利器:Pycharm(安装Pycharm破解以及创建快捷方式)

- (原)PyTorch中使用指定的GPU