Spark 2.0.1 运行环境的安装与测试

2016-10-27 21:35

519 查看

转自:http://www.cnblogs.com/anlei/p/5996818.html

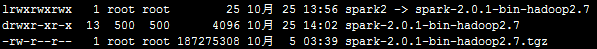

1. 官网下载

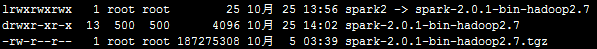

wget http://d3kbcqa49mib13.cloudfront.net/spark-2.0.1-bin-hadoop2.7.tgz

2. 解压

tar -zxvf spark-2.0.1-bin-hadoop2.7.tgz

ln -s spark-2.0.1-bin-hadoop2.7 spark2

3. 环境变量

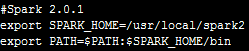

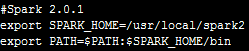

vi /etc/profile

#Spark 2.0.1

export SPARK_HOME=/usr/local/spark2

export PATH=$PATH:$SPARK_HOME/bin

4. 配置文件(/usr/local/spark2/conf)

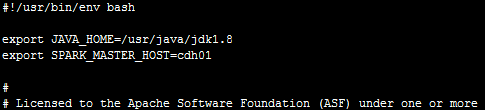

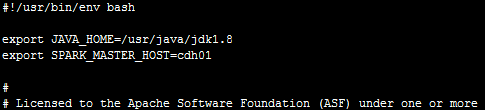

1) spark-env.sh

cp -a spark-env.sh.template spark-env.sh

vi spark-env.sh

export JAVA_HOME=/usr/java/jdk1.8

export SPARK_MASTER_HOST=cdh01

2) slaves

cp -a slaves.template slaves

vi slaves

cdh02

cdh03

5. 复制到其他节点

scp -r spark-2.0.1-bin-hadoop2.7 root@cdh02:/usr/local

scp -r spark-2.0.1-bin-hadoop2.7 root@cdh03:/usr/local

6. 启动

$SPARK_HOME/sbin/start-all.sh

7. 运行

1) 准备一个文本文件放在/logs/wordcount.log内容为:

hdfs hbase hive hdfs

hive hbase spark spark

spark spark spark

2) 运行spark-shell

3) 运行wordcount

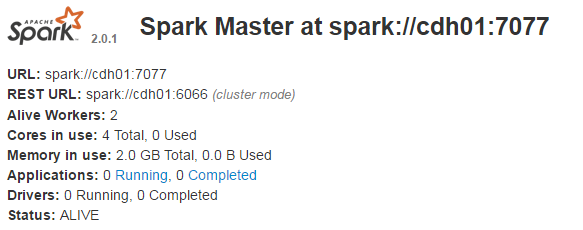

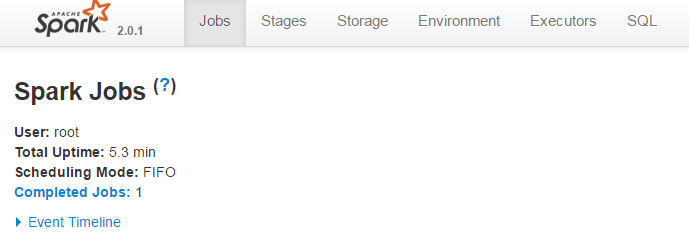

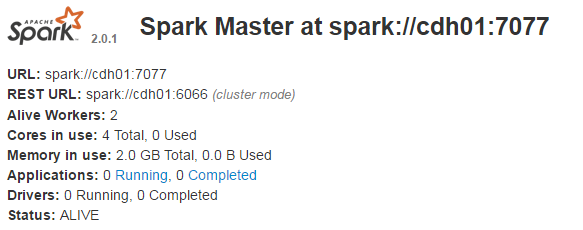

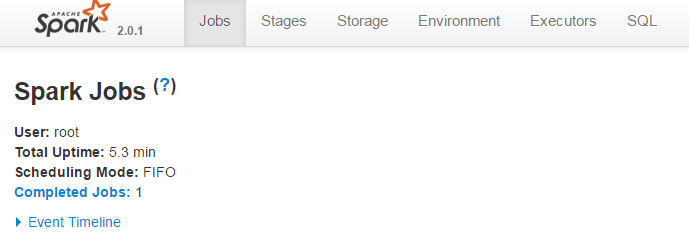

8. Web界面

http://cdh01:8080/jobs/

http://cdh01:4040/jobs/

1. 官网下载

wget http://d3kbcqa49mib13.cloudfront.net/spark-2.0.1-bin-hadoop2.7.tgz

2. 解压

tar -zxvf spark-2.0.1-bin-hadoop2.7.tgz

ln -s spark-2.0.1-bin-hadoop2.7 spark2

3. 环境变量

vi /etc/profile

#Spark 2.0.1

export SPARK_HOME=/usr/local/spark2

export PATH=$PATH:$SPARK_HOME/bin

4. 配置文件(/usr/local/spark2/conf)

1) spark-env.sh

cp -a spark-env.sh.template spark-env.sh

vi spark-env.sh

export JAVA_HOME=/usr/java/jdk1.8

export SPARK_MASTER_HOST=cdh01

2) slaves

cp -a slaves.template slaves

vi slaves

cdh02

cdh03

5. 复制到其他节点

scp -r spark-2.0.1-bin-hadoop2.7 root@cdh02:/usr/local

scp -r spark-2.0.1-bin-hadoop2.7 root@cdh03:/usr/local

6. 启动

$SPARK_HOME/sbin/start-all.sh

7. 运行

1) 准备一个文本文件放在/logs/wordcount.log内容为:

hdfs hbase hive hdfs

hive hbase spark spark

spark spark spark

2) 运行spark-shell

3) 运行wordcount

8. Web界面

http://cdh01:8080/jobs/

http://cdh01:4040/jobs/

相关文章推荐

- Spark运行环境的安装

- Spark运行环境的安装(Standalone)

- spark学习8之eclipse安装scala2.10和spark编译环境并上传到集群运行

- IDEA【基本配置1】配置SBT 和 scala 并在spark环境中进行wordcount测试(spark集群运行模式)

- CaffeOnSpark安装和使用教程系列三:集群环境下使用CaffeOnSpark进行MNIST数据集的测试

- jmeter 在linux服务器的安装和运行; linux环境下使用jmeter进行压力测试

- eclipse开发cocos2dx 3.2环境搭建之二: cocos2dx 3.2安装及测试运行 (An internal error occurred during: "C/C++ Indexe)

- 在window上提交spark代码到远程测试环境上运行

- windows安装Spark单机开发测试环境

- [BTS]经过测试SAP Adapter 1.0/2.0是可以安装到x64环境下运行的!

- docker实战1 (docker-toolbox的安装,docker基础命令详解[运行,容器导入/导出,镜像导入/导出,数据卷,网络],构建100个docker实例的测试环境)

- windows搭建spark运行环境(windows scala,hadoop,spark安装,idea使用配置等)

- 基于RedHatEnterpriseLinux V7(RHEL7)下SPEC CPU 2006环境搭建以及测试流程(之一)——介绍、安装准备、安装、config文件以及运行脚本介绍

- JDK安装成功了,环境变量也配置好了,测试代码也可以运行,但是打不开eclipse

- windows在IDEA环境运行spark程序(spark安装在另一台mac机器)

- Windows Vista环境下Microsoft SQL Server2000的安装及运行

- 安装与建立 Qt 桌面开发运行环境

- OpenC的问题,对安装,编译,动态库,链接顺序,运行环境,有界面程序的影响

- [转]安装 mogilefs 测试系统,在一台机器上,用于测试环境

- 在windows 2000下安装JSP运行环境