Android实战——科大讯飞语音听写SDK的使用,实现语音识别功能

2016-10-20 21:10

816 查看

版权声明:本文为博主原创文章,未经博主允许不得转载。

科大讯飞语音听写SDK的使用,实现语音识别功能

转载加原创

事先说明:

语音听写SDK适配安卓6.0需要手动申请权限,各位可以自信查询资料实现,如果嫌麻烦,可以用第三方Bmob集成好的工具类进行实现,详细可以看http://blog.csdn.NET/qq_30379689/article/details/52223244,关于语音听写SDK的开发,参考科大讯飞开放平台官网为准

步骤一:百度科大讯飞开发者平台,找到官网进入

步骤二:在科大讯飞开发者平台官网注册账号,并创建应用

步骤三:在SDK下载中下载语音听写、Android平台、我的应用进行下载

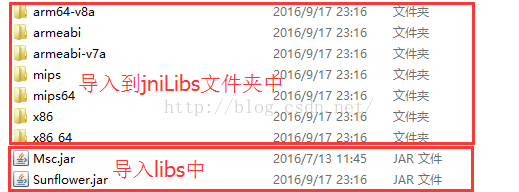

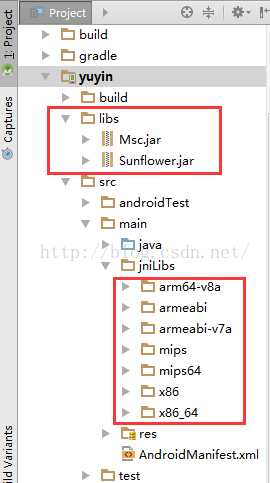

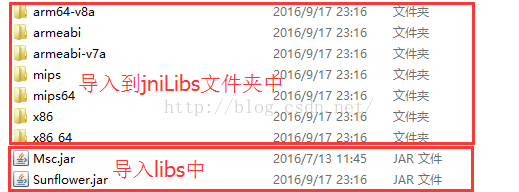

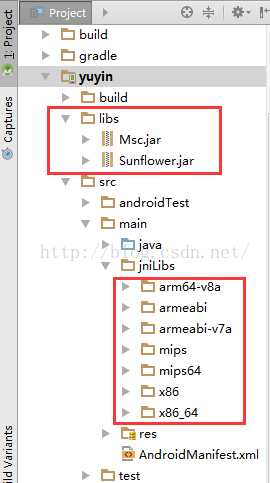

步骤四:解压下载包,在libs中对应导入Android

Studio中

你需要在Android

Studio中手动创建一个jniLibs文件夹,记得libs的jar包右键Add As Library

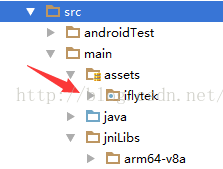

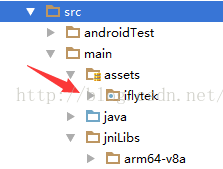

步骤五:复制assets文件夹到项目中

androidstudio都放入libs,在app的gradle加上

步骤六:根据需求,在Manifests文件中添加权限

[java]

view plain

copy

<!--连接网络权限,用于执行云端语音能力 -->

<uses-permission android:name="android.permission.INTERNET" />

<!--获取手机录音机使用权限,听写、识别、语义理解需要用到此权限 -->

<uses-permission android:name="android.permission.RECORD_AUDIO" />

<!--读取网络信息状态 -->

<uses-permission android:name="android.permission.ACCESS_NETWORK_STATE" />

<!--获取当前wifi状态 -->

<uses-permission android:name="android.permission.ACCESS_WIFI_STATE" />

<!--允许程序改变网络连接状态 -->

<uses-permission android:name="android.permission.CHANGE_NETWORK_STATE" />

<!--读取手机信息权限 -->

<uses-permission android:name="android.permission.READ_PHONE_STATE" />

<!--读取联系人权限,上传联系人需要用到此权限 -->

<uses-permission android:name="android.permission.READ_CONTACTS" />

<!--外存储写权限,构建语法需要用到此权限 -->

<uses-permission android:name="android.permission.WRITE_EXTERNAL_STORAGE" />

<!--外存储读权限,构建语法需要用到此权限 -->

<uses-permission android:name="android.permission.READ_EXTERNAL_STORAGE" />

<!--配置权限,用来记录应用配置信息 -->

<uses-permission android:name="android.permission.WRITE_SETTINGS" />

<!--手机定位信息,用来为语义等功能提供定位,提供更精准的服务--> <!--定位信息是敏感信息,可通过Setting.setLocationEnable(false)关闭定位请求 -->

<uses-permission android:name="android.permission.ACCESS_FINE_LOCATION" />

这个步骤有时候会出错,因为如果是文档中复制进来的权限,会在权限中多出几个空格导致报错,所以大家小心

步骤七:在代码中初始化SDK

[java]

view plain

copy

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

// 将“12345678”替换成您申请的 APPID

SpeechUtility.createUtility(this, SpeechConstant.APPID +"=12345678");

}

步骤八:在代码中封装语音识别实体,然后封装个方法使用

[java]

view plain

copy

/**

* 初始化语音识别

*/

public void initSpeech(final Context context) {

//1.创建RecognizerDialog对象

//第二个参数是个listener

RecognizerDialog mDialog = new RecognizerDialog(context, null);

//2.设置accent、language等参数

//设置语音识别为中文

mDialog.setParameter(SpeechConstant.LANGUAGE, "zh_cn");

//方言为普通话

mDialog.setParameter(SpeechConstant.ACCENT, "mandarin");

//3.设置回调接口

mDialog.setListener(new RecognizerDialogListener() {

@Override

public void onResult(RecognizerResult recognizerResult, boolean isLast) {

//islast做了判断去掉了最后的句号

if (!isLast) {

//解析语音

String result = parseVoice(recognizerResult.getResultString());

}

}

@Override

public void onError(SpeechError speechError) {

}

});

//4.显示dialog,接收语音输入

mDialog.show();

}

/**

* 解析语音json

*/

public String parseVoice(String resultString) {

Gson gson = new Gson();

Voice voiceBean = gson.fromJson(resultString, Voice.class);

StringBuffer sb = new StringBuffer();

ArrayList<Voice.WSBean> ws = voiceBean.ws;

for (Voice.WSBean wsBean : ws) {

String word = wsBean.cw.get(0).w;

sb.append(word);

}

return sb.toString();

}

/**

* 语音对象封装

*/

public class Voice {

public ArrayList<WSBean> ws;

public class WSBean {

public ArrayList<CWBean> cw;

}

public class CWBean {

public String w;

}

}

1设置点击初始化dialog

2:回掉接口

2解析json

由于语音识别返回的是个JSON数据,所以这里我们使用Gson这个包进行解析,需要在dependencies中添加

[java]

view plain

copy

compile 'com.google.code.gson:gson:2.2.4'

我们用一个按钮调用这个initSpeech方法,并将结果显示在TextView中,查看效果图

源码下载:使用Import Module导入

科大讯飞语音听写SDK的使用,实现语音识别功能

转载加原创

事先说明:

语音听写SDK适配安卓6.0需要手动申请权限,各位可以自信查询资料实现,如果嫌麻烦,可以用第三方Bmob集成好的工具类进行实现,详细可以看http://blog.csdn.NET/qq_30379689/article/details/52223244,关于语音听写SDK的开发,参考科大讯飞开放平台官网为准

步骤一:百度科大讯飞开发者平台,找到官网进入

步骤二:在科大讯飞开发者平台官网注册账号,并创建应用

步骤三:在SDK下载中下载语音听写、Android平台、我的应用进行下载

步骤四:解压下载包,在libs中对应导入Android

Studio中

你需要在Android

Studio中手动创建一个jniLibs文件夹,记得libs的jar包右键Add As Library

步骤五:复制assets文件夹到项目中

androidstudio都放入libs,在app的gradle加上

sourceSets {

main {

jniLibs.srcDirs = ['libs']

}

}[/code]步骤六:根据需求,在Manifests文件中添加权限

[java]

view plain

copy

<!--连接网络权限,用于执行云端语音能力 -->

<uses-permission android:name="android.permission.INTERNET" />

<!--获取手机录音机使用权限,听写、识别、语义理解需要用到此权限 -->

<uses-permission android:name="android.permission.RECORD_AUDIO" />

<!--读取网络信息状态 -->

<uses-permission android:name="android.permission.ACCESS_NETWORK_STATE" />

<!--获取当前wifi状态 -->

<uses-permission android:name="android.permission.ACCESS_WIFI_STATE" />

<!--允许程序改变网络连接状态 -->

<uses-permission android:name="android.permission.CHANGE_NETWORK_STATE" />

<!--读取手机信息权限 -->

<uses-permission android:name="android.permission.READ_PHONE_STATE" />

<!--读取联系人权限,上传联系人需要用到此权限 -->

<uses-permission android:name="android.permission.READ_CONTACTS" />

<!--外存储写权限,构建语法需要用到此权限 -->

<uses-permission android:name="android.permission.WRITE_EXTERNAL_STORAGE" />

<!--外存储读权限,构建语法需要用到此权限 -->

<uses-permission android:name="android.permission.READ_EXTERNAL_STORAGE" />

<!--配置权限,用来记录应用配置信息 -->

<uses-permission android:name="android.permission.WRITE_SETTINGS" />

<!--手机定位信息,用来为语义等功能提供定位,提供更精准的服务--> <!--定位信息是敏感信息,可通过Setting.setLocationEnable(false)关闭定位请求 -->

<uses-permission android:name="android.permission.ACCESS_FINE_LOCATION" />

这个步骤有时候会出错,因为如果是文档中复制进来的权限,会在权限中多出几个空格导致报错,所以大家小心

步骤七:在代码中初始化SDK

[java]

view plain

copy

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

// 将“12345678”替换成您申请的 APPID

SpeechUtility.createUtility(this, SpeechConstant.APPID +"=12345678");

}

步骤八:在代码中封装语音识别实体,然后封装个方法使用

[java]

view plain

copy

/**

* 初始化语音识别

*/

public void initSpeech(final Context context) {

//1.创建RecognizerDialog对象

//第二个参数是个listener

RecognizerDialog mDialog = new RecognizerDialog(context, null);

//2.设置accent、language等参数

//设置语音识别为中文

mDialog.setParameter(SpeechConstant.LANGUAGE, "zh_cn");

//方言为普通话

mDialog.setParameter(SpeechConstant.ACCENT, "mandarin");

//3.设置回调接口

mDialog.setListener(new RecognizerDialogListener() {

@Override

public void onResult(RecognizerResult recognizerResult, boolean isLast) {

//islast做了判断去掉了最后的句号

if (!isLast) {

//解析语音

String result = parseVoice(recognizerResult.getResultString());

}

}

@Override

public void onError(SpeechError speechError) {

}

});

//4.显示dialog,接收语音输入

mDialog.show();

}

/**

* 解析语音json

*/

public String parseVoice(String resultString) {

Gson gson = new Gson();

Voice voiceBean = gson.fromJson(resultString, Voice.class);

StringBuffer sb = new StringBuffer();

ArrayList<Voice.WSBean> ws = voiceBean.ws;

for (Voice.WSBean wsBean : ws) {

String word = wsBean.cw.get(0).w;

sb.append(word);

}

return sb.toString();

}

/**

* 语音对象封装

*/

public class Voice {

public ArrayList<WSBean> ws;

public class WSBean {

public ArrayList<CWBean> cw;

}

public class CWBean {

public String w;

}

}

1设置点击初始化dialog

//1.创建RecognizerDialog对象 RecognizerDialog mDialog = new RecognizerDialog(this, mInitListener); //2.设置accent、language等参数 //设置识别语言为中文 mDialog.setParameter(SpeechConstant.LANGUAGE, "zh_cn"); //设置方言为普通话 mDialog.setParameter(SpeechConstant.ACCENT, "mandarin"); //设置引擎为转写 mDialog.setParameter(SpeechConstant.DOMAIN, "iat"); //设置录音采样率为 mDialog.setParameter(SpeechConstant.SAMPLE_RATE, "16000"); mDialog.setParameter(SpeechConstant.RESULT_TYPE,"json"); //设置监听对象 mDialog.setListener(mRecognizerDialogListener); //4.显示dialog,接收语音输入 //开始识别 mDialog.show();

2:回掉接口

private InitListener mInitListener = new InitListener() {

@Override

public void onInit(int i) {

//初始化

if (i!= ErrorCode.SUCCESS){

Toast.makeText(SearchActivity.this,i+"code", Toast.LENGTH_SHORT).show();

}

}

};

private RecognizerDialogListener mRecognizerDialogListener = new RecognizerDialogListener() {

@Override

public void onResult(RecognizerResult recognizerResult, boolean isLast) {

//!islast把最后的句号去掉。

if (!isLast){

String text = JsonParser.parseIatResult(recognizerResult.getResultString());

//Toast.makeText(SearchActivity.this, text, Toast.LENGTH_SHORT).show();

searchActivityAutoTv.setText(text);

}

}2解析json

public class JsonParser {

public static String parseIatResult(String json) {

StringBuffer ret = new StringBuffer();

try {

JSONTokener tokener = new JSONTokener(json);

JSONObject joResult = new JSONObject(tokener);

JSONArray words = joResult.getJSONArray("ws");

for (int i = 0; i < words.length(); i++) {

// 转写结果词,默认使用第一个结果

JSONArray items = words.getJSONObject(i).getJSONArray("cw");

JSONObject obj = items.getJSONObject(0);

ret.append(obj.getString("w"));

//如果需要多候选结果,解析数组其他字段

//for(int j = 0; j < items.length(); j++)

//{

//JSONObject obj = items.getJSONObject(j);

//ret.append(obj.getString("w"));

//}

}

} catch (Exception e) {

e.printStackTrace();

}

return ret.toString();

}

public static String parseGrammarResult(String json) {

StringBuffer ret = new StringBuffer();

try {

JSONTokener tokener = new JSONTokener(json);

JSONObject joResult = new JSONObject(tokener);

JSONArray words = joResult.getJSONArray("ws");

for (int i = 0; i < words.length(); i++) {

JSONArray items = words.getJSONObject(i).getJSONArray("cw");

for(int j = 0; j < items.length(); j++)

{

JSONObject obj = items.getJSONObject(j);

if(obj.getString("w").contains("nomatch"))

{

ret.append("没有匹配结果.");

return ret.toString();

}

ret.append("【结果】"+ obj.getString("w"));

ret.append("【置信度】"+ obj.getInt("sc"));

ret.append("n");

}

}

} catch (Exception e) {

e.printStackTrace();

ret.append("没有匹配结果.");

}

return ret.toString();

}

}由于语音识别返回的是个JSON数据,所以这里我们使用Gson这个包进行解析,需要在dependencies中添加

[java]

view plain

copy

compile 'com.google.code.gson:gson:2.2.4'

我们用一个按钮调用这个initSpeech方法,并将结果显示在TextView中,查看效果图

源码下载:使用Import Module导入

相关文章推荐

- Android实战——科大讯飞语音听写SDK的使用,实现语音识别功能

- 使用科大讯飞SDK实现语音功能

- 使用科大讯飞SDK实现语音功能

- 使用科大讯飞提供的SDK实现android语音识别

- Android开发学习之使用百度语音识别SDK实现语音识别(上)

- android使用百度地图、定位SDK实现地图和定位功能!(最新、可用+吐槽)

- 使用讯飞实现语音听写与语音合成功能

- iOS 使用科大讯飞技术实现语音转文字(语音听写)

- android使用百度地图、定位SDK实现地图和定位功能!(最新、可用+吐槽)

- android使用百度地图、定位SDK实现地图和定位功能!(最新、可用+吐槽)

- android使用百度地图、定位SDK实现地图和定位功能!(最新、可用+吐槽)

- 讯飞语音的语音听写功能实现的总结以及新手如何着手第三方SDK

- Android开发学习之使用百度语音识别SDK实现语音识别(下)

- Android科大讯飞语音听写实现

- Android开发集成科大讯飞语音识别+语音合成功能

- Android开发集成科大讯飞语音识别+语音合成功能

- 在ubuntu上利用科大讯飞的SDK实现语音识别-语义识别等功能

- 使用科大讯飞的语音技术实现语音识别

- 使用科大讯飞语音SDK实现文字在线合成语音

- 使用科大讯飞的语音技术实现语音识别