Logistic Regression 之 Sigmoid

2016-10-16 17:20

127 查看

逻辑回归(Logistic Regression, LR)模型是一个二分类模型,属于广义线性模型,它还有个名字叫做二项逻辑斯蒂(谛)回归(不知为什么加个斯蒂(谛)),虽然叫XX回归,但却不属于回归模型。

用概率的观点看待二分类问题,模型(这个模型是贝叶斯模型)的数学表示:P(Y|x)

类别y1的后验概率可以写成:

P(y1|x)=P(x|y1)P(y1)p(x|y1)P(y1)+p(x|y2)P(y2)

上下同除以P(x|y1)P(y1):

P(y1|x)=11+p(x|y2)P(y2)p(x|y1)P(y1)

可进一步转换:取a=lnP(x|y1)P(y1)p(x|y2)P(y2)

于是有:P(y1|x)=11+e−a

可以看到a等于y1发生的概率与y2发生概率的比值(事件的几率)取对数,这里为什么取对数呢?……似乎为了引进sigmoid()函数(我曾经也被这样灌输过,那么为什么引进sigmoid()函数呢?………..),嗯,先放一放。

我们回过头来,根据朴素贝叶斯当y1类发生的概率大于y2类发生的概率时,为y1类,此时a>0(a=lnP(x|y1)P(y1)p(x|y2)P(y2)),反之,为y2类,此时a<0,此时想起来了线性回归,仿佛有点联系,好的,看下面:

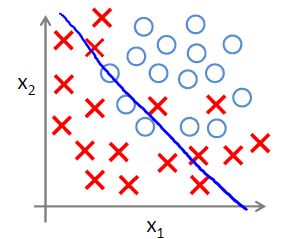

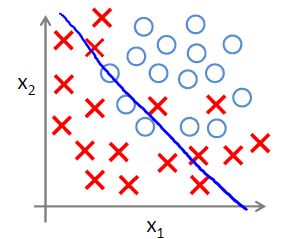

我们知道线性模型中,可分的超平面S:W*X+b=0,可以看作W*X,为直观感受,对二维平面的点进行分类,若W*X大于0,那么我们可以称为y1类,小于0,称为y2类,这是线性回归,

如果我们令a=W*X,这个模型正好可以满足,于是就把这个模型称为逻辑回归。

所以有:P(y1|x)=11+e−W∗X

在PRML书上也没具体说这个,直接把sigmoid引进作用在线性函数上,就称之为logistic回归,在《统计学习方法》上,直接来了定理,然后把对数几率作用在W*X上。在网上也看了好多资料,似乎也没讲清楚,都是引入sigmod()进来之后,再谈引入sigmod()函数的好处,不太严谨。

参考:《统计学习方法》,《模式识别与机器学习》

用概率的观点看待二分类问题,模型(这个模型是贝叶斯模型)的数学表示:P(Y|x)

类别y1的后验概率可以写成:

P(y1|x)=P(x|y1)P(y1)p(x|y1)P(y1)+p(x|y2)P(y2)

上下同除以P(x|y1)P(y1):

P(y1|x)=11+p(x|y2)P(y2)p(x|y1)P(y1)

可进一步转换:取a=lnP(x|y1)P(y1)p(x|y2)P(y2)

于是有:P(y1|x)=11+e−a

可以看到a等于y1发生的概率与y2发生概率的比值(事件的几率)取对数,这里为什么取对数呢?……似乎为了引进sigmoid()函数(我曾经也被这样灌输过,那么为什么引进sigmoid()函数呢?………..),嗯,先放一放。

我们回过头来,根据朴素贝叶斯当y1类发生的概率大于y2类发生的概率时,为y1类,此时a>0(a=lnP(x|y1)P(y1)p(x|y2)P(y2)),反之,为y2类,此时a<0,此时想起来了线性回归,仿佛有点联系,好的,看下面:

我们知道线性模型中,可分的超平面S:W*X+b=0,可以看作W*X,为直观感受,对二维平面的点进行分类,若W*X大于0,那么我们可以称为y1类,小于0,称为y2类,这是线性回归,

如果我们令a=W*X,这个模型正好可以满足,于是就把这个模型称为逻辑回归。

所以有:P(y1|x)=11+e−W∗X

在PRML书上也没具体说这个,直接把sigmoid引进作用在线性函数上,就称之为logistic回归,在《统计学习方法》上,直接来了定理,然后把对数几率作用在W*X上。在网上也看了好多资料,似乎也没讲清楚,都是引入sigmod()进来之后,再谈引入sigmod()函数的好处,不太严谨。

参考:《统计学习方法》,《模式识别与机器学习》

相关文章推荐

- Sigmoid 函数

- [Machine Learning_Andrew Ng]--Sigmoid() Function.

- sigmoid与ReLU函数

- 《神经网络与深度学习》笔记2:Sigmoid 神经元

- 为什么我们喜欢用sigmoid这类S型非线性变换?

- LSTM 两个激励函数区别sigmoid 和tanh

- ReLU为什么比Sigmoid效果好

- caffe Sigmoid cross entropy loss 交叉熵损失函数

- sigmoid和softmax的关系

- 人工神经网络框架AForge学习(二):Sigmoid激活函数

- sigmoid 函数

- ReLU 和sigmoid 函数对比以及droupout

- sigmoid与ReLU函数

- 深度学习笔记(4)——Sigmoid和Relu激活函数的对比

- tensorflow50 《面向机器智能的TensorFlow实战》笔记-04-02 Sigmoid

- ReLU Sigmoid and Tanh

- Sigmoid 函数

- NLTK和jieba这两个python的自然语言包(HMM,rnn,sigmoid

- 为什么 LR 模型要使用 sigmoid 函数,背后的数学原理是什么?

- S型函数:Sigmoid 函数