关于神经网络的一点理解

2016-10-07 20:11

253 查看

1.为什么使用神经网络

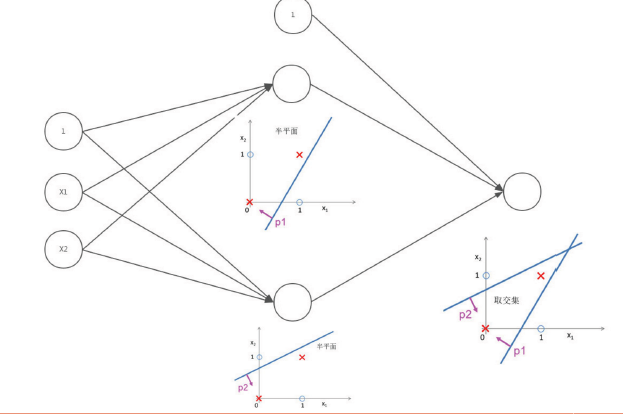

因为在最简单的异或问题上,一个简单的线性分类器都搞不定了。而神经网络相当于多个线性分类边界的整合。具有更优秀的能力。

【异或问题】如果a、b两个值不相同,则异或结果为1。如果a、b两个值相同,异或结果为0。

异或也叫半加运算,其运算法则相当于不带进位的二进制加法:二进制下用1表示真,0表示假,则异或的运算法则为:0⊕0=0,1⊕0=1,0⊕1=1,1⊕1=0(同为0,异为1),这些法则与加法是相同的,只是不带进位。

其中,每个直线代表一个分类器,给出一次分类结果。然后,在下一层中,根据这些初次分类得到的结果,再进行一次分类【本例中取交即可】

总结一下:单隐层的神经网络可以实现and和or功能,双【多】隐层的神经网络可以实现任何功能。

2.神经网络为何每层都要有一个激励函数?

试想如果从输入层到隐层之间没有一个“非线性变换”函数,那么每次从层1到层2经过一层权值,再从层2到层3 经过一层权值,这两层权值【两个矩阵】可以乘在一起,相当于没有这个必要了。3.理论上来说,用两个隐层的神经网络可以解决任何分类问题?

是的,可以看到每个层实际上是画了一条线,那么只要“这个隐层的神经元的个数非常多”但是这个训练不如我们“把层拉伸,”4.GBDT许多连续值不离散化的

我的目的就是为了找那个断点。树类型的分类器。所以许多并不离散化。为什么会用GBDT+LR来组合使用,因为GBDT可以用来构造特征

5.神经网络的特征许多都是人不可以理解的特征

类似于人的“潜意识里”的特征。输入到softmax里的特征,很难从物理上得到一个结论。6.普通分类和图像分类的区别?

普通分类器:数据归一化,训练集上数据归一化,拿到系数之后也要用到测试集上。7.神经网络做回归?

一般情况下,回归问题比较难做。但凡有想法的话,一般都希望把回归问题转化为分类问题。怎么转?相关文章推荐

- 深度学习系列——关于神经网络理解的总结

- 关于构建浅层神经网络的一些理解(以MNIST为例子)

- 关于神经网络的一点猜想

- 关于机器学习神经网络的基本理解

- 关于网络安全的一点看法

- 关于安全共性服务构件的一点理解

- 关于网络游戏的一点见解

- 关于反射的一点理解(一)

- 关于equals()和==操作的一点理解

- 我的一点浅见——关于机器的理解

- 关于对网络学习方法的一点见解

- [zt]关于左值"lvalue"和右值"rvalue"的一点理解

- 关于龙芯拿MIPS授权的一点理解

- 关于StrutsFormBean 的一点理解

- 语义网:能理解人类语言的智能网络(注:这应该是我看过的最通俗的一篇关于语义网的说明文章了)

- 关于DataRow和DataColumn的一点个人简单理解

- 个人对网络协议的一点理解(原创)

- 关于对网络学习方法的一点见解

- 关于Ndis驱动的一点个人理解

- 关于openlayers中namespace的一点理解