使用flume进行日志收集的总结(1)

2016-09-09 11:34

211 查看

由于最近几个月在搞一个实时监控平台的项目,用的是flume+kafka+spark,之前领导说弄个文档总结一下项目开发中的用到技术以及容易出错的地方,以供之后的新手们参考(其实我也才接触了几个月而已),现在才有时间弄文档,顺便也发个博客记录一下(处女篇),毕竟当初我也是不断在网上查资料的

,希望这份资料对大家有用吧。

由于网上对于flume的简介很多,这里就不多做赘述了,直奔主题,flume的安装就不说了,直接解压就可以了,解压之后需要修改一下配置文件

①cp flume-conf.properties.template flume-conf.properties

②vi flume-conf.properties

接下来就是配置flume的source,channel和sink

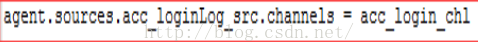

source配置:

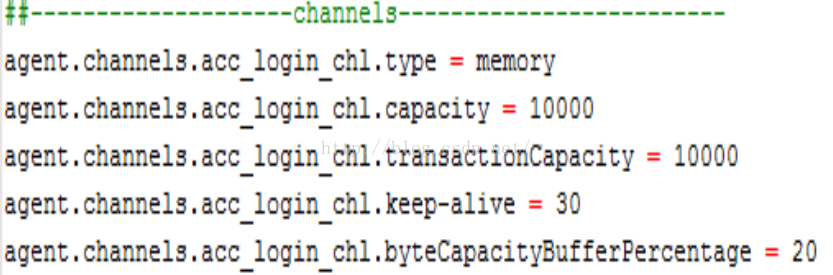

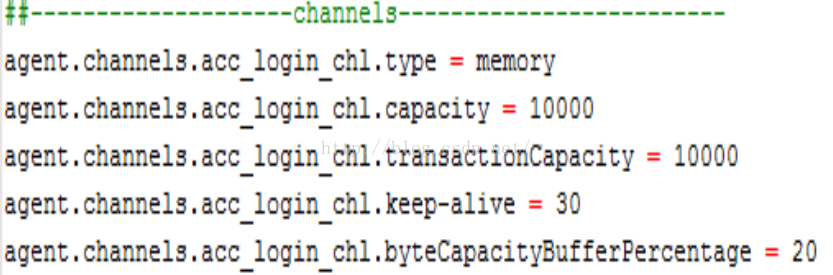

channel配置:

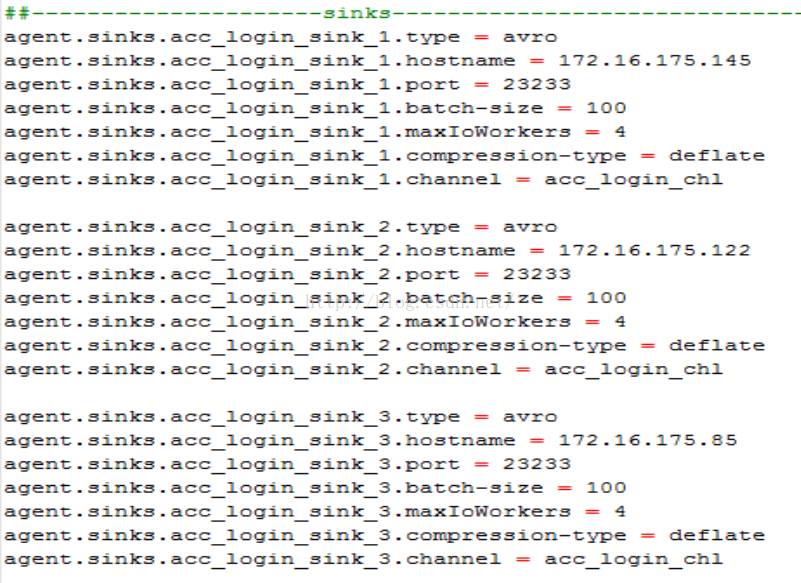

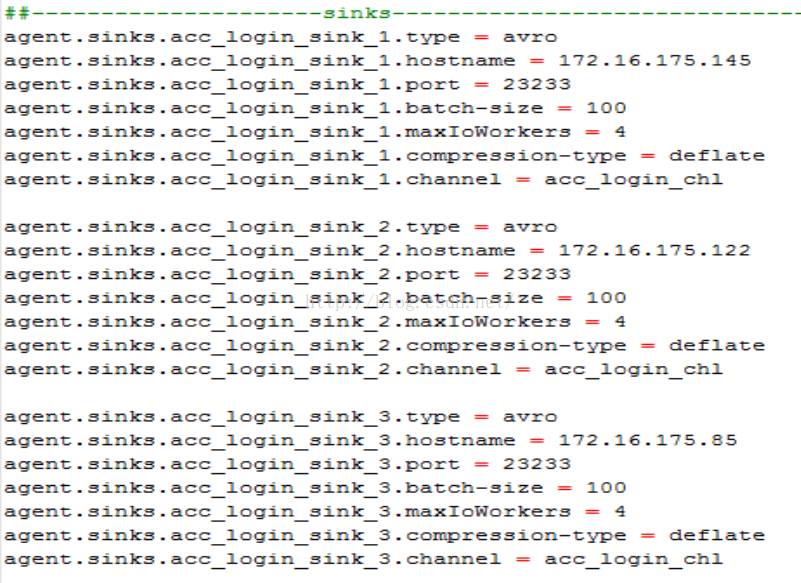

sink配置:

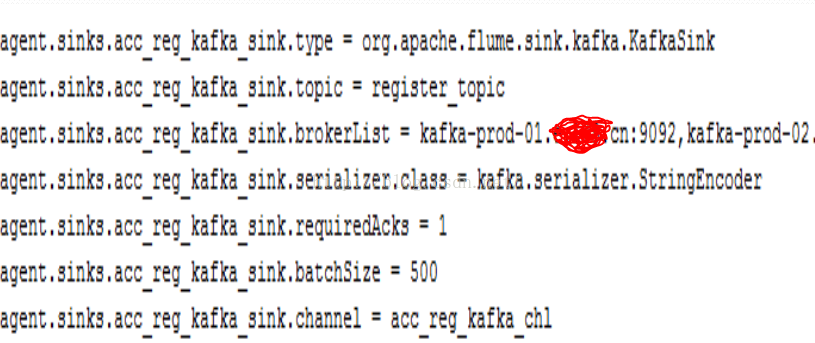

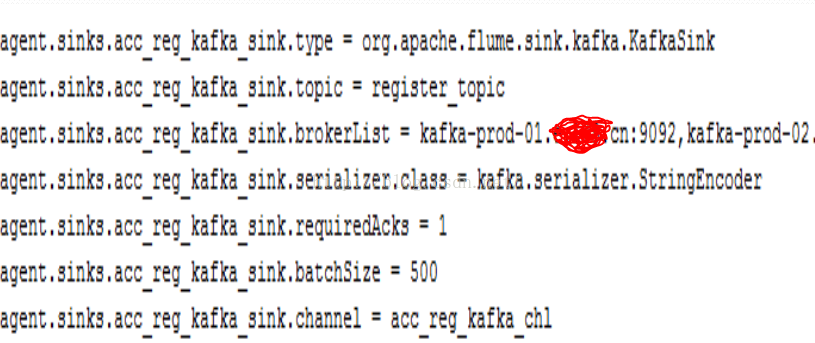

汇总的flume的kafkaSink配置:

[b]

接下来简单说说flume的拦截器,flume提供了许多拦截器,当Source指定一个拦截器后,拦截器会得到Event数据,可以在拦截器中过滤提取数据,一个Source可以指定多个拦截器形成拦截器chain

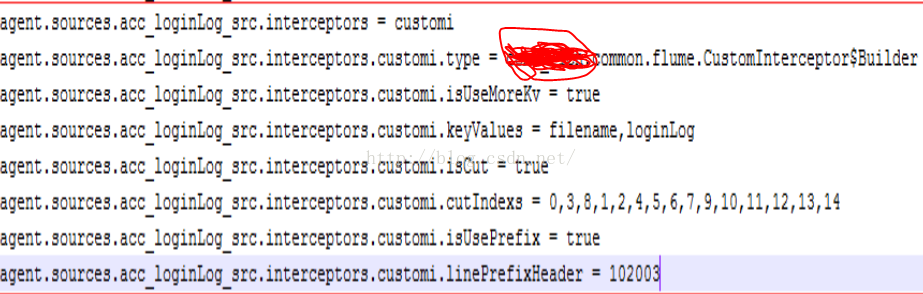

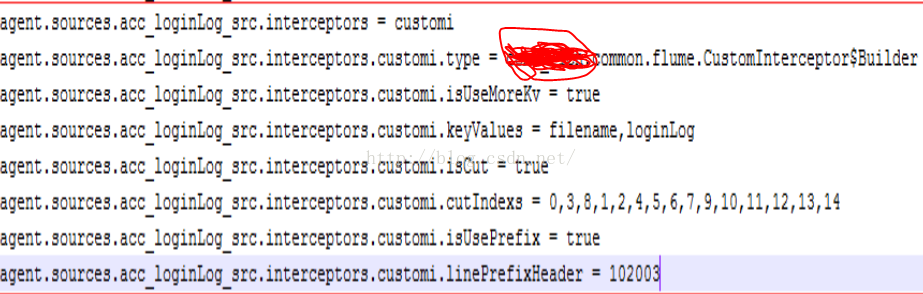

拦截器配置:

好了,先说这么多,这些应该算是简单的入门知识(毕竟是第一篇),下一篇会说一下我接触到的flume的负载均衡以及监控工具方面的东西,接下来也会更新工作中用到的kafka方面的知识点,希望大家多多支持

,希望这份资料对大家有用吧。

由于网上对于flume的简介很多,这里就不多做赘述了,直奔主题,flume的安装就不说了,直接解压就可以了,解压之后需要修改一下配置文件

①cp flume-conf.properties.template flume-conf.properties

②vi flume-conf.properties

接下来就是配置flume的source,channel和sink

source配置:

channel配置:

sink配置:

汇总的flume的kafkaSink配置:

[b]

接下来简单说说flume的拦截器,flume提供了许多拦截器,当Source指定一个拦截器后,拦截器会得到Event数据,可以在拦截器中过滤提取数据,一个Source可以指定多个拦截器形成拦截器chain

拦截器配置:

好了,先说这么多,这些应该算是简单的入门知识(毕竟是第一篇),下一篇会说一下我接触到的flume的负载均衡以及监控工具方面的东西,接下来也会更新工作中用到的kafka方面的知识点,希望大家多多支持

相关文章推荐

- 使用flume进行日志收集的总结(2)

- Flume NG源码分析(五)使用ThriftSource通过RPC方式收集日志

- 分析hadoop日志之前传-采用flume进行日志收集

- flume使用之flume+hive 实现日志离线收集、分析

- Flume 日志收集、使用Flume收集日志到HDFS

- flume学习(六):使用hive来分析flume收集的日志数据

- 使用Flume+Logstash+Kafka+Spark Streaming进行实时日志处理分析【公安大数据】

- 使用Flume+Kafka+SparkStreaming进行实时日志分析

- Flume(NG)架构设计要点及配置实践 Flume NG是一个分布式、可靠、可用的系统,它能够将不同数据源的海量日志数据进行高效收集

- [置顶] 使用Flume+Kafka+SparkStreaming进行实时日志分析

- nginx日志切割并使用flume-ng收集日志

- 使用hive来分析flume收集的日志数据

- flume学习(五):使用hive来分析flume收集的日志数据

- Hadoop详解(七)——Hive的原理和安装配置和UDF,flume的安装和配置以及简单使用,flume+hive+Hadoop进行日志处理

- flume学习(六):使用hive来分析flume收集的日志数据

- 学习总结二十二:flume是分布式的日志收集系统

- flume学习(六):使用hive来分析flume收集的日志数据

- 日志收集框架 Flume 组件之Source使用

- logstash的安装使用、收集json日志、csv日志总结

- 分布式数据日志收集之Flume的安装和使用