查看HDFS文件系统数据的三种方法

2016-07-22 15:38

399 查看

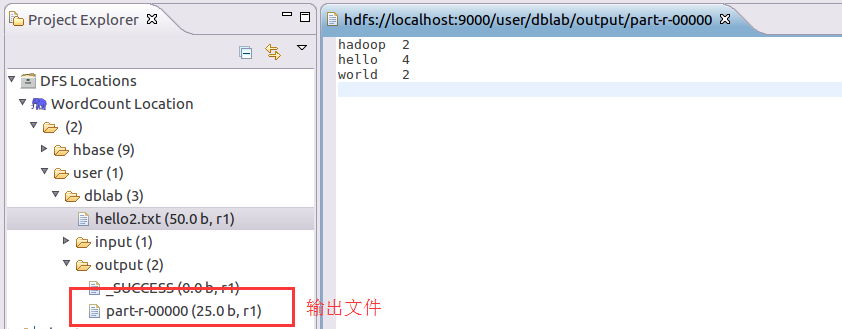

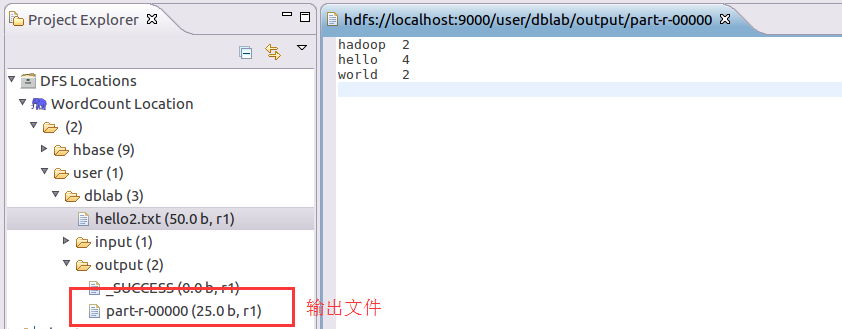

1、使用插件——Hadoop-Eclipse-Plugin

此方法需要借助Eclipse,插件的安装及使用请参考博文。

借助Eclipse只能进行简单的HDFS操作,如查看,删除,上传,下载。以下是操作界面:

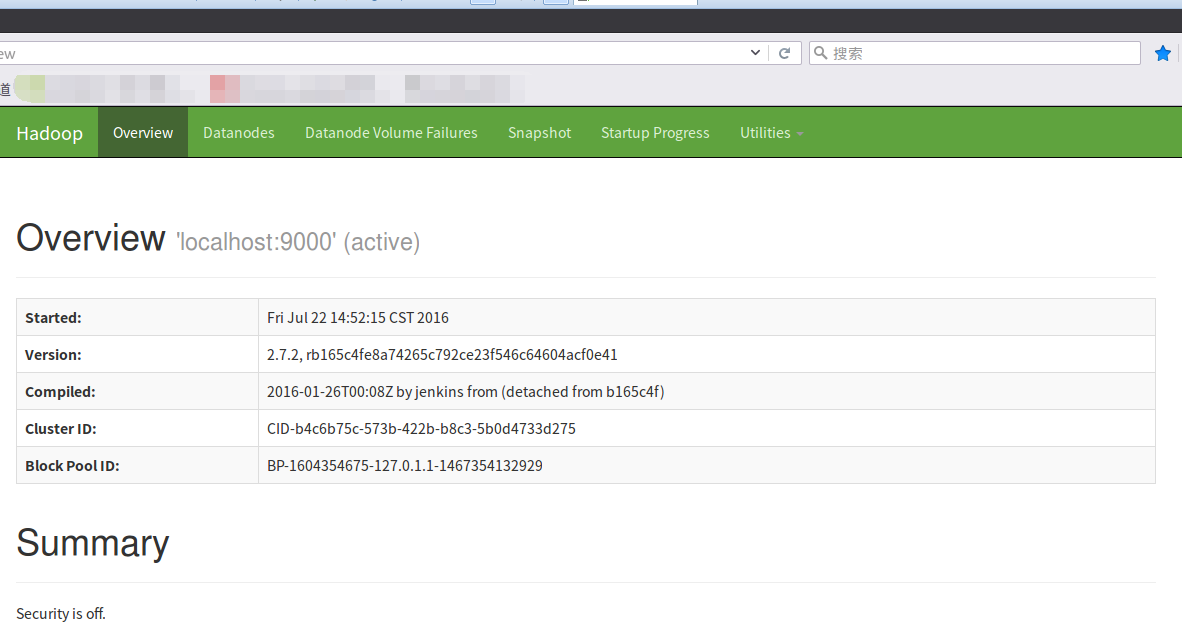

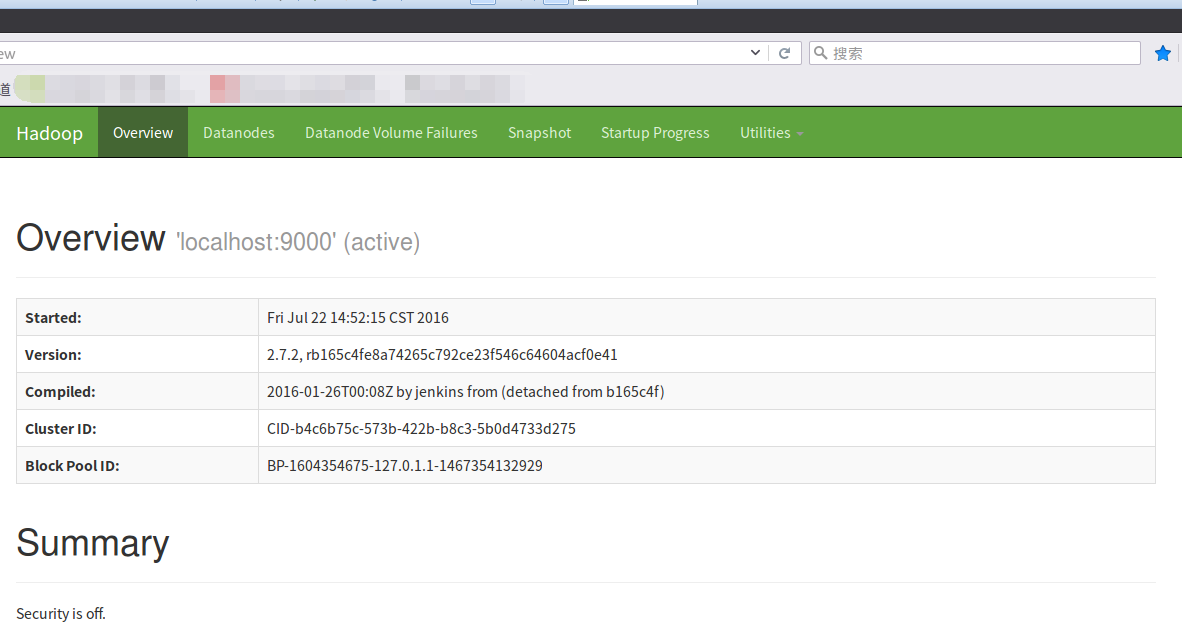

2、HDFS Web界面

HDFS Web界面上只能查看文件系统数据。网址:http://localhost:50070

界面如下:

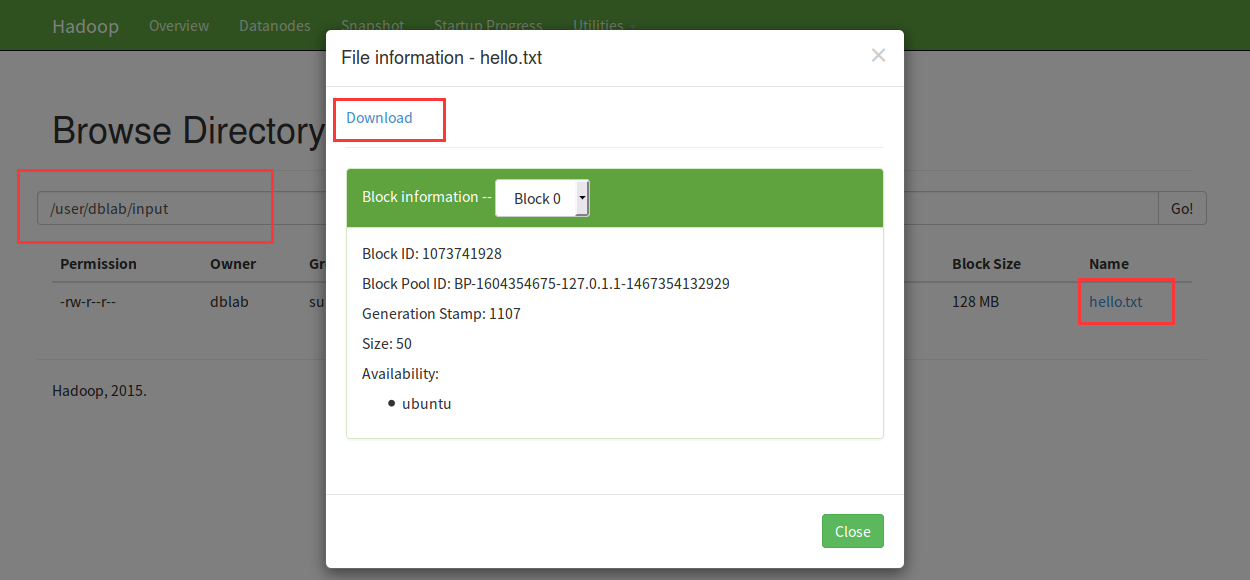

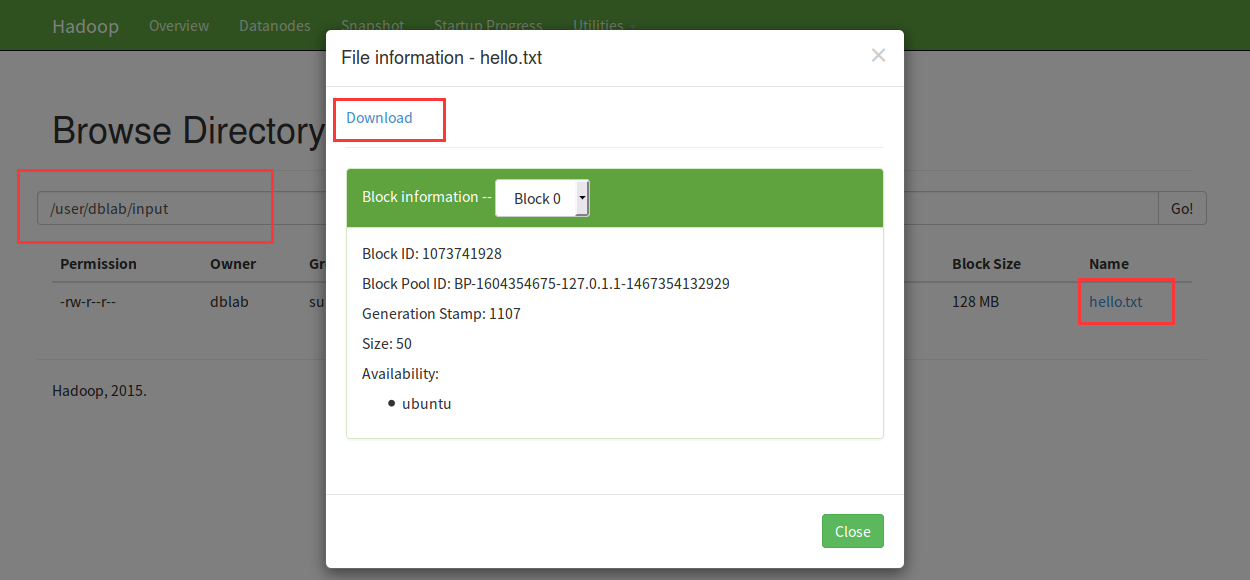

执行完WordCount程序后可以到本界面上下载output结果并查看,截图有误,理解就好,如图:

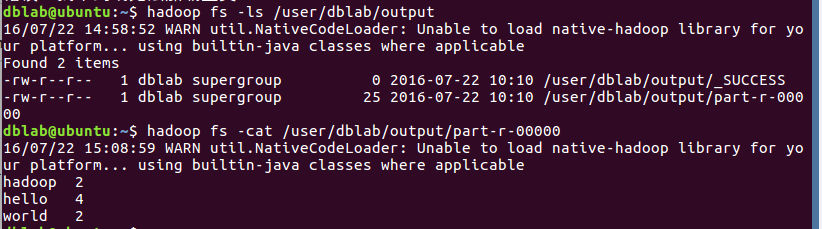

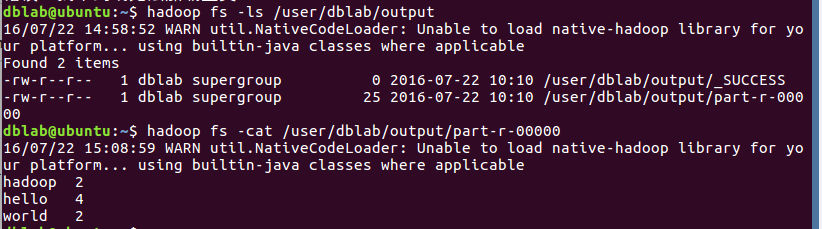

3、 shell命令

这个方法是最基本的,能进行所有文件操作。

博主的用户名是dblab,相应的HDFS上的目录变为/user/dblab/output。界面截图如下:

此方法需要借助Eclipse,插件的安装及使用请参考博文。

借助Eclipse只能进行简单的HDFS操作,如查看,删除,上传,下载。以下是操作界面:

2、HDFS Web界面

HDFS Web界面上只能查看文件系统数据。网址:http://localhost:50070

界面如下:

执行完WordCount程序后可以到本界面上下载output结果并查看,截图有误,理解就好,如图:

3、 shell命令

这个方法是最基本的,能进行所有文件操作。

hadoop fs -ls /user/hadoop/output #查看指定目录下的文件和文件夹。/user/hadoop/output是HDFS上的目录,不是本地目录 hadoop fs -cat /user/hadoop/output #查看文件内容

博主的用户名是dblab,相应的HDFS上的目录变为/user/dblab/output。界面截图如下:

相关文章推荐

- HDFS的StartupProgress启动跟踪分析

- HDFS的fs.defaultFS的端口

- hdfs 通过NFSV3 加载至本地目录

- Spark将HDFS数据导入到HBase

- Spark 读取HDFS存入 HBase(1.0.0 新 API)

- hdfs HA + MR HA

- Ubuntu16.04下安装Hadoop2.6.2 (单机模式)

- Ubuntu Virtualbox 搭建hadoop伪分布式集群

- HDFS 的 file size 和 block size

- HBase从hdfs导入数据

- HDFS 冗余数据块的自动删除

- HBase数据导出到HDFS

- Spark 提交任务时,指定文件

- HDFS权限问题

- 查看hive 表在hdfs上的存储路径

- hadoop实战-07.ubuntu14.04安装vsftpd服务

- 再聊HDFS Erasure Coding

- hadoop

- 查看HDFS上存储的hive表

- 【漫画解读】HDFS存储原理