Cloudera 5.7集群部署(四)--KAFKA集成

2016-07-16 18:13

357 查看

1 Cloudera kafka集成

1.1 Kafka parcels包下载

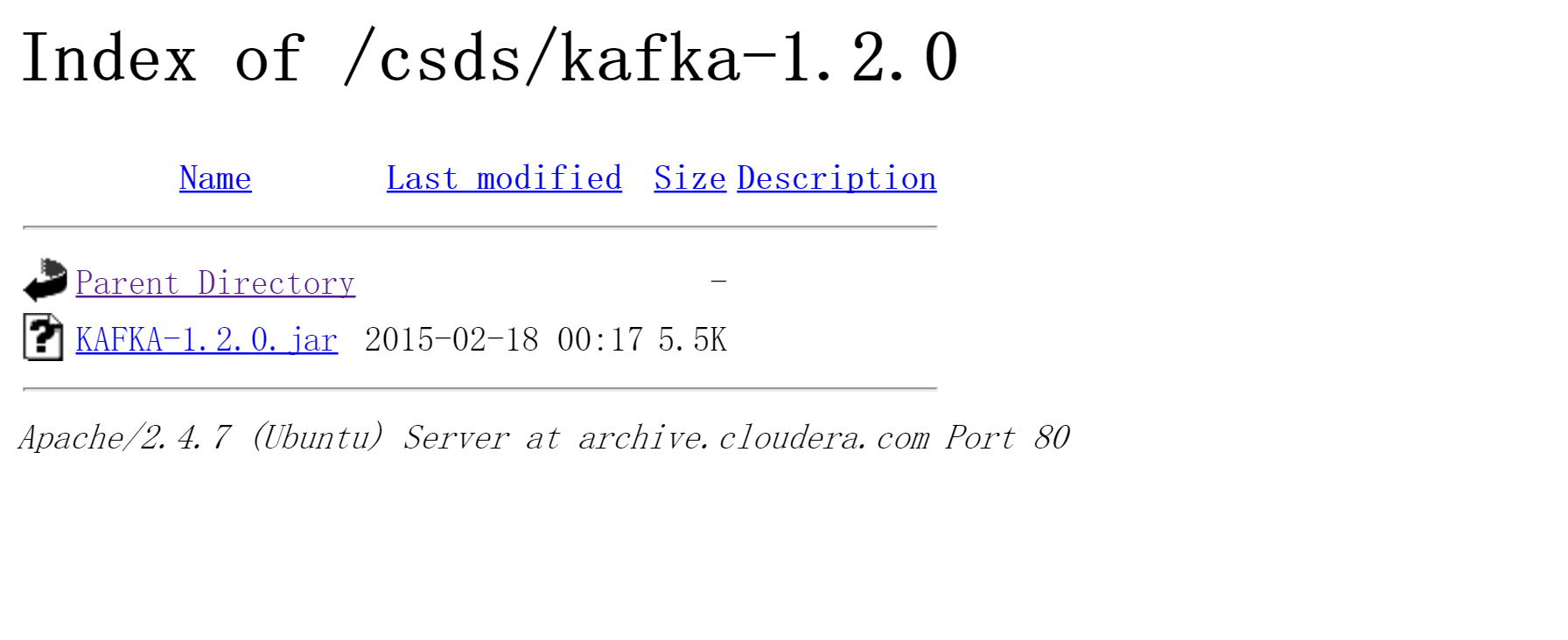

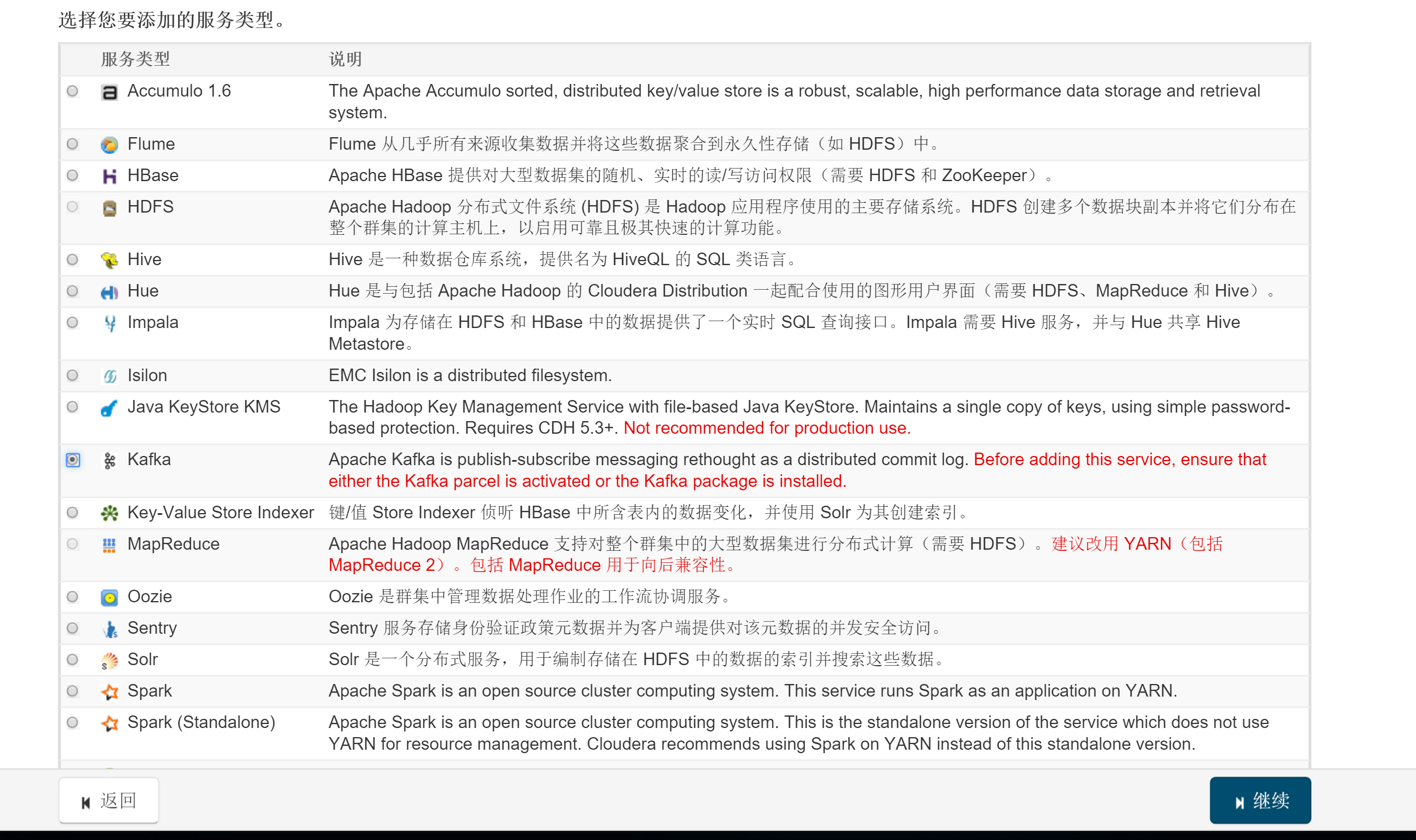

csd包:http://archive.cloudera.com/csds/kafka/

parcel包: http://archive.cloudera.com/kafka/parcels/latest/ (根据自己的集群的系统版本下载)

1.2 Kafka parcels包上传

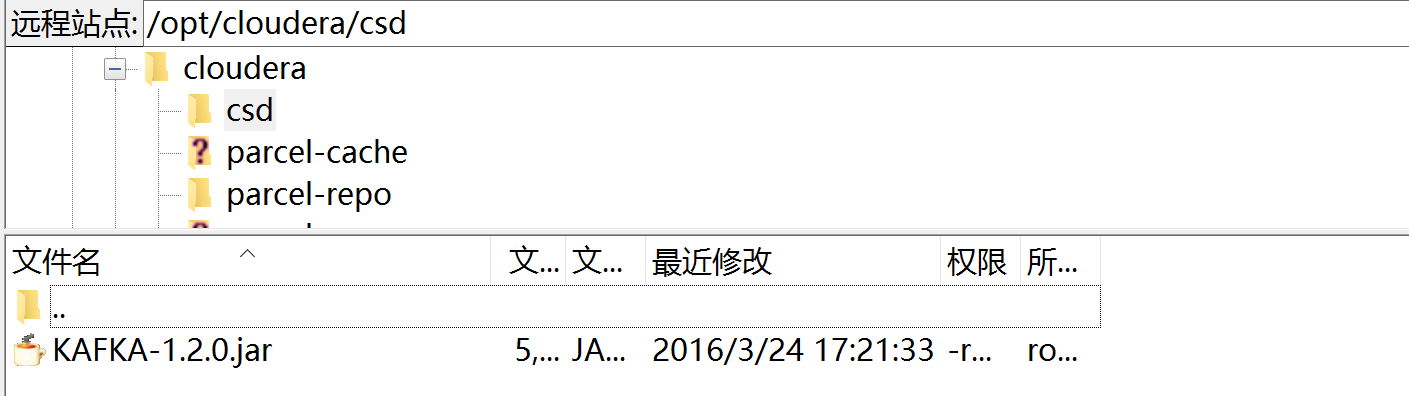

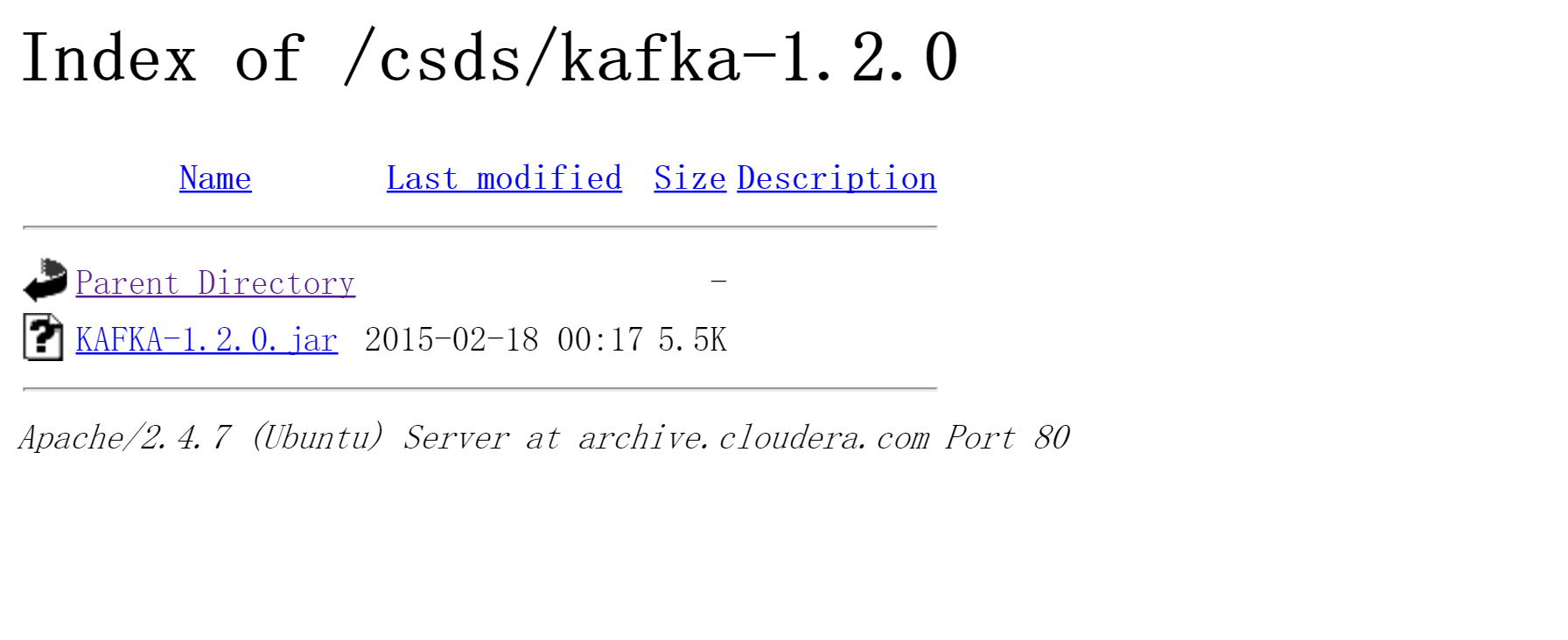

上传 KAFKA-1.2.0.jar放到cm安装节点下的 /opt/cloudera/csd目录下,如图 :

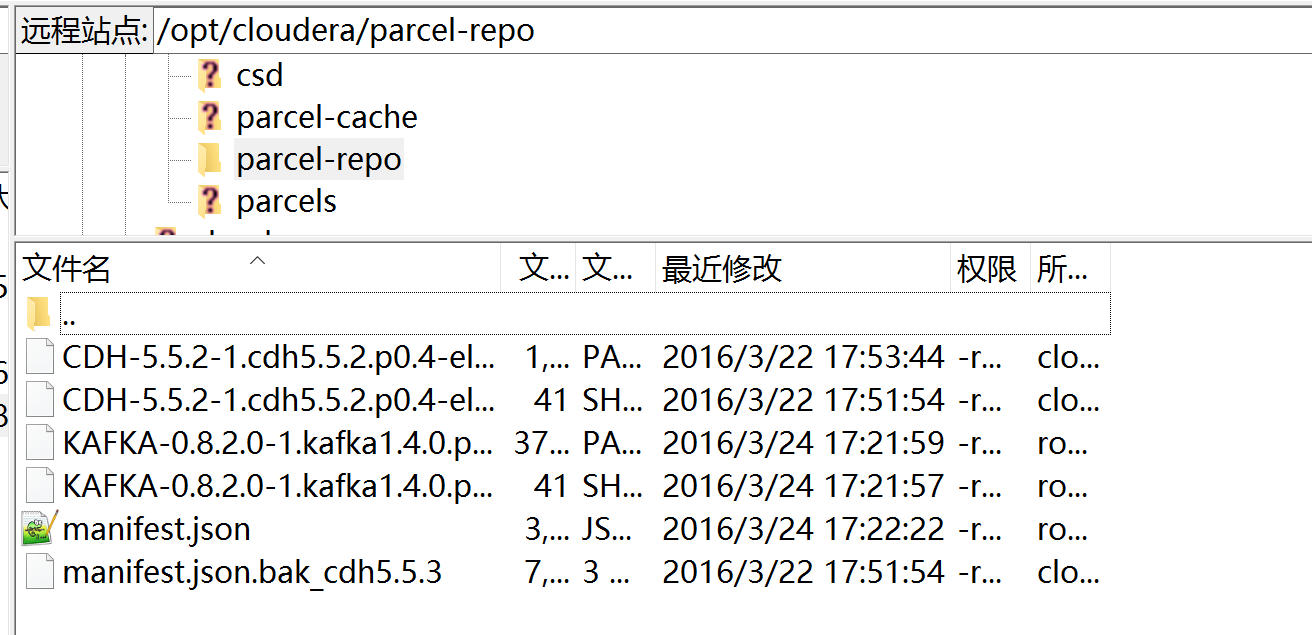

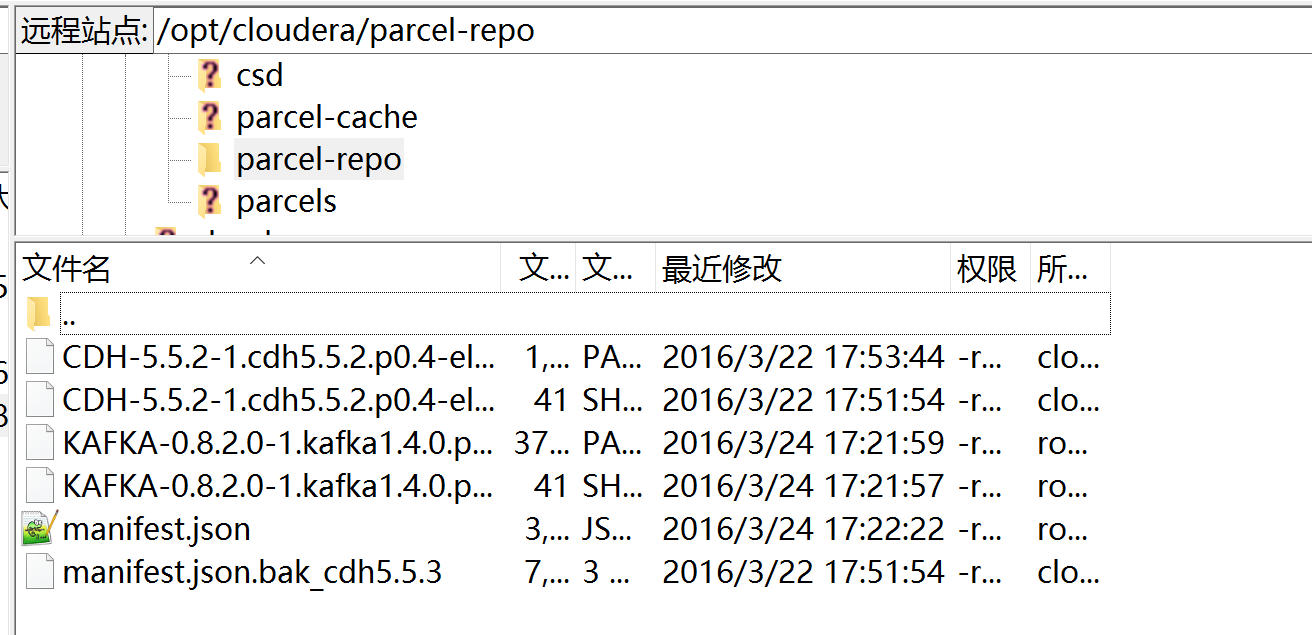

将parcel包放到cm安装节点下的/opt/cloudera/parcel-repo目录下,如图:

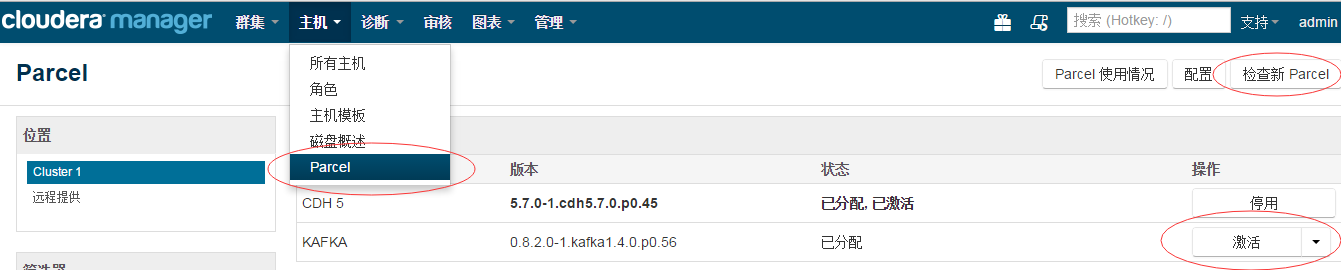

1.3 检查更新,分配激活

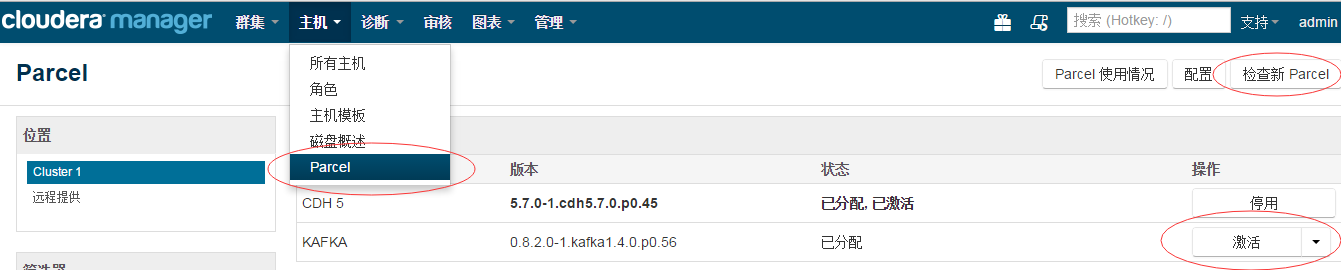

如下图,分配的kafka parcels必须要激活。

如下图,激活成功

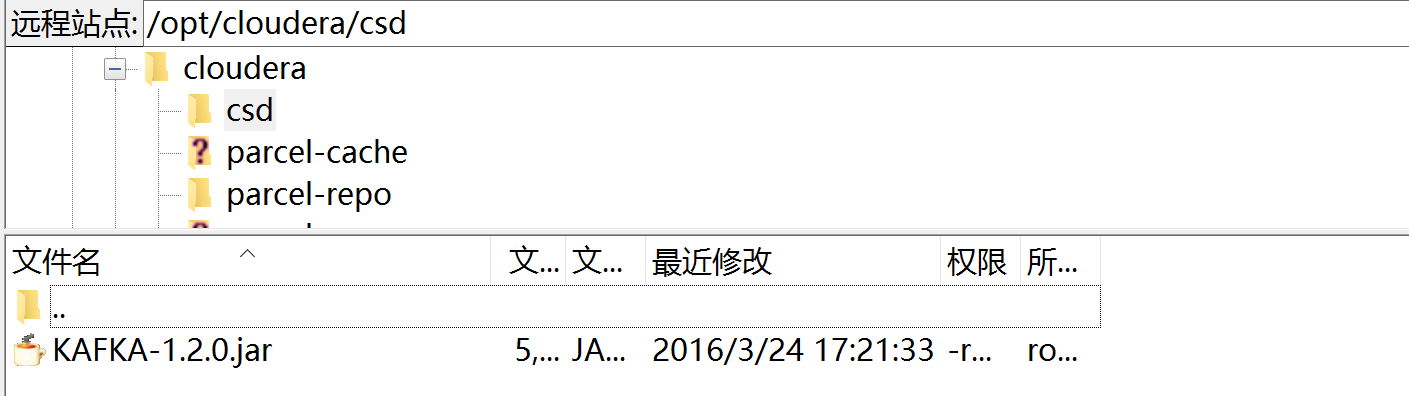

1.4 往集群里添加kafka服务

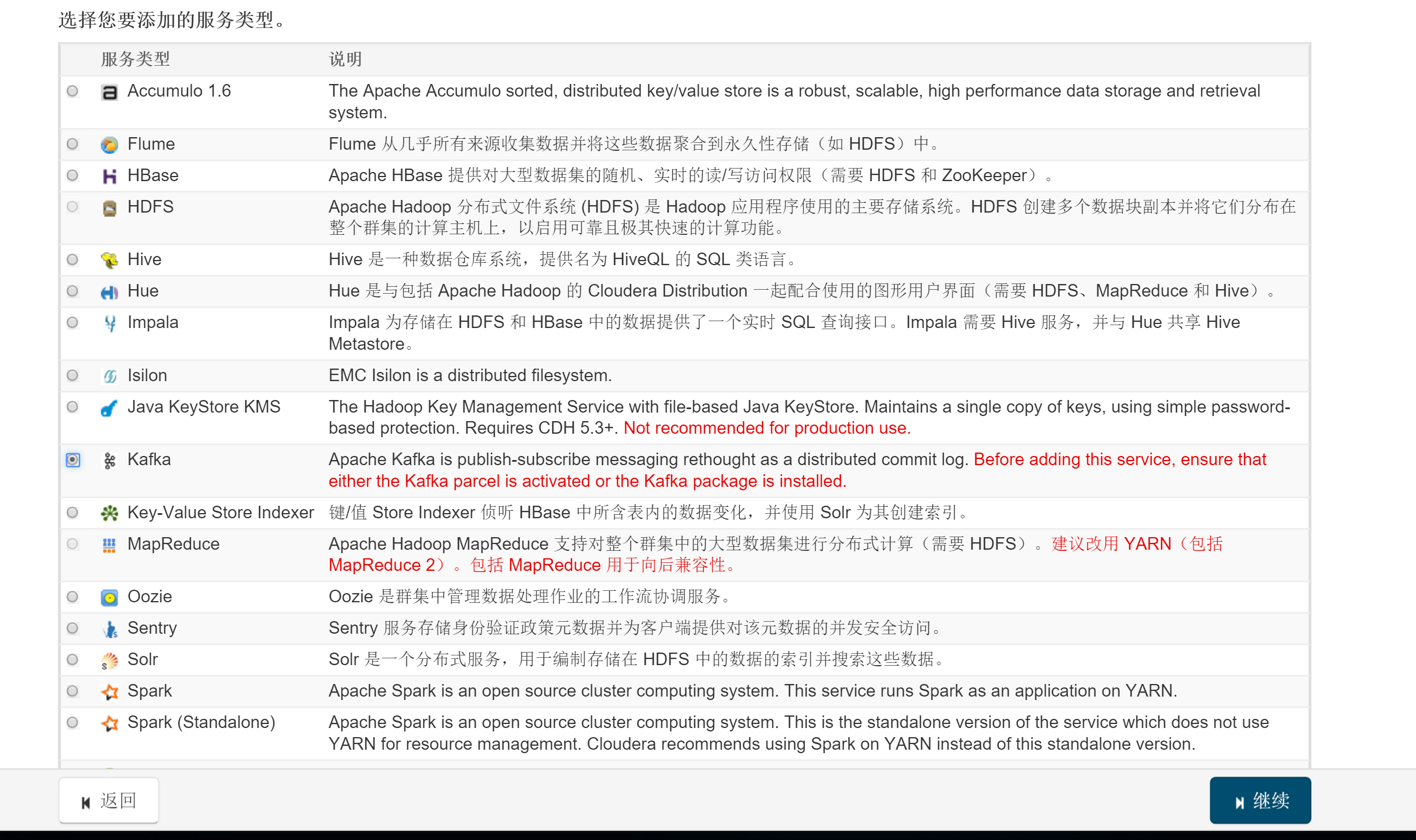

如下图:

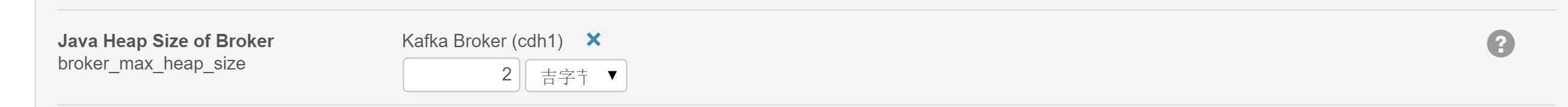

1.5 kafka配置

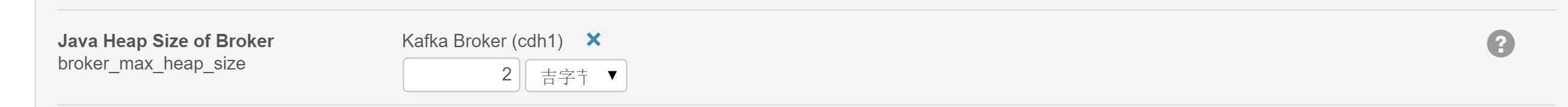

安装kafka服务时,会报java heap memory out

进主机各broker中配置一看,居然默认是50M(奇葩配置),改为2G以上

:

参考CDH官网文档http://www.cloudera.com/content/www/en-us/documentation/kafka/latest/topics/kafka_installing.html 在CDH官网中关于Kafka的安装和升级中已经说到,在CDH中,Kafka作为一个分布式的parcel,单独出来作为parcel分发安装包。

1.1 Kafka parcels包下载

csd包:http://archive.cloudera.com/csds/kafka/

parcel包: http://archive.cloudera.com/kafka/parcels/latest/ (根据自己的集群的系统版本下载)

1.2 Kafka parcels包上传

上传 KAFKA-1.2.0.jar放到cm安装节点下的 /opt/cloudera/csd目录下,如图 :

将parcel包放到cm安装节点下的/opt/cloudera/parcel-repo目录下,如图:

1.3 检查更新,分配激活

如下图,分配的kafka parcels必须要激活。

如下图,激活成功

1.4 往集群里添加kafka服务

如下图:

1.5 kafka配置

安装kafka服务时,会报java heap memory out

进主机各broker中配置一看,居然默认是50M(奇葩配置),改为2G以上

:

相关文章推荐

- Cloudera 推动即时通讯巨头 LINE 实现数据驱动的创新

- RedHat 5.8 安装Oracle 11gR2_Grid集群

- mysql集群之MMM简单搭建

- MySQL的集群配置的基本命令使用及一次操作过程实录

- MySQL slave_net_timeout参数解决的一个集群问题案例

- Redis 集群搭建和简单使用教程

- Windows Server 2003 下配置 MySQL 集群(Cluster)教程

- tomcat6_apache2.2_ajp 负载均衡加集群实战分享

- 用apache和tomcat搭建集群(负载均衡)

- Red Hat Linux,Apache2.0+Weblogic9.2负载均衡集群安装配置

- Hadoop单机版和全分布式(集群)安装

- java结合HADOOP集群文件上传下载

- Spring3.2.0和Quartz1.8.6集群配置

- (Weblogic Portal 9.2.3集群)Oracle数据库初始化报PF_MARKUP...

- HBase基本原理

- HDFS DatanodeProtocol——sendHeartbeat

- HDFS DatanodeProtocol——register

- Hadoop集群提交作业问题总结

- Hadoop源码分析 HDFS ClientProtocol——addBlock