机器学习基础(五十八)—— 香农熵、相对熵(KL散度)与交叉熵

2016-04-28 21:01

330 查看

1. 香农熵(Shannon entropy)

信息熵(又叫香农熵)反映了一个系统的无序化(有序化)程度,一个系统越有序,信息熵就越低,反之就越高。如果一个随机变量 X 的可能取值为 X={x1,x2,…,xn},对应的概率为 p(X=xi),则随机变量 X 的信息熵为:

H(X)=−∑i=1np(xi)logp(xi)

2. 相对熵(relative entropy)

所谓相对,自然在两个随机变量之间。又称互熵,Kullback–Leibler divergence(K-L 散度)等。设 p(x) 和 q(x) 是 X 取值的两个概率分布,则 p 对 q 的相对熵为:D(p||q)=∑i=1np(x)logp(x)q(x)

在一定程度上,熵可以度量两个随机变量的距离。KL 散度是两个概率分布 P 和 Q 差别的非对称性的度量。KL 散度是用来度量使用基于 Q 的编码来编码来自 P 的样本平均所需的额外的位元数。

典型情况下,P 表示数据的真实分布,Q 表示数据的理论分布,模型分布,或 P 的近似分布。

相对熵的性质,相对熵(KL散度)有两个主要的性质。如下

(1)尽管 KL 散度从直观上是个度量或距离函数,但它并不是一个真正的度量或者距离,因为它不具有对称性,即

D(p||q)≠D(q||p)

(2)相对熵的值为非负值,即

D(p||q)≥0

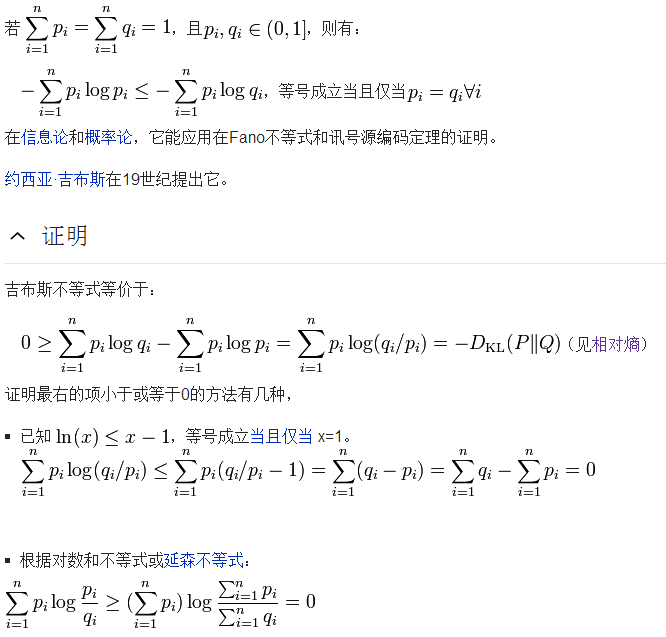

在证明之前,需要认识一个重要的不等式,叫做吉布斯不等式。内容如下

这里提供一个离散型 KL 散度的简单实现:

from functools import reduce import operator import math def kl(p, q): return reduce(operator.add, map(lambda x, y: x*math.log(x/y), p, q))

3. 交叉熵(cross entropy)

H(p,q)=−∑xp(x)logq(x)相关文章推荐

- CentOS7 + Django + mysql

- ElasticSearch学习17_Failed to deserialize response of type [*.SearchResponse]错误原因

- vs2012工程不能创建或是某工程不存在解决办法

- iOS 自定义UIDatePicker日期选择器视图 —— HERO博客

- Java中包装器类的作用

- #leetcode#24. Swap Nodes in Pairs

- 【Linux C王者归来】【第十章】【进程环境】

- 9.5.2 Connection对象

- Ajax返回状态为200但进入error方法

- 9.5.2 Connection对象

- 安卓---连续点击两次返回键退出程序---二级界面的退出程序

- 第七周 学习进度表

- 团队项目2.0

- MATLAB 与python reshape 比较

- SQL语句

- phpstorm的一些小节

- golang注记

- SNS基础

- JSON详解!!!

- LeetCode 338. Counting Bits C语言