常见排序整理

2016-04-26 10:50

141 查看

原文地址:http://blog.csdn.net/xiazdong/article/details/8462393

http://blog.csdn.net/whuslei/article/details/6442755

本文是 http://blog.csdn.net/xiazdong/article/details/7304239 的补充,当年看了《大话数据结构》总结的,但是现在看了《算法导论》,发现以前对排序的理解还不深入,所以打算对各个排序的思想再整理一遍。

本文首先介绍了基于比较模型的排序算法,即最坏复杂度都在Ω(nlgn)的排序算法,接着介绍了一些线性时间排序算法,这些排序算法虽然都在线性时间,但是都是在对输入数组有一定的约束的前提下才行。

这篇文章参看了《算法导论》第2、3、4、6、7、8章而总结。

算法的由来:9世纪波斯数学家提出的:“al-Khowarizmi”

排序的定义:

输入:n个数:a1,a2,a3,...,an

输出:n个数的排列:a1',a2',a3',...,an',使得a1'<=a2'<=a3'<=...<=an'。

In-place sort(不占用额外内存或占用常数的内存):插入排序、选择排序、冒泡排序、堆排序、快速排序。

Out-place sort:归并排序、计数排序、基数排序、桶排序。

当需要对大量数据进行排序时,In-place sort就显示出优点,因为只需要占用常数的内存。

设想一下,如果要对10000个数据排序,如果使用了Out-place sort,则假设需要用200G的额外空间,则一台老式电脑会吃不消,但是如果使用In-place sort,则不需要花费额外内存。

stable sort:插入排序、冒泡排序、归并排序、计数排序、基数排序、桶排序。

unstable sort:选择排序(5 8 5 2 9)、快速排序、堆排序。

为何排序的稳定性很重要?

在初学排序时会觉得稳定性有这么重要吗?两个一样的元素的顺序有这么重要吗?其实很重要。在基数排序中显得尤为突出,如下:

算法导论习题8.3-2说:如果对于不稳定的算法进行改进,使得那些不稳定的算法也稳定?

其实很简单,只需要在每个输入元素加一个index,表示初始时的数组索引,当不稳定的算法排好序后,对于相同的元素对index排序即可。

基于比较的排序都是遵循“决策树模型”,而在决策树模型中,我们能证明给予比较的排序算法最坏情况下的运行时间为Ω(nlgn),证明的思路是因为将n个序列构成的决策树的叶子节点个数至少有n!,因此高度至少为nlgn。

线性时间排序虽然能够理想情况下能在线性时间排序,但是每个排序都需要对输入数组做一些假设,比如计数排序需要输入数组数字范围为[0,k]等。

在排序算法的正确性证明中介绍了”循环不变式“,他类似于数学归纳法,"初始"对应"n=1","保持"对应"假设n=k成立,当n=k+1时"。

最优复杂度:当输入数组就是排好序的时候,复杂度为O(n),而快速排序在这种情况下会产生O(n^2)的复杂度。

最差复杂度:当输入数组为倒序时,复杂度为O(n^2)

插入排序比较适合用于“少量元素的数组”。

其实插入排序的复杂度和逆序对的个数一样,当数组倒序时,逆序对的个数为n(n-1)/2,因此插入排序复杂度为O(n^2)。

在算法导论2-4中有关于逆序对的介绍。

伪代码:

证明算法正确性:

循环不变式:在每次循环开始前,A[1...i-1]包含了原来的A[1...i-1]的元素,并且已排序。

初始:i=2,A[1...1]已排序,成立。

保持:在迭代开始前,A[1...i-1]已排序,而循环体的目的是将A[i]插入A[1...i-1]中,使得A[1...i]排序,因此在下一轮迭代开 始前,i++,因此现在A[1...i-1]排好序了,因此保持循环不变式。

终止:最后i=n+1,并且A[1...n]已排序,而A[1...n]就是整个数组,因此证毕。

而在算法导论2.3-6中还问是否能将伪代码第6-8行用二分法实现?

实际上是不能的。因为第6-8行并不是单纯的线性查找,而是还要移出一个空位让A[i]插入,因此就算二分查找用O(lgn)查到了插入的位置,但是还是要用O(n)的时间移出一个空位。

问:快速排序(不使用随机化)是否一定比插入排序快?

答:不一定,当输入数组已经排好序时,插入排序需要O(n)时间,而快速排序需要O(n^2)时间。

思想:通过两两交换,像水中的泡泡一样,小的先冒出来,大的后冒出来。

最坏运行时间:O(n^2)

最佳运行时间:O(n^2)(当然,也可以进行改进使得最佳运行时间为O(n))

算法导论思考题2-2中介绍了冒泡排序。

伪代码:

证明算法正确性:

运用两次循环不变式,先证明第4-6行的内循环,再证明外循环。

内循环不变式:在每次循环开始前,A[j]是A[j...n]中最小的元素。

初始:j=n,因此A

是A[n...n]的最小元素。

保持:当循环开始时,已知A[j]是A[j...n]的最小元素,将A[j]与A[j-1]比较,并将较小者放在j-1位置,因此能够说明A[j-1]是A[j-1...n]的最小元素,因此循环不变式保持。

终止:j=i,已知A[i]是A[i...n]中最小的元素,证毕。

接下来证明外循环不变式:在每次循环之前,A[1...i-1]包含了A中最小的i-1个元素,且已排序:A[1]<=A[2]<=...<=A[i-1]。

初始:i=1,因此A[1..0]=空,因此成立。

保持:当循环开始时,已知A[1...i-1]是A中最小的i-1个元素,且A[1]<=A[2]<=...<=A[i-1],根据内循环不变式,终止时A[i]是A[i...n]中最小的元素,因此A[1...i]包含了A中最小的i个元素,且A[1]<=A[2]<=...<=A[i-1]<=A[i]

终止:i=n+1,已知A[1...n]是A中最小的n个元素,且A[1]<=A[2]<=...<=A

,得证。

在算法导论思考题2-2中又问了”冒泡排序和插入排序哪个更快“呢?

一般的人回答:“差不多吧,因为渐近时间都是O(n^2)”。

但是事实上不是这样的,插入排序的速度直接是逆序对的个数,而冒泡排序中执行“交换“的次数是逆序对的个数,因此冒泡排序执行的时间至少是逆序对的个数,因此插入排序的执行时间至少比冒泡排序快。

递归版冒泡排序

改进版冒泡排序

最佳运行时间:O(n)

最坏运行时间:O(n^2)

思想:每次找一个最小值。

最好情况时间:O(n^2)。

最坏情况时间:O(n^2)。

伪代码:

证明算法正确性:

循环不变式:A[1...i-1]包含了A中最小的i-1个元素,且已排序。

初始:i=1,A[1...0]=空,因此成立。

保持:在某次迭代开始之前,保持循环不变式,即A[1...i-1]包含了A中最小的i-1个元素,且已排序,则进入循环体后,程序从 A[i...n]中找出最小值放在A[i]处,因此A[1...i]包含了A中最小的i个元素,且已排序,而i++,因此下一次循环之前,保持

循环不变式:A[1..i-1]包含了A中最小的i-1个元素,且已排序。

终止:i=n,已知A[1...n-1]包含了A中最小的i-1个元素,且已排序,因此A

中的元素是最大的,因此A[1...n]已排序,证毕。

算法导论2.2-2中问了"为什么伪代码中第3行只有循环n-1次而不是n次"?

在循环不变式证明中也提到了,如果A[1...n-1]已排序,且包含了A中最小的n-1个元素,则A

肯定是最大的,因此肯定是已排序的。

递归版选择排序

递归式:

T(n)=T(n-1)+O(n)

=> T(n)=O(n^2)

思想:运用分治法思想解决排序问题。

最坏情况运行时间:O(nlgn)

最佳运行时间:O(nlgn)

分治法介绍:分治法就是将原问题分解为多个独立的子问题,且这些子问题的形式和原问题相似,只是规模上减少了,求解完子问题后合并结果构成原问题的解。

分治法通常有3步:Divide(分解子问题的步骤) 、 Conquer(递归解决子问题的步骤)、 Combine(子问题解求出来后合并成原问题解的步骤)。

假设Divide需要f(n)时间,Conquer分解为b个子问题,且子问题大小为a,Combine需要g(n)时间,则递归式为:

T(n)=bT(n/a)+f(n)+g(n)

算法导论思考题4-3(参数传递)能够很好的考察对于分治法的理解。

就如归并排序,Divide的步骤为m=(p+q)/2,因此为O(1),Combine步骤为merge()函数,Conquer步骤为分解为2个子问题,子问题大小为n/2,因此:

归并排序的递归式:T(n)=2T(n/2)+O(n)

而求解递归式的三种方法有:

(1)替换法:主要用于验证递归式的复杂度。

(2)递归树:能够大致估算递归式的复杂度,估算完后可以用替换法验证。

(3)主定理:用于解一些常见的递归式。

伪代码:

证明算法正确性:

其实我们只要证明merge()函数的正确性即可。

merge函数的主要步骤在第25~31行,可以看出是由一个循环构成。

循环不变式:每次循环之前,A[p...k-1]已排序,且L[i]和R[j]是L和R中剩下的元素中最小的两个元素。

初始:k=p,A[p...p-1]为空,因此已排序,成立。

保持:在第k次迭代之前,A[p...k-1]已经排序,而因为L[i]和R[j]是L和R中剩下的元素中最小的两个元素,因此只需要将L[i]和R[j]中最小的元素放到A[k]即可,在第k+1次迭代之前A[p...k]已排序,且L[i]和R[j]为剩下的最小的两个元素。

终止:k=q+1,且A[p...q]已排序,这就是我们想要的,因此证毕。

归并排序的例子:

问:归并排序的缺点是什么?

答:他是Out-place sort,因此相比快排,需要很多额外的空间。

问:为什么归并排序比快速排序慢?

答:虽然渐近复杂度一样,但是归并排序的系数比快排大。

问:对于归并排序有什么改进?

答:就是在数组长度为k时,用插入排序,因为插入排序适合对小数组排序。在算法导论思考题2-1中介绍了。复杂度为O(nk+nlg(n/k)) ,当k=O(lgn)时,复杂度为O(nlgn)

算法导论中讲解的快速排序的PARTITION是Lomuto提出的,是对Hoare的算法进行一些改变的,而算法导论7-1介绍了Hoare的快排。

特性:unstable sort、In-place sort。

最坏运行时间:当输入数组已排序时,时间为O(n^2),当然可以通过随机化来改进(shuffle array 或者 randomized select pivot),使得期望运行时间为O(nlgn)。

最佳运行时间:O(nlgn)

快速排序的思想也是分治法。

当输入数组的所有元素都一样时,不管是快速排序还是随机化快速排序的复杂度都为O(n^2),而在算法导论第三版的思考题7-2中通过改变Partition函数,从而改进复杂度为O(n)。

注意:只要partition的划分比例是常数的,则快排的效率就是O(nlgn),比如当partition的划分比例为10000:1时(足够不平衡了),快排的效率还是O(nlgn)

“A killer adversary for quicksort”这篇文章很有趣的介绍了怎么样设计一个输入数组,使得quicksort运行时间为O(n^2)。

伪代码:

随机化partition的实现:

改进当所有元素相同时的效率的Partition实现:

证明算法正确性:

对partition函数证明循环不变式:A[p...i]的所有元素小于等于pivot,A[i+1...j-1]的所有元素大于pivot。

初始:i=p-1,j=p,因此A[p...p-1]=空,A[p...p-1]=空,因此成立。

保持:当循环开始前,已知A[p...i]的所有元素小于等于pivot,A[i+1...j-1]的所有元素大于pivot,在循环体中,

- 如果A[j]>pivot,那么不动,j++,此时A[p...i]的所有元素小于等于pivot,A[i+1...j-1]的所有元素大于pivot。

- 如果A[j]<=pivot,则i++,A[i+1]>pivot,将A[i+1]和A[j]交换后,A[P...i]保持所有元素小于等于pivot,而A[i+1...j-1]的所有元素大于pivot。

终止:j=r,因此A[p...i]的所有元素小于等于pivot,A[i+1...r-1]的所有元素大于pivot。

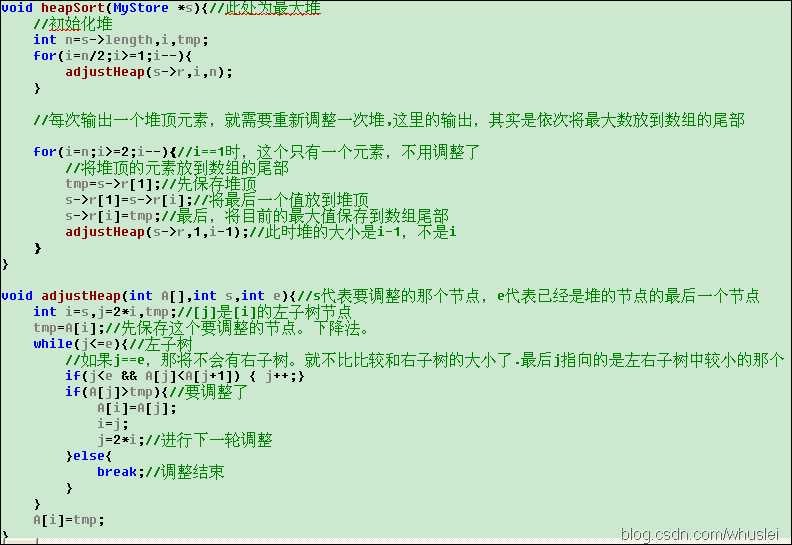

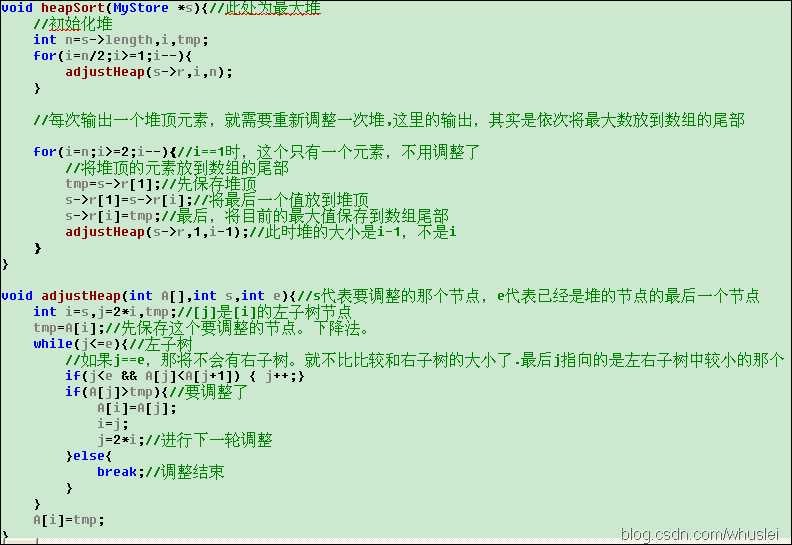

特性:unstable sort、In-place sort。

最优时间:O(nlgn)

最差时间:O(nlgn)

此篇文章介绍了堆排序的最优时间和最差时间的证明:/article/7665027.html

思想:运用了最小堆、最大堆这个数据结构,而堆还能用于构建优先队列。

优先队列应用于进程间调度、任务调度等。

堆数据结构应用于Dijkstra、Prim算法。

证明算法正确性:

(1)证明build_max_heap的正确性:

循环不变式:每次循环开始前,A[i+1]、A[i+2]、...、A

分别为最大堆的根。

初始:i=floor(n/2),则A[i+1]、...、A

都是叶子,因此成立。

保持:每次迭代开始前,已知A[i+1]、A[i+2]、...、A

分别为最大堆的根,在循环体中,因为A[i]的孩子的子树都是最大堆,因此执行完MAX_HEAPIFY(A,i)后,A[i]也是最大堆的根,因此保持循环不变式。

终止:i=0,已知A[1]、...、A

都是最大堆的根,得到了A[1]是最大堆的根,因此证毕。

(2)证明heapsort的正确性:

循环不变式:每次迭代前,A[i+1]、...、A

包含了A中最大的n-i个元素,且A[i+1]<=A[i+2]<=...<=A

,且A[1]是堆中最大的。

初始:i=n,A[n+1]...A

为空,成立。

保持:每次迭代开始前,A[i+1]、...、A

包含了A中最大的n-i个元素,且A[i+1]<=A[i+2]<=...<=A

,循环体内将A[1]与A[i]交换,因为A[1]是堆中最大的,因此A[i]、...、A

包含了A中最大的n-i+1个元素且A[i]<=A[i+1]<=A[i+2]<=...<=A

,因此保持循环不变式。

终止:i=1,已知A[2]、...、A

包含了A中最大的n-1个元素,且A[2]<=A[3]<=...<=A

,因此A[1]<=A[2]<=A[3]<=...<=A

,证毕。

最坏情况运行时间:O(n+k)

最好情况运行时间:O(n+k)

当k=O(n)时,计数排序时间为O(n)

伪代码:

特性:stable sort、Out-place sort。

最坏情况运行时间:O((n+k)d)

最好情况运行时间:O((n+k)d)

当d为常数、k=O(n)时,效率为O(n)

我们也不一定要一位一位排序,我们可以多位多位排序,比如一共10位,我们可以先对低5位排序,再对高5位排序。

引理:假设n个b位数,将b位数分为多个单元,且每个单元为r位,那么基数排序的效率为O[(b/r)(n+2^r)]。

当b=O(nlgn),r=lgn时,基数排序效率O(n)

比如算法导论习题8.3-4:说明如何在O(n)时间内,对0~n^2-1之间的n个整数排序?

答案:将这些数化为2进制,位数为lg(n^2)=2lgn=O(lgn),因此利用引理,b=O(lgn),而我们设r=lgn,则基数排序可以在O(n)内排序。

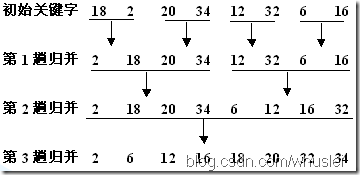

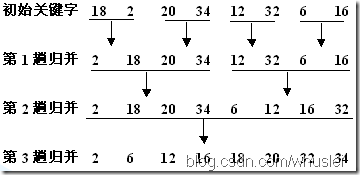

基数排序的例子:

证明算法正确性:

通过循环不变式可证,证明略。

特性:out-place sort、stable sort。

最坏情况运行时间:当分布不均匀时,全部元素都分到一个桶中,则O(n^2),当然[算法导论8.4-2]也可以将插入排序换成堆排序、快速排序等,这样最坏情况就是O(nlgn)。

最好情况运行时间:O(n)

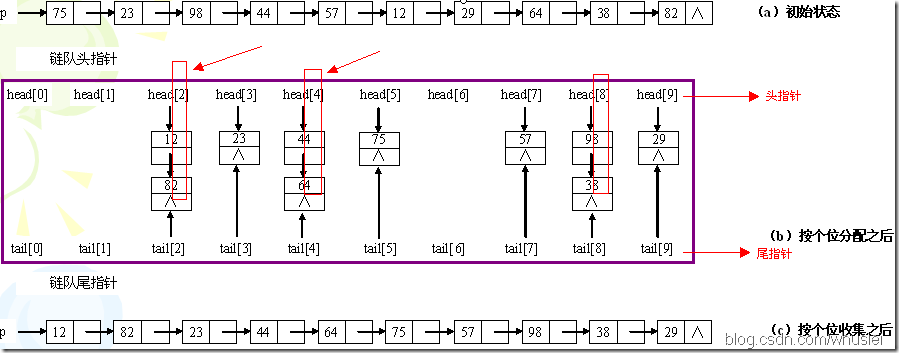

桶排序的例子:

伪代码:

证明算法正确性:

对于任意A[i]<=A[j],且A[i]落在B[a],A[j]落在B,我们可以看出a<=b,因此得证。

——————————————————————————————————————————————————————————————————————————

排序算法经过了很长时间的演变,产生了很多种不同的方法。对于初学者来说,对它们进行整理便于理解记忆显得很重要。每种算法都有它特定的使用场合,很难通用。因此,我们很有必要对所有常见的排序算法进行归纳。

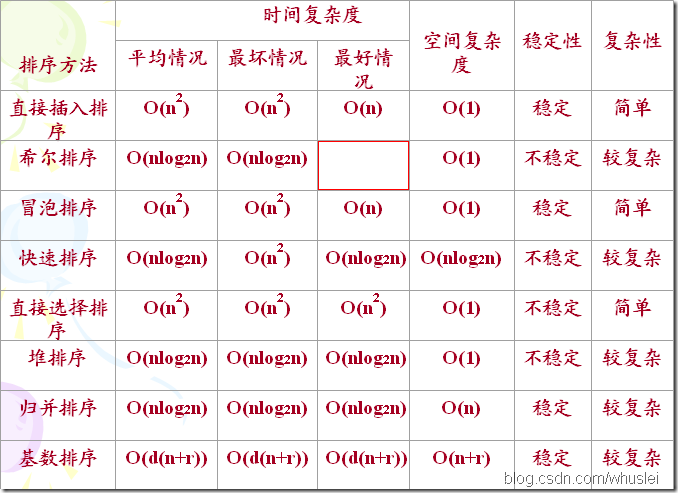

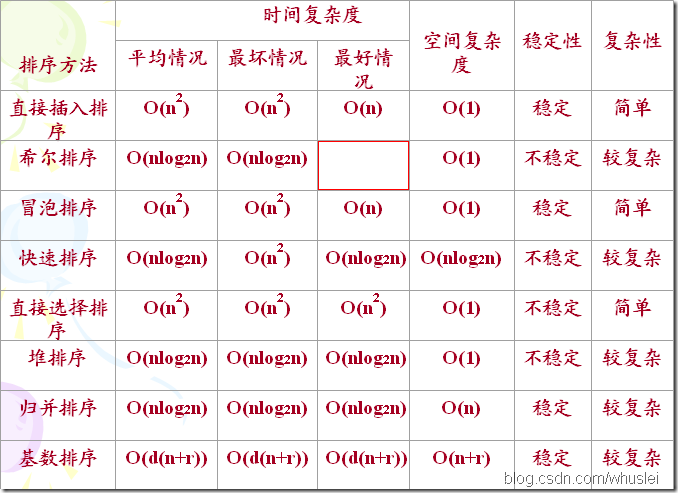

我不喜欢死记硬背,我更偏向于弄清来龙去脉,理解性地记忆。比如下面这张图,我们将围绕这张图来思考几个问题。

上面的这张图来自一个PPT。它概括了数据结构中的所有常见的排序算法。现在有以下几个问题:

1、每个算法的思想是什么?

2、每个算法的稳定性怎样?时间复杂度是多少?

3、在什么情况下,算法出现最好情况 or 最坏情况?

4、每种算法的具体实现又是怎样的?

这个是排序算法里面最基本,也是最常考的问题。下面是我的小结。

[b]一、直接插入排序(插入排序)。

1、算法的伪代码(这样便于理解):

INSERTION-SORT (A, n) A[1 . . n]

for j ←2 to n

do key ← A[ j]

i ← j – 1

while i > 0 and A[i] > key

do A[i+1] ← A[i]

i ← i – 1

A[i+1] = key

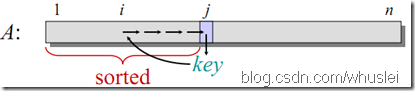

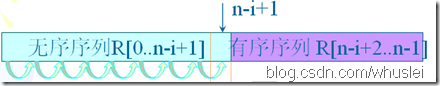

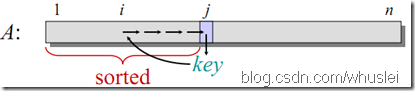

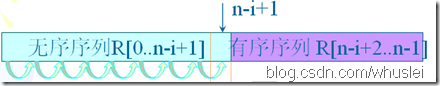

2、思想:如下图所示,每次选择一个元素K插入到之前已排好序的部分A[1…i]中,插入过程中K依次由后向前与A[1…i]中的元素进行比较。若发现发现A[x]>=K,则将K插入到A[x]的后面,插入前需要移动元素。

3、算法时间复杂度。

最好的情况下:正序有序(从小到大),这样只需要比较n次,不需要移动。因此时间复杂度为O(n)

最坏的情况下:逆序有序,这样每一个元素就需要比较n次,共有n个元素,因此实际复杂度为O(n2)

平均情况下:O(n2)

4、稳定性。

理解性记忆比死记硬背要好。因此,我们来分析下。稳定性,就是有两个相同的元素,排序先后的相对位置是否变化,主要用在排序时有多个排序规则的情况下。在插入排序中,K1是已排序部分中的元素,当K2和K1比较时,直接插到K1的后面(没有必要插到K1的前面,这样做还需要移动!!),因此,插入排序是稳定的。

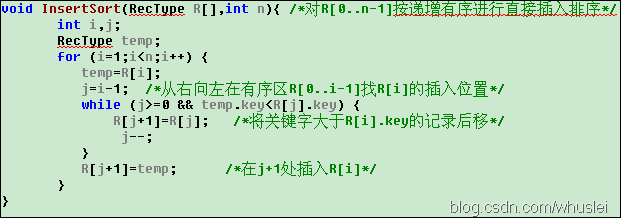

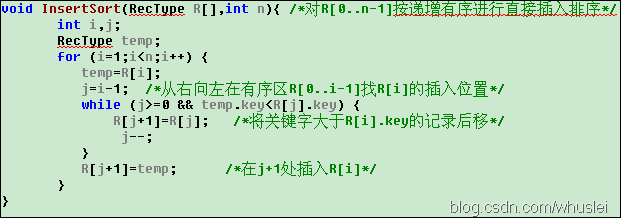

5、代码(c版) blog.csdn.com/whuslei

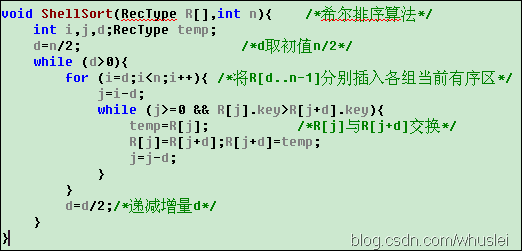

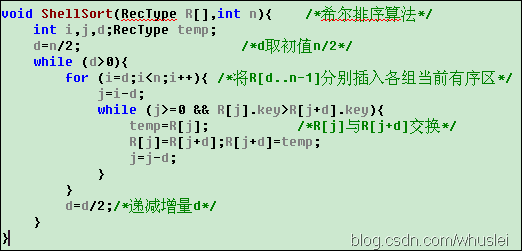

二、希尔排序(插入排序)

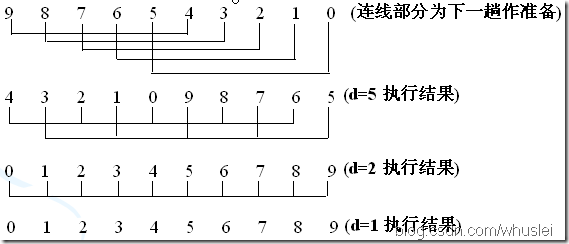

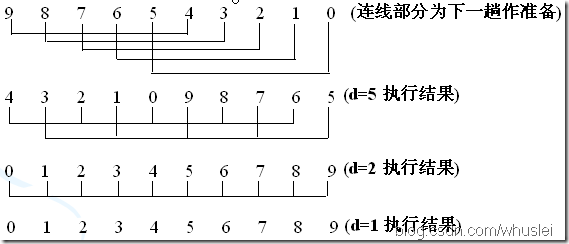

1、思想:希尔排序也是一种插入排序方法,实际上是一种分组插入方法。先取定一个小于n的整数d1作为第一个增量,把表的全部记录分成d1个组,所有距离为d1的倍数的记录放在同一个组中,在各组内进行直接插入排序;然后,取第二个增量d2(<d1),重复上述的分组和排序,直至所取的增量dt=1(dt<dt-1<…<d2<d1),即所有记录放在同一组中进行直接插入排序为止。

例如:将 n 个记录分成 d 个子序列:

{ R[0], R[d], R[2d],…, R[kd] }

{ R[1], R[1+d], R[1+2d],…,R[1+kd] }

…

{ R[d-1],R[2d-1],R[3d-1],…,R[(k+1)d-1] }

说明:d=5 时,先从A[d]开始向前插入,判断A[d-d],然后A[d+1]与A[(d+1)-d]比较,如此类推,这一回合后将原序列分为d个组。<由后向前>

2、时间复杂度。

最好情况:由于希尔排序的好坏和步长d的选择有很多关系,因此,目前还没有得出最好的步长如何选择(现在有些比较好的选择了,但不确定是否是最好的)。所以,不知道最好的情况下的算法时间复杂度。

最坏情况下:O(N*logN),最坏的情况下和平均情况下差不多。

平均情况下:O(N*logN)

3、稳定性。

由于多次插入排序,我们知道一次插入排序是稳定的,不会改变相同元素的相对顺序,但在不同的插入排序过程中,相同的元素可能在各自的插入排序中移动,最后其稳定性就会被打乱,所以shell排序是不稳定的。(有个猜测,方便记忆:一般来说,若存在不相邻元素间交换,则很可能是不稳定的排序。)

4、代码(c版) blog.csdn.com/whuslei

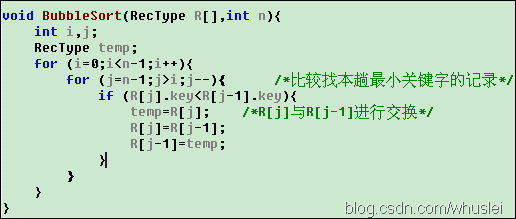

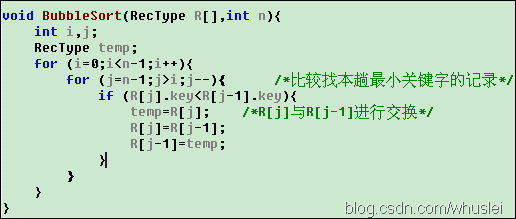

三、冒泡排序(交换排序)

1、基本思想:通过无序区中相邻记录关键字间的比较和位置的交换,使关键字最小的记录如气泡一般逐渐往上“漂浮”直至“水面”。

2、时间复杂度

最好情况下:正序有序,则只需要比较n次。故,为O(n)

最坏情况下: 逆序有序,则需要比较(n-1)+(n-2)+……+1,故,为O(N*N)

3、稳定性

排序过程中只交换相邻两个元素的位置。因此,当两个数相等时,是没必要交换两个数的位置的。所以,它们的相对位置并没有改变,冒泡排序算法是稳定的!

4、代码(c版) blog.csdn.com/whuslei

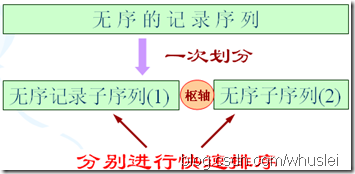

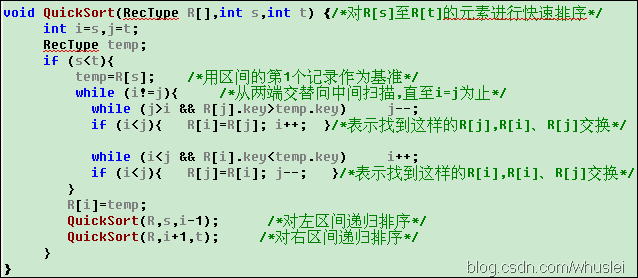

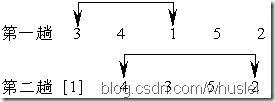

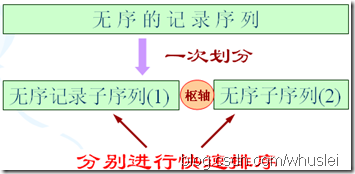

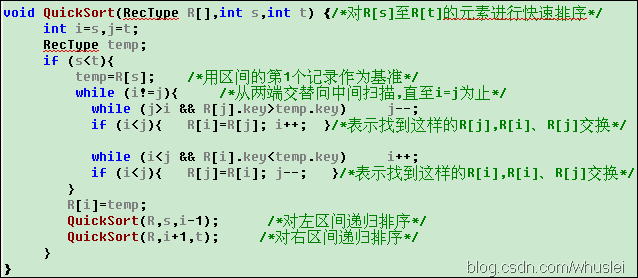

四、快速排序(交换排序)

1、思想:它是由冒泡排序改进而来的。在待排序的n个记录中任取一个记录(通常取第一个记录),把该记录放入适当位置后,数据序列被此记录划分成两部分。所有关键字比该记录关键字小的记录放置在前一部分,所有比它大的记录放置在后一部分,并把该记录排在这两部分的中间(称为该记录归位),这个过程称作一趟快速排序。

说明:最核心的思想是将小的部分放在左边,大的部分放到右边,实现分割。

2、算法复杂度

最好的情况下:因为每次都将序列分为两个部分(一般二分都复杂度都和logN相关),故为 O(N*logN)

最坏的情况下:基本有序时,退化为冒泡排序,几乎要比较N*N次,故为O(N*N)

3、稳定性

由于每次都需要和中轴元素交换,因此原来的顺序就可能被打乱。如序列为 5 3 3 4 3 8 9 10 11会将3的顺序打乱。所以说,快速排序是不稳定的!

4、代码(c版)

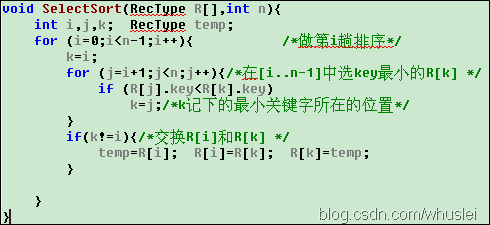

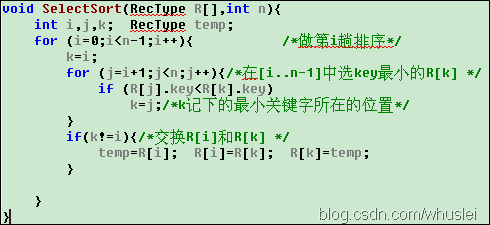

五、直接选择排序(选择排序)

1、思想:首先在未排序序列中找到最小元素,存放到排序序列的起始位置,然后,再从剩余未排序元素中继续寻找最小元素,然后放到排序序列末尾。以此类推,直到所有元素均排序完毕。具体做法是:选择最小的元素与未排序部分的首部交换,使得序列的前面为有序。

2、时间复杂度。

最好情况下:交换0次,但是每次都要找到最小的元素,因此大约必须遍历N*N次,因此为O(N*N)。减少了交换次数!

最坏情况下,平均情况下:O(N*N)

3、稳定性

由于每次都是选取未排序序列A中的最小元素x与A中的第一个元素交换,因此跨距离了,很可能破坏了元素间的相对位置,因此选择排序是不稳定的!

4、代码(c版)blog.csdn.com/whuslei

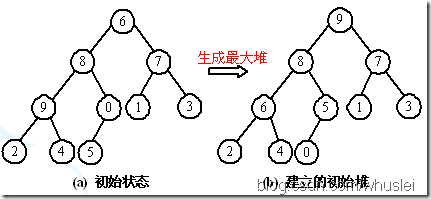

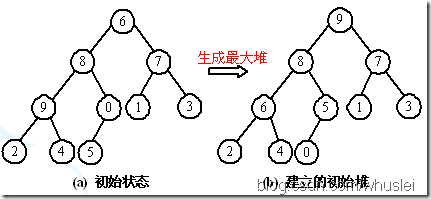

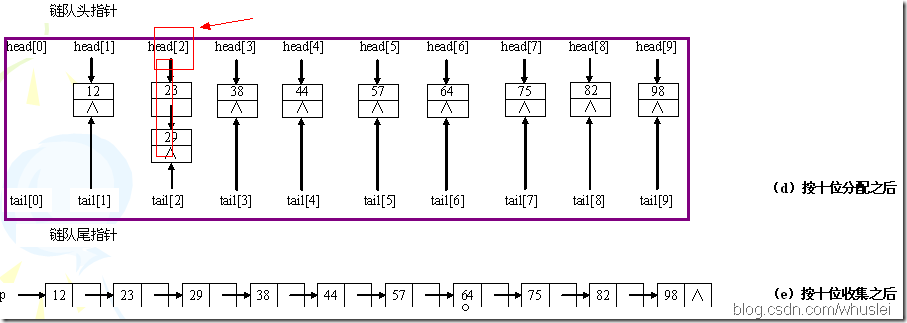

六、堆排序

1、思想:利用完全二叉树中双亲节点和孩子节点之间的内在关系,在当前无序区中选择关键字最大(或者最小)的记录。也就是说,以最小堆为例,根节点为最小元素,较大的节点偏向于分布在堆底附近。

2、算法复杂度

最坏情况下,接近于最差情况下:O(N*logN),因此它是一种效果不错的排序算法。

3、稳定性

堆排序需要不断地调整堆,因此它是一种不稳定的排序!

4、代码(c版,看代码后更容易理解!)

七、归并排序

1、思想:多次将两个或两个以上的有序表合并成一个新的有序表。

2、算法时间复杂度

最好的情况下:一趟归并需要n次,总共需要logN次,因此为O(N*logN)

最坏的情况下,接近于平均情况下,为O(N*logN)

说明:对长度为n的文件,需进行logN 趟二路归并,每趟归并的时间为O(n),故其时间复杂度无论是在最好情况下还是在最坏情况下均是O(nlgn)。

3、稳定性

归并排序最大的特色就是它是一种稳定的排序算法。归并过程中是不会改变元素的相对位置的。

4、缺点是,它需要O(n)的额外空间。但是很适合于多链表排序。

5、代码(略)blog.csdn.com/whuslei

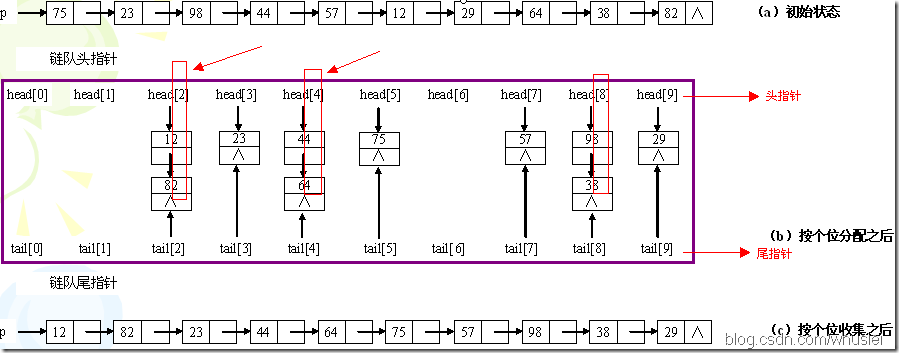

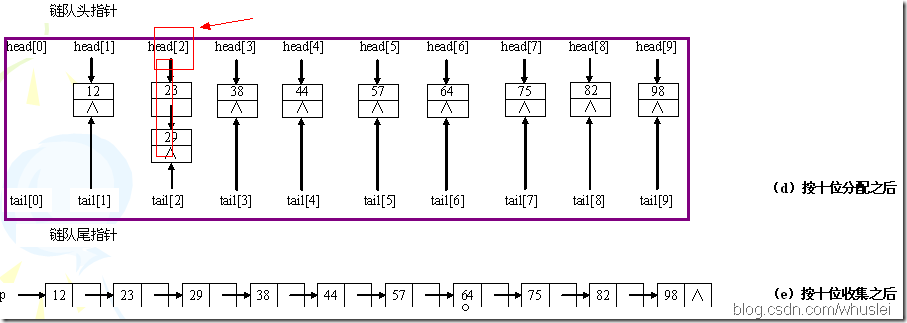

八、基数排序

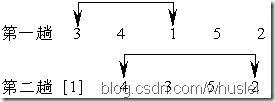

1、思想:它是一种非比较排序。它是根据位的高低进行排序的,也就是先按个位排序,然后依据十位排序……以此类推。示例如下:

2、算法的时间复杂度

分配需要O(n),收集为O(r),其中r为分配后链表的个数,以r=10为例,则有0~9这样10个链表来将原来的序列分类。而d,也就是位数(如最大的数是1234,位数是4,则d=4),即"分配-收集"的趟数。因此时间复杂度为O(d*(n+r))。

3、稳定性

基数排序过程中不改变元素的相对位置,因此是稳定的!

4、适用情况:如果有一个序列,知道数的范围(比如1~1000),用快速排序或者堆排序,需要O(N*logN),但是如果采用基数排序,则可以达到O(4*(n+10))=O(n)的时间复杂度。算是这种情况下排序最快的!!

5、代码(略)

总结: 每种算法都要它适用的条件,本文也仅仅是回顾了下基础。如有不懂的地方请参考课本。

如有转载,请注明:blog.csdn.com/whuslei

http://blog.csdn.net/whuslei/article/details/6442755

本文是 http://blog.csdn.net/xiazdong/article/details/7304239 的补充,当年看了《大话数据结构》总结的,但是现在看了《算法导论》,发现以前对排序的理解还不深入,所以打算对各个排序的思想再整理一遍。

本文首先介绍了基于比较模型的排序算法,即最坏复杂度都在Ω(nlgn)的排序算法,接着介绍了一些线性时间排序算法,这些排序算法虽然都在线性时间,但是都是在对输入数组有一定的约束的前提下才行。

这篇文章参看了《算法导论》第2、3、4、6、7、8章而总结。

算法的由来:9世纪波斯数学家提出的:“al-Khowarizmi”

排序的定义:

输入:n个数:a1,a2,a3,...,an

输出:n个数的排列:a1',a2',a3',...,an',使得a1'<=a2'<=a3'<=...<=an'。

In-place sort(不占用额外内存或占用常数的内存):插入排序、选择排序、冒泡排序、堆排序、快速排序。

Out-place sort:归并排序、计数排序、基数排序、桶排序。

当需要对大量数据进行排序时,In-place sort就显示出优点,因为只需要占用常数的内存。

设想一下,如果要对10000个数据排序,如果使用了Out-place sort,则假设需要用200G的额外空间,则一台老式电脑会吃不消,但是如果使用In-place sort,则不需要花费额外内存。

stable sort:插入排序、冒泡排序、归并排序、计数排序、基数排序、桶排序。

unstable sort:选择排序(5 8 5 2 9)、快速排序、堆排序。

为何排序的稳定性很重要?

在初学排序时会觉得稳定性有这么重要吗?两个一样的元素的顺序有这么重要吗?其实很重要。在基数排序中显得尤为突出,如下:

算法导论习题8.3-2说:如果对于不稳定的算法进行改进,使得那些不稳定的算法也稳定?

其实很简单,只需要在每个输入元素加一个index,表示初始时的数组索引,当不稳定的算法排好序后,对于相同的元素对index排序即可。

基于比较的排序都是遵循“决策树模型”,而在决策树模型中,我们能证明给予比较的排序算法最坏情况下的运行时间为Ω(nlgn),证明的思路是因为将n个序列构成的决策树的叶子节点个数至少有n!,因此高度至少为nlgn。

线性时间排序虽然能够理想情况下能在线性时间排序,但是每个排序都需要对输入数组做一些假设,比如计数排序需要输入数组数字范围为[0,k]等。

在排序算法的正确性证明中介绍了”循环不变式“,他类似于数学归纳法,"初始"对应"n=1","保持"对应"假设n=k成立,当n=k+1时"。

一、插入排序

特点:stable sort、In-place sort最优复杂度:当输入数组就是排好序的时候,复杂度为O(n),而快速排序在这种情况下会产生O(n^2)的复杂度。

最差复杂度:当输入数组为倒序时,复杂度为O(n^2)

插入排序比较适合用于“少量元素的数组”。

其实插入排序的复杂度和逆序对的个数一样,当数组倒序时,逆序对的个数为n(n-1)/2,因此插入排序复杂度为O(n^2)。

在算法导论2-4中有关于逆序对的介绍。

伪代码:

证明算法正确性:

循环不变式:在每次循环开始前,A[1...i-1]包含了原来的A[1...i-1]的元素,并且已排序。

初始:i=2,A[1...1]已排序,成立。

保持:在迭代开始前,A[1...i-1]已排序,而循环体的目的是将A[i]插入A[1...i-1]中,使得A[1...i]排序,因此在下一轮迭代开 始前,i++,因此现在A[1...i-1]排好序了,因此保持循环不变式。

终止:最后i=n+1,并且A[1...n]已排序,而A[1...n]就是整个数组,因此证毕。

而在算法导论2.3-6中还问是否能将伪代码第6-8行用二分法实现?

实际上是不能的。因为第6-8行并不是单纯的线性查找,而是还要移出一个空位让A[i]插入,因此就算二分查找用O(lgn)查到了插入的位置,但是还是要用O(n)的时间移出一个空位。

问:快速排序(不使用随机化)是否一定比插入排序快?

答:不一定,当输入数组已经排好序时,插入排序需要O(n)时间,而快速排序需要O(n^2)时间。

递归版插入排序

二、冒泡排序

特点:stable sort、In-place sort思想:通过两两交换,像水中的泡泡一样,小的先冒出来,大的后冒出来。

最坏运行时间:O(n^2)

最佳运行时间:O(n^2)(当然,也可以进行改进使得最佳运行时间为O(n))

算法导论思考题2-2中介绍了冒泡排序。

伪代码:

证明算法正确性:

运用两次循环不变式,先证明第4-6行的内循环,再证明外循环。

内循环不变式:在每次循环开始前,A[j]是A[j...n]中最小的元素。

初始:j=n,因此A

是A[n...n]的最小元素。

保持:当循环开始时,已知A[j]是A[j...n]的最小元素,将A[j]与A[j-1]比较,并将较小者放在j-1位置,因此能够说明A[j-1]是A[j-1...n]的最小元素,因此循环不变式保持。

终止:j=i,已知A[i]是A[i...n]中最小的元素,证毕。

接下来证明外循环不变式:在每次循环之前,A[1...i-1]包含了A中最小的i-1个元素,且已排序:A[1]<=A[2]<=...<=A[i-1]。

初始:i=1,因此A[1..0]=空,因此成立。

保持:当循环开始时,已知A[1...i-1]是A中最小的i-1个元素,且A[1]<=A[2]<=...<=A[i-1],根据内循环不变式,终止时A[i]是A[i...n]中最小的元素,因此A[1...i]包含了A中最小的i个元素,且A[1]<=A[2]<=...<=A[i-1]<=A[i]

终止:i=n+1,已知A[1...n]是A中最小的n个元素,且A[1]<=A[2]<=...<=A

,得证。

在算法导论思考题2-2中又问了”冒泡排序和插入排序哪个更快“呢?

一般的人回答:“差不多吧,因为渐近时间都是O(n^2)”。

但是事实上不是这样的,插入排序的速度直接是逆序对的个数,而冒泡排序中执行“交换“的次数是逆序对的个数,因此冒泡排序执行的时间至少是逆序对的个数,因此插入排序的执行时间至少比冒泡排序快。

递归版冒泡排序

改进版冒泡排序

最佳运行时间:O(n)

最坏运行时间:O(n^2)

三、选择排序

特性:In-place sort,unstable sort。思想:每次找一个最小值。

最好情况时间:O(n^2)。

最坏情况时间:O(n^2)。

伪代码:

证明算法正确性:

循环不变式:A[1...i-1]包含了A中最小的i-1个元素,且已排序。

初始:i=1,A[1...0]=空,因此成立。

保持:在某次迭代开始之前,保持循环不变式,即A[1...i-1]包含了A中最小的i-1个元素,且已排序,则进入循环体后,程序从 A[i...n]中找出最小值放在A[i]处,因此A[1...i]包含了A中最小的i个元素,且已排序,而i++,因此下一次循环之前,保持

循环不变式:A[1..i-1]包含了A中最小的i-1个元素,且已排序。

终止:i=n,已知A[1...n-1]包含了A中最小的i-1个元素,且已排序,因此A

中的元素是最大的,因此A[1...n]已排序,证毕。

算法导论2.2-2中问了"为什么伪代码中第3行只有循环n-1次而不是n次"?

在循环不变式证明中也提到了,如果A[1...n-1]已排序,且包含了A中最小的n-1个元素,则A

肯定是最大的,因此肯定是已排序的。

递归版选择排序

递归式:

T(n)=T(n-1)+O(n)

=> T(n)=O(n^2)

四、归并排序

特点:stable sort、Out-place sort思想:运用分治法思想解决排序问题。

最坏情况运行时间:O(nlgn)

最佳运行时间:O(nlgn)

分治法介绍:分治法就是将原问题分解为多个独立的子问题,且这些子问题的形式和原问题相似,只是规模上减少了,求解完子问题后合并结果构成原问题的解。

分治法通常有3步:Divide(分解子问题的步骤) 、 Conquer(递归解决子问题的步骤)、 Combine(子问题解求出来后合并成原问题解的步骤)。

假设Divide需要f(n)时间,Conquer分解为b个子问题,且子问题大小为a,Combine需要g(n)时间,则递归式为:

T(n)=bT(n/a)+f(n)+g(n)

算法导论思考题4-3(参数传递)能够很好的考察对于分治法的理解。

就如归并排序,Divide的步骤为m=(p+q)/2,因此为O(1),Combine步骤为merge()函数,Conquer步骤为分解为2个子问题,子问题大小为n/2,因此:

归并排序的递归式:T(n)=2T(n/2)+O(n)

而求解递归式的三种方法有:

(1)替换法:主要用于验证递归式的复杂度。

(2)递归树:能够大致估算递归式的复杂度,估算完后可以用替换法验证。

(3)主定理:用于解一些常见的递归式。

伪代码:

证明算法正确性:

其实我们只要证明merge()函数的正确性即可。

merge函数的主要步骤在第25~31行,可以看出是由一个循环构成。

循环不变式:每次循环之前,A[p...k-1]已排序,且L[i]和R[j]是L和R中剩下的元素中最小的两个元素。

初始:k=p,A[p...p-1]为空,因此已排序,成立。

保持:在第k次迭代之前,A[p...k-1]已经排序,而因为L[i]和R[j]是L和R中剩下的元素中最小的两个元素,因此只需要将L[i]和R[j]中最小的元素放到A[k]即可,在第k+1次迭代之前A[p...k]已排序,且L[i]和R[j]为剩下的最小的两个元素。

终止:k=q+1,且A[p...q]已排序,这就是我们想要的,因此证毕。

归并排序的例子:

问:归并排序的缺点是什么?

答:他是Out-place sort,因此相比快排,需要很多额外的空间。

问:为什么归并排序比快速排序慢?

答:虽然渐近复杂度一样,但是归并排序的系数比快排大。

问:对于归并排序有什么改进?

答:就是在数组长度为k时,用插入排序,因为插入排序适合对小数组排序。在算法导论思考题2-1中介绍了。复杂度为O(nk+nlg(n/k)) ,当k=O(lgn)时,复杂度为O(nlgn)

五、快速排序

Tony Hoare爵士在1962年发明,被誉为“20世纪十大经典算法之一”。算法导论中讲解的快速排序的PARTITION是Lomuto提出的,是对Hoare的算法进行一些改变的,而算法导论7-1介绍了Hoare的快排。

特性:unstable sort、In-place sort。

最坏运行时间:当输入数组已排序时,时间为O(n^2),当然可以通过随机化来改进(shuffle array 或者 randomized select pivot),使得期望运行时间为O(nlgn)。

最佳运行时间:O(nlgn)

快速排序的思想也是分治法。

当输入数组的所有元素都一样时,不管是快速排序还是随机化快速排序的复杂度都为O(n^2),而在算法导论第三版的思考题7-2中通过改变Partition函数,从而改进复杂度为O(n)。

注意:只要partition的划分比例是常数的,则快排的效率就是O(nlgn),比如当partition的划分比例为10000:1时(足够不平衡了),快排的效率还是O(nlgn)

“A killer adversary for quicksort”这篇文章很有趣的介绍了怎么样设计一个输入数组,使得quicksort运行时间为O(n^2)。

伪代码:

随机化partition的实现:

改进当所有元素相同时的效率的Partition实现:

证明算法正确性:

对partition函数证明循环不变式:A[p...i]的所有元素小于等于pivot,A[i+1...j-1]的所有元素大于pivot。

初始:i=p-1,j=p,因此A[p...p-1]=空,A[p...p-1]=空,因此成立。

保持:当循环开始前,已知A[p...i]的所有元素小于等于pivot,A[i+1...j-1]的所有元素大于pivot,在循环体中,

- 如果A[j]>pivot,那么不动,j++,此时A[p...i]的所有元素小于等于pivot,A[i+1...j-1]的所有元素大于pivot。

- 如果A[j]<=pivot,则i++,A[i+1]>pivot,将A[i+1]和A[j]交换后,A[P...i]保持所有元素小于等于pivot,而A[i+1...j-1]的所有元素大于pivot。

终止:j=r,因此A[p...i]的所有元素小于等于pivot,A[i+1...r-1]的所有元素大于pivot。

六、堆排序

1964年Williams提出。特性:unstable sort、In-place sort。

最优时间:O(nlgn)

最差时间:O(nlgn)

此篇文章介绍了堆排序的最优时间和最差时间的证明:/article/7665027.html

思想:运用了最小堆、最大堆这个数据结构,而堆还能用于构建优先队列。

优先队列应用于进程间调度、任务调度等。

堆数据结构应用于Dijkstra、Prim算法。

证明算法正确性:

(1)证明build_max_heap的正确性:

循环不变式:每次循环开始前,A[i+1]、A[i+2]、...、A

分别为最大堆的根。

初始:i=floor(n/2),则A[i+1]、...、A

都是叶子,因此成立。

保持:每次迭代开始前,已知A[i+1]、A[i+2]、...、A

分别为最大堆的根,在循环体中,因为A[i]的孩子的子树都是最大堆,因此执行完MAX_HEAPIFY(A,i)后,A[i]也是最大堆的根,因此保持循环不变式。

终止:i=0,已知A[1]、...、A

都是最大堆的根,得到了A[1]是最大堆的根,因此证毕。

(2)证明heapsort的正确性:

循环不变式:每次迭代前,A[i+1]、...、A

包含了A中最大的n-i个元素,且A[i+1]<=A[i+2]<=...<=A

,且A[1]是堆中最大的。

初始:i=n,A[n+1]...A

为空,成立。

保持:每次迭代开始前,A[i+1]、...、A

包含了A中最大的n-i个元素,且A[i+1]<=A[i+2]<=...<=A

,循环体内将A[1]与A[i]交换,因为A[1]是堆中最大的,因此A[i]、...、A

包含了A中最大的n-i+1个元素且A[i]<=A[i+1]<=A[i+2]<=...<=A

,因此保持循环不变式。

终止:i=1,已知A[2]、...、A

包含了A中最大的n-1个元素,且A[2]<=A[3]<=...<=A

,因此A[1]<=A[2]<=A[3]<=...<=A

,证毕。

七、计数排序

特性:stable sort、out-place sort。最坏情况运行时间:O(n+k)

最好情况运行时间:O(n+k)

当k=O(n)时,计数排序时间为O(n)

伪代码:

八、基数排序

本文假定每位的排序是计数排序。特性:stable sort、Out-place sort。

最坏情况运行时间:O((n+k)d)

最好情况运行时间:O((n+k)d)

当d为常数、k=O(n)时,效率为O(n)

我们也不一定要一位一位排序,我们可以多位多位排序,比如一共10位,我们可以先对低5位排序,再对高5位排序。

引理:假设n个b位数,将b位数分为多个单元,且每个单元为r位,那么基数排序的效率为O[(b/r)(n+2^r)]。

当b=O(nlgn),r=lgn时,基数排序效率O(n)

比如算法导论习题8.3-4:说明如何在O(n)时间内,对0~n^2-1之间的n个整数排序?

答案:将这些数化为2进制,位数为lg(n^2)=2lgn=O(lgn),因此利用引理,b=O(lgn),而我们设r=lgn,则基数排序可以在O(n)内排序。

基数排序的例子:

证明算法正确性:

通过循环不变式可证,证明略。

九、桶排序

假设输入数组的元素都在[0,1)之间。特性:out-place sort、stable sort。

最坏情况运行时间:当分布不均匀时,全部元素都分到一个桶中,则O(n^2),当然[算法导论8.4-2]也可以将插入排序换成堆排序、快速排序等,这样最坏情况就是O(nlgn)。

最好情况运行时间:O(n)

桶排序的例子:

伪代码:

证明算法正确性:

对于任意A[i]<=A[j],且A[i]落在B[a],A[j]落在B,我们可以看出a<=b,因此得证。

——————————————————————————————————————————————————————————————————————————

排序算法经过了很长时间的演变,产生了很多种不同的方法。对于初学者来说,对它们进行整理便于理解记忆显得很重要。每种算法都有它特定的使用场合,很难通用。因此,我们很有必要对所有常见的排序算法进行归纳。

我不喜欢死记硬背,我更偏向于弄清来龙去脉,理解性地记忆。比如下面这张图,我们将围绕这张图来思考几个问题。

上面的这张图来自一个PPT。它概括了数据结构中的所有常见的排序算法。现在有以下几个问题:

1、每个算法的思想是什么?

2、每个算法的稳定性怎样?时间复杂度是多少?

3、在什么情况下,算法出现最好情况 or 最坏情况?

4、每种算法的具体实现又是怎样的?

这个是排序算法里面最基本,也是最常考的问题。下面是我的小结。

[b]一、直接插入排序(插入排序)。

1、算法的伪代码(这样便于理解):

INSERTION-SORT (A, n) A[1 . . n]

for j ←2 to n

do key ← A[ j]

i ← j – 1

while i > 0 and A[i] > key

do A[i+1] ← A[i]

i ← i – 1

A[i+1] = key

2、思想:如下图所示,每次选择一个元素K插入到之前已排好序的部分A[1…i]中,插入过程中K依次由后向前与A[1…i]中的元素进行比较。若发现发现A[x]>=K,则将K插入到A[x]的后面,插入前需要移动元素。

3、算法时间复杂度。

最好的情况下:正序有序(从小到大),这样只需要比较n次,不需要移动。因此时间复杂度为O(n)

最坏的情况下:逆序有序,这样每一个元素就需要比较n次,共有n个元素,因此实际复杂度为O(n2)

平均情况下:O(n2)

4、稳定性。

理解性记忆比死记硬背要好。因此,我们来分析下。稳定性,就是有两个相同的元素,排序先后的相对位置是否变化,主要用在排序时有多个排序规则的情况下。在插入排序中,K1是已排序部分中的元素,当K2和K1比较时,直接插到K1的后面(没有必要插到K1的前面,这样做还需要移动!!),因此,插入排序是稳定的。

5、代码(c版) blog.csdn.com/whuslei

二、希尔排序(插入排序)

1、思想:希尔排序也是一种插入排序方法,实际上是一种分组插入方法。先取定一个小于n的整数d1作为第一个增量,把表的全部记录分成d1个组,所有距离为d1的倍数的记录放在同一个组中,在各组内进行直接插入排序;然后,取第二个增量d2(<d1),重复上述的分组和排序,直至所取的增量dt=1(dt<dt-1<…<d2<d1),即所有记录放在同一组中进行直接插入排序为止。

例如:将 n 个记录分成 d 个子序列:

{ R[0], R[d], R[2d],…, R[kd] }

{ R[1], R[1+d], R[1+2d],…,R[1+kd] }

…

{ R[d-1],R[2d-1],R[3d-1],…,R[(k+1)d-1] }

说明:d=5 时,先从A[d]开始向前插入,判断A[d-d],然后A[d+1]与A[(d+1)-d]比较,如此类推,这一回合后将原序列分为d个组。<由后向前>

2、时间复杂度。

最好情况:由于希尔排序的好坏和步长d的选择有很多关系,因此,目前还没有得出最好的步长如何选择(现在有些比较好的选择了,但不确定是否是最好的)。所以,不知道最好的情况下的算法时间复杂度。

最坏情况下:O(N*logN),最坏的情况下和平均情况下差不多。

平均情况下:O(N*logN)

3、稳定性。

由于多次插入排序,我们知道一次插入排序是稳定的,不会改变相同元素的相对顺序,但在不同的插入排序过程中,相同的元素可能在各自的插入排序中移动,最后其稳定性就会被打乱,所以shell排序是不稳定的。(有个猜测,方便记忆:一般来说,若存在不相邻元素间交换,则很可能是不稳定的排序。)

4、代码(c版) blog.csdn.com/whuslei

三、冒泡排序(交换排序)

1、基本思想:通过无序区中相邻记录关键字间的比较和位置的交换,使关键字最小的记录如气泡一般逐渐往上“漂浮”直至“水面”。

2、时间复杂度

最好情况下:正序有序,则只需要比较n次。故,为O(n)

最坏情况下: 逆序有序,则需要比较(n-1)+(n-2)+……+1,故,为O(N*N)

3、稳定性

排序过程中只交换相邻两个元素的位置。因此,当两个数相等时,是没必要交换两个数的位置的。所以,它们的相对位置并没有改变,冒泡排序算法是稳定的!

4、代码(c版) blog.csdn.com/whuslei

四、快速排序(交换排序)

1、思想:它是由冒泡排序改进而来的。在待排序的n个记录中任取一个记录(通常取第一个记录),把该记录放入适当位置后,数据序列被此记录划分成两部分。所有关键字比该记录关键字小的记录放置在前一部分,所有比它大的记录放置在后一部分,并把该记录排在这两部分的中间(称为该记录归位),这个过程称作一趟快速排序。

说明:最核心的思想是将小的部分放在左边,大的部分放到右边,实现分割。

2、算法复杂度

最好的情况下:因为每次都将序列分为两个部分(一般二分都复杂度都和logN相关),故为 O(N*logN)

最坏的情况下:基本有序时,退化为冒泡排序,几乎要比较N*N次,故为O(N*N)

3、稳定性

由于每次都需要和中轴元素交换,因此原来的顺序就可能被打乱。如序列为 5 3 3 4 3 8 9 10 11会将3的顺序打乱。所以说,快速排序是不稳定的!

4、代码(c版)

五、直接选择排序(选择排序)

1、思想:首先在未排序序列中找到最小元素,存放到排序序列的起始位置,然后,再从剩余未排序元素中继续寻找最小元素,然后放到排序序列末尾。以此类推,直到所有元素均排序完毕。具体做法是:选择最小的元素与未排序部分的首部交换,使得序列的前面为有序。

2、时间复杂度。

最好情况下:交换0次,但是每次都要找到最小的元素,因此大约必须遍历N*N次,因此为O(N*N)。减少了交换次数!

最坏情况下,平均情况下:O(N*N)

3、稳定性

由于每次都是选取未排序序列A中的最小元素x与A中的第一个元素交换,因此跨距离了,很可能破坏了元素间的相对位置,因此选择排序是不稳定的!

4、代码(c版)blog.csdn.com/whuslei

六、堆排序

1、思想:利用完全二叉树中双亲节点和孩子节点之间的内在关系,在当前无序区中选择关键字最大(或者最小)的记录。也就是说,以最小堆为例,根节点为最小元素,较大的节点偏向于分布在堆底附近。

2、算法复杂度

最坏情况下,接近于最差情况下:O(N*logN),因此它是一种效果不错的排序算法。

3、稳定性

堆排序需要不断地调整堆,因此它是一种不稳定的排序!

4、代码(c版,看代码后更容易理解!)

七、归并排序

1、思想:多次将两个或两个以上的有序表合并成一个新的有序表。

2、算法时间复杂度

最好的情况下:一趟归并需要n次,总共需要logN次,因此为O(N*logN)

最坏的情况下,接近于平均情况下,为O(N*logN)

说明:对长度为n的文件,需进行logN 趟二路归并,每趟归并的时间为O(n),故其时间复杂度无论是在最好情况下还是在最坏情况下均是O(nlgn)。

3、稳定性

归并排序最大的特色就是它是一种稳定的排序算法。归并过程中是不会改变元素的相对位置的。

4、缺点是,它需要O(n)的额外空间。但是很适合于多链表排序。

5、代码(略)blog.csdn.com/whuslei

八、基数排序

1、思想:它是一种非比较排序。它是根据位的高低进行排序的,也就是先按个位排序,然后依据十位排序……以此类推。示例如下:

2、算法的时间复杂度

分配需要O(n),收集为O(r),其中r为分配后链表的个数,以r=10为例,则有0~9这样10个链表来将原来的序列分类。而d,也就是位数(如最大的数是1234,位数是4,则d=4),即"分配-收集"的趟数。因此时间复杂度为O(d*(n+r))。

3、稳定性

基数排序过程中不改变元素的相对位置,因此是稳定的!

4、适用情况:如果有一个序列,知道数的范围(比如1~1000),用快速排序或者堆排序,需要O(N*logN),但是如果采用基数排序,则可以达到O(4*(n+10))=O(n)的时间复杂度。算是这种情况下排序最快的!!

5、代码(略)

总结: 每种算法都要它适用的条件,本文也仅仅是回顾了下基础。如有不懂的地方请参考课本。

如有转载,请注明:blog.csdn.com/whuslei

相关文章推荐

- android中MotionEvent.ACTION_CANCEL事件如何被触发?

- C++ 构造双向链表的实现代码

- redis配置详解

- 浏览器和服务器端数据传输的多种方式

- typedef struct bit0 : 1

- docker学习资料整理(持续更新中..)

- redis 数据持久化

- MyLinearLayout 之 初级学习经验

- ASP.NET中Literal与Label控件的区别

- 浅谈 iOS 版本号

- 完整的web请求与响应

- 设计模式——迭代器模式

- catalina.out日志按天输出

- Eclipse配置Git全过程-----------附用EGit不能push的问题解决

- RecyclerView

- C语言的setvbuf函数:设置文件流的缓冲区

- 建立软件开发团队时要避免的7个问题

- 剑指offer 连续子数组的最大和

- 大脑“芯片”与地平线机器人科技创新企业

- CSS3 的 appearance用法