python网络爬虫

这是转载他人的内容,原地址:http://my.oschina.net/yangyanxing/blog/160770

今天研究了下urllib2这个库的使用,才发现以前有很多不明白的东西,现在写下来也做个记录

1. 最基础的应用

?

客户端与服务器端通过request与response来沟通,客户端先向服务端发送request,然后接收服务端返回的response

urllib2提供了request的类,可以让用户在发送请求前先构造一个request的对象,然后通过urllib2.urlopen方法来发送请求

?

上例中先使用req = urllib2.Request(url)实例化一个resquest对象,接下来使用urllib2.urlopen(req)来打开这个网页

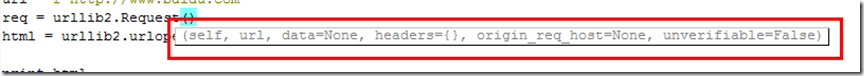

我们注意到在实例化Request对象的时候,队了url是必须的,还有几个默认的参数

基中data与header也是使用的比较多的,一些需要登录的才能浏览的网站经常需要这两个参数

?

这个例子是向百度发送几个数据,这个例子是会返回一个错误页面,很正常,因为我们在访问百度的时候并不需要post什么信息,post了倒是会出错

百度是找不到相应的网页就会报错。

当然这个是POST数据,也可以用在GET方法,稍将上面的代码进行改造

百度是通过http://www.baidu.com/s?wd=XXX 来进行查询的,这样我们需要将{‘wd’:’xxx’}这个字典进行urlencode

?

以下以模拟登录人人网然后再显示首页内容为例来详细说明一下cookie的使用,以下是文档中给的例子,我们就通过改造这个例子来实现我们想要的功能

?

?

当你看到有cj的时候,说明你已经访问了登录页面,是否正常登录你现在还看不出来,可以通过访问http://www.renren.com/home 来查看

上面的代码有两点要说明,我也是看了很长时间才明白

r = opener.open(url,data) 这句,为什么要使用opener这个对象来open,而不是用utllib2,urlopen?不光是例子里这么写,我们才这么写,通过改造我们也可以使用urllib2.urlopen,其实是因为opener是urllib2.bulid_opener创造出来的, 但是你可以这样理解,他build出来后,自已却并没有安装使用它,也没有它的属性与方法,如果想使urllib2也具有opener的属性与方法,可以先使用urllib2.install_opener(opener)来"安装"这个opener,安装完以后就可以使用urllib2来操作了

?

同样urllib2还有proxy相关的handle,基本的思路和这个差不多

- Python即时网络爬虫项目启动说明

- Python实例:网络爬虫抓取豆瓣3万本书(5)

- python学习笔记之网络爬虫(六)正则表达式(2)

- python 网络爬虫——请求头,ip代理

- python之网络爬虫

- 用 Python 写网络爬虫 第2版

- Python 实现网络爬虫小程序

- 【爬了个爬——学习Python网络爬虫】0.写在前面的话

- [Python]网络爬虫(九):百度贴吧的网络爬虫(v0.4)源码及解析

- python 网络爬虫开源框架scrapy

- 分享百度云链接 Python 3网络爬虫开发实战 ,崔庆才著

- 学习python写网络爬虫(二)

- Python网络爬虫框架scrapy的学习

- Python通用网络爬虫脚本

- python-网络爬虫初学三:网络异常的捕获

- Python 实现网络爬虫 抓取静态网页【代码】

- python网络爬虫之如何伪装逃过反爬虫程序的方法

- python爬虫 - python requests网络请求简洁之道

- 07精通Python网络爬虫——爬取京东手机图片

- [No000079]罗辑思维2016.1.2日前的所有每日语音,python3做的网络爬虫