机器学习-学习笔记3.1-局部加权回归

2014-11-21 20:01

357 查看

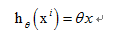

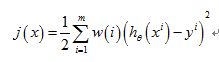

局部加权紧接着上面的线性回归中参数求解来继续讲吧。还是以上面的房屋价格的预测,它的中心思想是在对参数进行求解的过程中,每个样本对当前参数值的影响是有不一样的权重的。比如上节中我们的回归方程为(这个地方用矩阵的方法来表示Ɵ表示参数,i表示第i个样本,h为在Ɵ参数下的预测值):

我们的目标是让

最小,然后求出来Ɵ,再代入h中就可以得到回归方程了。

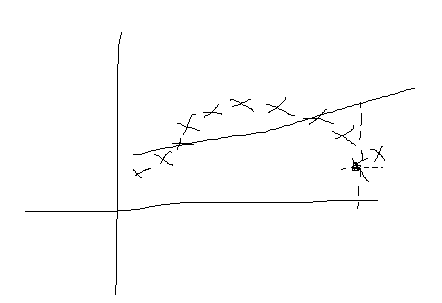

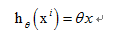

但是如果类似以下的样本,他们的对应图如下:

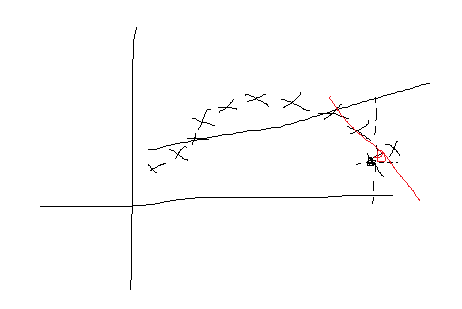

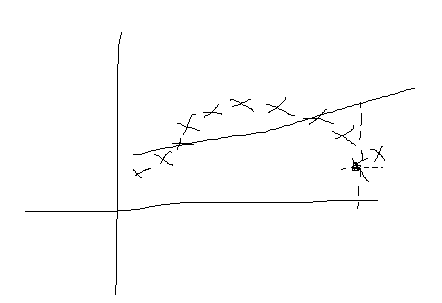

如果用之前的方法,图中线为求出的回归方程,那么在x的取值和真实差别很大,这个情况叫做欠拟合。那么我们怎么办呢?我们的主要思想就是只对x的附近的一些样本进行选择,根据这些样本得到x附近这些样本所推倒出来的回归方程,那么此时我们得到的回归方程就比较拟合样本数据,得到的效果图如下:

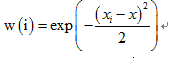

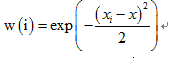

我们解的思路如下,加入一个加权因子:

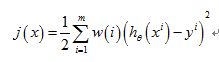

重新构造新的j(x)

Exp是以e为低的指数,这个时候可以知道如果x距离样本很远的时候w(i)=0,否则为1,当我们预测一个值的时候就需要我们重新来计算当前的参数Ɵ的值,然后构造回归方程,计算当前的预测值。

这就是局部加权回归LWR!

我们的目标是让

最小,然后求出来Ɵ,再代入h中就可以得到回归方程了。

但是如果类似以下的样本,他们的对应图如下:

如果用之前的方法,图中线为求出的回归方程,那么在x的取值和真实差别很大,这个情况叫做欠拟合。那么我们怎么办呢?我们的主要思想就是只对x的附近的一些样本进行选择,根据这些样本得到x附近这些样本所推倒出来的回归方程,那么此时我们得到的回归方程就比较拟合样本数据,得到的效果图如下:

我们解的思路如下,加入一个加权因子:

重新构造新的j(x)

Exp是以e为低的指数,这个时候可以知道如果x距离样本很远的时候w(i)=0,否则为1,当我们预测一个值的时候就需要我们重新来计算当前的参数Ɵ的值,然后构造回归方程,计算当前的预测值。

这就是局部加权回归LWR!

相关文章推荐

- 机器学习-学习笔记3.1-局部加权回归

- 机器学习-学习笔记3.1-局部加权回归

- 机器学习-学习笔记3.1-局部加权回归

- 机器学习第二篇(stanford大学公开课学习笔记) —局部加权回归

- 机器学习-学习笔记3.1-局部加权回归

- # 机器学习笔记2——参数学习、非参数学习、局部加权线性回归、线性回归的概率解释、logistics回归

- 斯坦福机器学习公开课学习笔记(3)—拟合问题以及局部权重回归、逻辑回归

- 机器学习笔记----最小二乘法,局部加权,岭回归讲解

- 机器学习笔记三 - 局部加权回归、最小二乘的概率解释、逻辑斯蒂回归、感知器算法

- (斯坦福机器学习课程笔记)局部加权线性回归练习

- 斯坦福机器学习: 网易公开课系列笔记(三)——局部加权回归、logistic回归

- 局部加权回归、欠拟合、过拟合 - Andrew Ng机器学习公开课笔记1.3

- 回归算法学习笔记(二)局部加权线性回归

- 机器学习—局部加权线性回归

- 机器学习实战线性回归局部加权线性回归笔记

- 监督学习-局部加权回归模板

- 机器学习:线性回归、局部加权线性回归、岭回归、前向逐步回归

- Andrew NG 机器学习听课笔记(2)——过学习与欠学习,最小二乘的概率意义、logistic回归

- 机器学习基础(三十) —— 线性回归、正则化(regularized)线性回归、局部加权线性回归(LWLR)

- 【学习笔记】斯坦福大学公开课(机器学习) 之一:线性回归、梯度下降