SVM(三),支持向量机,线性不可分和核函数

2014-03-13 14:33

302 查看

3.1 线性不可以分

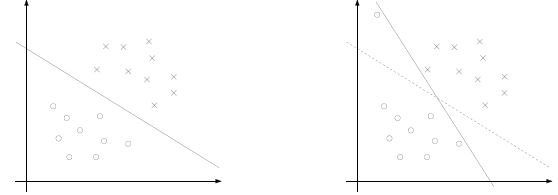

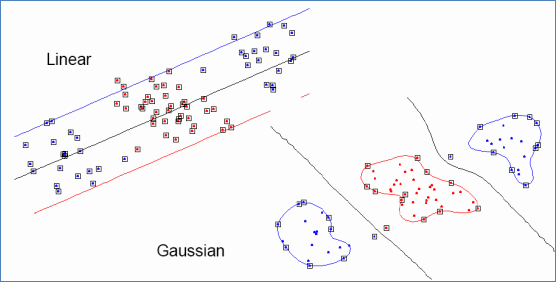

我们之前讨论的情况都是建立在样例线性可分的假设上,当样例线性不可分时,我们可以尝试使用核函数来将特征映射到高维,这样很可能就可分了。然而,映射后我们也不能100%保证可分。那怎么办呢,我们需要将模型进行调整,以保证在不可分的情况下,也能够尽可能地找出分隔超平面。看下面两张图:

可以看到一个离群点(可能是噪声)可以造成超平面的移动,间隔缩小,可见以前的模型对噪声非常敏感。再有甚者,如果离群点在另外一个类中,那么这时候就是线性不可分了。

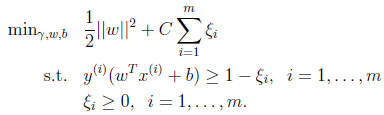

这时候我们应该允许一些点游离并在在模型中违背限制条件(函数间隔大于1)。我们设计得到新的模型如下(也称软间隔):

引入非负参数

后(称为松弛变量),就允许某些样本点的函数间隔小于1,即在最大间隔区间里面,或者函数间隔是负数,即样本点在对方的区域中。而放松限制条件后,我们需要重新调整目标函数,以对离群点进行处罚,目标函数后面加上的

就表示离群点越多,目标函数值越大,而我们要求的是尽可能小的目标函数值。这里的C是离群点的权重,C越大表明离群点对目标函数影响越大,也就是越不希望看到离群点。我们看到,目标函数控制了离群点的数目和程度,使大部分样本点仍然遵守限制条件。

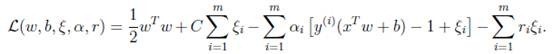

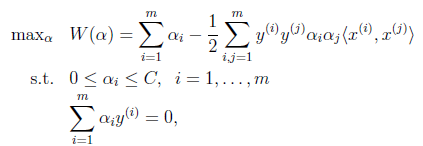

模型修改后,拉格朗日公式也要修改如下:

这里的

和

都是拉格朗日乘子,回想我们在拉格朗日对偶中提到的求法,先写出拉格朗日公式(如上),然后将其看作是变量w和b的函数,分别对其求偏导,得到w和b的表达式。然后代入公式中,求带入后公式的极大值。整个推导过程类似以前的模型,这里只写出最后结果如下:

此时,我们发现没有了参数

,与之前模型唯一不同在于

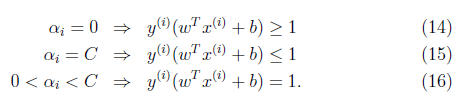

又多了

的限制条件。需要提醒的是,b的求值公式也发生了改变,改变结果在SMO算法里面介绍。先看看KKT条件的变化:

第一个式子表明在两条间隔线外的样本点前面的系数为0,离群样本点前面的系数为C,而支持向量(也就是在超平面两边的最大间隔线上)的样本点前面系数在(0,C)上。通过KKT条件可知,某些在最大间隔线上的样本点也不是支持向量,相反也可能是离群点。

10 坐标上升法(Coordinate ascent)

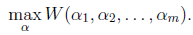

在最后讨论

的求解之前,我们先看看坐标上升法的基本原理。假设要求解下面的优化问题:

这里W是

向量的函数。之前我们在回归中提到过两种求最优解的方法,一种是梯度下降法,另外一种是牛顿法。现在我们再讲一种方法称为坐标上升法(求解最小值问题时,称作坐标下降法,原理一样)。

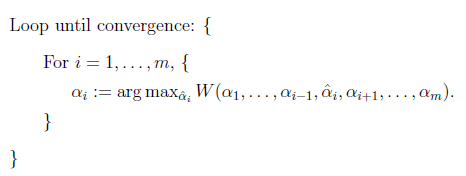

方法过程:

最里面语句的意思是固定除

之外的所有

,这时W可看作只是关于

的函数,那么直接对

求导优化即可。这里我们进行最大化求导的顺序i是从1到m,可以通过更改优化顺序来使W能够更快地增加并收敛。如果W在内循环中能够很快地达到最优,那么坐标上升法会是一个很高效的求极值方法。

下面通过一张图来展示:

椭圆代表了二次函数的各个等高线,变量数为2,起始坐标是(2,-2)。图中的直线式迭代优化的路径,可以看到每一步都会向最优值前进一步,而且前进路线是平行于坐标轴的,因为每一步只优化一个变量。

3.2 核函数(Kernels)

定义 3.1 (核或正定核)设是中的一个子集,称定义在上的函数是核函数,如果存在一个从到Hilbert空间的映射(1.1)

使得对任意的,

都成立。其中表示Hilbert空间中的内积。

考虑我们最初在“线性回归”中提出的问题,特征是房子的面积x,这里的x是实数,结果y是房子的价格。假设我们从样本点的分布中看到x和y符合3次曲线,那么我们希望使用x的三次多项式来逼近这些样本点。那么首先需要将特征x扩展到三维

,然后寻找特征和结果之间的模型。我们将这种特征变换称作特征映射(feature

mapping)。映射函数称作

,在这个例子中

我们希望将得到的特征映射后的特征应用于SVM分类,而不是最初的特征。这样,我们需要将前面

公式中的内积从

,映射到

。

至于为什么需要映射后的特征而不是最初的特征来参与计算,上面提到的(为了更好地拟合)是其中一个原因,另外的一个重要原因是样例可能存在线性不可分的情况,而将特征映射到高维空间后,往往就可分了。(在《数据挖掘导论》Pang-Ning Tan等人著的《支持向量机》那一章有个很好的例子说明)

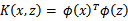

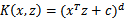

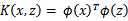

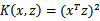

将核函数形式化定义,如果原始特征内积是

,映射后为

,那么定义核函数(Kernel)为

到这里,我们可以得出结论,如果要实现该节开头的效果,只需先计算

,然后计算

即可,然而这种计算方式是非常低效的。比如最初的特征是n维的,我们将其映射到

维,然后再计算,这样需要

的时间。那么我们能不能想办法减少计算时间呢?

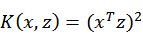

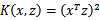

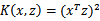

先看一个例子,假设x和z都是n维的,

展开后,得

这个时候发现我们可以只计算原始特征x和z内积的平方(时间复杂度是O(n)),就等价与计算映射后特征的内积。也就是说我们不需要花

时间了。

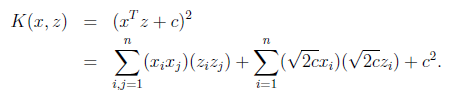

现在看一下映射函数(n=3时),根据上面的公式,得到

也就是说核函数

只能在选择这样的

作为映射函数时才能够等价于映射后特征的内积。

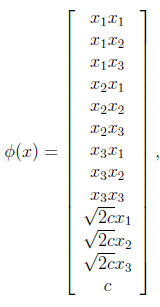

再看一个核函数

对应的映射函数(n=3时)是

更一般地,核函数

对应的映射后特征维度为

。(求解方法参见http://zhidao.baidu.com/question/16706714.html)。

由于计算的是内积,我们可以想到IR中的余弦相似度,如果x和z向量夹角越小,那么核函数值越大,反之,越小。因此,核函数值是

和

的相似度。

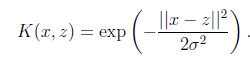

再看另外一个核函数

这时,如果x和z很相近(

),那么核函数值为1,如果x和z相差很大(

),那么核函数值约等于0。由于这个函数类似于高斯分布,因此称为高斯核函数,也叫做径向基函数(Radial

Basis Function 简称RBF)。它能够把原始特征映射到无穷维。

既然高斯核函数能够比较x和z的相似度,并映射到0到1,回想logistic回归,sigmoid函数可以,因此还有sigmoid核函数等等。

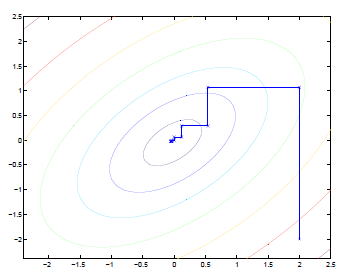

下面有张图说明在低维线性不可分时,映射到高维后就可分了,使用高斯核函数。

来自Eric Xing的slides

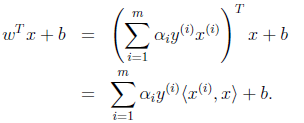

注意,使用核函数后,怎么分类新来的样本呢?线性的时候我们使用SVM学习出w和b,新来样本x的话,我们使用

来判断,如果值大于等于1,那么是正类,小于等于是负类。在两者之间,认为无法确定。如果使用了核函数后,

就变成了

,是否先要找到

,然后再预测?答案肯定不是了,找

很麻烦,回想我们之前说过的

只需将

替换成

,然后值的判断同上。

核函数有效性判定

问题:给定一个函数K,我们能否使用K来替代计算

,也就说,是否能够找出一个

,使得对于所有的x和z,都有

?

比如给出了

,是否能够认为K是一个有效的核函数。

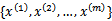

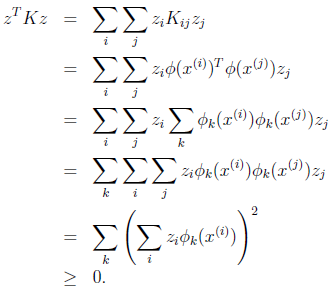

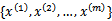

下面来解决这个问题,给定m个训练样本

,每一个

对应一个特征向量。那么,我们可以将任意两个

和

带入K中,计算得到

。I可以从1到m,j可以从1到m,这样可以计算出m*m的核函数矩阵(Kernel

Matrix)。为了方便,我们将核函数矩阵和

都使用K来表示。

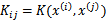

如果假设K是有效地核函数,那么根据核函数定义

可见,矩阵K应该是个对称阵。让我们得出一个更强的结论,首先使用符号

来表示映射函数

的第k维属性值。那么对于任意向量z,得

最后一步和前面计算

时类似。从这个公式我们可以看出,如果K是个有效的核函数(即

和

等价),那么,在训练集上得到的核函数矩阵K应该是半正定的(

)

这样我们得到一个核函数的必要条件:

K是有效的核函数 ==> 核函数矩阵K是对称半正定的。

可幸的是,这个条件也是充分的,由Mercer定理来表达。

| Mercer定理: 如果函数K是  上的映射(也就是从两个n维向量映射到实数域)。那么如果K是一个有效核函数(也称为Mercer核函数),那么当且仅当对于训练样例  ,其相应的核函数矩阵是对称半正定的。 |

,而只需要在训练集上求出各个

,然后判断矩阵K是否是半正定(使用左上角主子式大于等于零等方法)即可。

许多其他的教科书在Mercer定理证明过程中使用了

范数和再生希尔伯特空间等概念,但在特征是n维的情况下,这里给出的证明是等价的。

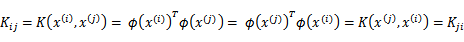

核函数不仅仅用在SVM上,但凡在一个模型后算法中出现了

,我们都可以常使用

去替换,这可能能够很好地改善我们的算法。

相关文章推荐

- SVM(三),支持向量机,线性不可分和核函数

- SVM(三),支持向量机,线性不可分和核函数

- SVM(三),支持向量机,线性不可分和核函数

- SVM(三),支持向量机,线性不可分和核函数

- SVM(三)支持向量机,线性不可分和核函数

- SVM(三)支持向量机,线性不可分和核函数

- SVM支持向量机原理(三)线性不可分支持向量机与核函数

- 支持向量机原理(三)线性不可分支持向量机与核函数

- 机器学习(18)之支持向量机原理(三)线性不可分支持向量机与核函数

- 机器学习二十:线性不可分支持向量机与核函数

- OpenCV支持向量机SVM对线性不可分数据的处理

- 第11节--支持向量机(SVM)--线性不可分

- 支持向量机原理(三)线性不可分支持向量机与核函数

- OpenCV之ml 模块. 机器学习:支持向量机(SVM)介绍 支持向量机对线性不可分数据的处理

- SVM 为何需要核函数 & 线性不可分转化为高维线性可分

- 支持向量机,线性不可分和核函数

- 支持向量机SVM之处理线性不可分数据

- 机器学习(18)之支持向量机原理(三)线性不可分支持向量机与核函数

- SVM边学边总结系列——线性不可分情况

- 简单介绍支持向量机(SVM)与核函数