(二)hadoop学习:集群环境搭建

2013-10-28 21:27

756 查看

引用:http://blog.csdn.net/shan9liang/article/details/9841933

一、硬件环境

1、windows 7 专业 64位

2、VMware Workstation ACE 版 6.0.2

3、Redhat Linux 5

4、Hadoop-1.2.1

二、安装 VMware Workstation 和Redhat Linux 5

1、VMware Workstation和Redhat Linux 5的安装,网上到处都是,我也是在网上随便找的,你可以找写得更详细准确的,这里不再赘述,可参考:

http://www.docin.com/p-30647520.html

http://wenku.baidu.com/view/1bfeb7651ed9ad51f01df2c9.html

注:当你在虚拟机上安装完一个Linux后,不要重复安装步骤,使用虚拟机带的克隆功能,可以很容易复制出多台一模一样的Linux。

可参考:

http://wenku.baidu.com/view/befc8052be23482fb4da4c29.html

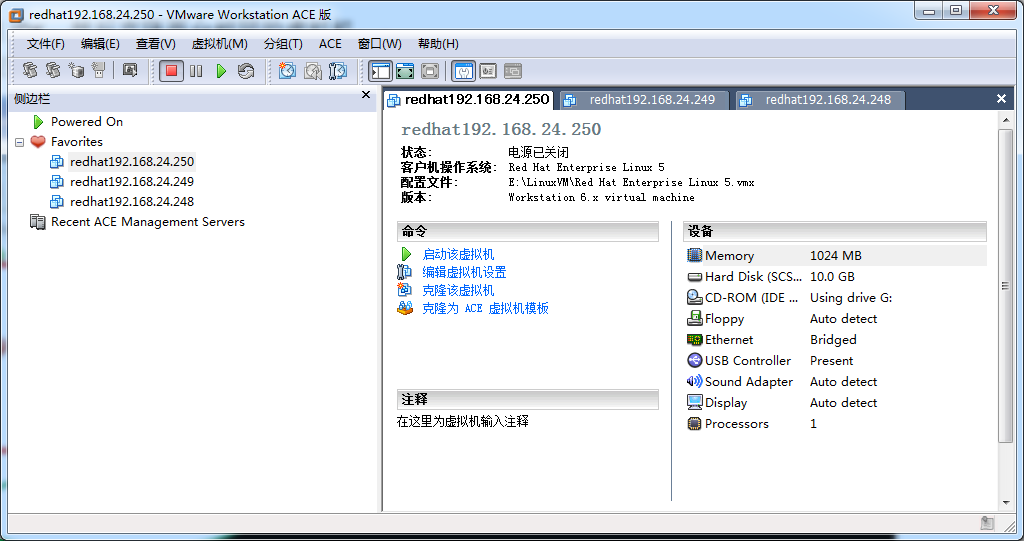

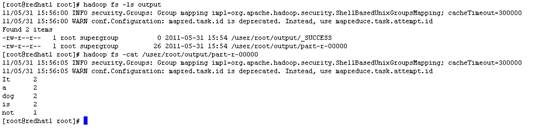

完成这一步骤后的效果

三、安装配置Hadoop

1、安装hadoop前先配置Linux

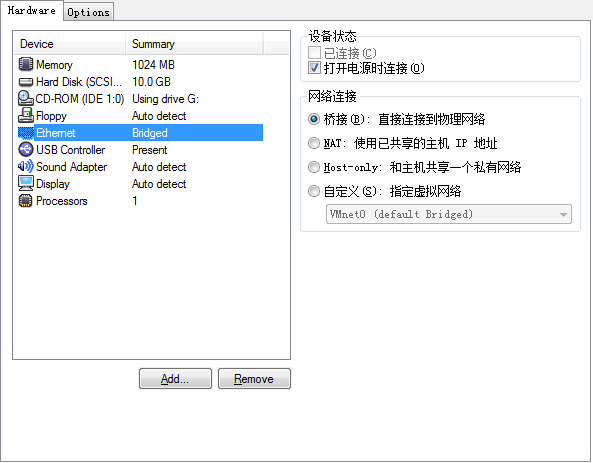

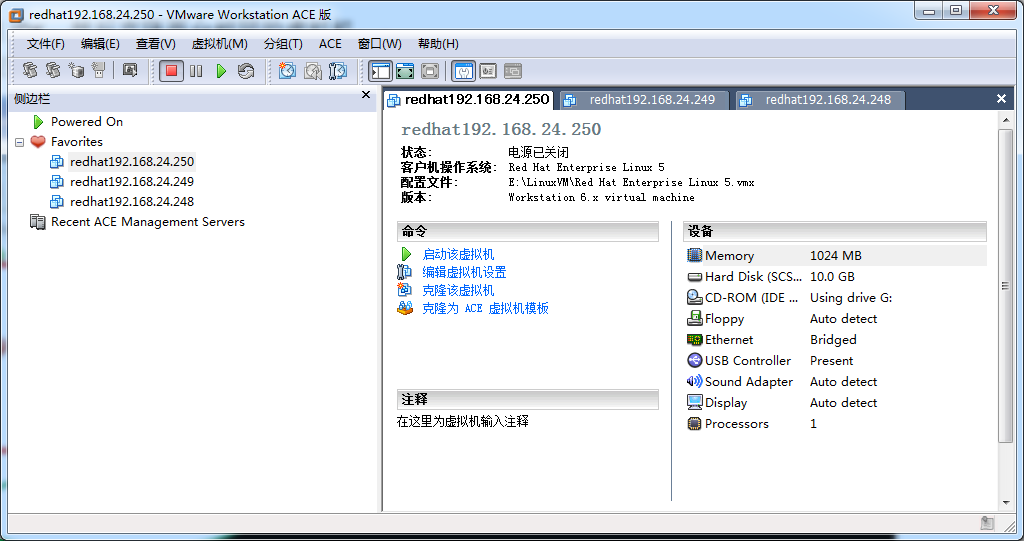

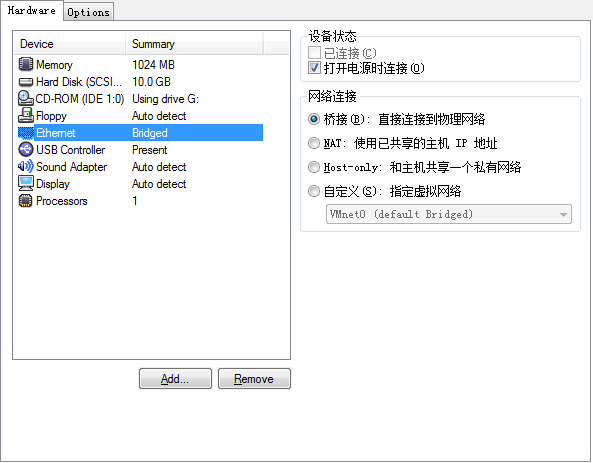

(1)更改三台机器的网络连接方式

选中要更改的虚拟机,右击-设置(Settings)

(2)以root用户登录Linux,设置IP地址和默认网关(三台机器都要设置)

输入vi /etc/sysconfig/network-scripts/ifcfg-eth0 ,(vi的使用不再赘述,不懂自己网上查)修改该文件内容为:

DEVICE=eth0

BOOTPROTO=static

IPADDR=192.168.24.250

GATEWAY=192.168.27.254

NETMASK=255.255.255.0

ONBOOT=yes

IP地址和默认网关根据自己需要进行设置

(3)配置虚拟机的主机名(三台机器都要设置)

输入vi /etc/sysconfig/network

NETWORKING=yes

NETWORKING_IPV6=yes

HOSTNAME=redhat1

(4)配置主机名与ip地址的对应关系(三台机器都要设置)

输入 vi /etc/hosts

127.0.0.1 localhost

192.168.24.250 redhat1

192.168.24.249 redhat2

192.168.24.248 redhat3

这是标准内容。去掉多余的,否则可能出现Hadoop在master查看live

nodes为0

(5)关闭防火墙(三台机器都要设置)

输入 chkconfig iptables off 开机不启动防火墙

输入 service iptables stop 关闭当前防火墙服务

当然也可以设置防火墙对hadoop放行,为了简单起见,我这里就直接关闭防火墙了。

(6)测试网络是否联通

设置完成之后,在每台虚拟机之间执行ping命令,保证虚拟机之间网络没有问题

如:ping 192.168.24.249

2、建立linux之间ssh无密码登录

这个网上也到处都是,参考:

http://www.2cto.com/os/201301/186673.html

http://www.linuxidc.com/Linux/2008-09/15952.htm

到此为止,铺垫工作算是做完了。

3、安装和配置JDK(三台机器都要安装)

这个参考我的文章

http://www.jialinblog.com/?p=74

http://blog.csdn.net/shan9liang/article/details/9117021

4、安装hadoop(三台机器都要安装)

(1)到hadoop官网下载hadoop1.2.0

(2)使用ftp上传到linux,如果不懂,可以参考我的文章:

http://blog.csdn.net/shan9liang/article/details/9110559

http://www.jialinblog.com/?p=64

(3)解压安装

进入hadoop-1.2.0.tar.gz所在的目录

输入:

tar -zvxf hadoop-1.2.0.tar.gz

即安装完毕

5、配置Hadoop(三台机器都要设置)

(1)配置hadoop环境变量

和设置jdk环境变量一样

命令:vi /etc/profile

在文件最后输入:

export HADOOP_HOME=/usr/local/hadoop-1.2.0

export PATH=$PATH:$HADOOP_HOME/bin

执行命令source /etc/profile 使profile生效

(2)配置hadoop运行参数

更改hadoop安装路径下/conf/hadoop-env.sh的文件(三台机器都要设置)

第9行加入export JAVA_HOME=/usr/java/jdk1.7.0_21

更改hadoop安装路径/conf/masters和slaves两个文件。(只配置192.168.24.250虚拟机)

masters中输入:192.168.24.250

slaves中输入:

192.168.24.249

192.168.24.248

配置hadoop安装路径/conf/core-site.xml、hdfs-site.xml和mapred-site.xml三个文件。(三台机器都要设置)

core-site.xml:

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://192.168.24.250:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/tmp</value>

</property>

</configuration>

hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

mapred-site.xml:

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>192.168.24.250:9001</value>

</property>

</configuration>

(3)格式化文件系统

命令:Hadoop namenode –format

至此hadoop已经安装配置完毕了。

四、测试

1、启动hadoop

在192.168.24.250机器上执行如下指令,启动hadoop安装目录bin下:

Start-all.sh

对于hadoop来说,启动所有进程是鼻血的,但是如果有必要,你依然可以只启动HDFS(start-dfs)或MapReduce(start-mapred.sh)

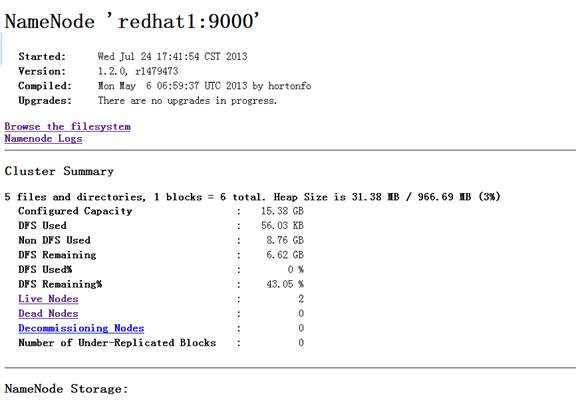

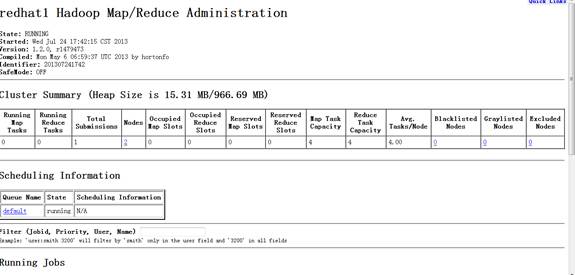

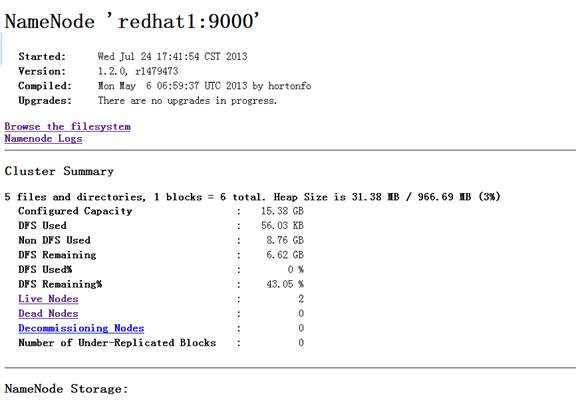

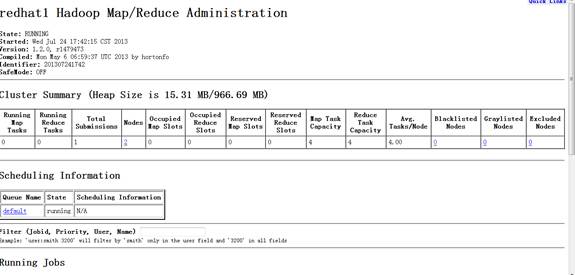

Web浏览器监视HDFS文件系统状态和MAPREDUCE执行任务的情况。

HDFS文件系统

浏览器中输入:http://192.168.11.188:50070/

浏览器中输入:http://192.168.11.188:50030

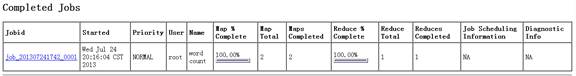

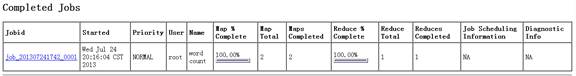

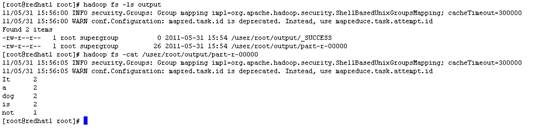

2、运行hadoop自带的wordcount示例

依次执行命令:

echo “It is a dog”> input1

echo "it is not a dog" > input2

hadoop fs -mkdir input

hadoop fs -copyFromLocal /root/input* input

hadoop jar /usr/local/hadoop-1.2.0/hadoop-examples-1.2.0.jar wordcount input output

可以查看运行状态http://192.168.24.250:50030

查看运行结果

至此全部成功!

一、硬件环境

1、windows 7 专业 64位

2、VMware Workstation ACE 版 6.0.2

3、Redhat Linux 5

4、Hadoop-1.2.1

| Windows | VM | 虚拟机器Linux | IP | 作用 |

| Window 7 64位 | VMware Workstation | Redhat1 | 192.168.24.250 | NameNode、master、jobTracker |

| Redhat2 | 192.168.24.249 | DataNode、slave、taskTracker | ||

| Redhat3 | 192.168.24.248 | DataNode、slave、taskTracker |

1、VMware Workstation和Redhat Linux 5的安装,网上到处都是,我也是在网上随便找的,你可以找写得更详细准确的,这里不再赘述,可参考:

http://www.docin.com/p-30647520.html

http://wenku.baidu.com/view/1bfeb7651ed9ad51f01df2c9.html

注:当你在虚拟机上安装完一个Linux后,不要重复安装步骤,使用虚拟机带的克隆功能,可以很容易复制出多台一模一样的Linux。

可参考:

http://wenku.baidu.com/view/befc8052be23482fb4da4c29.html

完成这一步骤后的效果

三、安装配置Hadoop

1、安装hadoop前先配置Linux

(1)更改三台机器的网络连接方式

选中要更改的虚拟机,右击-设置(Settings)

(2)以root用户登录Linux,设置IP地址和默认网关(三台机器都要设置)

输入vi /etc/sysconfig/network-scripts/ifcfg-eth0 ,(vi的使用不再赘述,不懂自己网上查)修改该文件内容为:

DEVICE=eth0

BOOTPROTO=static

IPADDR=192.168.24.250

GATEWAY=192.168.27.254

NETMASK=255.255.255.0

ONBOOT=yes

IP地址和默认网关根据自己需要进行设置

(3)配置虚拟机的主机名(三台机器都要设置)

输入vi /etc/sysconfig/network

NETWORKING=yes

NETWORKING_IPV6=yes

HOSTNAME=redhat1

(4)配置主机名与ip地址的对应关系(三台机器都要设置)

输入 vi /etc/hosts

127.0.0.1 localhost

192.168.24.250 redhat1

192.168.24.249 redhat2

192.168.24.248 redhat3

这是标准内容。去掉多余的,否则可能出现Hadoop在master查看live

nodes为0

(5)关闭防火墙(三台机器都要设置)

输入 chkconfig iptables off 开机不启动防火墙

输入 service iptables stop 关闭当前防火墙服务

当然也可以设置防火墙对hadoop放行,为了简单起见,我这里就直接关闭防火墙了。

(6)测试网络是否联通

设置完成之后,在每台虚拟机之间执行ping命令,保证虚拟机之间网络没有问题

如:ping 192.168.24.249

2、建立linux之间ssh无密码登录

这个网上也到处都是,参考:

http://www.2cto.com/os/201301/186673.html

http://www.linuxidc.com/Linux/2008-09/15952.htm

到此为止,铺垫工作算是做完了。

3、安装和配置JDK(三台机器都要安装)

这个参考我的文章

http://www.jialinblog.com/?p=74

http://blog.csdn.net/shan9liang/article/details/9117021

4、安装hadoop(三台机器都要安装)

(1)到hadoop官网下载hadoop1.2.0

(2)使用ftp上传到linux,如果不懂,可以参考我的文章:

http://blog.csdn.net/shan9liang/article/details/9110559

http://www.jialinblog.com/?p=64

(3)解压安装

进入hadoop-1.2.0.tar.gz所在的目录

输入:

tar -zvxf hadoop-1.2.0.tar.gz

即安装完毕

5、配置Hadoop(三台机器都要设置)

(1)配置hadoop环境变量

和设置jdk环境变量一样

命令:vi /etc/profile

在文件最后输入:

export HADOOP_HOME=/usr/local/hadoop-1.2.0

export PATH=$PATH:$HADOOP_HOME/bin

执行命令source /etc/profile 使profile生效

(2)配置hadoop运行参数

更改hadoop安装路径下/conf/hadoop-env.sh的文件(三台机器都要设置)

第9行加入export JAVA_HOME=/usr/java/jdk1.7.0_21

更改hadoop安装路径/conf/masters和slaves两个文件。(只配置192.168.24.250虚拟机)

masters中输入:192.168.24.250

slaves中输入:

192.168.24.249

192.168.24.248

配置hadoop安装路径/conf/core-site.xml、hdfs-site.xml和mapred-site.xml三个文件。(三台机器都要设置)

core-site.xml:

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://192.168.24.250:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/tmp</value>

</property>

</configuration>

hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

mapred-site.xml:

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>192.168.24.250:9001</value>

</property>

</configuration>

(3)格式化文件系统

命令:Hadoop namenode –format

至此hadoop已经安装配置完毕了。

四、测试

1、启动hadoop

在192.168.24.250机器上执行如下指令,启动hadoop安装目录bin下:

Start-all.sh

对于hadoop来说,启动所有进程是鼻血的,但是如果有必要,你依然可以只启动HDFS(start-dfs)或MapReduce(start-mapred.sh)

Web浏览器监视HDFS文件系统状态和MAPREDUCE执行任务的情况。

HDFS文件系统

浏览器中输入:http://192.168.11.188:50070/

浏览器中输入:http://192.168.11.188:50030

2、运行hadoop自带的wordcount示例

依次执行命令:

echo “It is a dog”> input1

echo "it is not a dog" > input2

hadoop fs -mkdir input

hadoop fs -copyFromLocal /root/input* input

hadoop jar /usr/local/hadoop-1.2.0/hadoop-examples-1.2.0.jar wordcount input output

可以查看运行状态http://192.168.24.250:50030

查看运行结果

至此全部成功!

相关文章推荐

- DayDayUP_大数据学习课程[1]_hadoop2.6.0完全分布式集群环境和伪分布式集群搭建

- 学习搭建Hadoop+HBase+ZooKeeper分布式集群环境

- 大数据hadoop入门学习之集群环境搭建集合

- VirtualBox+CentOs虚拟集群搭建配置hadoop2.2.0学习环境

- Hadoop学习之HBase的集群环境搭建

- Hadoop学习(1):利用虚拟机搭建Hadoop集群环境

- spark学习1--centOS7.2下基于hadoop2.7.3的spark2.0集群环境搭建

- hadoop学习之路(一)hadoop集群服务搭建

- Docker环境下Hadoop分布式集群搭建

- hadoop、zookeeper、hbase、spark集群环境搭建

- spark 1.5、hadoop 2.7 集群环境搭建

- SSH简介与Hadoop集群环境搭建之 SSH免密钥登录

- hadoop2.6.2集群环境搭建在经过几天的环境搭建,终于搭建成功,其中对于hadoop的具体设置倒是没有碰到很多问题,反而在hadoop各节点之间的通信遇到了问题,而且还反复了很多遍,光虚拟机就重

- hadoop集群环境搭建之伪分布式集群环境搭建(一)

- hadoop入门学习系列之五Eclipse下搭建Hadoop2.6.5开发环境并写wordcount

- hadoop集群环境的搭建

- 大数据学习系列之八----- Hadoop、Spark、HBase、Hive搭建环境遇到的错误以及解决方法

- 搭建Oracle RAC 学习环境之---数据库集群软件安装

- 搭建hadoop集群环境

- 搭建hadoop2.6.0集群环境