Tiled convolutional neural networks(TCNN)

2013-07-17 09:22

549 查看

文章来源:http://cs.stanford.edu/~pangwei/papers/Le%20et%20al.%20-%202010%20-%20Tiled%20Convolutional%20Neural%20Networks.pdf

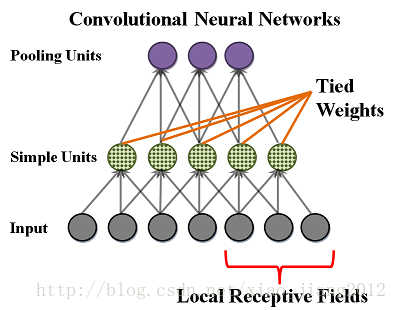

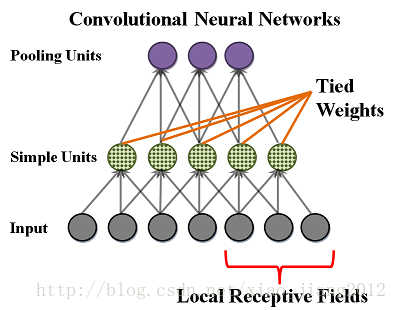

CNN基于两个关键性质:

1)局部接收域 ——计算的目的

2)权重共享——学习平移不变性。

1、权重共享的缺点:不能学习到其他的不变性,如旋转,尺度等,因为权重相同,等于第二层的池化单元是对相同基函数的池化。

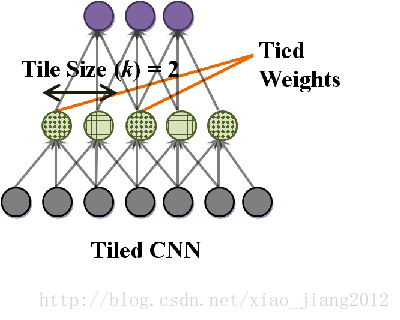

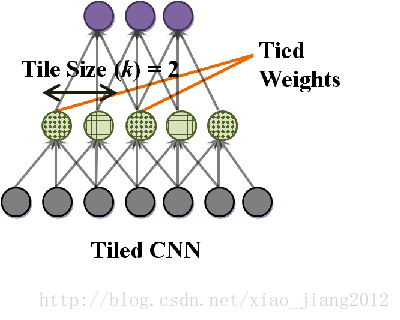

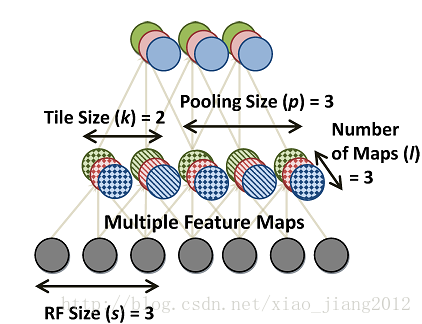

2、为了在计算量和不变性之间权衡,提出TCNN,即相邻单元间的权重不相同,距离远的单元权重相同。规定,只有相距k个单元的隐藏单元的权重相同。如果k=1,变为CNN。

上图,k=2,相邻两个单元的隐藏单元的权重相同。

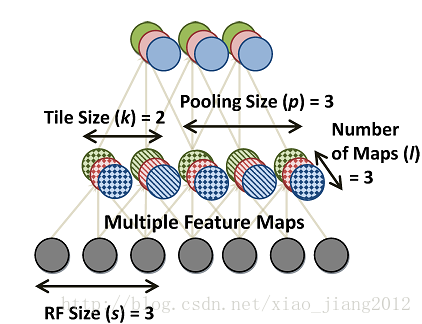

3、 为了学习到过完备集,我们允许多映射(multiple “maps“),即在一个局部接收域用多个滤波器学习多个特征特征。

上图中,map数是3,相同颜色的单元是相同的映射,每个映射中,相同纹理的单元有相同的权重。

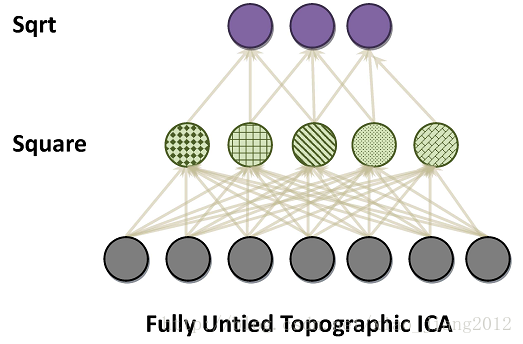

二、TCNN是基于TICA学习算法的。

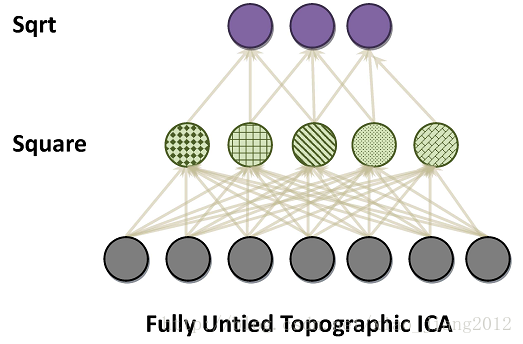

TICA相当于一个两层的网络:

第一层网络的激活函数是平方,第二层的激活函数是平方根。第一层的基函数W是通过学习获得,第二层的基函数是固定的,表示第一层的单元的拓扑结构(哪些单元相邻,池化)。

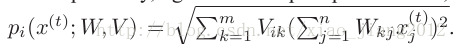

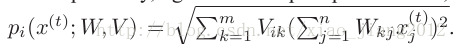

每一个第二层单元的激活函数为:

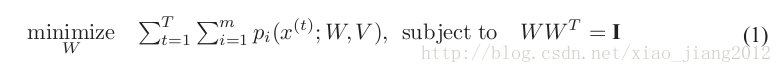

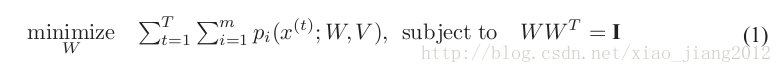

TICA学习参数W通过在第二层单元学习到稀疏特征表示,

是白化过的数据。

不同的权重和池化操作保证了学习特征的鲁棒性,对稀疏特征的优化保证了特征的选择性,这两个特性是特征不变性的核心。

为减少计算量,我们在正交操作时,只对具有相同输入单元的不同映射是权重进行正交。

CNN基于两个关键性质:

1)局部接收域 ——计算的目的

2)权重共享——学习平移不变性。

1、权重共享的缺点:不能学习到其他的不变性,如旋转,尺度等,因为权重相同,等于第二层的池化单元是对相同基函数的池化。

2、为了在计算量和不变性之间权衡,提出TCNN,即相邻单元间的权重不相同,距离远的单元权重相同。规定,只有相距k个单元的隐藏单元的权重相同。如果k=1,变为CNN。

上图,k=2,相邻两个单元的隐藏单元的权重相同。

3、 为了学习到过完备集,我们允许多映射(multiple “maps“),即在一个局部接收域用多个滤波器学习多个特征特征。

上图中,map数是3,相同颜色的单元是相同的映射,每个映射中,相同纹理的单元有相同的权重。

二、TCNN是基于TICA学习算法的。

TICA相当于一个两层的网络:

第一层网络的激活函数是平方,第二层的激活函数是平方根。第一层的基函数W是通过学习获得,第二层的基函数是固定的,表示第一层的单元的拓扑结构(哪些单元相邻,池化)。

每一个第二层单元的激活函数为:

TICA学习参数W通过在第二层单元学习到稀疏特征表示,

是白化过的数据。

不同的权重和池化操作保证了学习特征的鲁棒性,对稀疏特征的优化保证了特征的选择性,这两个特性是特征不变性的核心。

为减少计算量,我们在正交操作时,只对具有相同输入单元的不同映射是权重进行正交。

相关文章推荐

- 线性分类器之 logistic regression与neural networks的关系

- Andrew Ng机器学习week5(Neural Networks: Learning)编程习题

- Natural language processing: Deep Neural networks with multitask learning

- Convolutional Neural Networks卷积神经网络

- 今天开始学模式识别与机器学习(PRML),章节5.1,Neural Networks神经网络-前向网络。

- 斯坦福大学机器学习第六课“神经网络的表示(Neural Networks: Representation)”

- 6-Neural Networks--Representation

- 卷积神经网络Convolutional Neural Networks

- 论文阅读笔记——Generalizing Pooling Functions in Convolutional Neural Networks: Mixed, Gated, and Tree

- 学习笔记3 Supervised Neural Networks

- Stanford机器学习---第五讲. 神经网络的学习 Neural Networks learning

- 神经网络,流形和拓扑Neural Networks, Manifolds, and Topology

- 神经网络第一部分:背景Neural Networks, Part 1: Background

- 【Stanford机器学习笔记】7-Neural Networks: Learning

- deep learning 卷积神经网络的实现(Convolution Neural Networks)

- Convolutional neural networks(CNN) (一) 入门参考

- 「Deep Learning」R-CNN - Region-based Convolutional Neural Networks

- Deep Learning 23:dropout理解_之读论文“Improving neural networks by preventing co-adaptation of feature detectors”

- 循环神经网络(RNN,Recurrent Neural Networks)介绍

- 【学习笔记】【Coursera】【MachineLearning】Neural Networks