两个Redis集群 如何平滑数据迁移

2021-03-03 21:56

1061 查看

问题

由于生产环境的各种原因,我们需要对现有服务器进行迁移,包括线上正在运行的 redis 集群环境 如何去做?

涉及到数据源变动,原有数据如何平滑迁移到新实例,从而可以实现无缝迁移?

方案汇总

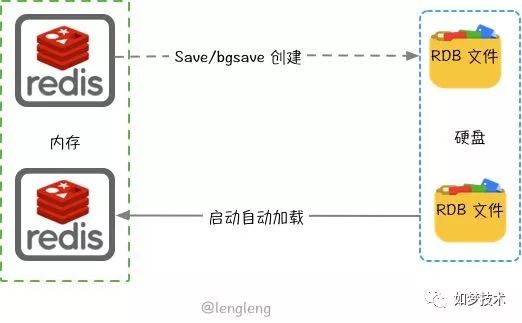

基于 redis 自身的RDB/AOF 备份机制

执行

save\bgsave

触发数据持久化RDB

文件拷贝redis备份文件(dump.rdb)到目标机器

重启目标实例重新

load

RDB 文件

关于 save/bgsave 的区别

| 命令 | save | bgsave |

|---|---|---|

| IO阻塞 | 同步 | 异步 |

| 复杂度 | O(n) | O(n) |

| 缺点 | 阻塞客户端 | 需要fork,消耗内存 |

基于 redis-dump

导入导出 json

备份

redis-dump 基于JSON 备份还原Redis的数据https://github.com/delano/redis-dump

# 导出命令

redis-dump –u 127.0.0.1:6379 > lengleng.json

# 导出指定数据库数据

redis-dump -u 127.0.0.1:6379 -d 15 > lengleng.json

# 如果redis设有密码

redis-dump –u :password@127.0.0.1:6379 > lengleng.json

# 导入命令

< lengleng.json redis-load

# 指定redis密码

< lengleng.json redis-load -u :password@127.0.0.1:6379

基于 redis-shake

实现 redis-cluster

迁移

redis-shake是阿里云Redis&MongoDB团队开源的用于redis数据同步的工具https://github.com/alibaba/RedisShake。

基于

Docker

创建两个集群

docker run --name redis-cluster1 -e CLUSTER_ANNOUNCE_IP=192.168.0.31 -p 8000-8005:7000-7005 -p 18000-18005:17000-17005 pig4cloud/redis-cluster:4.0

docker run --name redis-cluster2 -e CLUSTER_ANNOUNCE_IP=192.168.0.31 -p 8000-8005:7000-7005 -p 18000-18005:17000-17005 pig4cloud/redis-cluster:4.0

配置

redis-shake.conf

source.type: clustersource.address: master@192.168.0.31:7000 #配置一个节点自动发现target.type: clustertarget.address: master@192.168.0.31:8000 #配置一个节点自动发现

执行全量、增量同步

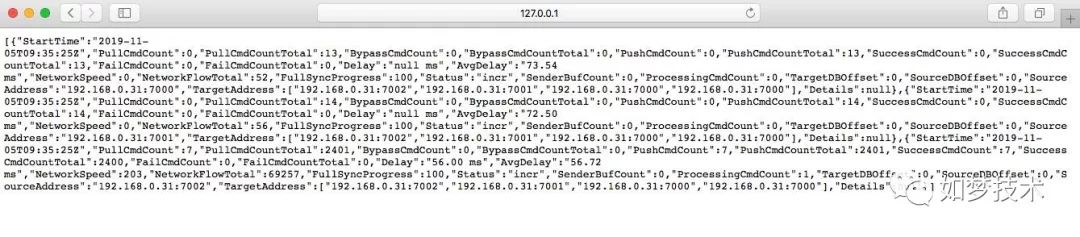

restful监控指标

# 用户可以通过restful监控指标查看内部运行状况,默认的restful端口是9320:

http://127.0.0.1:9320/metric

相关文章推荐

- redis集群 数据迁移方式 Hash槽 和 一致性hash对比,优缺点比较

- 如何将FastDFS存储数据平滑迁移至XSKY对象存储?

- Redis异构集群数据实时迁移

- redis集群配置加单实例数据迁移到集群

- 两个haoop集群之间迁移数据:

- 如何搭建redis集群---让集群拥有分片的数据内存的扩容和哨兵的高可用

- HBase迁移数据方案(两个集群不能通信)

- 如何把阿里云上redis实例的数据迁移到另外的实例?

- 不同的Hadoop 集群之间或版本之间的数据如何迁移

- HBase迁移数据方案(两个集群不能通信)

- HBase迁移数据方案1(两个集群不能通信)

- mysql5.7 InnoDB数据表空间文件平滑迁移

- mysql批量迁移数据至redis

- storm集群任务迁移问题平滑迁移

- 如何实现高可用的redis集群(方案介绍)

- Hadoop集群数据迁移

- spring结合redis如何实现数据的缓存

- 如何处理集群、分布架构的数据同步问题

- redis数据迁移过程

- 频繁变化的数据如何有效的缓存?(redis,memcached)