机器学习--决策树

2020-07-14 06:28

47 查看

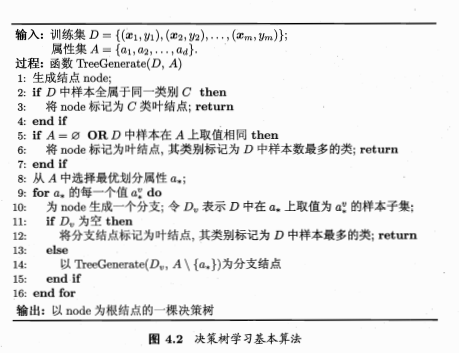

基本流程:

决策树:

根结点:属性测试,包含样本全集

内部结点:属性测试,根据属性测试的结果被划分到子结点中

叶结点:决策结果

划分选择:如何选择最优划分属性。目标是结点的"纯度"越来越高

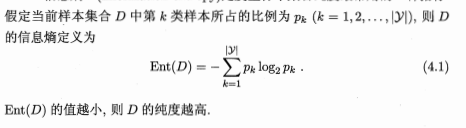

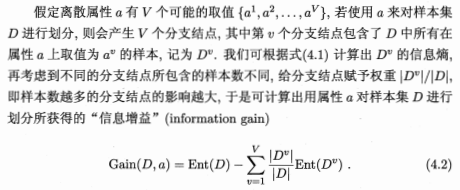

1.信息增益:

使用“信息熵”:

信息增益越大,意味使用属性a划分所获得的“纯度提升”越大。因此可以使用信息增益进行决策树的划分属性选择。即在决策树算法的图中的第八行选择属性a*=argmaxGain(D,a)

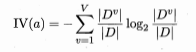

2.增益率

Gain_ratio(D,a)=Gain(D,a)/IV(a)

IV(a)=

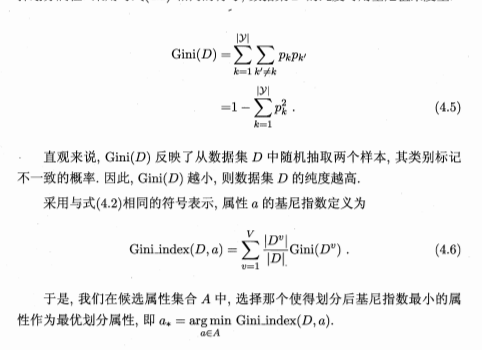

3.基尼指数

数据集的纯度可用基尼值来度量

剪枝:

如果能为决策树带来泛化性能提升,则将该子树替换为叶结点。

预剪枝,后剪枝

连续与缺失值

二分法、

转载于:https://www.cnblogs.com/Ccmr/p/7598021.html

相关文章推荐

- Spark2.0机器学习系列之3:决策树及Spark 2.0-MLlib、Scikit代码分析

- python机器学习实战2:实现决策树

- 看懂论文的机器学习基本知识(五)--随机森林、决策树

- 周志华《机器学习》课后答案——第4章.决策树

- 【机器学习笔记之二】决策树的python实现

- Python机器学习实践例子&&Kagle入门 Titanic乘客生存预测模型分析(利用决策树)

- 机器学习笔记(决策树)

- 小啃机器学习(1)-----ID3和C4.5决策树

- 【机器学习】决策树的优缺点

- 关于机器学习中决策树的相关问题也谈随机森林

- 机器学习(二)决策树

- 机器学习之:决策树(Decision Tree)

- 【机器学习】--决策树

- 机器学习入门学习笔记:(3.2)ID3决策树程序实现

- 机器学习:谈谈决策树

- 机器学习:梯度Boost决策树

- Python机器学习之决策树案例

- 机器学习技法-决策树和CART分类回归树构建算法

- 学习笔记【机器学习重点与实战】——3 决策树

- 机器学习实战 决策树代码 计算香农熵 Error return arrays must be of ArrayType