【Hive】Hive安装部署

前言

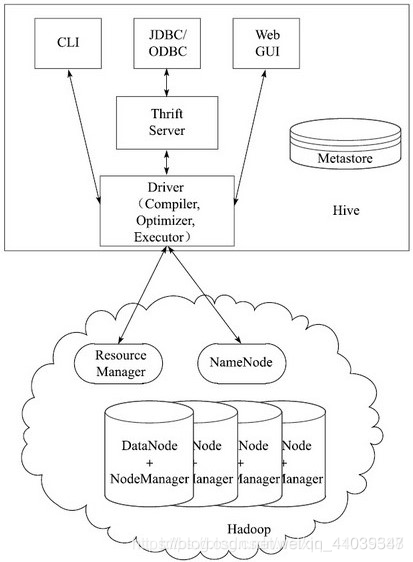

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供简单的SQL查询功能,可以将SQL语句转换为MapReduce任务进行运行。 其优点是学习成本低,可以通过类SQL语句快速实现简单的MapReduce统计,不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

Hive构建在基于静态批处理的Hadoop之上,由于Hadoop通常都有较高的延迟并且在作业提交和调度的时候需要大量的开销。因此,Hive并不适合那些需要低延迟的应用,它最适合应用在基于大量不可变数据的批处理作业,例如,网络日志分析。

Hive的特点是:可伸缩(在Hadoop集群上动态的添加设备)、可扩展、容错、输出格式的松散耦合。

Hive将元数据存储在关系型数据库(RDBMS)中,比如MySQL、Derby中。

Hive有三种模式连接到数据,其方式是:单用户模式,多用户模式和远程服务模式。(也就是内嵌模式、本地模式、远程模式)。

实验步骤

1.首先在Linux本地,新建/data/hive1目录,用于存放所需文件。

mkdir -p /data/hive1

切换目录到/data/hive1下,使用wget命令,下载hive所需安装包hive-1.1.0-cdh5.4.5.tar.gz以及mysql-connector-java-5.1.26-bin.jar。

cd /data/hive1

wget http://59.74.172.143:60000/allfiles/hive1/hive-1.1.0-cdh5.4.5.tar.gz

wget http://59.74.172.143:60000/allfiles/hive1/mysql-connector-java-5.1.26-bin.jar

2.将/data/hive1目录下的hive-1.1.0-cdh5.4.5.tar.gz,解压缩到/apps目录下。

tar -xzvf hive-1.1.0-cdh5.4.5.tar.gz -C /apps/

再切换到/apps目录下,将/apps/hive-1.1.0-cdh5.4.5,重命名为hive。

cd /apps

mv /apps/hive-1.1.0-cdh5.4.5/ /apps/hive

3.使用vim打开用户环境变量。

sudo vim ~/.bashrc

将Hive的bin目录,添加到用户环境变量PATH中,然后保存退出。

#hive config

export HIVE_HOME=/apps/hive

export PATH=HIVEHOME/bin:

HIVEHOME/bin:PATH

执行source命令,使Hive环境变量生效。

source ~/.bashrc

4.由于Hive需要将元数据,存储到Mysql中。所以需要拷贝/data/hive1目录下的mysql-connector-java-5.1.26-bin.jar到hive的lib目录下。

cp /data/hive1/mysql-connector-java-5.1.26-bin.jar /apps/hive/lib/

5.下面配置Hive,切换到/apps/hive/conf目录下,并创建Hive的配置文件hive-site.xml。

cd /apps/hive/conf

touch hive-site.xml

使用vim打开hive-site.xml文件。

vim hive-site.xml

并将下列配置项,添加到hive-site.xml文件中。

<configuration> <property> <name>javax.jdo.option.ConnectionURL</name> <value>jdbc:mysql://localhost:3306/hive?createDatabaseIfNotExsit=true;characterEncoding=latin1</value> </property> <property> <name>javax.jdo.option.ConnectionDriverName</name> <value>com.mysql.jdbc.Driver</value> </property> <property> <name>javax.jdo.option.ConnectionUserName</name> <value>root</value> </property> <property> <name>javax.jdo.option.ConnectionPassword</name> <value>strongs</value> </property> </configuration>

由于Hive的元数据会存储在Mysql数据库中,所以需要在Hive的配置文件中,指定mysql的相关信息。

javax.jdo.option.ConnectionURL:数据库链接字符串。

javax.jdo.option.ConnectionDriverName:连接数据库的驱动包。

javax.jdo.option.ConnectionUserName:数据库用户名。

javax.jdo.option.ConnectionPassword:连接数据库的密码。

此处的数据库的用户名及密码,需要设置为自身系统的数据库用户名及密码。

6.另外,还需要告诉Hive,Hadoop的环境配置。所以我们需要修改hive-env.sh文件。

首先我们将hive-env.sh.template重命名为hive-env.sh。

mv /apps/hive/conf/hive-env.sh.template /apps/hive/conf/hive-env.sh

mv /apps/hive/conf/hive-env.sh.template /apps/hive/conf/hive-env.sh

使用vim打开hive-env.sh文件。

vim hive-env.sh

追加Hadoop的路径,以及Hive配置文件的路径到文件中。

# Set HADOOP_HOME to point to a specific hadoop install directory

# HADOOP_HOME=${bin}/../../hadoop

HADOOP_HOME=/apps/hadoop

# Hive Configuration Directory can be controlled by:

# export HIVE_CONF_DIR=

export HIVE_CONF_DIR=/apps/hive/conf

7.下一步是配置Mysql,用于存储Hive的元数据。

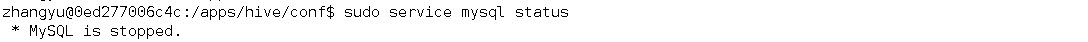

首先,需要保证Mysql已经启动。执行以下命令,查看Mysql的运行状态。

sudo service mysql status

通过输出,可以看出Mysql未启动。所以需要执行启动命令。

sudo service mysql start

如果未安装Mysql则需要执行安装命令。若我们的环境已安装Mysql,则无需执行此步。

sudo apt-get install mysql-server

8.开启Mysql数据库。

mysql -u root -p

此时会提示输入密码,此处密码为strongs

创建名为hive的数据库,编码格式为latin1,用于存储元数据。

create database hive CHARACTER SET latin1;

查看数据库是否创建成功。

show databases;

下面,输入exit退出Mysql。

exit

9.执行测试。由于Hive对数据的处理,依赖MapReduce计算模型,所以需要保证Hadoop相关进程已经启动。

输入jps,查看进程状态。若Hadoop相关进程未启动,则需启动Hadoop。

/apps/hadoop/sbin/start-all.sh

启动Hadoop后,在终端命令行界面,直接输入hive便可启动Hive命令行模式。

hive

输入HQL语句查询数据库,测试Hive是否可以正常使用。

show databases;

至此Hive安装完毕。

- hive部署安装(apache-hive-1.1.0)

- hadoop之hive的安装与部署

- Hive 安装部署及测试

- hive2.1.1安装部署

- centos6\7下hive1.2.1安装部署

- python使用impyla连接hive和impala(安装部署)

- HIVE 安装系列(1)安装部署 遇到虚拟机磁盘空间满 清理空间 折腾了半天

- Hadoop入门进阶课程8--Hive介绍和安装部署

- Hadoop2.3、 Hbase0.98、 Hive0.13架构中Hive的安装部署配置以及数据测试

- Hbase0.98版本的安装部署配置管理(Hadoop2.3、Hbase0.98、Hive0.13整合)

- 搭建3个节点的hadoop集群(完全分布式部署)--2安装mysql及hive

- Hadoop入门进阶课程8--Hive介绍和安装部署

- hive安装部署

- Hive分布式安装部署(详细教程)Hive+Mysql

- hive2.1.1 部署安装

- Hive安装部署

- apache_hive_2.1.1安装部署

- Hive的安装与部署

- Spark2.0.1 on yarn with hue 集群安装部署(六)hue+hive+sparksql

- hive安装部署