执行start-dfs.sh后,datenode没有启动的解决办法

2018-04-20 17:45

561 查看

执行start-dfs.sh后,datenode没有启动,很大一部分原因是因为在第一次格式化dfs后,启动并使用了hadoop,后来又重新执行了格式化命令(hdfs namenode -format),这时主节点namenode的clusterID会重新生成,而从节点datanode的clusterID 保持不变导致的。

解决办法如下:

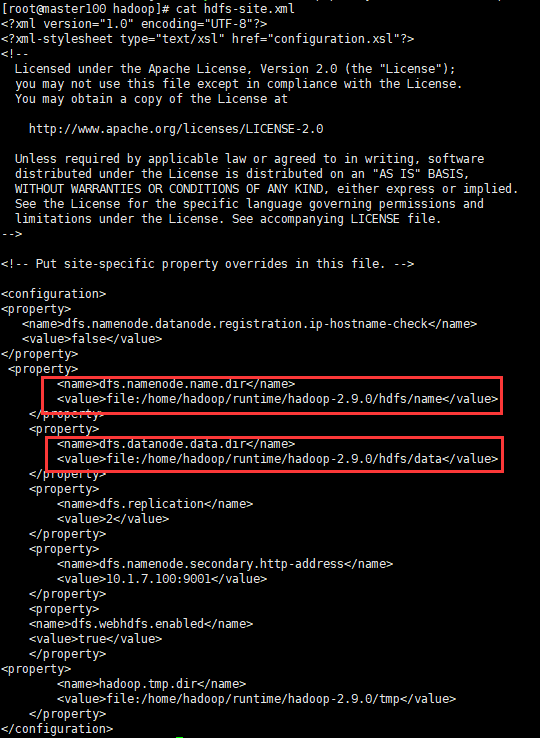

打开hdfs-site.xml找到如下节点

如上找到namenode和datanode(这个datanode是在从节点计算机中查看)的文件路径。分别进入这两个目录,分别打开VERSION查看clusterID是否一致。如果不一致,将namenode中的clusterID值赋值给datanode中VERSION中的clusterID。然后在重新运行脚本start-dfs.sh.

相关文章推荐

- 执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 大数据-执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 执行start-dfs.sh后,datenode没有启动

- 【Hadoop】关于hadoop在./start-all.sh指令启动后子节点没有datanode进程的解决办法

- 执行start-all.sh后,datanode没有启动

- Hadoop-2.2.0启动./start-dfs.sh报错解决方法

- Hadoop的datanode没有启动--解决办法

- Hadoop之——执行start-all.sh时namenode没有启动

- hadoop启动start-all.sh,slave节点没有datanode的问题

- hadoop启动命令 start-all.sh失效解决办法

- Hadoop中DataNode没有启动解决办法

- azkaban-web-start.sh启动时出现Table 'execution_flows' is marked as crashed and should be repaired Query错误的解决办法(图文详解)

- hadoop启动时,DataNode没有启动的解决办法

- shell脚本中执行时提示“没有那个文件或目录”的解决办法