From FCN to U-Net:经典分割网络的前世今生

2018-03-07 15:37

232 查看

关于Fully Convolution Network的一些细节介绍可以参考博主的另一篇文章:http://blog.csdn.net/jyzhang_cvml/article/details/79451749. 随着FCN提出,在2015年医学图像处理顶会MICCAI上,Olaf Ronneberger 设计了名为 U-Net 的医学图像分割网络。作者在文章中表示该网络具有两大优势:(1)在较少的医学图像数据中训练模型,并能够得到很好地分割结果。(2)采用了有效的 data argumentation 方法充分利用图像信息。其实在充分理解 FCN 的基础上再看 U-Net,其实也是换汤不换药而已。

分割算法面临的挑战

该部分是博主的个人理解,但是我认为对于理解类似FCN的U-Net具有很大帮助。谈到分割就不得不弄清楚 what 和 where 的问题。

– what 的问题

即分割目标的语义信息,来决定感受野中的这个目标到底是什么。通常来说,更大的感受野能够捕获越丰富的globa

4000

l图像信息,从而通过设计完备的卷积神经网络结构进行语义信息的提取,进而更准确的解释对应输出单元感受野之内的目标到底是什么。

– where 的问题

即分割目标的位置信息,来决定感兴趣目标的位置。通常来说,感受野越大,导致目标位置信息的损失越严重,进而定位信息不准确。

通常来说,分割任务需要准确的分辨出感兴趣区域,因此需要一个较大的感受野。那么如何获得较大的感受野?FCN和U-Net采用通过不断max-pooling的操作对得到的feature map进行降采样,从而让最后输出单元可以对应较大的感受野区域。然而这样的操作带来的副作用就是造成分割图像的分辨率降低,损失了有益的位置信息。

所以,如何补全降采样时丧失的分辨率信息是FCN和U-Net的重中之重:采用 deconvolution 反卷积的方法,通过学习得到的卷积核进行上采样,恢复出原先的分辨率。

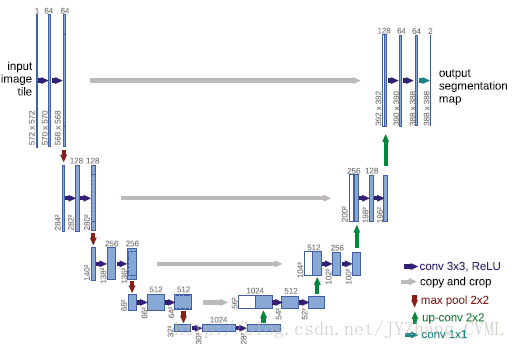

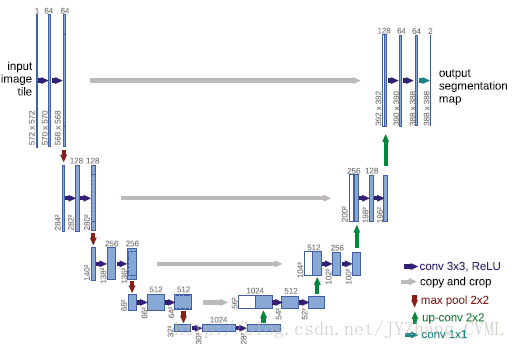

网络构架

可以看到这样的网络构建呈现 U 字型。左边从上到下的网络构架通过4次max_pooling操作将分辨率变成原先的1/16,但是能够得到较大的感受野区域,这样的过程在文章中被称为“Contracting Path”。而右边的构架是通过反卷积4次,将原先的低分辨率的feature map 还原成原始图像大小尺度,这样的过程被称为“Upsampled output”。在这两条路径之间还存在着“Feature Channels”进一步补全Contracting Path中损失的空间信息。

创新性

– data argument

根据处理细胞分割的问题,采用一种图像扭曲形变的argument方法

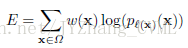

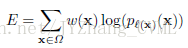

– 加权损失函数

通过这样的加权函数的设置,使得分割算法对于特定的boundry部分有一个很好的响应。

总结

其实在理解了FCN的基础上,再看U-Net无非就是有了一种更加具体特定的网络构架。依旧是通过反卷积+feature channal 的策略,解决感受野大小和图像分辨率的trade-off问题。

分割算法面临的挑战

该部分是博主的个人理解,但是我认为对于理解类似FCN的U-Net具有很大帮助。谈到分割就不得不弄清楚 what 和 where 的问题。

– what 的问题

即分割目标的语义信息,来决定感受野中的这个目标到底是什么。通常来说,更大的感受野能够捕获越丰富的globa

4000

l图像信息,从而通过设计完备的卷积神经网络结构进行语义信息的提取,进而更准确的解释对应输出单元感受野之内的目标到底是什么。

– where 的问题

即分割目标的位置信息,来决定感兴趣目标的位置。通常来说,感受野越大,导致目标位置信息的损失越严重,进而定位信息不准确。

通常来说,分割任务需要准确的分辨出感兴趣区域,因此需要一个较大的感受野。那么如何获得较大的感受野?FCN和U-Net采用通过不断max-pooling的操作对得到的feature map进行降采样,从而让最后输出单元可以对应较大的感受野区域。然而这样的操作带来的副作用就是造成分割图像的分辨率降低,损失了有益的位置信息。

所以,如何补全降采样时丧失的分辨率信息是FCN和U-Net的重中之重:采用 deconvolution 反卷积的方法,通过学习得到的卷积核进行上采样,恢复出原先的分辨率。

网络构架

可以看到这样的网络构建呈现 U 字型。左边从上到下的网络构架通过4次max_pooling操作将分辨率变成原先的1/16,但是能够得到较大的感受野区域,这样的过程在文章中被称为“Contracting Path”。而右边的构架是通过反卷积4次,将原先的低分辨率的feature map 还原成原始图像大小尺度,这样的过程被称为“Upsampled output”。在这两条路径之间还存在着“Feature Channels”进一步补全Contracting Path中损失的空间信息。

创新性

– data argument

根据处理细胞分割的问题,采用一种图像扭曲形变的argument方法

– 加权损失函数

通过这样的加权函数的设置,使得分割算法对于特定的boundry部分有一个很好的响应。

总结

其实在理解了FCN的基础上,再看U-Net无非就是有了一种更加具体特定的网络构架。依旧是通过反卷积+feature channal 的策略,解决感受野大小和图像分辨率的trade-off问题。

相关文章推荐

- 经典的卷积网络结构:AlexNet,VGGNet,Google Inception Net,ResNet(HR)

- c#.Net经典面试题目(6)_.Net编程_网络编程

- 语义分割(semantic segmentation) 常用神经网络介绍对比-FCN SegNet U-net DeconvNet

- 语义分割网络之PSPnet

- 语义分割(semantic segmentation) 常用神经网络介绍对比-FCN SegNet U-net DeconvNet

- 浅述经典的4种卷积网络之(3)Google Inception Net

- [pytorch] 深度学习分割网络U-net的pytorch模型实现

- [pytorch] 深度学习分割网络U-net的pytorch模型实现 原创 2017年03月08日 21:48:21 标签: python / 深度学习 / 生物图

- Segnet分割网络caffe教程(一)

- 全卷机神经网络图像分割(U-net)-keras实现

- 经典网络结构VGG-net《Very Deep Convolutional Networks for Large-Scale Image Recognition》

- U-Net及使用keras搭建U-Net分割网络

- 【深度学习系列】用PaddlePaddle和Tensorflow实现经典CNN网络GoogLeNet

- 深度学习分割网络U-net的pytorch模型实现

- 深度学习卷积神经网络——经典网络GoogLeNet(Inception V3)网络的搭建与实现

- 语义分割 常用神经网络介绍对比-FCN,SegNet,U-net DeconvNet

- 网络经典命令行---ping/netstat/tracert

- 语义分割经典神经网络框架汇总

- 语义分割(semantic segmentation) 常用神经网络介绍对比-FCN SegNet U-net DeconvNet

- TensorFlow实现经典深度学习网络(3):TensorFlow实现Google Inception Net