CNN之卷积计算层

2018-01-16 10:05

281 查看

1. CNN之卷积计算层

1.1 什么是卷积

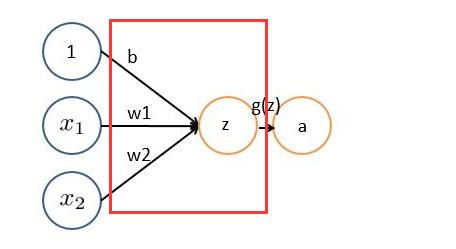

首先,我们来了解下什么是卷积操作。对图像(不同的数据窗口数据)和滤波矩阵(一组固定的权重:因为每个神经元的多个权重固定,所以又可以看做一个恒定的滤波器filter)做内积(逐个元素相乘再求和)的操作就是所谓的『卷积』操作,也是卷积神经网络的名字来源。

非严格意义上来讲,下图中红框框起来的部分便可以理解为一个滤波器,即带着一组固定权重的神经元。多个滤波器叠加便成了卷积层。

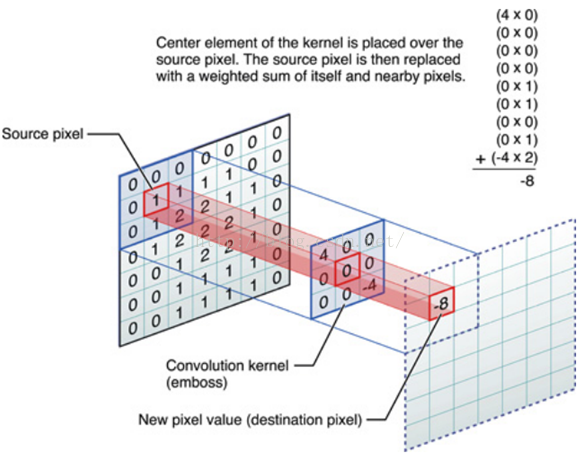

OK,举个具体的例子。比如下图中,图中左边部分是原始输入数据,图中中间部分是滤波器filter,图中右边是输出的新的二维数据。

分解下上图

对应位置上是数字先相乘后相加

=

中间滤波器filter与数据窗口做内积,其具体计算过程则是:4*0 + 0*0 + 0*0 + 0*0 + 0*1 + 0*1 + 0*0 + 0*1 + -4*2 = -8

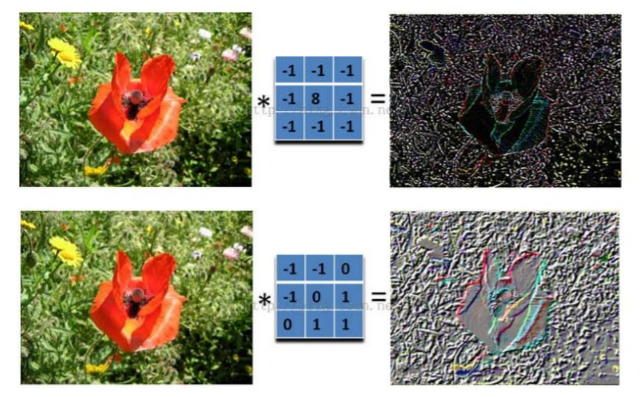

1.2 图像上的卷积

在下图对应的计算过程中,输入是一定区域大小(width*height)的数据,和滤波器filter(带着一组固定权重的神经元)做内积后等到新的二维数据。具体来说,左边是图像输入,中间部分就是滤波器filter(带着一组固定权重的神经元),不同的滤波器filter会得到不同的输出数据,比如颜色深浅、轮廓。相当于如果想提取图像的不同特征,则用不同的滤波器filter,提取想要的关于图像的特定信息:颜色深浅或轮廓。

如下图所示

1.3 GIF动态卷积图

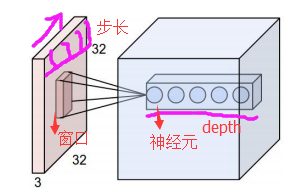

在CNN中,滤波器filter(带着一组固定权重的神经元)对局部输入数据进行卷积计算。每计算完一个数据窗口内的局部数据后,数据窗口不断平移滑动,直到计算完所有数据。这个过程中,有这么几个参数:a. 深度depth:神经元个数,决定输出的depth厚度。同时代表滤波器个数。

b. 步长stride:决定滑动多少步可以到边缘。

c. 填充值zero-padding:在外围边缘补充若干圈0,方便从初始位置以步长为单位可以刚好滑倒末尾位置,通俗地讲就是为了总长能被步长整除。

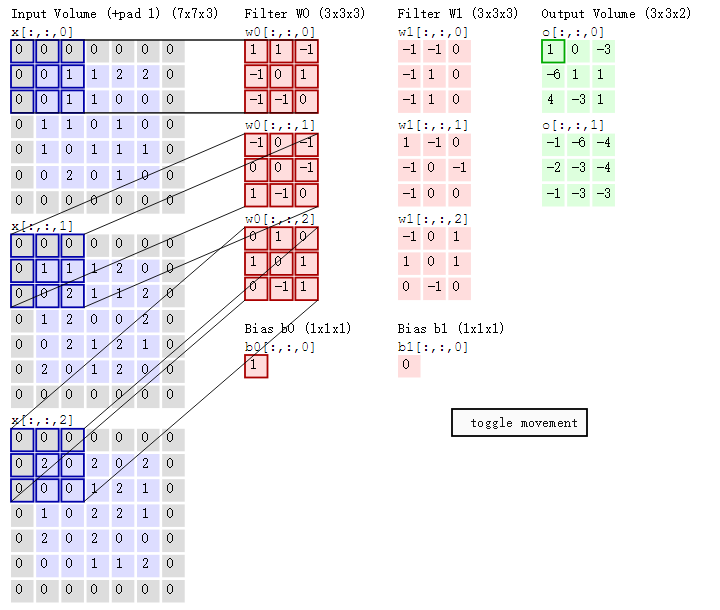

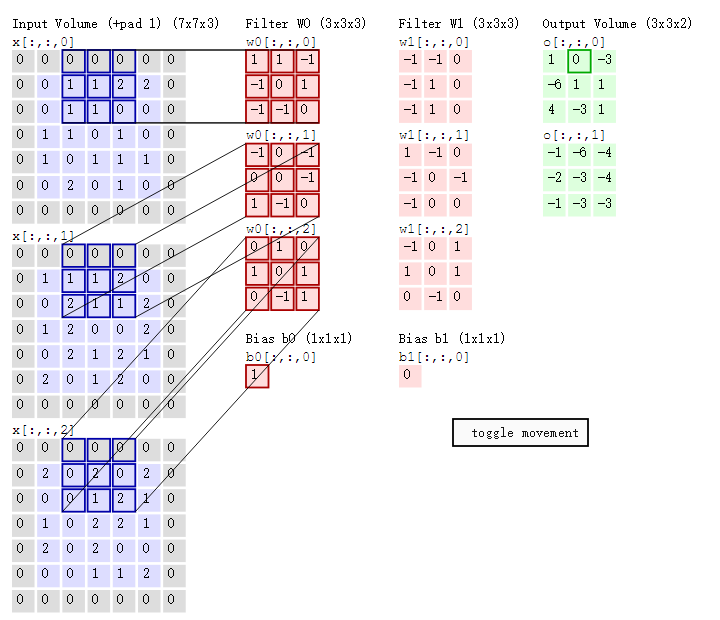

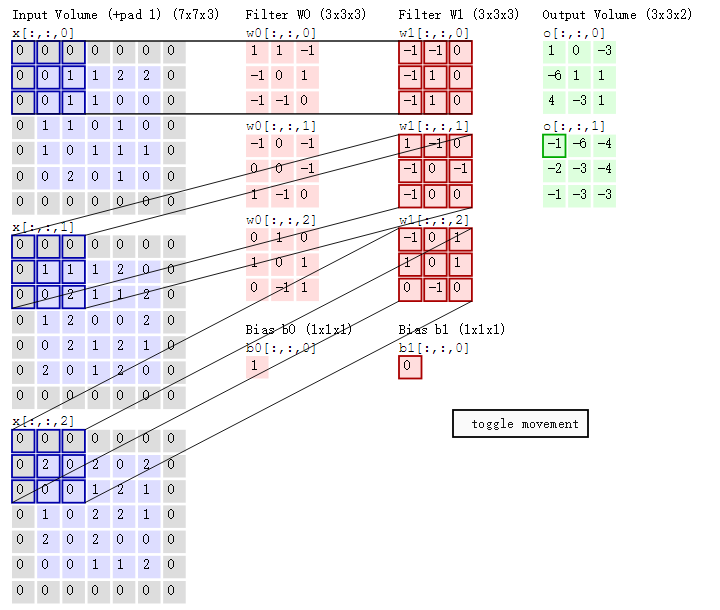

cs231n课程中有一张卷积动图,貌似是用d3js 和一个util 画的,我根据cs231n的卷积动图依次截取了18张图,然后用一gif 制图工具制作了一gif 动态卷积图。如下gif 图所示,可以看到:

两个神经元,即depth=2,意味着有两个滤波器。

数据窗口每次移动两个步长取3*3的局部数据,即stride=2。

zero-padding=1。

然后分别以两个滤波器filter为轴滑动数组进行卷积计算,得到两组不同的结果。

如果初看此图,可能不一定能立马理解啥意思,但结合上文的内容后,理解这个动图已经不是很困难的事情:

左边是输入(7*7*3中,7*7代表图像的像素/长宽,3代表R、G、B 三个颜色通道)

中间部分是两个不同的滤波器Filter w0、Filter w1

最右边则是两个不同的输出

随着左边数据窗口的平移滑动,滤波器Filter w0 / Filter w1对不同的局部数据进行卷积计算。

值得一提的是:

左边数据在变化,每次滤波器都是针对某一局部的数据窗口进行卷积,这就是所谓的CNN中的局部感知机制。

打个比方,滤波器就像一双眼睛,人类视角有限,一眼望去,只能看到这世界的局部。如果一眼就看到全世界,你会累死,而且一下子接受全世界所有信息,你大脑接收不过来。当然,即便是看局部,针对局部里的信息人类双眼也是有偏重、偏好的。比如看美女,对脸、胸、腿是重点关注,所以这3个输入的权重相对较大。

与此同时,数据窗口滑动,导致输入在变化,但中间滤波器Filter w0的权重(即每个神经元连接数据窗口的权重)是固定不变的,这个权重不变即所谓的CNN中的参数(权重)共享机制。

再打个比方,某人环游全世界,所看到的信息在变,但采集信息的双眼不变。btw,不同人的双眼 看同一个局部信息 所感受到的不同,即一千个读者有一千个哈姆雷特,所以不同的滤波器 就像不同的双眼,不同的人有着不同的反馈结果

我第一次看到上面这个动态图的时候,只觉得很炫,另外就是据说计算过程是“相乘后相加”,但到底具体是个怎么相乘后相加的计算过程 则无法一眼看出,网上也没有一目了然的计算过程。本文来细究下。

首先,我们来分解下上述动图,如下图

接着,我们细究下上图的具体计算过程。即上图中的输出结果1具体是怎么计算得到的呢?其实,类似wx + b,w对应滤波器Filter w0,x对应不同的数据窗口,b对应Bias b0,相当于滤波器Filter w0与一个个数据窗口相乘再求和后,最后加上Bias b0得到输出结果1,如下过程所示:

然后滤波器Filter w0固定不变,数据窗口向右移动2步,继续做内积计算,得到0的输出结果

最后,换做另外一个不同的滤波器Filter w1、不同的偏置Bias b1,再跟图中最左边的数据窗口做卷积,可得到另外一个不同的输出。

总结

1. 首先收输入层是毛东西?

就是输入的图像,有可能是三通道的有可能是单通道的。

比如28*28*1或者28*28*3 分别代表的是大小为28*28,通道数分别为单通道和三通道的图片

2. 其次,什么是filter呢

filter的最大的特点是其深度与输入层的深度是一致的。输入层是单通道,filter也是单通道。 输入层是三通道,filter也是三通道!!!

3. 最后输出层又是什么呢?

输出层的就是filter遍历输入层后的的计算结果。

如下图所示:

4. 那么具体的计算过程是怎么样的呢?

这里只是想说,输出层的深度是滤波器的个数!每一个filter遍历输入层会产生一个深度的输出层,那么n个输出层就会产生n个深度的输出层(也就是输出层的深度啦)。

这里再说一下,输出层每一个深度的计算过程。比如,输入层是28*28*3的图像,filter为3*3*3的滤波器。那么3个通道的filter会相应的每一个通道相互独立计算,然后再将3个通道的值相加在一起。

这就是每一个filter的计提的计算过程。现在就是CNN卷积的处理过程。

相关文章推荐

- CNN卷积各层的参数和链接个数的计算

- CNN 卷积之后 map大小的计算

- CNN卷积各层的参数和链接个数的计算

- 深度学习系列(十):从卷积计算到卷积神经网络CNN

- cnn学习之卷积或者池化后输出的map的size计算

- 用sklearn和tensorflow做boston房价的回归计算的比较(2)--卷积神经网路CNN

- CNN-卷积计算

- caffe中CNN卷积计算量估算

- CNN中的卷积操作的参数数计算

- (Tensorflow之十一)cnn卷积神经网络LeNet-5模型以及卷积核的计算

- cnn学习之卷积或者池化后输出的map的size计算

- CNN之卷积计算层

- 数据挖掘、目标检测中的cnn和cn---卷积网络和卷积神经网络

- 多通道卷积计算

- 多通道卷积计算

- 【深度学习-CNN】CNN中的参数与计算量

- CNN学习笔记(二)卷积神经网络经典结构

- 深度学习:CNN中RGB图像的卷积

- 深度学习与自然语言处理之四:卷积神经网络模型(CNN)

- CNN之卷积加速